性能基准测试新高度:Commons-Codec与其他库的全面对决

发布时间: 2024-09-25 15:59:58 阅读量: 79 订阅数: 59

commons-codec-android-1.15

# 1. 性能基准测试的理论基础

性能基准测试作为软件开发中的重要环节,其理论基础为我们提供了对软件性能评估的科学依据。在本章节中,我们将首先介绍性能基准测试的定义和目标,然后探讨其在软件开发生命周期中的作用和重要性。我们还将通过示例来说明性能基准测试的流程,包括如何定义测试目标、选择合适的测试工具、设计测试案例,以及分析和解读测试结果。本章将为读者理解性能基准测试的重要性、原则和方法论打下坚实的基础,为后续章节中深入探讨特定库的性能测试和优化提供理论支持。

```

// 示例代码块

// 性能基准测试的一个简单例子:

// 假设我们要测试一个排序算法的性能

import java.util.concurrent.TimeUnit;

public class SortPerformanceTest {

private static final int DATA_SIZE = 10000;

public static void main(String[] args) throws InterruptedException {

int[] data = generateRandomData(DATA_SIZE);

// 热身

sort(data.clone());

// 开始测试

long startTime = System.nanoTime();

sort(data);

long endTime = System.nanoTime();

// 输出测试结果

System.out.printf("Sort took %d nanoseconds\n", (endTime - startTime));

}

private static int[] generateRandomData(int size) {

Random rand = new Random();

int[] data = new int[size];

for (int i = 0; i < size; i++) {

data[i] = rand.nextInt();

}

return data;

}

private static void sort(int[] data) {

// 排序逻辑

}

}

```

该代码块通过简单的计时机制,演示了如何对一个数组排序算法的性能进行基本测量。通过定义测试范围和数据量,我们可以测量在一定条件下算法的执行时间,并通过多次执行取平均值来提高结果的准确性。这样的基准测试可以在软件开发中用于比较不同算法或实现的性能差异。

# 2. Commons-Codec库概述与实践应用

### 2.1 Commons-Codec核心功能解析

#### 2.1.1 编码与解码机制

Commons-Codec库是一个处理编码和解码操作的Java库,提供了多种编码格式的实现。编码是将数据转换为特定编码格式的过程,而解码则是将编码后的数据转换回原始形式。Commons-Codec采用了一套灵活的API,允许开发者以一致的方式处理不同类型的编码和解码需求。

编码与解码机制的关键在于编码器和解码器的实现。Commons-Codec通过工厂模式(Factory Pattern)提供了一种标准的接口来获取编码器和解码器实例。常见的编码格式如Base64、URL、Hex等都被封装为独立的类,使得开发者能够轻松实现各种场景下的编码解码需求。

#### 2.1.2 支持的编码格式

Commons-Codec支持多种编码格式,为开发者提供了便利。以下是一些核心的编码格式,及其用途:

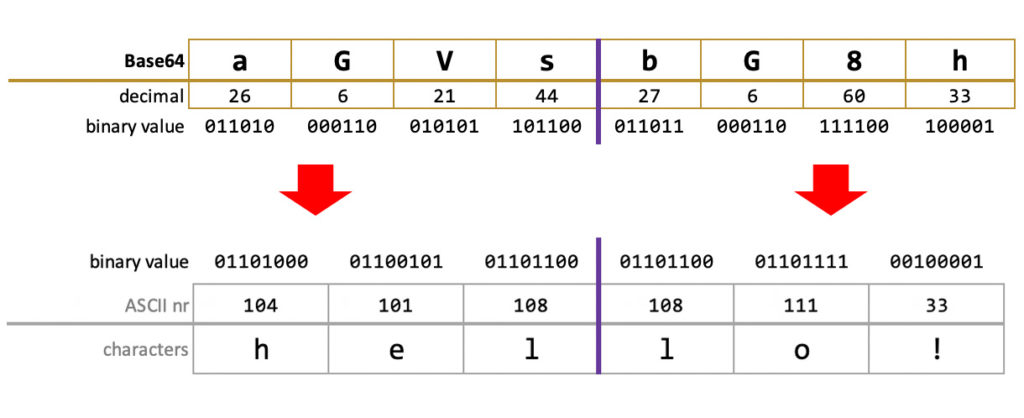

- **Base64编码**:用于在二进制数据和文本数据之间转换,尤其适用于在文本协议中传输二进制数据(如电子邮件、JSON字符串等)。

- **Hex编码**:将字节数据转换为十六进制字符串,常用于日志记录和调试。

- **URL编码**:将URL的非字母数字字符转换为%,+和%后跟两位十六进制数,以适应HTTP协议的URL传输要求。

- **MIME编码**:遵循MIME规范的编码方式,常用于网络数据传输。

- **String编码**:特殊字符的转义处理,通常用于不同系统间的数据交互。

### 2.2 Commons-Codec在实际项目中的应用

#### 2.2.1 性能优化案例分析

在实际项目中,Commons-Codec的应用可以带来性能上的优化。例如,在处理大量数据的序列化和反序列化操作时,使用高效且稳定的编码解码库能够确保数据传输的准确性和高效性。

以下是一个性能优化的案例分析:

假设一个Web服务需要将大量数据以JSON格式发送给客户端,数据中包含了特殊字符和非ASCII字符。使用纯Java实现的编码和解码可能会导致性能瓶颈。通过集成Commons-Codec库,可以显著提升性能。

#### 2.2.2 安全性考量与处理

编码和解码操作不仅仅是技术实现问题,同样也是安全性问题。正确的编码和解码可以防止诸如跨站脚本攻击(XSS)和数据篡改等安全威胁。

使用Commons-Codec处理URL编码和解码时,开发者需要注意对输入数据进行适当的验证和清洗,避免注入攻击。同样,在处理Base64编码时,应意识到Base64并非一种安全的编码机制,它仅仅是对数据进行透明的转换,不适合用于加密敏感信息。

### 2.3 Commons-Codec的扩展与定制

#### 2.3.1 源码定制化策略

在某些情况下,Commons-Codec提供的功能可能不完全符合特定项目的需求。这时,开发者可以采取源码定制化策略,即直接修改Commons-Codec的源码来实现额外的功能。

例如,如果需要为Commons-Codec添加一个新的编码器,开发者可以创建一个继承自`CodecBase`类的新类,并实现相应的编码和解码方法。之后,可以将这个新类编译成一个jar包,替换或覆盖原有版本的Commons-Codec库。

#### 2.3.2 接口扩展

0

0