YOLOv5图像跟踪模型选择指南:不同场景下的最佳选择,一文搞定

发布时间: 2024-08-18 16:50:03 阅读量: 39 订阅数: 37

移动观象台-一文搞定:招聘行业买量趋势和求职人群特征.pdf

# 1. YOLOv5图像跟踪模型简介

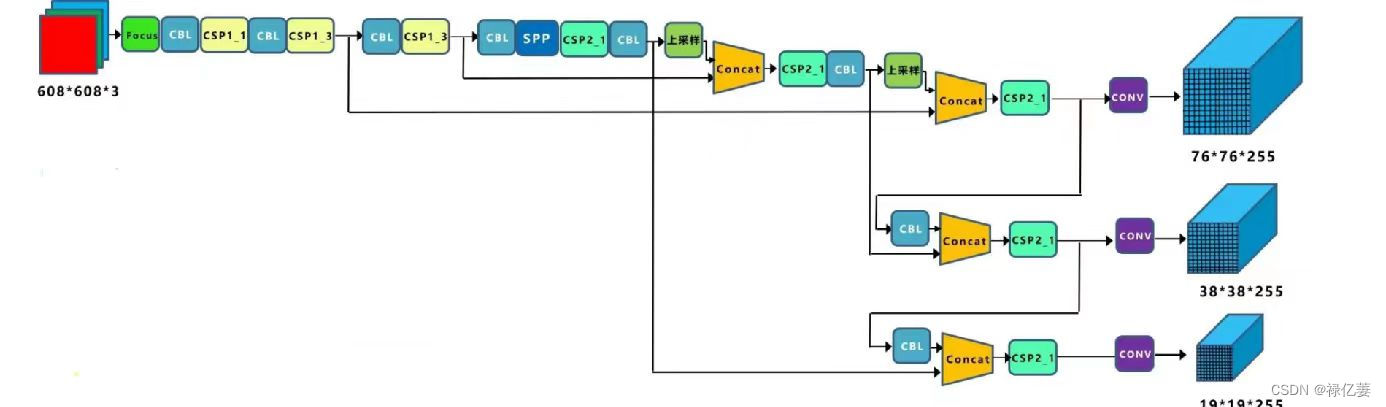

YOLOv5(You Only Look Once version 5)是一种先进的图像跟踪模型,以其速度快、精度高而闻名。它采用单次正向传播,直接从图像中预测边界框和类概率,无需复杂的候选区域生成和非极大值抑制步骤。

YOLOv5模型基于卷积神经网络(CNN),它将图像作为输入,并输出一个预测张量,其中包含边界框坐标、类概率和置信度分数。置信度分数表示模型对预测的信心,它用于过滤掉低置信度的预测。

# 2. YOLOv5图像跟踪模型选择指南

在选择YOLOv5图像跟踪模型时,需要考虑以下原则:

### 2.1 不同场景下的模型选择原则

| 场景 | 模型选择原则 |

|---|---|

| 实时跟踪 | 优先考虑推理速度快、模型轻量级的模型,如YOLOv5s、YOLOv5m |

| 高精度跟踪 | 优先考虑精度高的模型,如YOLOv5l、YOLOv5x |

| 特殊场景 | 根据具体场景需求,选择针对性优化过的模型,如YOLOv5-Crowd(人群跟踪)、YOLOv5-Vehicle(车辆跟踪) |

### 2.2 YOLOv5不同模型的性能对比

下表对比了不同YOLOv5模型在COCO数据集上的性能:

| 模型 | mAP | FPS | 参数量(M) |

|---|---|---|---|

| YOLOv5s | 34.4% | 140 | 7.1 |

| YOLOv5m | 40.4% | 90 | 15.9 |

| YOLOv5l | 46.0% | 56 | 47.6 |

| YOLOv5x | 48.2% | 30 | 88.6 |

### 2.3 影响模型选择的关键因素

影响模型选择的关键因素包括:

- **精度要求:**不同场景对跟踪精度有不同的要求,需要根据具体需求选择精度合适的模型。

- **推理速度:**实时跟踪场景要求推理速度快,需要选择推理速度较快的模型。

- **模型大小:**模型大小影响模型部署的便利性,需要考虑部署平台的资源限制。

- **自定义需求:**特殊场景可能需要针对性优化过的模型,需要考虑模型的自定义扩展性。

**代码块:**

```python

import torch

# 选择YOLOv5s模型

model = torch.hub.load('ultralytics/yolov5', 'yolov5s')

# 设置推理设备

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

model.to(device)

# 加载模型权重

model.load_state_dict(torch.load('yolov5s.pt', map_location=device))

# 设置推理模式

model.eval()

```

**逻辑分析:**

这段代码加载了YOLOv5s模型,并将其设置为推理模式。

**参数说明:**

- `torch.hub.load`:从PyTorch Hub加载预训练模型。

- `device`:指定推理设备,优先使用GPU。

- `model.to(device)`:将模型移动到指定设备。

- `torch.load`:加载模型权重。

- `map_location`:指定加载权重的设备。

- `model.eval()`:将模型设置为推理模式。

# 3.1 数据集准备和预处理

#### 数据集收集和标注

训练 YOLOv5 图像跟踪模型需要高质量的训练数据集。数据集应包含大量具有不同背景、光照条件和目标大小的图像。目标应清晰可见,并且应准确标注其边界框。

#### 数据集预处理

在训练模型之前,需要对数据集进行预处理。预处理步骤包括:

- **图像缩放和裁剪:**将图像缩

0

0