OpenCV缺陷检测中的实例分割技术:语义分割、实例分割

发布时间: 2024-08-09 18:19:46 阅读量: 110 订阅数: 25

# 1. 缺陷检测概述**

缺陷检测是计算机视觉领域中一项重要的任务,旨在识别和定位图像中的缺陷。随着深度学习技术的飞速发展,基于深度学习的缺陷检测方法取得了显著的进展。

深度学习模型能够从大量缺陷图像中学习复杂的特征,从而有效地识别和定位缺陷。在缺陷检测中,语义分割和实例分割是两种常用的深度学习方法。

语义分割将图像中的每个像素分类为不同的语义类别,从而识别缺陷区域。实例分割则进一步将缺陷区域细分为不同的实例,从而实现对缺陷的精确定位和识别。

# 2. 语义分割理论与实践

### 2.1 语义分割的基本原理

#### 2.1.1 图像分割算法

图像分割是将图像分解为多个不相交的区域的过程,每个区域代表图像中的不同对象或区域。语义分割是一种图像分割任务,其目标是为每个像素分配一个语义标签,该标签表示像素所属的对象或区域。

常见的图像分割算法包括:

- **阈值分割:**根据像素的强度或颜色将图像分割为不同的区域。

- **区域生长:**从种子像素开始,将相邻的相似像素分组到一个区域中。

- **聚类:**将像素聚类到具有相似特征的组中,然后将每个组视为一个分割区域。

#### 2.1.2 深度学习在语义分割中的应用

深度学习模型,如卷积神经网络(CNN),已广泛应用于语义分割任务。CNN 能够从图像中提取高级特征,并将其用于预测每个像素的语义标签。

常用的深度学习语义分割模型包括:

- **FCN(全卷积网络):**将卷积神经网络的最后一层替换为全卷积层,以生成像素级的预测。

- **U-Net:**一种编码器-解码器网络,用于语义分割,具有跳跃连接以融合不同分辨率的特征。

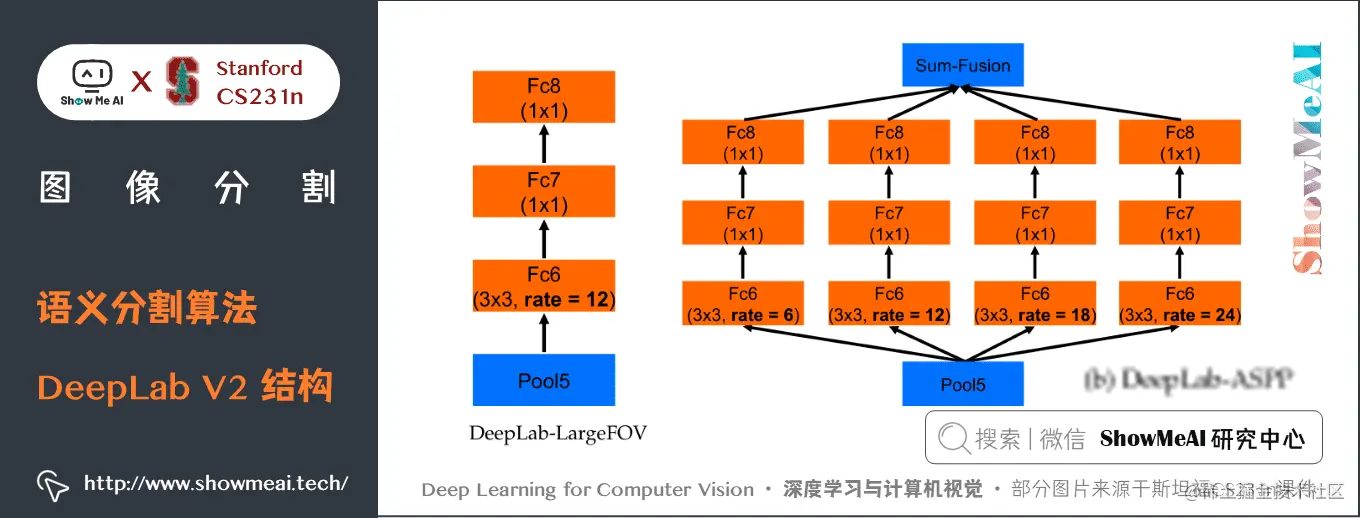

- **DeepLab:**一种基于空洞卷积的语义分割模型,能够捕捉图像中的长距离依赖关系。

### 2.2 语义分割实践应用

#### 2.2.1 缺陷图像的预处理

在应用语义分割模型进行缺陷检测之前,需要对缺陷图像进行预处理,包括:

- **图像增强:**调整图像的对比度、亮度和饱和度,以提高缺陷的可见性。

- **图像归一化:**将图像像素值归一化到特定范围内,以提高模型的鲁棒性。

- **图像裁剪和调整大小:**将图像裁剪到特定大小,并调整大小以符合模型的输入要求。

#### 2.2.2 语义分割模型的训练和评估

语义分割模型的训练需要大量带标签的缺陷图像。训练过程涉及以下步骤:

- **数据准备:**收集和预处理缺陷图像,并为每个像素分配语义标签。

- **模型选择:**选择合适的语义分割模型,如 FCN、U-Net 或 DeepLab。

- **模型训练:**使用带标签的缺陷图像训练模型,优化损失函数以最小化预测和真实标签之间的差异。

- **模型评估:**使用验证集评估模型的性能,计算指标如像素精度、平均交并比(mIoU)和帕斯卡尔 VOC 分数。

**代码块:**

```python

import torch

from torch.utils.data import DataLoader

from torchvision import transforms

# 数据预处理

transform = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

# 数据加载

train_dataset = MyDataset(root='train', transform=transform)

train_loader = DataLoader(train_dataset, batch_size=16, shuffle=True)

# 模型选择

model = Unet(num_classes=21)

# 损失函数

criterion = torch.nn.CrossEntropyLoss()

# 优化器

optimizer = torch.optim.Adam(model.parameters(), lr=0.001)

# 训练

for epoch in range(100):

for i, data in enumerate(train_loader):

inputs, labels = data

outputs = model(inputs)

loss = criterion(outputs, labels)

optimizer.zero_grad()

loss.backward()

optimizer.step()

```

**逻辑分析:**

该代码块演示了语义分割模型的训练过

0

0