ggally与机器学习:数据探索与模型评估的联合策略

发布时间: 2024-11-08 00:25:03 阅读量: 27 订阅数: 42

# 1. ggally在数据探索中的作用

在数据分析和机器学习项目中,数据探索是一个关键的阶段,它涉及对数据集的初步检查,以理解数据的结构、分布和潜在的关系。ggally包,作为ggplot2的扩展包,为R语言提供了更丰富、更直观的数据探索工具,使得复杂的数据关系可视化变得更加简易和高效。

ggally的核心价值在于其能通过简洁的函数调用生成多个变量间的多种关系图。其中,ggally的散点图矩阵是快速理解数据特征相关性的常用方法之一,它通过将多个散点图组织在一个矩阵中,便于观察数据集中的双变量关系。通过这种方式,研究人员可以迅速识别出潜在的模式、异常值或者变量间的相互作用,从而为后续的数据处理和模型构建奠定基础。

在本章中,我们将探索ggally的这些基本功能如何帮助我们进行初步的数据探索,以及它在更高层次的数据分析和机器学习工作流程中的作用和优势。

# 2. ggally的基础功能和使用

## 2.1 ggally的绘图功能

ggally包是ggplot2的补充,它提供了额外的绘图功能,使得数据探索和可视化更加直观和方便。ggally绘图功能的核心在于为用户提供快速且高效的多变量数据可视化方法。

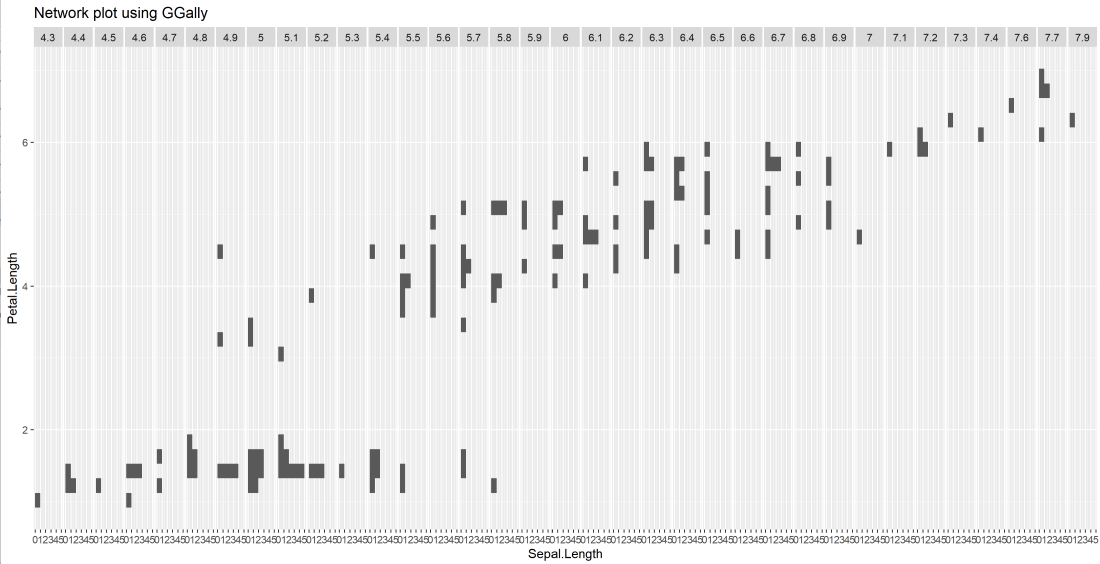

### 2.1.1 ggally的散点图矩阵

散点图矩阵是一种强大的数据探索工具,它允许用户在多个变量对之间绘制散点图,以寻找变量之间的相关性。在ggally中,这可以通过`ggpairs()`函数实现。

```r

# 载入ggally包

library(ggally)

# 创建一个简单的数据框

data <- data.frame(

x = rnorm(100),

y = rnorm(100),

z = rnorm(100)

)

# 绘制散点图矩阵

ggpairs(data)

```

执行上述代码后,我们将得到一个包含了x、y、z三个变量之间所有可能散点图的矩阵。这有助于分析变量之间的线性关系、分布情况以及潜在的异常值。参数`columns`可以用来指定只显示特定的几列。

### 2.1.2 ggally的热图

热图是另一种用于展示多变量关系的图形,它根据数据点的数值大小来着色。在ggally中,可以通过`ggally_heatmap()`函数绘制热图。

```r

# 模拟数据

data_matrix <- matrix(rnorm(100*10), nrow = 100)

rownames(data_matrix) <- paste("Observation", 1:100)

colnames(data_matrix) <- paste("Variable", 1:10)

# 绘制热图

ggally_heatmap(data_matrix)

```

执行上述代码会生成一个热图,其中数据矩阵的每一行和每一列分别代表一个观测值和一个变量。热图的颜色深浅表示数值的大小,这有助于快速发现数据中的模式和趋势。

## 2.2 ggally的高级功能

ggally不仅限于基础的绘图功能,它还提供了一系列高级功能,如交互式图形和自定义图形,以满足更复杂的数据分析需求。

### 2.2.1 ggally的交互式图形

交互式图形可以提高用户体验,ggally通过集成`plotly`包来提供交互式图形功能。这使得用户可以通过鼠标悬停和缩放等功能来更好地探索数据。

```r

# 加载plotly包

library(plotly)

# 将ggpairs()的输出转换为plotly对象

gg <- ggpairs(data)

ggplotly(gg)

```

转换后的图形支持点击和滚动操作,用户可以根据自己的需要进行更深入的探索。

### 2.2.2 ggally的自定义图形

有时候,内置的图形功能无法完全满足特定的可视化需求,这时ggally允许用户通过提供自定义函数来扩展图形的绘制方式。

```r

# 自定义函数,例如添加线性回归线到散点图

custom_function <- function(data, mapping, ...){

ggplot(data = data, mapping = mapping) +

geom_point(...) +

geom_smooth(method = "lm", ...)

}

# 使用自定义函数

ggpairs(data, upper = list(continuous = custom_function))

```

在这个例子中,我们定义了一个添加线性回归线的自定义函数,并将其应用到了散点图矩阵的连续变量对上。这样,用户就可以根据自己的分析目的定制图形。

以上就是ggally的基础功能和使用方法的详细介绍。通过这些功能,数据分析师可以更加高效地进行数据探索,并从多维度对数据进行直观的可视化分析。在下一章,我们将深入探讨机器学习模型的评估方法,以及如何利用ggally的可视化能力辅助模型评估和优化。

# 3. 机器学习的模型评估

机器学习模型训练完毕后,如何确保模型的效果和性能是合格的,是后续应用的关键一步。评估模型是机器学习过程中不可或缺的一个环节,它关系到模型的泛化能力和最终的业务价值。本章我们将探讨模型评估的基本方法和高级方法,并解释它们在实际操作中的应用与重要性。

## 3.1 模型评估的基本方法

### 3.1.1 交叉验证

交叉验证是一种统计学上用来评估并改善预测模型效能的方法,可以有效地减少模型评估中的方差。交叉验证的主要思想是将训练数据集分为K个大小相同的子集,每一个子集轮流作为测试集,其余的K-1个子集合在一起作为训练集。常见的交叉验证方法包括K折交叉验证(K-Fold Cross Validation)。

交叉验证的具体操作步骤如下:

1. 将原始数据集随机分为K个大小相等的子集。

2. 对每一个子集轮流作为测试集,其余K-1个子集作为训练集。

3. 对每一个训练集/测试集组合训练模型,并评估其表现。

4. 计算K次评估结果的平均值,作为模型的最终评估指标。

下面是一个K折交叉验证的Python代码示例:

```python

import numpy as np

from sklearn.model_selection import KFold

from sklearn.metrics import mean_squared_error

# 假设X和y是训练数据集的特征和目标变量

X = np.array([...])

y = np.array([...])

k_fold = KFold(n_splits=5, shuffle=True, random_state=1)

for train_index, test_index in k_fold.split(X):

X_train, X_test = X[train_index], X[test_index]

y_train, y_test = y[train_index], y[test_index]

# 这里假设使用线性回归模型

from sklearn.linear_model import LinearRegression

model = LinearRegression()

model.fit(X_train, y_train)

y_pred = model.predict(X_test)

mse = me

```

0

0