生物统计学中的ggally应用:生命科学数据探索的秘密武器

发布时间: 2024-11-08 00:22:04 阅读量: 21 订阅数: 40

# 1. 生物统计学与ggally包简介

## 1.1 生物统计学的重要性和应用范围

生物统计学是应用统计学原理和方法研究生物科学领域问题的一门学科,它在生命科学的发展中扮演着至关重要的角色。无论是从基因组学、蛋白质组学到药理学,生物统计学都为研究者提供了分析和解释数据的工具。随着大数据和机器学习在生物科学中的不断应用,生物统计学的重要性日益凸显。

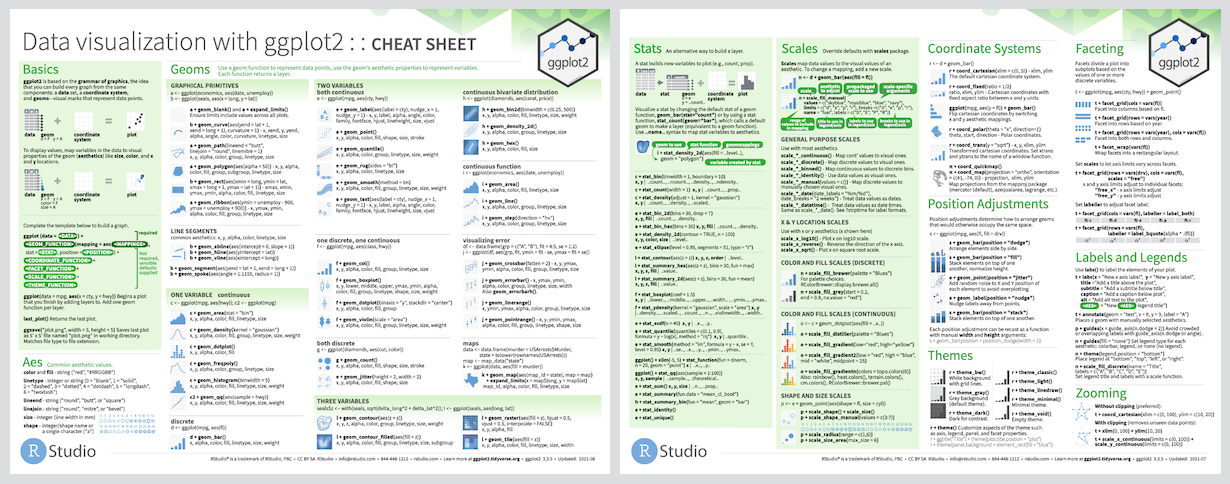

## 1.2 ggally包的背景和功能概览

ggally是R语言中一个扩展包,它基于ggplot2构建,旨在通过一系列方便的函数简化数据探索和可视化的过程。ggally包特别注重于提供交互式的可视化工具,并且在数据预处理、网络分析、时间序列分析以及生存分析等多个方面都有着出色的表现。它已经成为生物统计学家和数据分析专家不可或缺的工具之一。

```r

# 安装ggally包

install.packages("ggally")

# 加载ggally包

library(ggally)

```

在这章中,我们会探索ggally包的基础功能,并在接下来的章节深入学习其在生物统计学中的高级应用。

# 2. ggally包的基础功能

## 2.1 ggally包的数据探索功能

### 2.1.1 数据探索的基本流程

数据探索是数据分析的首要步骤,它涉及对数据集的理解和熟悉,为后续的数据处理、分析和解释做准备。一般来说,数据探索的基本流程可以被概括为以下几个阶段:

1. 数据收集:这是数据探索的第一步,涉及到从各种数据源中收集数据。在生物统计学中,这可能是从实验中收集数据,或者从在线数据库中提取数据。

2. 数据清洗:数据通常包含错误、缺失值或不一致的数据点。数据清洗的目的是确保数据集的质量,这一步通常包括处理缺失值、去除或修正异常值等。

3. 数据探索:在这一步,分析者会检查数据的分布、寻找潜在的模式或关系,以及对数据特征进行初步的理解。这包括使用各种统计和可视化方法来检查数据的中心趋势、变异性和分布情况。

4. 数据转换:基于数据探索的结果,可能需要对数据进行转换,以便更好地适配后续的统计模型或分析。

### 2.1.2 ggally包中的数据探索工具

ggally包是基于ggplot2包的扩展,它提供了一系列方便的函数来简化数据探索的过程。ggally包中的一些关键函数包括:

- `ggally_cor()`:用于展示数据集的变量之间的相关性矩阵。

- `ggally_density()`:可以显示一个或多个变量的概率密度估计。

- `ggally_boxplot()`:为数据集生成箱线图,展示变量的分布情况。

- `ggally_pairs()`:生成配对图矩阵,这是对数据探索非常有用的工具,因为它可以同时展示多个变量之间的关系。

这些函数使得数据探索过程中的常见任务变得更加高效和简单,同时也保持了ggplot2一贯的美观和可定制性。使用ggally包进行数据探索的一个优点是,它允许分析者轻松地叠加不同的图形元素,并创建复杂的多变量图形。

### 2.1.3 数据探索实践案例

假设我们有一个包含多种生物指标的数据集,我们想要使用ggally包来快速了解数据集的基本情况。以下是使用ggally包进行数据探索的示例代码。

```r

# 加载所需的库

library(GGally)

library(ggplot2)

# 读取数据集

data(biomarker_data)

# 使用ggally的ggpairs函数进行配对图探索

ggpairs(biomarker_data, columns = c('Age', 'Weight', 'Height', 'BloodPressure'))

```

这段代码会生成一个配对图矩阵,该矩阵将帮助我们查看不同生物指标之间的相关性,并初步检查数据集中的模式和关系。

## 2.2 ggally包的图形绘制功能

### 2.2.1 图形绘制的基本原则

图形绘制是数据探索和分析中不可或缺的一部分,它帮助我们可视化数据并直观地展示分析结果。在进行图形绘制时,需要考虑以下几个基本原则:

1. 清晰性:图形应当足够清晰,让观察者容易理解和解读数据。

2. 简洁性:避免图形过于复杂,以免观察者感到困惑。

3. 准确性:图形应准确反映数据,不包含误导性的信息。

4. 一致性:如果需要展示多个图形,应确保它们在视觉上保持一致。

5. 可读性:图表中的文字、符号和颜色应容易阅读和区分。

### 2.2.2 ggally包中的图形绘制工具

ggally包提供了几个方便的函数,用于快速绘制各种统计图形,其核心是基于ggplot2强大的图形构建能力。ggally包中的关键函数包括:

- `ggally_density()`:用来绘制单变量分布的密度图。

- `ggally_boxplot()`:绘制单变量分布的箱线图。

- `ggally_dotplot()`:创建点图,展示数据的分布情况。

- `ggally_scatterplot()`:生成散点图,可以用来展示两个变量之间的关系。

- `ggally_point_interval()`:结合了点图和区间估计,适用于展示数据的均值和置信区间。

使用这些函数可以快速地创建出高质量的统计图形,并且可以很容易地与ggplot2系统的其他功能相结合,实现更加复杂和个性化的图形定制。

### 2.2.3 图形绘制实践案例

为了说明如何使用ggally包绘制图形,假设我们有一个实验数据集,其中包含几个不同时间点的生物指标。我们可以使用ggally包的函数来可视化这些数据,观察指标随时间的变化趋势。

```r

# 加载ggally包

library(ggally)

# 绘制时间序列数据的散点图

ggally_scatterplot(data = time_series_data, mapping = aes(x = Time, y = Biomarker))

```

这段代码将为每个生物指标绘制一个散点图,展示了其在不同时间点的值,从而直观地显示了指标随时间的变化趋势。

## 2.3 ggally包的数据处理功能

### 2.3.1 数据预处理的基本方法

在数据分析和统计建模之前,通常需要对数据进行预处理。预处理的目标是提高数据质量,确保分析结果的准确性。预处理通常包含以下几个基本方法:

1. 缺失值处理:缺失值可能会对分析造成影响。预处理中可能需要删除含有缺失值的记录,或者填充缺失值。

2. 数据变换:为了使数据更好地符合分析模型的假设,可能需要进行对数变换、幂变换或其他形式的数据变换。

3. 特征选择:从数据集中选择有助于分析的变量,可能需要去除冗余或不相关的特征。

4. 缩放和标准化:不同变量的量纲和范围可能不同,通过缩放和标准化可以使其在同一量级上进行比较。

5. 异常值处理:异常值可能对模型的准确性造成负面影响,需要进行适当的处理,例如剔除或替代。

### 2.3.2 ggally包中的数据处理工具

ggally包并不直接提供数据预处理的函数,但是,它提供了与ggplot2结合使用的一些图形工具,这些图形工具可以帮助我们更好地理解数据,从而进行更有效的数据预处理。

例如,ggally包中的`ggally_histogram()`函数可以用来绘制直方图,通过观察直方图可以识别数据分布中的异常值。`ggally_boxplot()`函数可以揭示数据中的离群点,这些点可能需要在预处理阶段被处理。

### 2.3.3 数据预处理实践案例

假设我们正在处理一个包含多种生物指标的实验数据集,我们首先使用ggally包的函数来查看数据的分布情况,以便于我们做出进一步的数据处理决策。

```r

# 加载所需的库

library(ggally)

# 读取数据集

data(biomedical_data)

# 使用ggally绘制直方图查看变量分布

ggally_histogram(data = biomedical_data, mapping = aes(x = Biomarker1))

```

通过直方图,我们可以看到变量`Biomarker1`的分布情况,并据此判断是否存在异常值或分布不正常的情况,以决定是否需要进行数据处理。

在下一章节,我们将深入探讨ggally包的高级应用,包括网络分析、时间序列分析以及生存分析等功能,了解如何将ggally包应用于更复杂的生物统计学问题中。

# 3. ggally包的高级应用

## 3.1 ggally包的网络分析功能

### 3.1.1 网络分析的基本概念

网络分析是利用图论的概念来研究数据集中个体之间相互关系的方法。在网络中,节点代表个体,边代表个体间的关系。网络分析可以揭示复杂的相互作用模式,对于理解生态系统、社交网络或任何类型的网络结构至关重要。

网络分析不仅限于社会学或生态学,它也被广泛应用于生命科学领域,例如基因调控网络、蛋白质相互作用网络等。通过分析这些网络的结构,可以更好地了解生物学过程和潜在的治疗靶点。

### 3.1.2 ggally包中的网络分析工具

ggally包提供了一系列的网络分析工具,能够帮助用户生成网络图并分析网络中的模式和关系。其中,最常用的是`ggally_network`函数,它可以帮助用户以图形化

0

0