【CNN与Transformer结构】在NLP中的完美结合

发布时间: 2024-04-20 02:34:45 阅读量: 18 订阅数: 47

# 1. 介绍CNN与Transformer结构在NLP中的应用

在自然语言处理(NLP)领域,卷积神经网络(CNN)和Transformer结构作为两种重要的深度学习模型,不仅在图像处理、语音识别等领域有广泛应用,而且在NLP任务中也展现出了强大的能力。CNN以其局部感知和参数共享的特性,在文本分类、情感分析等任务中表现出色;而Transformer模型则通过自注意力机制实现了对文本序列的建模,使得在机器翻译、文本生成等任务中取得了巨大成功。本章将深入介绍CNN与Transformer结构在NLP中的应用,旨在帮助读者全面了解它们的价值和实用性。

# 2. 深入理解CNN

### 2.1 CNN基本概念和原理

卷积神经网络(Convolutional Neural Network,CNN)是一种专门用于处理具有类似网格结构数据的神经网络。在计算机视觉领域,CNN被广泛应用于图像识别、目标检测和语义分割等任务中。下面将深入探讨CNN的基本概念和原理。

#### 2.1.1 卷积神经网络的起源和发展历程

卷积神经网络最初由Yann LeCun等人于上世纪80年代提出,经过多年的发展和演进,如今已成为深度学习中的核心模型之一。LeNet、AlexNet、VGG、ResNet等经典CNN模型的提出和优化,推动了计算机视觉领域的发展。

#### 2.1.2 卷积操作及其在图像处理中的应用

卷积操作是CNN中的核心操作,通过卷积核与输入特征图的计算,实现特征的提取和表征。在图像处理中,卷积操作能够有效捕获图像的局部特征,实现平移不变性和特征共享,从而提高模型的泛化能力。

#### 2.1.3 卷积层、池化层和全连接层的作用及区别

- **卷积层(Convolutional Layer)**:负责提取输入特征图中的局部特征,通过卷积操作生成输出特征图。

- **池化层(Pooling Layer)**:用于降维和减少计算复杂度,通过最大值或平均值等操作对特征图进行下采样。

- **全连接层(Fully Connected Layer)**:将卷积层或池化层提取的特征进行展平并连接到输出层,用于分类或回归任务。

深入理解CNN的基本概念和原理,有助于我们更好地理解CNN在自然语言处理中的应用和局限性。

### 2.2 CNN在自然语言处理中的局限性

虽然CNN在计算机视觉领域取得了巨大成功,但在处理自然语言处理任务时,也存在一些局限性。接下来,我们将探讨CNN在文本处理中的挑战以及其在NLP任务中的应用案例分析。

#### 2.2.1 传统CNN在文本处理中的挑战

传统的CNN模型通常应用于固定大小的输入数据,对于变长的文本序列处理存在一定困难,难以捕捉长距离的序列依赖关系。

#### 2.2.2 CNN对文本序列长度的限制问题

由于卷积神经网络中的卷积核大小和池化操作会限制文本序列的长度,长文本序列的处理会受到限制,难以建模长距离的语义信息。

#### 2.2.3 CNN在NLP任务中的应用案例分析

虽然CNN在处理文本上存在一些局限性,但在文本分类、情感分析等短文本任务中仍有应用。借助卷积操作提取局部特征,CNN在短文本任务中表现出色,如文本分类、命名实体识别等。

通过深入解析CNN在自然语言处理中的局限性,我们可以更全面地认识CNN模型在NLP领域中的应用情况。

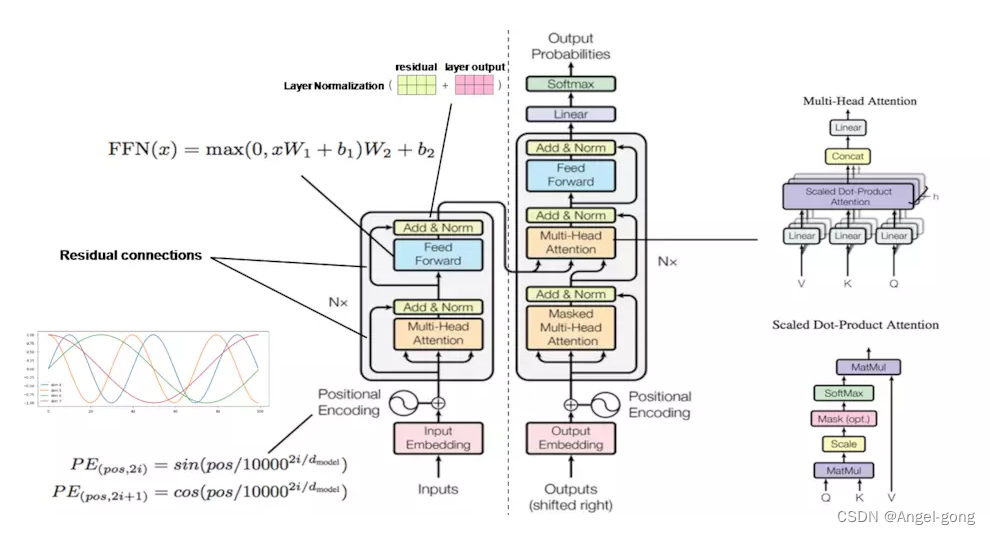

# 3.1 Transformer的基本原理和结构

Transformer 模型是自然语言处理领域的一种革命性模型,其基本原理和结构为该模型的核心。本节将深入解析 Transformer 的基本原理和结构,帮助读者更好地理解这一模型的本质。

#### 3.1.1 自注意力机制的核心概念

自注意力机制是 Transformer 模型的核心概念之一。在传统的循环神经网络(RNN)和卷积神经网络(CNN)中,信息的传递是通过固定的方式,而自注意力机制允许模型在计算过程中动态地为每个输入位置分配权重,从而更灵活地学习长距离依赖关系。具体来说,自注意力机制包括三个重要步骤:计算 Query、Key 和 Value;计算注意力权重;计算加权和。这种机制使得模型能够在保持高效性的同时捕捉输入序列中各个位置之间的关系,是 Transformer 模型能够胜任复杂NLP任务的关键所在。

```python

# 自注意力机制示例代码

query = ...

key = ...

value = ...

# 计算注意力权重

attention_weights = softmax(dot_product(query, key) / sqrt(d_k))

# 计算加权和

output = dot_product(attention_weights, value)

```

#### 3.1.2 Transformer编码器和解码器结构解析

Transformer 模型由编码器和解码器两部分组成,编码器用于将输入序列映射成隐层表示,解码器则根据编码器的输出以及已生成的部分序列来预测下一个词。编码器和解码器结构中的多头自注意力层(Multi-Head Self-Attention Layer)和前馈神经网络层(Feed-Forward Neural Network Layer)是 Transformer 的重要组成部分,通过堆叠这些层来实现对输入序列的编码和解码。其中,多头自注意力层能同时学习不同表示空间的信息,从而提高模型的表征能力。

```python

# Transformer 编码器示例

class EncoderLayer(nn.Module):

def __init__(

```

0

0