Hadoop压缩技术在大数据分析中的角色:作用解析与影响评估

发布时间: 2024-10-27 02:55:35 阅读量: 4 订阅数: 5

# 1. Hadoop压缩技术概述

在大数据的处理与存储中,压缩技术扮演着至关重要的角色。Hadoop作为一个分布式存储和处理的框架,它能够高效地处理大量数据,而这背后离不开压缩技术的支持。在本章中,我们将简要介绍Hadoop中的压缩技术,并探讨它如何通过减少数据的存储体积和网络传输量来提高整体的数据处理效率。我们会从Hadoop的压缩机制讲起,深入探讨其在减少数据存储和提升网络传输效率方面的重要性,并为读者介绍后续章节中将要讨论的Hadoop压缩技术的理论基础和生态系统集成。

# 2. 压缩技术的理论基础与Hadoop生态系统集成

### 数据压缩的基本原理

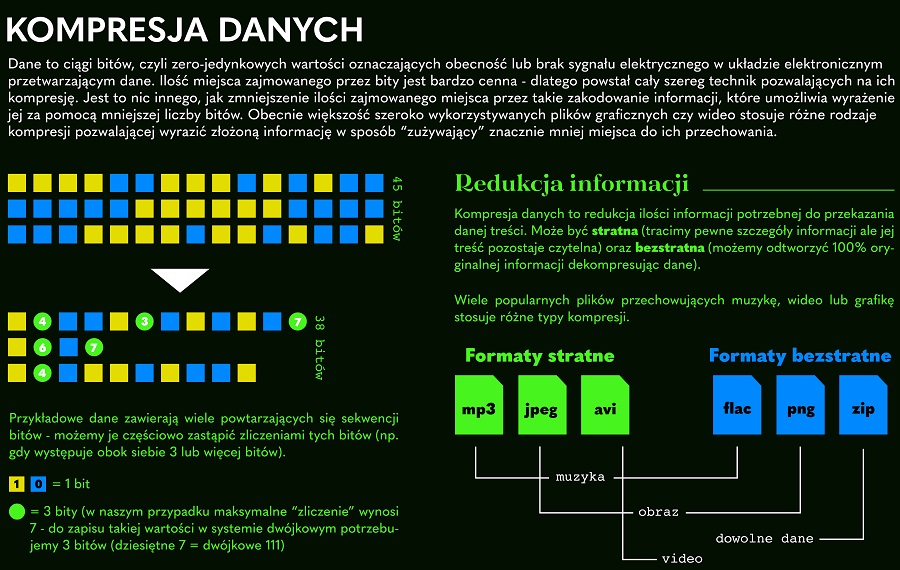

数据压缩是信息技术领域的一个基本概念,它指的是在不丢失信息的前提下,将数据以更小的存储空间表示的技术。它广泛应用于数据存储、网络传输等多个领域,以提高效率和降低成本。

#### 压缩算法的核心概念

压缩算法的核心在于识别并去除数据中的冗余信息。冗余信息是指数据中可以预测或者推断的部分,这些部分不增加任何新的信息量。压缩算法可以是无损的,也可以是有损的。无损压缩保证数据的完整性,而有损压缩则允许信息的损失以换取更高的压缩比。

常见的无损压缩算法包括霍夫曼编码、Lempel-Ziv-Welch (LZW) 和Deflate等。而有损压缩算法在多媒体领域较为常见,如JPEG和MP3等。有损压缩牺牲了精确度来获取更高的压缩率,适用于对精度要求不高的场景。

#### 常见压缩技术的比较分析

为了深入理解压缩技术,我们可以通过比较几种常见的压缩算法来进行分析。霍夫曼编码是一种广泛使用的无损压缩技术,它基于字符出现的频率来构建最优前缀码。LZW算法则通过构建一个词典来压缩数据,它在处理大型文本文件时尤其高效。Deflate算法结合了LZ77压缩和霍夫曼编码的特点,是Gzip和PNG图像格式中使用的压缩算法。

通过对比这些算法在压缩率、速度和资源消耗上的差异,我们可以根据应用场景选择最适合的压缩技术。例如,对于需要高度准确性的文本数据,霍夫曼编码可能是一个不错的选择;而对于需要快速压缩的图像数据,JPEG(基于DCT变换和霍夫曼编码)可能是更好的选择。

### Hadoop生态系统中的压缩组件

Hadoop作为一个分布式存储和计算平台,它内部集成了多种压缩组件来满足大数据处理中的压缩需求。

#### Hadoop I/O类库的压缩框架

Hadoop通过它的I/O类库提供了一套完整的压缩框架。它支持多种压缩格式,并允许用户在不同的数据处理阶段选择合适的压缩方式。开发者可以通过配置文件来指定哪些数据应该被压缩,以及使用何种压缩算法。

压缩框架与Hadoop的MapReduce作业紧密集成,确保数据在网络传输和磁盘存储过程中得到高效的压缩处理。它不仅提高了数据处理的效率,还减少了所需的存储空间。

#### Hadoop原生支持的压缩编解码器

Hadoop原生支持多种压缩编解码器,包括但不限于Gzip、Bzip2、Deflate、Snappy和LZ4等。这些编解码器各有特点,有的侧重于压缩比,如Gzip;有的则侧重于处理速度,如Snappy和LZ4。

Hadoop的MapReduce框架可以配置使用特定的压缩编解码器来压缩中间输出数据,这样可以显著减少网络传输的数据量,并加速整个数据处理过程。

### 压缩在数据存储和传输中的作用

压缩技术的引入为数据存储和传输提供了新的优化途径。

#### 存储效率的提升

在数据存储方面,压缩技术可以有效减少存储空间的使用,从而降低硬件成本。对于大规模数据集,压缩可以减少所需的磁盘数量,降低能耗,提高数据中心的空间利用率。

此外,高效的压缩算法使得数据的备份和恢复过程更加迅速,这对业务连续性至关重要。数据压缩之后,备份所需的时间大大减少,数据恢复过程也更加迅速。

#### 网络带宽的节省

在数据传输方面,压缩技术同样发挥着重要作用。在分布式计算环境中,大量的数据需要在网络中传输,此时压缩可以显著减少网络带宽的占用,降低延迟,提高数据传输的效率。

例如,在Hadoop生态系统中,使用压缩技术可以减少MapReduce作业中的Shuffle阶段的数据传输量,从而加快整个作业的处理速度。

在接下来的章节中,我们将进一步探讨压缩技术如何影响大数据处理性能,以及在Hadoop生态系统中的具体应用。

# 3. 压缩技术对大数据处理性能的影响

随着大数据量的爆炸性增长,处理和分析这些数据的速度变得至关重要。压缩技术不仅减少了存储和传输数据所需的资源,还对提升大数据处理性能有着显著的影响。本章节将深入探讨压缩技术与大数据处理性能之间的复杂关系。

## 3.1 压缩与数据处理速度的关系

压缩技术通过减少数据的物理大小,直接影响了数据处理的速度。为了深入理解这一关系,我们将从压缩比和压缩算法选择两个方面进行探讨。

### 3.1.1 压缩比对处理速度的影响

压缩比是指压缩后数据与原始数据大小的比例。较高的压缩比意味着更多的数据被压缩,减少了存储空间的需求,同时能够提升数据传输的速度,因为相同量级的数据传输需要的时间更少。然而,压缩和解压缩过程本身需要额外的计算资源和时间,这可能会抵消一些性能提升。尤其是在处理速度非常关键的环境中,压缩比过高的负面影响可能尤为明显。

### 3.1.2 压缩算法的选择对性能的影响

不同的压缩算法具有不同的处理速度和压缩效率。有些算法如LZ4以其高速著称,适用于需要快速压缩和解压缩的场景,而算法如Brotli和Zstandard则提供了更好的压缩率,但可能会牺牲一些速度。在选择压缩算法时,需要根据具体的应用场景进行权衡。例如,实时数据处理可能更偏向于速度,而非实时的批处理则可能更注重压缩率。

## 3.2 压缩技术在MapReduce中的应用

MapReduce是一种用于大规模数据处理的编程模型,其中压缩技术的合理应用可以显著提升性能。

### 3.2.1 Map阶段的压缩处理

在Map阶段,输入数据在分配给各个Map任务之前可以先进行压缩。这样不仅可以减少硬盘I/O,还能加快数据在集群中的传输。通常在Map任务开始时,会读取并解压数据,然后进行处理。如果选择的压缩算法能够有效地平衡压缩和解压速度,那么整个过程的性能将会得到提升。

### 3.2.2 Reduce阶段的压缩处理

Reduce阶段通常是数据处理的瓶颈,因此在这一阶段中合理地使用压缩技术显得尤为重要。通过在Reduce任务开始之前对数据进行压缩,不仅可以减少网络传输的数据量,还可以提高数据排序和处理的速度。然而,必须仔细选择压缩算法,确保在压缩和解压过程中不会引入太多额

0

0