Python生成对抗网络(GAN)入门:创作逼真AI内容的初探

发布时间: 2024-09-19 17:17:00 阅读量: 29 订阅数: 66

# 1. 生成对抗网络(GAN)简介与理论基础

## 1.1 GAN的概念和起源

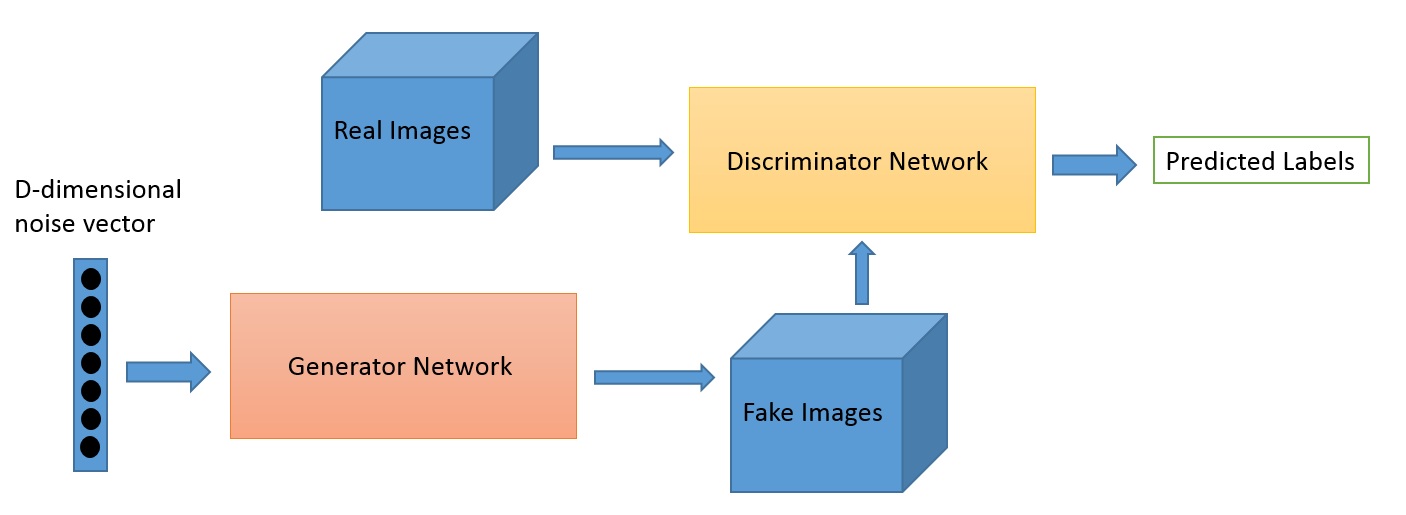

生成对抗网络(GAN)是由Ian Goodfellow于2014年提出的一种深度学习模型,它由两部分组成:生成器(Generator)和判别器(Discriminator)。生成器产生新的数据实例,而判别器评估它们的真实性。在训练过程中,生成器不断学习并提高其生成数据的质量,使得判别器难以区分真实和生成的数据。这种对抗机制是GAN的核心思想。

## 1.2 GAN的工作原理和架构

GAN的工作原理类似于假币制造者和警察的游戏:假币制造者尝试制造越来越真实的假币,而警察则尝试变得更擅长于识别假币。在GAN中,生成器就是假币制造者,它尝试生成逼真的数据,判别器则是警察,它尝试区分生成的数据和真实数据。在不断迭代中,两者的能力都得到提高,最终达到一个平衡状态,即纳什均衡。

## 1.3 GAN的应用前景和挑战

GAN的应用前景广泛,包括图像生成、图像转换、超分辨率、文本生成等。然而,GAN也面临一些挑战,如训练不稳定、模式崩溃和评估困难。随着研究的深入和技术的发展,这些挑战正在逐步被解决,GAN的潜力正在被不断挖掘。

# 2. 深度学习与GAN的数学原理

## 2.1 概率分布与数据生成

### 2.1.1 概率分布基础知识

在机器学习领域中,概率分布是理解数据生成过程的关键概念。概率分布描述了随机变量取不同值的概率。例如,掷硬币时正面朝上的概率分布是离散的,服从二项分布;而人的身高数据则通常服从连续的概率分布,如正态分布。

当我们提到生成对抗网络(GAN)时,我们会涉及一个特殊类型的概率分布——数据生成分布。数据生成分布是真实世界数据背后潜在的概率分布,它决定了我们能够从某个领域(如图像、音频、文本)中观测到的数据样本。

要使用GAN来模拟数据分布,我们需要先理解GAN中的两个主要角色:

- **生成器(Generator)**:将随机噪声转换为看起来像是来自真实数据分布的样本。

- **判别器(Discriminator)**:评估一个样本是真实数据还是生成器产生的假数据。

### 2.1.2 如何使用GAN模拟数据分布

模拟数据生成分布的关键在于对抗训练。在训练过程中,生成器和判别器不断对抗,使生成器能够学习到更准确的数据生成分布。

- **初始化**:随机初始化生成器和判别器的参数。

- **前向传播**:给生成器提供随机噪声,生成器输出假数据;同时,给出一批真实数据输入判别器。

- **计算损失**:判别器输出两类数据(真实和假的)的概率分布,通过损失函数评估其性能。损失函数通常包含两部分:一个是判别器成功区分真实数据的概率,另一个是生成器生成数据让判别器错误的概率。

- **反向传播和更新**:使用损失函数的结果来更新生成器和判别器的参数,以改进它们的性能。

这个过程循环往复,直到生成器能够以高概率生成与真实数据难以区分的假数据,此时我们说GAN已经成功地模拟了数据生成分布。

## 2.2 神经网络的基本结构和功能

### 2.2.1 神经网络前向传播与反向传播

神经网络的基本单元是神经元,它们通过连接形成复杂网络结构。前向传播是信号从输入层经过隐藏层,最后达到输出层的过程。每个神经元的输出成为下一个层神经元的输入。

反向传播是一种通过输出误差调整网络权重的学习方法。具体操作如下:

- 计算损失函数对每个权重的梯度。

- 通过链式法则,将梯度传递回网络的每一层。

- 根据计算出的梯度,更新网络中的权重。

这种基于梯度的方法确保了网络能够学习到如何最小化输出误差。

### 2.2.2 损失函数的选择与优化目标

损失函数是衡量模型预测值与真实值之间差异的函数。在GAN中,判别器和生成器使用不同的损失函数:

- **判别器的损失函数**:通常使用交叉熵损失函数来度量判别器将样本分类为真实或假的准确性。

- **生成器的损失函数**:生成器的目标是欺骗判别器,因此它的损失函数与判别器的输出有关,通常涉及到最大化判别器错误分类生成数据的概率。

优化目标是调整模型参数,使得损失函数达到最小值,即模型输出与真实值的差异最小化。在GAN中,优化目标是动态变化的,因为生成器和判别器相互竞争,都在试图最小化自己的损失函数。

## 2.3 卷积神经网络与GAN的结合

### 2.3.1 卷积神经网络在图像处理中的应用

卷积神经网络(CNN)是一类特别适合处理具有类似网格结构数据的深度学习模型,比如图像。它通过卷积层自动提取重要特征,不需要人为指定特征提取器。

CNN在图像处理中的应用包括:

- **图像分类**:通过层层卷积操作,最终得到能够代表图像类别信息的特征。

- **对象检测**:在图像中识别并定位一个或多个对象。

- **图像分割**:将图像中的每个像素点分类,以识别不同区域。

### 2.3.2 卷积层在GAN中的角色与特点

在GAN中使用CNN(即DCGAN),卷积层扮演了至关重要的角色:

- **参数共享**:卷积层的权重在空间上共享,大大减少了模型参数的数量。

- **局部连接**:卷积层只关注局部区域,这与图像的局部特征属性相吻合。

- **层次特征提取**:多层卷积结构可以帮助GAN提取图像的高级抽象特征。

卷积层的使用使得GAN在图像生成任务上取得了突破性的进展,特别是在图像质量的提高和细节的丰富性上。

在此,我们已经完成了第二章的介绍,涵盖了深度学习和GAN基础的数学原理和结构。下一章节将探索如何实践操作来构建基本的GAN模型。

# 3. 实践操作:构建基本的GAN模型

## 3.1 环境搭建与框架选择

### 3.1.1 Python环境与深度学习库安装

在开始构建生成对抗网络(GAN)之前,确保你有一个适合的开发环境。Python是目前深度学习领域中最流行的语言,因为它拥有强大的库支持。为了搭建一个GAN模型,至少需要安装Python环境和深度学习库,比如TensorFlow或PyTorch。下面是如何安装Python环境和这些库的步骤。

首先,你需要下载并安装Python。可以从Python官网下载对应操作系统的安装包,并按照安装向导进行安装。安装Python时,确保“Add Python to PATH”的选项被选中,这样可以在命令行中直接运行Python和pip命令。

接下来,安装深度学习相关的库。TensorFlow和PyTorch是目前最流行的两个深度学习框架。它们各自有不同的优势,但在这个章节中,我们将侧重于TensorFlow,因为它具有广泛的社区支持和良好的文档。可以通过pip命令来安装TensorFlow和其它相关的深度学习库。

```bash

pip install tensorflow

pip install numpy

pip install matplotlib

pip install scipy

```

### 3.1.2 深度学习框架(如TensorFlow或PyTorch)介绍

TensorFlow是由Google开发的一个开源机器学习库,用于设计、训练和部署深度学习模型。它支持多种语言,包括Python,并且能在多种平台上运行,如服务器、PC和移动设备。TensorFlow使用数据流图来进行数值计算,并且具有强大的可视化工具TensorBoard,可以帮助你理解、调试和优化模型。

PyTorch是由Facebook开发的一个开源机器学习库,它的接口设计更类似于Python的原生风格,所以对很多Python开发者来说更加易用。PyTorch的一个核心优势是动态计算图,这让它在某些研究和快速原型开发方面非常有优势。

在这个部分,我们将深入介绍TensorFlow的基本架构和使用方法,因为这是我们构建GAN模型的工具。

```python

import tensorflow as tf

# 创建一个简单的常量操作,它会生成一个张量

tensor = tf.constant([[1, 2], [3, 4]])

# 创建一个会话

***pat.v1.Session() as sess:

print(sess.run(tensor))

```

在上面的代码块中,我们导入了TensorFlow库,并使用它来创建一个常量张量。之后我们创建了一个TensorFlow会话,在该会话中运行这个张量的操作,并打印了它的值。这个例子展示了TensorFlow的基本操作。

## 3.2 编写简单的GAN模型

### 3.2.1 生成器网络的构建

生成器网络是GAN模型中负责生成数据的一方。在这个例子中,我们首先构建一个简单的生成器网络。这个网络将接收一个随机噪声向量作为输入,并将其映射到数据空间,目的是生成看似合理的数据样本。

为了构建生成器,我们使用TensorFlow的Keras API,它提供了高层神经网络API来方便构建和训练模型。下面是一个简单生成器网络的实现代码:

```python

from tensorflow.keras.layers import Dense, Reshape

from tensorflow.keras.mod

```

0

0