利用pandas进行多表格数据汇总分析

发布时间: 2024-04-17 06:57:15 阅读量: 86 订阅数: 48

(179979052)基于MATLAB车牌识别系统【带界面GUI】.zip

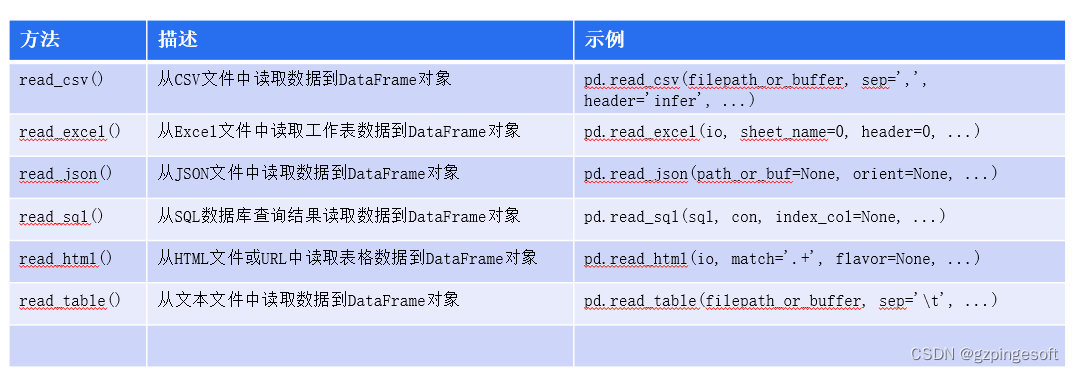

# 1. 数据准备

在数据分析和建模的过程中,数据准备是至关重要的一步。首先,我们需要进行数据收集。数据可以通过网络数据抓取来获取,也可以从文件中导入数据集。接着,对数据进行清洗是必不可少的。在清洗过程中,我们需要处理缺失值,通常采用填充或删除的方式;也需要处理重复值,避免对后续分析造成影响。数据清洗的目的是确保数据质量,提高后续分析建模的准确性。因此,数据准备是数据分析的基础,只有经过充分的准备,我们才能进行有效的数据分析和挖掘工作。

# 2. 数据合并与拼接

在数据处理和分析中,数据合并与拼接是非常重要的环节。当我们需要将多个数据源进行整合,或者对同一数据集进行不同时间段的比较时,就需要用到数据合并与拼接的技巧。本章将介绍横向合并、纵向合并和深度合并这三种常见的数据合并方式。

### 2.1 横向合并

横向合并是指按照列的方向进行合并,通常用于将具有相同索引的不同列合并成一张新表格。在实际工作中,横向合并可以帮助我们将多个数据集的字段拼接在一起,便于后续的分析和处理。

#### 2.1.1 使用concat函数

首先,我们来介绍使用concat函数进行横向合并的方法。该函数可以将两个或多个DataFrame对象沿着列方向进行拼接,合并后数据集的行索引会保持不变。

```python

import pandas as pd

data1 = {'A': [1, 2, 3],

'B': [4, 5, 6]}

df1 = pd.DataFrame(data1)

data2 = {'C': [7, 8, 9],

'D': [10, 11, 12]}

df2 = pd.DataFrame(data2)

result = pd.concat([df1, df2], axis=1)

print(result)

```

以上代码将DataFrame df1 和 df2 沿列方向拼接,生成一个新的DataFrame result,并输出结果。

结果如下:

| | A | B | C | D |

|---|---|---|---|---|

| 0 | 1 | 4 | 7 | 10 |

| 1 | 2 | 5 | 8 | 11 |

| 2 | 3 | 6 | 9 | 12 |

#### 2.1.2 使用merge函数

除了concat函数,我们还可以使用merge函数进行横向合并。merge函数可以根据指定的列合并两个DataFrame,类似于数据库中的合并操作。

```python

data3 = {'key': ['K0', 'K1', 'K2'],

'E': ['X0', 'X1', 'X2']}

df3 = pd.DataFrame(data3)

data4 = {'key': ['K0', 'K1', 'K2'],

'F': ['Y0', 'Y1', 'Y2']}

df4 = pd.DataFrame(data4)

result_merge = pd.merge(df3, df4, on='key')

print(result_merge)

```

以上代码通过merge函数,根据共同的列 'key' 将DataFrame df3 和 df4 进行横向合并。

结果如下:

| | key | E | F |

|---|-----|---|---|

| 0 | K0 | X0 | Y0 |

| 1 | K1 | X1 | Y1 |

| 2 | K2 | X2 | Y2 |

### 2.2 纵向合并

纵向合并是指按照行的方向进行合并,通常用于将具有相同字段的不同行数据合并成一张新表格。在数据分析中,纵向合并可以帮助我们整合多个数据集中不同时间段或维度的数据,从而进行深入的比较和分析。

#### 2.2.1 使用concat函数

我们可以再次利用concat函数来进行纵向合并操作。在纵向合并时,我们需要保证待合并的数据集具有相同的列名,否则会导致数据错位。

```python

data5 = {'A': [1, 2, 3],

'B': [4, 5, 6]}

df5 = pd.DataFrame(data5)

data6 = {'A': [7, 8, 9],

'B': [10, 11, 12]}

df6 = pd.DataFrame(data6)

result_vertical = pd.concat([df5, df6], ignore_index=True)

print(result_vertical)

```

以上代码将DataFrame df5 和 df6 沿行方向合并,并使用参数 ignore_index=True 来重新生成索引。

结果如下:

| | A | B |

|---|---|---|

| 0 | 1 | 4 |

| 1 | 2 | 5 |

| 2 | 3 | 6 |

| 3 | 7 | 10 |

| 4 | 8 | 11 |

| 5 | 9 | 12 |

#### 2.2.2 使用merge函数

此外,我们也可以借助merge函数进行纵向合并的操作,通过指定合并的方式和规则来实现数据的整合。

```python

data7 = {'key': ['K0', 'K1', 'K2'],

'G': ['Z0', 'Z1', 'Z2']}

df7 = pd.DataFrame(data7)

data8 = {'key': ['K3', 'K4', 'K5'],

'G': ['Z3', 'Z4', 'Z5']}

df8 = pd.DataFrame(data8)

result_merge_vertical = pd.merge(df7, df8, how='outer')

pr

```

0

0