【pstats性能分析进阶篇】:如何精准定位Python应用的性能瓶颈

发布时间: 2024-10-02 05:43:56 阅读量: 6 订阅数: 8

# 1. Python应用性能分析基础知识

## 1.1 为何性能分析至关重要

在现代软件开发中,应用性能直接影响用户体验和系统的稳定性。对于Python开发者来说,了解性能分析的基础知识是至关重要的。性能分析不仅可以帮助我们诊断应用程序的瓶颈,还可以指导我们进行有效的性能优化,从而提升应用的速度和响应能力。

## 1.2 性能分析的目标

性能分析的主要目标是识别代码中最耗时的部分,即瓶颈。通过对程序执行时间的详细测量,我们可以确定应该重点关注的区域。这种分析对于优化资源消耗和计算效率至关重要。

## 1.3 理解性能分析的基本指标

性能分析涉及多个关键指标,包括CPU使用率、内存消耗、I/O操作、执行时间等。掌握这些指标有助于我们判断应用在特定环境下的性能表现,并为后续的调优工作奠定基础。

# 2. 深入理解Python性能分析工具

在第二章中,我们将深入探讨Python性能分析工具的核心知识,以助于理解如何精确地识别和诊断性能瓶颈。我们将从性能分析工具概述开始,逐步深入到性能数据的解读,最后探索高级性能分析技巧。以下是本章的详细内容。

## 2.1 性能分析工具概述

性能分析工具是优化Python应用性能不可或缺的助手。在本节,我们将重点介绍两个流行的性能分析工具:cProfile和line_profiler。

### 2.1.1 cProfile的原理和使用

cProfile是Python标准库中的一个性能分析工具,它通过采样方式对程序进行性能分析。它记录了所有函数调用的次数以及每个函数调用的累计时间,因此非常适合进行粗粒度的性能分析。

#### cProfile的基本使用

使用cProfile非常简单,可以通过命令行直接启动,或在代码中导入并使用。下面是一个基本的例子:

```python

import cProfile

def my_function():

# some function logic

pass

cProfile.run('my_function()')

```

此代码将输出`my_function()`的性能分析结果。通过分析这个输出,我们可以获取到每个函数的调用次数、总时间、最大递归深度等信息。

#### cProfile的输出解读

cProfile的输出通常包含以下列:

- `ncalls`: 函数被调用的次数。

- `tottime`: 函数本身执行的累计时间。

- `percall`: 单次调用的累计时间。

- `cumtime`: 函数调用累计时间。

- `percall`: 单次调用的累计时间。

- `filename:lineno(function)`: 调用发生的文件名、行号和函数名。

解读这些信息能够帮助我们识别那些耗费时间最多的函数,进而找到性能瓶颈。

### 2.1.2 line_profiler的深入分析

line_profiler是一个专门针对代码逐行性能分析的工具。它比cProfile更精细,能够告诉我们每一行代码的执行时间。

#### 安装和使用line_profiler

首先需要安装line_profiler包,可以通过pip进行安装:

```shell

pip install line_profiler

```

然后,通过`kernprof`命令和`@profile`装饰器来标记需要分析的函数:

```python

from line_profiler import LineProfiler

def my_line_profiled_function():

# some function logic

pass

if __name__ == "__ '__":

profiler = LineProfiler()

profiler.add_function(my_line_profiled_function)

profiler.enable_by_count()

my_line_profiled_function()

profiler.print_stats()

```

在上述代码中,`LineProfiler`对象跟踪指定函数的每一行,并记录性能数据。

#### line_profiler的输出分析

line_profiler提供的输出会详细到每一行代码。输出一般包括:

- 每行代码的执行次数。

- 每行代码的总执行时间。

- 该行代码在所有函数中的执行时间百分比。

通过逐行分析,我们可以深入理解程序的性能瓶颈,特别是在那些被频繁调用的函数中。

## 2.2 性能数据的解读和应用

性能分析工具产生的数据是诊断性能问题的关键,本节将讨论如何解读这些数据,并从中提取有价值的信息。

### 2.2.1 理解性能数据报告

性能数据报告是性能分析的直接结果,它提供了程序运行时各个部分的性能指标。理解这些数据对于性能优化至关重要。

- **总计时间(Total Time)**: 评估函数调用的效率。

- **自身时间(Self Time)**: 分析函数本身的性能瓶颈。

- **子调用时间(Child Call Time)**: 关注在函数内部调用其他函数的时间消耗。

- **调用比例(Call Percentage)**: 对比不同函数在总执行时间中所占的比重。

### 2.2.2 如何从报告中提取有价值信息

解读性能报告时,应当关注以下几个方面:

- **最耗时函数**: 确定程序中哪些函数的调用导致了最多的执行时间。

- **调用关系**: 分析函数之间的调用关系,特别是那些导致性能问题的递归调用或深层调用。

- **内存消耗**: 在多线程和多进程程序中,内存消耗往往与性能问题密切相关。

### 2.2.3 性能数据与代码优化的关联

性能数据直接反映了程序运行的效率问题,代码优化需要紧密依赖这些数据进行。优化的目标是减少程序的执行时间、内存消耗或者资源使用,提升程序的响应速度和吞吐量。

- **热点优化**: 找到性能热点,即耗时最多的代码段,进行优化。

- **算法调整**: 根据性能数据选择更高效的算法和数据结构。

- **并行化**: 利用多线程或多进程处理可以并行的计算任务。

## 2.3 高级性能分析技巧

当面对复杂的性能问题时,需要使用更高级的性能分析技巧来定位问题。

### 2.3.1 分析多线程和多进程应用

多线程和多进程应用由于并发执行,使得性能分析更为复杂。我们需要理解不同线程或进程间交互对性能的影响。

- **锁竞争**: 分析多个线程对共享资源的竞争情况。

- **I/O绑定**: 识别I/O操作导致的线程或进程阻塞。

- **负载均衡**: 确保任务合理分配到不同的线程或进程中。

### 2.3.2 内存分析工具的使用和解读

内存泄漏是Python应用中的常见问题,特别是在长时间运行的程序中。使用内存分析工具可以帮助我们识别这些问题。

- **对象保留**: 通过工具找出哪些对象没有被垃圾回收器回收。

- **内存泄漏模式**: 分析这些保留对象的模式,以确定内存泄漏的原因。

- **优化内存使用**: 根据分析结果优化数据结构和算法,减少内存占用。

### 2.3.3 实时性能监控工具

实时性能监控工具可以持续追踪应用程序性能指标,从而使得开发者可以在问题发生时及时得到通知。

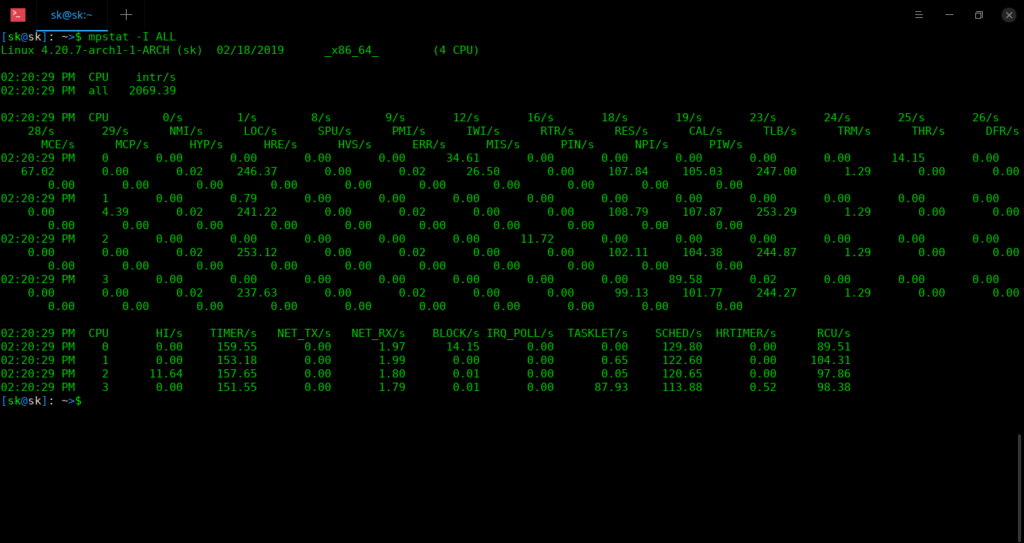

- **性能指标**: 监控关键性能指标,如CPU使用率、内存消耗、I/O操作。

- **警报设置**: 当性能指标超出预设阈值时触发警报。

- **趋势分析**: 分析性能指标随时间的变化趋势,提前预防性能问题。

以上就是本章的核心内容。在下一章中,我们将进一步探讨Python性能优化实战,包括算法和数据结构优化、代码级别的性能调优,以及系统级别的性能调整策略。

# 3. Python性能优化实战

## 3.1 优化Python算法和数据结构

### 3.1.1 理解算法复杂度对性能的影响

在Python中优化性能时,算法复杂度的理解是至关重要的。复杂度通常表示为大O表示法,它定义了随着输入规模的增长,算法执行时间或空间需求的增长速度。例如,线性时间复杂度O(n)意味着算法的时间需求与输入大小成线性关系,而二次时间复杂度O(n^2)则意味着执行时间会随着输入大小的增加而呈平方级增长。

理解算法复杂度有助于我们预判在数据规模增大时算法的性能表现。在某些情况下,一个简单的算法改变就可以大幅度提升性能。比如,将一个具有O(n^2)复杂度的嵌套循环算法,改进为使用O(n log n)复杂度的快速排序算法,可以显著减少对大数据集的操作时间。

代码示例:

```python

# 例子:O(n^2)复杂度的算法

def nested_loop_sum(matrix):

total = 0

for row in matrix:

for value in row:

total += value

return total

# 例子:O(n log n)复杂度的算法,使用快速排序

def quick_sort(lst):

```

0

0