HDFS数据安全与备份策略:保护数据不受意外丢失的权威指南

发布时间: 2024-10-25 16:50:21 阅读量: 53 订阅数: 23

# 1. HDFS基础与数据安全概览

## 1.1 HDFS的基本概念

Hadoop分布式文件系统(HDFS)是一个高度容错性的系统,适合在廉价硬件上运行。它被设计用来提供高吞吐量的数据访问,非常适合大规模数据集的应用。HDFS提供了一个高度冗余的存储解决方案,能够存储PB级别的数据。其核心设计理念是把数据分割成固定大小的块(block),然后跨多个节点(node)进行复制,以实现数据的高可用性和容错性。

## 1.2 HDFS数据安全的重要性

在大数据环境中,数据的安全性是确保业务连续性和满足合规要求的关键。HDFS作为存储层,其数据安全涉及防止未经授权的数据访问、数据丢失和数据损坏等。因此,了解HDFS的数据保护机制对于保护数据资产至关重要。

## 1.3 数据安全策略的构成

一个完善的数据安全策略应包括预防、检测和响应三个主要部分。对于HDFS,预防措施涉及权限控制、加密和定期备份。检测则依赖于审计日志的分析。响应则是指在安全事件发生时的应对措施,比如灾难恢复计划。通过这样的多层次防护,可以显著增强HDFS上存储数据的安全性。

# 2. 理解HDFS的数据保护机制

## 2.1 HDFS的复制机制

### 2.1.1 数据副本的存储原理

HDFS通过一种称为“复制”的机制来保证数据的可靠性和高可用性。Hadoop分布式文件系统设计之初就考虑到了硬件故障是常态,因此它在存储数据时会将数据分割成一系列的块(block),并默认地将每个块复制到多个(通常是3个)不同的数据节点(datanode)上。这些副本块在物理位置上是分散存储的,这样当某个节点出现故障时,数据仍然可以从其他节点上被读取,从而实现了容错的目的。

数据的复制不仅能够提高数据读取的性能,也确保了即便在单点故障的情况下,数据也能够被完整地保存。HDFS在数据写入时,会采用一种称为“一次写入,多次读取”(Write Once Read Many, WORM)的策略,意味着一旦数据块写入HDFS后,其内容将保持不变,除非使用特定的管理命令来修改数据副本的策略。

### 2.1.2 副本放置策略和数据可靠性

副本的放置策略遵循一些基本原则,以确保数据的高可用性和数据恢复的速度。首先,HDFS会尽量避免数据副本在同一机架上的节点上过多地存储,从而降低整个机架出现故障导致数据丢失的风险。通常,一个副本被放置在写入数据的节点上,另一个副本放置在与写入节点不同的机架的节点上,第三个副本和其他副本则根据集群的剩余空间和性能考量分散放置。

HDFS通过心跳机制监控集群内各个数据节点的健康状态,如果检测到某个节点失效,HDFS会自动从其他节点上复制数据块来替换失效节点上的数据副本,以保持系统的整体数据副本数量。在设置副本数量时,可以根据业务需求和集群规模来调整默认的副本因子,但这会直接影响到存储空间的利用率和数据的可靠性。

## 2.2 HDFS的权限控制

### 2.2.1 用户和权限模型

HDFS在权限控制方面提供了一套基于POSIX风格的权限模型。在HDFS中,每个用户都有一个唯一的用户名和与之关联的用户组信息。文件和目录在HDFS中都可以被赋予读、写、执行权限,这些权限可以针对文件所有者、同组用户以及其他用户来分别设置。

权限模型的操作包括对文件和目录的所有权变更,以及对权限的更改,这些都是通过HDFS的命令行工具来执行的。例如,`hdfs dfs -chown`命令可以更改文件或目录的所有者,`hdfs dfs -chmod`命令可以更改文件或目录的权限。HDFS的权限控制还支持通过设置安全模式来限制对敏感数据的访问,进一步强化数据的安全性。

### 2.2.2 访问控制列表(ACLs)和安全模式

除了基本的权限模型之外,HDFS还支持访问控制列表(Access Control Lists,ACLs)来实现更细粒度的权限控制。ACLs为每个用户或用户组提供了对特定文件或目录更详细的访问权限设置。使用ACLs可以覆盖基本权限模型的限制,允许管理员为特定用户或用户组设置读、写、执行等权限。

此外,HDFS还提供了一个特殊模式,称为安全模式,该模式在Hadoop集群启动后运行一段时间(默认为30秒)。在安全模式下,HDFS会自动检查和复制数据副本到其他节点,以确保达到设定的副本因子。在这一模式下,修改文件(例如创建、删除、重命名)是受限的,以确保数据一致性。只有当集群运行正常并且副本因子达到要求后,HDFS才会退出安全模式,允许用户进行正常的读写操作。

## 2.3 HDFS审计日志

### 2.3.1 审计日志的配置与管理

HDFS为了加强数据操作的可追踪性,提供了审计日志功能。通过配置审计日志,可以记录对文件系统的所有操作,包括读写操作、权限修改等敏感事件。审计日志的配置主要包括指定哪些类型的操作需要被记录以及日志存储的位置。

管理员需要在HDFS的配置文件中设置审计日志的相关参数,包括启用审计日志的记录、设置日志策略以及确定审计日志的存储路径等。一旦审计日志功能被激活,所有的操作记录都会按照定义的策略进行记录和存储。

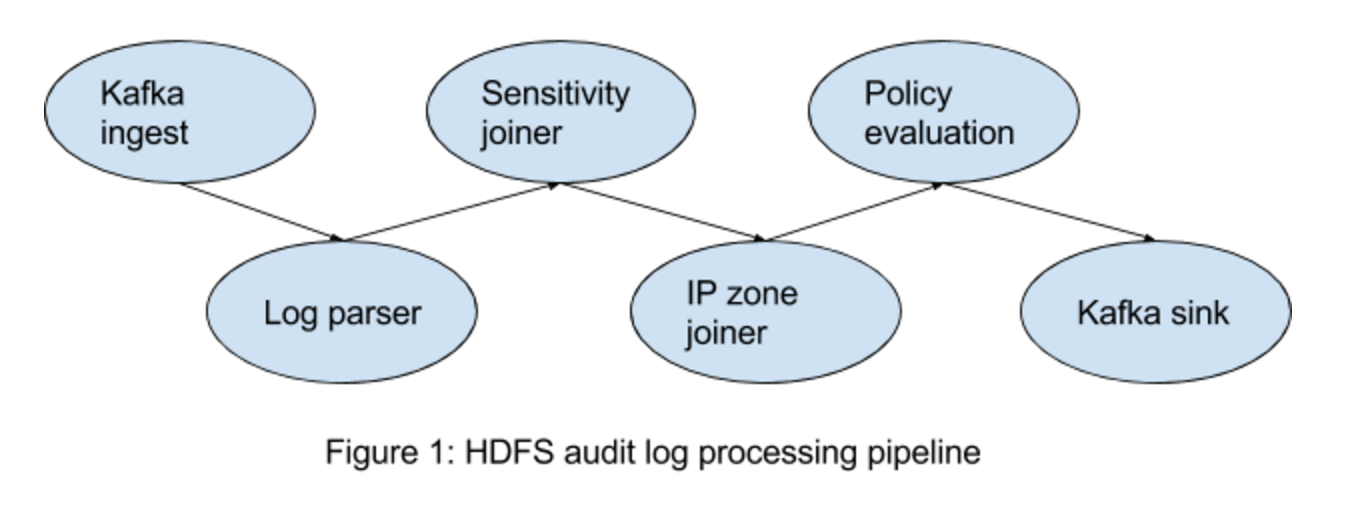

### 2.3.2 审计日志的分析与应用

审计日志记录了丰富的操作信息,包括操作时间、操作用户、操作类型、操作的文件路径以及操作结果等。这些日志文件是可查询的文本文件,管理员可以通过搜索和分析这些日志来了解HDFS文件系统的使用情况,监控异常操作,以及进行安全审计。

为了方便审计日志的分析,可以使用一些数据处理工具,如grep、awk等命令行工具,或者使用日志分析软件来对审计日志进行深入的挖掘。此外,审计日志也可以被配置为实时传输到日志分析系统中,以便及时发现问题并作出响应。

通过审计日志,管理员可以实现对HDFS操作行为的持续监控和审查,及时发现潜在的安全风险,并采取措施进行干预,从而加强数据保护和合规性。

# 3. HDFS数据备份策略

## 3.1 定期备份的策略设计

### 3.1.1 备份的时机选择和执行流程

在数据密集型的环境中,定期备份是数据安全的一个关键组成部分。备份的时机选择依赖于数据更新的频率和业务连续性需求。对于经常变化的数据,每天备份可能是必要的,而对于相对静态的数据,可能每周或每月备份就足够了。HDFS提供了一套工具来自动化备份流程。

在选择备份时机时,需要权衡几个因素:

- **数据的重要性**:业务关键数据需要更频繁的备份。

- **备份窗口**:系统中可以执行备份操作的时间段。

- **备份容量**:备份过程中对存储资源的需求。

- **恢复时间目标(RTO)**:在故障发生后,数据需要多长时间内恢复可用状态。

备份执行流程通常包括以下几个步骤:

1. **初始化备份**:设定备份策略,包括备份的时间间隔、备份数据的选择等。

2. **备份执行**:在设定的时间点触发备份操作,使用Hadoop的DistCp命令或其他备份工具进行数据复制。

3. **数据传输**:将选定的数据复制到备份存储位置。

4. **验证备份**:检查备份数据的一致性和完整性。

5. **清理旧备份**:根据设定的策略清理旧的备份数据,以释放存储空间。

### 3.1.2 备份数据的存储和管理

备份数据的存储和管理是确保备份有效性的重要环节。在HDFS中,备份数据可以存放在相同的集群中,也可以选择外部存储系统如Amazon S3、HDFS兼容的云存储或专用的备份设备。

备份数据管理的关键策略包含:

- **备份版本控制**:为每次备份保留不同的版本,有助于在数据损坏或误操作时恢复到特定时间点的状态。

- **备份生命周期管理**:定义保留期限,自动删除过期的备份,以节约存储空间并降低管理成本。

- **备份验证**:定期验证备份数据的完整性和可恢复性。

- **安全合规**:确保备份数据符合数据安全标准和法规要求,如加密传输和存储。

## 3.2 快照管理

### 3.2.1 快照的创建和恢复

快照功能允许HDFS在特定时间点创建文件系统的镜像。用户可以对这些镜像执行数据恢复操作,而不是从头开始重新复制数据。在HDFS中,快照创建和管理是通过`hdfs dfsadmin -allowSnapshot <path>`命令以及相关的Hadoop API实现的。

创建快照的步骤可能如下:

1. **启用快照功能**:在HDFS命名空

0

0