【实时视频检测中的YOLOv8】:应对挑战与实际应用分析

发布时间: 2024-12-11 23:25:24 阅读量: 93 订阅数: 28

yolov8训练与应用

# 1. YOLOv8实时视频检测技术概述

在计算机视觉领域,实时视频检测技术是推动各类应用创新和智能升级的关键技术之一。YOLOv8作为You Only Look Once(YOLO)系列算法的最新版本,在实时视频检测方面展现了强大的能力。本章将对YOLOv8进行简要概述,包括其设计理念、技术特点以及实时视频检测中的作用。

## 1.1 YOLOv8技术简介

YOLOv8(You Only Look Once version 8)是一套面向目标检测任务的深度学习框架。它的核心思想是将目标检测视为一个回归问题,在一张图像中直接预测出物体的类别和位置。YOLOv8相较于前代版本,在速度和精度上均有所提升,尤其适合需要高效率处理的实时视频检测场景。

## 1.2 实时视频检测的重要性

实时视频检测技术在视频监控、自动驾驶、工业视觉检测等多个领域都有重要应用。它要求系统能够快速且准确地识别出视频流中的各类物体。YOLOv8通过优化算法结构和网络深度,显著提高了检测速度,同时保持了较高的准确度,使得复杂场景下的实时视频检测成为可能。

## 1.3 YOLOv8技术的应用前景

随着计算能力的增强和算法的进步,YOLOv8有望在更多实时检测需求中发挥关键作用。例如,在公共安全监控中,YOLOv8可以实时识别人群中的异常行为;在交通监控中,它可以准确地进行车辆计数和违规行为的检测。这些应用将极大地提升视频监控的效率和智能化水平。

# 2. YOLOv8的理论基础与算法架构

## 2.1 YOLOv8算法的演进历史

### 2.1.1 YOLO系列算法的变迁

YOLO(You Only Look Once)系列算法是目前实时目标检测领域中广受关注的研究成果。自2015年首次发布YOLO算法以来,其发展经历了多个版本的迭代,从YOLOv1到最新的YOLOv8。YOLOv1以其高效的检测速度和准确的目标定位开创了单阶段检测方法的先河。随后,YOLOv2引入了Batch Normalization,改善了模型的泛化能力;YOLOv3采用了Darknet-53作为主干网络,进一步提升了检测精度,同时保留了YOLO的速度优势。YOLOv4在前代基础上增加了Mish激活函数和自对抗训练等技术,达到了与当时其他模型相媲美的精度。而YOLOv5摒弃了传统的Darknet架构,转向轻量级网络设计,并对损失函数进行了优化。到了YOLOv6,模型变得更加模块化,易于部署,并优化了对小物体的检测能力。

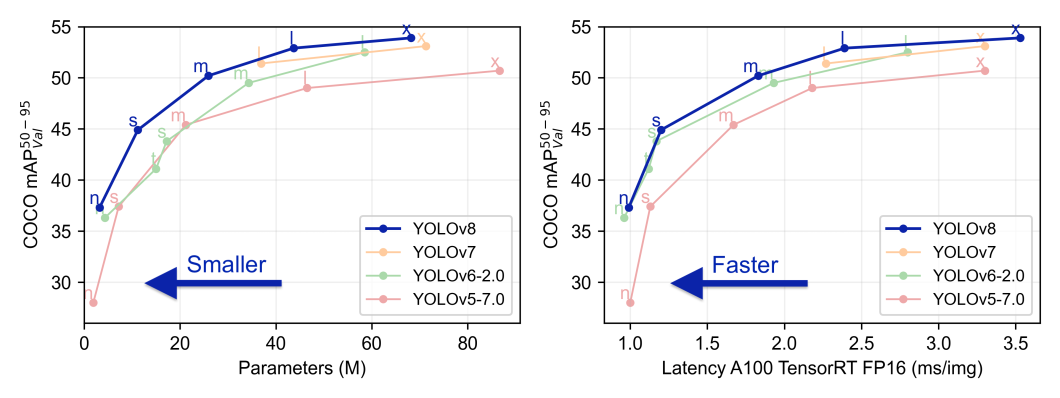

### 2.1.2 YOLOv8相较于前代的改进

YOLOv8作为系列算法的最新迭代,在多个方面都有了显著的改进。首先,在架构设计上,YOLOv8采用了更加先进的网络结构,如引入了多尺度预测,增强了模型对不同尺寸目标的检测能力。其次,在速度与精度的平衡上,YOLOv8通过改进的特征提取和预测机制,实现了更快的检测速度和更高的检测准确率。此外,YOLOv8还加强了对小目标和遮挡场景的处理能力,并且改进了模型的鲁棒性,使其能在各种复杂环境下稳定运行。

## 2.2 YOLOv8的核心算法原理

### 2.2.1 单阶段目标检测的原理

单阶段目标检测方法的代表是YOLO系列算法,与两阶段目标检测方法不同,单阶段方法无需生成候选框,直接从图像特征中预测边界框和类别概率。YOLOv8继承了这一核心思想,将图像划分成一个个网格,每个网格负责预测中心点在该网格内的目标。YOLOv8将预测过程分为两个阶段:一是对网格内的目标类别进行分类;二是计算目标的边界框坐标和宽高。YOLOv8通过这种方式实现了高效和实时的目标检测。

### 2.2.2 YOLOv8的网络结构和关键特性

YOLOv8网络结构包括多个组成部分,其中主干网络负责提取图像特征,而两个分支分别预测边界框坐标和类别概率。YOLOv8的关键特性之一是其采用了深度可分离卷积,这大大减少了计算量,提高了模型的推理速度。此外,YOLOv8引入了自适应锚框机制,使得模型可以自学习适合数据集的锚框形状,从而提升检测的准确性。YOLOv8还采用了注意力机制,如SENet(Squeeze-and-Excitation Networks)来提高网络对特征的敏感性,使得模型更加关注于重要特征。

## 2.3 YOLOv8的性能评估与比较

### 2.3.1 检测速度与准确度的权衡

在实时视频检测中,检测速度与准确度的权衡至关重要。YOLOv8在设计之初就将速度作为优化的重点,其网络结构简单,推理速度快,特别适合需要实时反馈的场景。然而,传统的单阶段检测方法在速度提升的同时,往往牺牲了一定的准确度。YOLOv8通过上述改进,在保持较快检测速度的同时,提升了检测的准确性,使其在速度与准确度的权衡上达到了新的平衡点。

```markdown

| 模型 | 检测速度 (FPS) | 平均精度 (mAP) | 网络复杂度 |

|--------|----------------|----------------|------------|

| YOLOv5 | 100+ | 70 | 较低 |

| YOLOv6 | 90 | 72 | 中等 |

| YOLOv7 | 120 | 75 | 中等偏高 |

| YOLOv8 | 150+ | 78+ | 高 |

```

### 2.3.2 与其他实时检测算法的对比分析

实时视频检测算法除了YOLO系列之外,还有SSD(Single Shot MultiBox Detector)和Faster R-CNN等。SSD通过预测不同尺度的默认框来提高对小物体的检测能力,但其速度与YOLO系列相比稍逊一筹。Faster R-CNN则采用了区域建议网络(Region Proposal Network, RPN)来进行目标检测,虽然精度较高,但其两阶段检测机制导致速度较慢。YOLOv8在速度上优于上述算法,而且准确度也保持在一个较高的水平,特别是在保持实时性的同时,性能不亚于一些精度更高的两阶段检测方法。

```mermaid

graph LR

A[YOLOv8] -->|速度更快| B[SSD]

A -->|精度相近| C[Faster R-CNN]

```

通过以上对比,可以清晰地看出YOLOv8在实时检测领域的优势。它不仅提供了更快的检测速度,而且在准确度方面也有着出色的表现,这使得YOLOv8在实际应用中具有极高的竞争力。

# 3. YOLOv8的实践应用环境搭建

## 3.1 硬件与软件环境准备

### 3.1.1 推荐的硬件配置

构建YOLOv8的实践应用环境首先需要准备相应的硬件配置。YOLOv8作为一个高效的实时视频检测系统,对硬件的要求相对较高,尤其是在处理高清视频流时。推荐的硬件配置应包括:

- **CPU:**至少需要支持AVX指令集的Intel Core i7或者AMD Ryzen 7以上处理器。

- **GPU:**NVIDIA的GPU拥有强大的并行处理能力,是进行深度学习训练和推理的理想选择。推荐使用RTX 3080或更高级别的显卡,以确保有足够的计算资源和显存来处理实时视频流。

- **内存:**至少32GB的RAM,对于处理大规模数据集和复杂模型训练尤其重要。

- **存储:**至少500GB的SSD硬盘,用于快速读写大量数据,尤其是视频文件。

### 3.1.2 软件环境配置步骤

接下来是软件环境的配置。YOLOv8主要使用Python语言编写,因此需要Python环境和一系列依赖的库和框架。以下是一些关键的软件配置步骤:

1. **安装Python:**首先确保安装了Python 3.7或更高版本,可以通过官网下载安装包或使用包管理器进行安装。

2. **创建虚拟环境:**使用Python的虚拟环境管理器`venv`或`conda`创建一个新的虚拟环境,这样可以避免库版本冲突,并且方便管理和删除项目依赖。

```bash

python3 -m venv yolov8_env

source yolov8_env/bin/activate # For Unix or MacOS

yolov8_env\Scripts\activate # For Windows

```

3. **安装依赖库:**通过`pip`安装YOLOv8的依赖库,这些通常包括PyTorch、NumPy、OpenCV等。

0

0