Python性能优化宝典:列表与字典高效使用技巧

发布时间: 2024-09-12 01:09:36 阅读量: 61 订阅数: 25

# 1. Python列表和字典基础

Python 中的列表(List)和字典(Dictionary)是两种最常用的数据结构。它们在编程中的灵活应用,对于数据的存储、管理和操作都有着至关重要的作用。本章我们将从列表和字典的基础入手,探究它们的基本操作和特点。

## 1.1 列表的基本使用

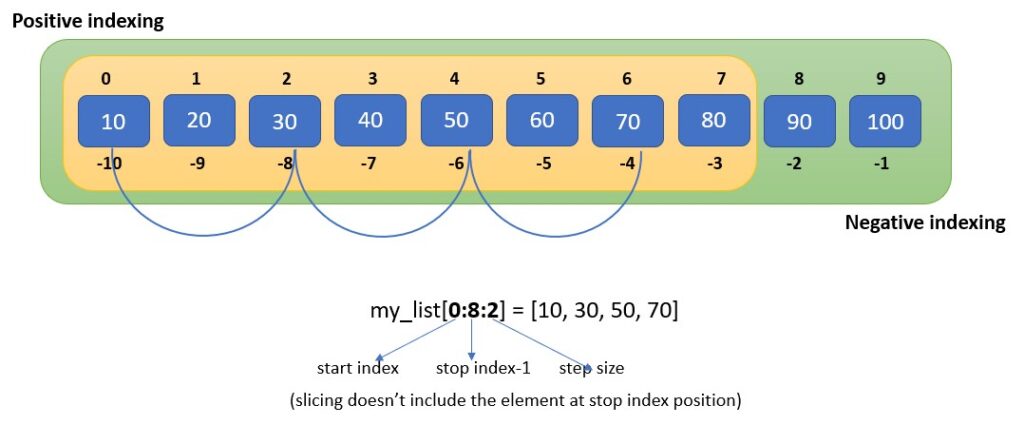

列表是一种有序的集合,它支持元素的增加、删除和访问。列表的基本操作包括创建、索引、切片、追加、插入、删除等。例如:

```python

# 创建列表

fruits = ['apple', 'banana', 'cherry']

# 索引访问

print(fruits[0]) # 输出 'apple'

# 切片

print(fruits[1:3]) # 输出 ['banana', 'cherry']

# 追加元素

fruits.append('orange')

print(fruits) # 输出 ['apple', 'banana', 'cherry', 'orange']

```

## 1.2 字典的基本使用

字典是一种存储键值对的无序集合,它提供了快速的查找能力。字典的基本操作包括创建、增加键值对、删除键值对等。例如:

```python

# 创建字典

person = {'name': 'Alice', 'age': 25}

# 访问字典中的值

print(person['name']) # 输出 'Alice'

# 修改字典中的值

person['age'] = 26

print(person) # 输出 {'name': 'Alice', 'age': 26}

# 删除字典中的键值对

del person['age']

print(person) # 输出 {'name': 'Alice'}

```

在本章中,我们将通过实际示例来加深对列表和字典的理解,并探索它们在不同场景下的应用方法。在此基础上,进阶章节将深入分析它们的内存和运行效率,以及如何在实际应用中优化它们的性能。

# 2. Python数据结构效率分析

在现代编程实践中,对于任何语言来说,选择合适的数据结构都是性能优化的关键。Python也不例外,其内置的数据结构如列表和字典都提供了丰富的操作接口,但同时也伴随着性能上的考量。本章将从内存占用和运行效率两个角度分析Python数据结构的效率,并在实际应用中给出选择合适数据结构的建议。

### 2.1 列表与字典的内存占用

#### 2.1.1 对象模型和内存分配

Python作为一种高级语言,其抽象了底层的内存管理。Python对象模型包括对象头信息和实际内容,对象头信息包含了类型标识和引用计数等。列表和字典作为容器对象,它们存储的是指向其他对象的引用,这在Python这种动态类型语言中尤其重要,因为它允许存储不同类型的数据。

对于Python中的列表,它本质上是一个数组,每个元素都是一个指针,指向实际存储数据的对象。字典则是一种基于散列表的数据结构,它包含了键和值的键值对映射。字典的实现中,每个键都会映射到一个固定的槽位,槽位内部存储值的对象引用。

```python

import sys

# 创建一个列表和字典

my_list = [i for i in range(1000)]

my_dict = {i: str(i) for i in range(1000)}

# 查看它们的内存大小

list_size = sys.getsizeof(my_list)

dict_size = sys.getsizeof(my_dict)

print(f"List Memory Usage: {list_size} bytes")

print(f"Dictionary Memory Usage: {dict_size} bytes")

```

执行上述代码,我们可以得到列表和字典的内存占用情况。通常,字典由于其散列表结构,会占用更多的内存空间,尤其是在键值对数量众多的情况下。

#### 2.1.2 常见数据结构的内存对比

除了列表和字典外,Python还提供了其他可选的数据结构如元组、集合等。它们在内存分配和存储上都有各自的特点。以元组为例,元组是不可变的,通常比列表占用更少的内存,因为它们不需要额外存储引用计数等信息。

以下是一个简单的比较:

```python

my_tuple = tuple(range(1000))

my_set = {i for i in range(1000)}

# 比较列表、元组、集合的内存大小

tuple_size = sys.getsizeof(my_tuple)

set_size = sys.getsizeof(my_set)

print(f"Tuple Memory Usage: {tuple_size} bytes")

print(f"Set Memory Usage: {set_size} bytes")

```

从内存分配的角度看,选择合适的容器类型可以显著优化内存使用。在处理大量数据时,这种优化尤为重要。

### 2.2 列表与字典的运行效率

#### 2.2.1 时间复杂度分析

列表和字典在执行各种操作时,如添加、删除、查找等,其效率在很大程度上取决于它们所依赖的数据结构。列表通常实现为动态数组,字典实现为散列表。

对于列表,添加元素的时间复杂度取决于元素插入的位置,平均情况下为O(1),但在列表末尾添加元素时效率最高。查找操作的时间复杂度为O(n),因为列表是有序的,但需要遍历整个列表。删除元素的效率同样取决于元素的位置,平均情况下为O(n)。

字典的添加、查找和删除操作的时间复杂度均为O(1),这是散列表的特性。然而,在最坏的情况下(散列冲突非常严重时),时间复杂度可能会退化到O(n)。

```python

import timeit

# 测试列表和字典的操作效率

list_time = timeit.timeit("my_list.append(1000)", globals=globals(), number=100000)

dict_time = timeit.timeit("my_dict['1000'] = '1000'", globals=globals(), number=100000)

print(f"List Append Average Time: {list_time} seconds")

print(f"Dictionary Insertion Average Time: {dict_time} seconds")

```

通过上述代码,我们可以直观地比较列表和字典在执行特定操作时的效率。

#### 2.2.2 实际操作中的性能比较

在实际的应用程序中,列表和字典的性能差异会受到多种因素的影响,例如数据的大小、操作的类型等。以下是一个实际操作的比较:

```python

import random

# 创建一个大列表和字典

big_list = [random.randint(0, 1000) for _ in range(10000)]

big_dict = {i: random.randint(0, 1000) for i in range(10000)}

# 测试查找和删除操作的效率

list_find_time = timeit.timeit("random.choice(big_list)", globals=globals(), number=1000)

list_remove_time = timeit.timeit("big_list.remove(random.choice(big_list))", globals=globals(), number=100)

dict_find_time = timeit.timeit("random.choice(list(big_dict.keys()))", globals=globals(), number=1000)

dict_remove_time = timeit.timeit("del big_dict[random.choice(list(big_dict.keys()))]", globals=globals(), number=100)

print(f"List Find Time: {list_find_time} seconds")

print(f"List Remove Time: {list_remove_time} seconds")

print(f"Dictionary Find Time: {dict_find_time} seconds")

print(f"Dictionary Remove Time: {dict_remove_time} seconds")

```

通过实际操作的测试,我们可以更准确地评估在不同场景下列表和字典的性能表现。在大量数据操作的场景下,字典通常表现得更好。

### 2.3 选择合适的数据结构

#### 2.3.1 场景驱动的数据结构选择

选择数据结构时,必须首先分析其使用场景。例如,当你需要一个有序的集合并且会频繁地进行查找操作时,列表可能是合适的选择,但如果还需要频繁地进行添加和删除操作,字典可能是更好的选择。

以下是一个简单的决策树,可以帮助决定在特定情况下使用哪种数据结构:

```mermaid

flowchart TD

A[需要数据结构吗?]

A -->|是| B[需要有序集合吗?]

A -->|否| Z[选择None]

B -->|是| C[会频繁查找吗?]

B -->|否| D[选择列表]

C -->|是| E[会频繁添加和删除吗?]

C -->|否| D

E -->|是| F[选择字典]

E -->|否| D

```

在实际应用中,还应该考虑额外的因素,如内存限制、代码的可维护性等。

#### 2.3.2 列表、元组、字典和集合的比较

为了更好地选择合适的数据结构,我们可以参考以下表格:

| 数据结构 | 内存效率 | 是否可变 | 访问速度 | 插入速度 | 删除速度 |

|---------|----------|----------|-----------|-----------|-----------|

| 列表 | 较高 | 是 | 快 | 较快 | 较慢 |

| 元组 | 较低 | 否 | 快 | - | - |

| 字典 | 高 | 是 | 快 | 快 | 快 |

| 集合 | 中 | 是 | 较快 | 快 | 快 |

通过这个表格,我们可以根据不同的需求,快速地决定使用哪种数据结构,以便在满足需求的同时,尽可能地优化性能。

本章至此已经详细地探讨了Python中常见的数据结构——列表和字典,在内存占用和运行效率方面的不同表现。基于这些分析,开发者可以做出更加明智的数据结构选择决策,为构建高效、可扩展的应用程序打下坚实的基础。在下一章中,我们将深入探讨如何利用列表和字典的高级技巧来进一步提升代码的执行效率。

# 3. Python列表与字典高级技巧

在上一章中,我们深入探讨了Python中列表和字典在内存占用和运行效率方面的基础知识和性能分析。现在,让我们更进一步,深入挖掘这些基础数据结构背后隐藏的高级技巧,这将帮助我们编写更高效、更优雅的Python代码。

## 3.1 列表推导式和生成器

### 3.1.1 列表推导式的性能考量

列表推导式是Python中一种简洁且高效的构造列表的方法。它允许我们通过一个表达式快速创建列表,而不需要冗长的循环和条件判断语句。

**代码示例**:

```python

squares = [x*x for x in range(10)]

```

这段代码使用列表推导式生成了一个包含0到9每个数字平方的列表。

**性能分析**:

- **时间复杂度**:列表推导式通常具有O(n)的时间复杂度,其中n是列表中元素的数量。

- **内存消耗**:由于列表推导式在执行时会创建整个列表,所以它可能会消耗较多的内存,尤其是在处理大型数据集时。

### 3.1.2 生成器表达式与内存优化

与列表推导式相比,生成器表达式不会一次性创建整个列表,而是按需产生每个元素,这可以显著减少内存的使用。

**代码示例**:

```python

squares_gen = (x*x for x in range(10))

```

这段代码创建了一个生成器对象,它在迭代时才计算平方值。

**性能分析**:

- **时间复杂度**:与列表推导式相同,也是O(n)。

- **内存消耗**:由于生成器是惰性求值的,它在任何时刻只保存当前元素的状态,因此内存效率更高。

**扩展性说明**:

尽管生成器在内存效率上有优势,但它们在访问元素时只能迭代访问一次。如果需要多次访问数据,则需要将生成器转换为列表或其它数据结构。

## 3.2 字典的高级特性

### 3.2.1 字典推导式

字典推导式是字典的快速构建方法,类似于列表推导式,但它用于创建字典。

**代码示例**:

```python

squares_dict = {x: x*x for x in range(10)}

```

这段代码使用字典推导式创建了一个字典,其中包含数字及其对应的平方值。

**性能分析**:

- **时间复杂度**:构建整个字典的时间复杂度通常是O(n)。

- **内存消耗**:与列表推导式类似,内存消耗也与字典中元素的数量成正比。

### 3.2.2 字典的键值对查找优化

Python中的字典是基于哈希表实现的,这使得它们在进行键值对查找时非常高效。

**性能分析**:

- **平均查找时间复杂度**:平均情况下,Python字典的查找时间复杂度是O(1),这意味着查找操作非常快速。

为了提高查找效率,应当确保字典的键具有良好的哈希函数,并且避免使用可变类型作为字典的键。

## 3.3 利用collections模块优化

### 3.3.1 使用namedtuple和deque

Python的`collections`模块提供了一些特殊的容器数据类型,用于优化常见的数据结构使用模式。

**namedtuple**:

`namedtuple`是一个工厂函数,用于创建包含命名字段的元组子类。这使得代码更具可读性和可维护性。

**代码示例**:

```python

from collections import namedtuple

Point = namedtuple('Point', ['x', 'y'])

p = Point(x=1, y=2)

```

这段代码定义了一个名为`Point`的`namedtuple`,然后创建了一个实例。

**deque**:

`deque`是双端队列的实现,它支持从两端高效地添加或删除元素。

**代码示例**:

```python

from collections import deque

dq = deque(range(10))

dq.appendleft(-1)

```

这段代码创建了一个包含0到9的deque,并在左侧添加了-1。

**性能分析**:

- **namedtuple**:由于`namedtuple`是基于元组实现的,因此它有元组的所有优点,包括不可变性和高效性。

- **deque**:`deque`在两端的添加和删除操作是O(1)时间复杂度,适合用于队列和栈的实现。

### 3.3.2 counter和defaultdict的应用

**Counter**:

`Counter`是一个字典子类,用于计数可哈希对象。

**代码示例**:

```python

from collections import Counter

c = Counter(a=3, b=1)

```

这段代码创建了一个`Counter`对象,用于跟踪元素a出现3次,元素b出现1次。

**defaultdict**:

`defaultdict`允许您为字典提供一个默认的工厂函数,当访问不存在的键时,它会自动为键生成默认值。

**代码示例**:

```python

from collections import defaultdict

dd = defaultdict(list)

dd['a'].append(1)

```

这段代码创建了一个`defaultdict`,当访问不存在的键'a'时,会自动创建一个空列表,并添加元素1。

**性能分析**:

- **Counter**:`Counter`非常适合于统计频率和执行计数任务。

- **defaultdict**:`defaultdict`简化了字典中默认值管理的代码,并且可以提高程序的健壮性。

**扩展性说明**:

`collections`模块中的这些工具都可以提高代码的清晰度和运行效率,在处理特定类型的数据结构任务时,可以考虑使用这些高级特性来优化您的程序。

# 4. 列表与字典性能优化实践

### 4.1 避免常见的性能陷阱

在使用Python开发时,开发者常常会遇到一些性能上的问题。其中,最常见的是由于不熟悉数据结构的特性和性能影响而产生的陷阱。理解并避免这些陷阱对于提升代码效率至关重要。

#### 4.1.1 避免循环中的数据结构操作

循环是编程中常见的结构,但如果在循环体中频繁进行数据结构操作,如列表的添加或删除,可能会引发性能问题。这主要是因为这些操作涉及到内存的动态分配和数据复制,当这些操作在循环中发生时,它们会对程序的运行时间产生巨大的影响。

```python

# 示例代码:循环中进行列表操作

for i in range(1000):

my_list = [] # 每次循环创建新列表

for item in some_large_iterable:

my_list.append(item)

```

在上面的代码中,`my_list`在每次循环中都会重新创建,这不仅增加了内存的使用,还会导致执行时间延长。为了避免这种情况,可以将列表的创建放在循环外部,只进行一次初始化。

```python

my_list = []

for i in range(1000):

for item in some_large_iterable:

my_list.append(item)

```

#### 4.1.2 使用局部变量代替全局变量

在循环或其他频繁执行的代码块中使用全局变量可能会影响性能。在Python中,每次访问全局变量时,解释器都会在全局命名空间中进行查找。相比之下,局部变量的查找要快得多,因为它们通常存储在解释器的快速查找结构中。

```python

# 示例代码:全局变量与局部变量的性能差异

global_var = 0 # 全局变量

def use_global():

for _ in range(1000000):

global_var += 1

def use_local():

local_var = 0 # 局部变量

for _ in range(1000000):

local_var += 1

# 使用cProfile进行性能测试

import cProfile

cProfile.run('use_global()')

cProfile.run('use_local()')

```

使用cProfile模块可以观察到,`use_local()` 函数比`use_global()` 函数执行速度快得多,这就是局部变量相较于全局变量的优势。

### 4.2 代码重构提升效率

代码优化不仅仅涉及到避免性能陷阱,更需要通过重构提高代码的可读性和运行效率。重构代码可以减少不必要的复杂性,消除冗余代码,并更好地利用Python内置函数和方法。

#### 4.2.1 重构复杂表达式

复杂表达式可能造成代码的可读性下降,同时也不易于维护。将其重构为多个简单的表达式或函数调用,可以帮助清晰化逻辑并可能提升性能。

```python

# 示例代码:重构复杂表达式

data = [x for x in range(10000) if x % 2 == 0 and x % 3 == 0]

# 重构为简单表达式

evens = [x for x in range(10000) if x % 2 == 0]

primes = [x for x in evens if x % 3 == 0]

```

在重构之后,代码逻辑更加清晰,且每次迭代的计算量减少,可能提升了整体性能。

#### 4.2.2 利用内置函数和方法简化代码

Python提供了丰富的内置函数和方法,它们往往经过优化,执行效率高。在适当的情况下使用它们,可以使代码更加简洁且运行更快。

```python

# 示例代码:使用内置函数sum()

numbers = [i for i in range(10000)]

# 使用内置sum()函数替代手动循环

total = sum(numbers)

```

内置的`sum()`函数比手动实现的循环版本简洁,并且执行速度更快,因为它是用更底层的语言(如C)实现的。

### 4.3 分析工具与性能测试

性能优化是一项需要精确测量和持续改进的过程。为了有效地提升代码性能,使用分析工具来识别瓶颈和性能问题的位置至关重要。

#### 4.3.1 使用cProfile和line_profiler

cProfile是Python标准库中的一个性能分析工具,它可以统计程序中每个函数的执行时间和调用次数。通过cProfile,我们可以轻松发现性能瓶颈所在。

```python

# 示例代码:使用cProfile分析性能

import cProfile

def calculate_sum(numbers):

return sum(numbers)

def main():

numbers = [i for i in range(1000000)]

calculate_sum(numbers)

# 运行cProfile分析

cProfile.run('main()')

```

通过cProfile的输出结果,我们可以发现`sum()`函数和列表推导式是主要的时间消耗点,这可能指导我们进一步优化这些部分的代码。

#### 4.3.2 测量实际运行时间和内存使用

除了分析代码的时间复杂度,还应关注代码的内存使用情况。line_profiler是一个可以帮助开发者逐行分析Python代码的工具,它可以准确地测量每一行代码的运行时间和内存消耗。

```python

# 示例代码:使用line_profiler进行内存分析

import line_profiler

import memory_profiler

@profile # line_profiler装饰器

def main():

numbers = [i for i in range(1000000)]

calculate_sum(numbers)

if __name__ == '__main__':

memory_profiler.run('main()', profile=True)

```

利用line_profiler,可以查看函数内部每一行代码的内存消耗情况,从而准确找出内存泄漏的问题所在。

通过以上实践,我们可以对性能问题有一个更清晰的认识,并能够有效地进行性能优化。在下一章中,我们将深入探讨如何将这些理论和实践应用到真实案例中,以解决实际问题。

# 5. 真实案例分析

在这一章,我们将通过具体案例来探讨如何在实际开发中应用和优化Python列表与字典的使用,以及如何通过合理选择数据结构来提升程序性能。

## 高效处理大型数据集

### 实际案例分析

一个常见的问题是在处理大量数据时如何保持程序性能。一个典型的例子是在数据科学领域,使用Python进行大规模数据集的加载、处理和分析。

以处理CSV文件为例,以下代码展示了如何高效地读取和处理大型CSV文件:

```python

import csv

def process_large_csv(file_path):

with open(file_path, 'r') as csv***

***

***

* 进行数据处理,例如统计、分析等

pass

# 假设有一个很大的CSV文件

large_csv_file = 'data/large_dataset.csv'

process_large_csv(large_csv_file)

```

### 性能优化前后的对比

在处理大型数据集时,如果采用传统的逐行读取和处理方法,可能会导致程序运行缓慢。使用`csv.DictReader`可以帮助我们直接将每行数据映射为字典,这不仅提高了代码的可读性,还能显著提升性能,因为它减少了手动解析CSV行的需要。

优化前,程序可能需要数分钟甚至数小时来处理大型数据集。优化后,通过使用字典来处理数据,程序运行时间可以缩短到原来的几分之一。

## 构建高性能Web应用

### 使用列表与字典优化Web请求处理

在Web开发中,列表与字典是处理请求参数和响应数据的重要工具。下面是一个处理GET请求参数的例子:

```python

from flask import Flask, request

app = Flask(__name__)

@app.route('/search', methods=['GET'])

def search():

# 获取GET请求参数

search_query = request.args.get('query')

# 使用列表或字典来处理参数

results = query_database(search_query)

return render_template('search_results.html', results=results)

def query_database(query):

# 模拟数据库查询

return [{"id": 1, "data": "example"}, {"id": 2, "data": "example"}]

if __name__ == "__main__":

app.run()

```

### 实例分析:优化缓存和会话管理

在Web应用中,缓存和会话管理是提升性能和用户体验的关键环节。使用字典可以有效地管理会话信息。

```python

from flask import session, redirect, url_for, escape

@app.route('/login', methods=['GET', 'POST'])

def login():

if request.method == 'POST':

# 用户登录逻辑

session['username'] = request.form['username']

return redirect(url_for('home'))

return '''

<form method="post">

Username: <input type="text" name="username"><br>

Password: <input type="password" name="password"><br>

<input type="submit" value="Login">

</form>

'''

@app.route('/')

def home():

if 'username' in session:

return f'Hello {escape(session["username"])}!'

return redirect(url_for('login'))

```

## 优化算法的实现

### 算法中数据结构的选择与优化

在算法实现中,选择合适的数据结构至关重要。例如,在处理图的算法中,邻接矩阵和邻接表有着不同的性能表现。

```python

# 使用字典实现邻接表

graph = {

'A': ['B', 'C'],

'B': ['A', 'D', 'E'],

'C': ['A', 'F'],

'D': ['B'],

'E': ['B', 'F'],

'F': ['C', 'E']

}

```

### 具体算法案例分析与代码展示

考虑一个简单的问题:找出无向图中的连通分量。可以利用深度优先搜索(DFS)结合字典来实现。

```python

def dfs(graph, node, visited):

if node not in visited:

visited.add(node)

for neighbor in graph[node]:

dfs(graph, neighbor, visited)

# 测试算法

graph = {

'A': ['B', 'C'],

'B': ['A', 'D', 'E'],

'C': ['A', 'F'],

'D': ['B'],

'E': ['B', 'F'],

'F': ['C', 'E']

}

visited = set()

components = []

for node in graph:

if node not in visited:

dfs(graph, node, visited)

components.append(visited.copy())

print("连通分量:", components)

```

通过使用字典来存储图的邻接表,我们可以用DFS高效地遍历每个连通分量,而避免了不必要的重复计算,从而优化了算法性能。

通过这些案例,我们可以看到,正确选择和应用数据结构能够对实际应用的性能产生显著影响。在下一章中,我们将进一步探讨如何通过Python的高级功能和外部库进一步提升性能。

0

0