Python机器学习实战:从零开始构建机器学习模型,探索数据奥秘

发布时间: 2024-06-17 17:22:31 阅读量: 83 订阅数: 31

# 1. 机器学习基础**

机器学习是一种计算机科学领域,它使计算机能够从数据中学习,而无需明确编程。它基于这样的理念:计算机可以通过识别模式和关系,从数据中提取知识并做出预测。

机器学习算法可以分为两类:监督学习和非监督学习。监督学习算法使用带有标签的数据进行训练,其中标签表示数据的目标值。非监督学习算法使用未标记的数据进行训练,从中发现隐藏的模式和结构。

机器学习在各种行业中都有广泛的应用,包括预测分析、图像识别和自然语言处理。它使计算机能够执行复杂的任务,例如检测欺诈、推荐产品和诊断疾病。

# 2. 数据预处理与特征工程

### 2.1 数据预处理技术

数据预处理是机器学习流程中至关重要的一步,它可以提高数据的质量,为后续的建模和分析奠定坚实的基础。

#### 2.1.1 数据清洗和转换

数据清洗和转换主要包括以下步骤:

- **处理缺失值:**缺失值是数据集中常见的现象,需要根据具体情况进行处理。常见的方法包括:删除缺失值、用平均值或中位数填充、使用机器学习模型预测缺失值。

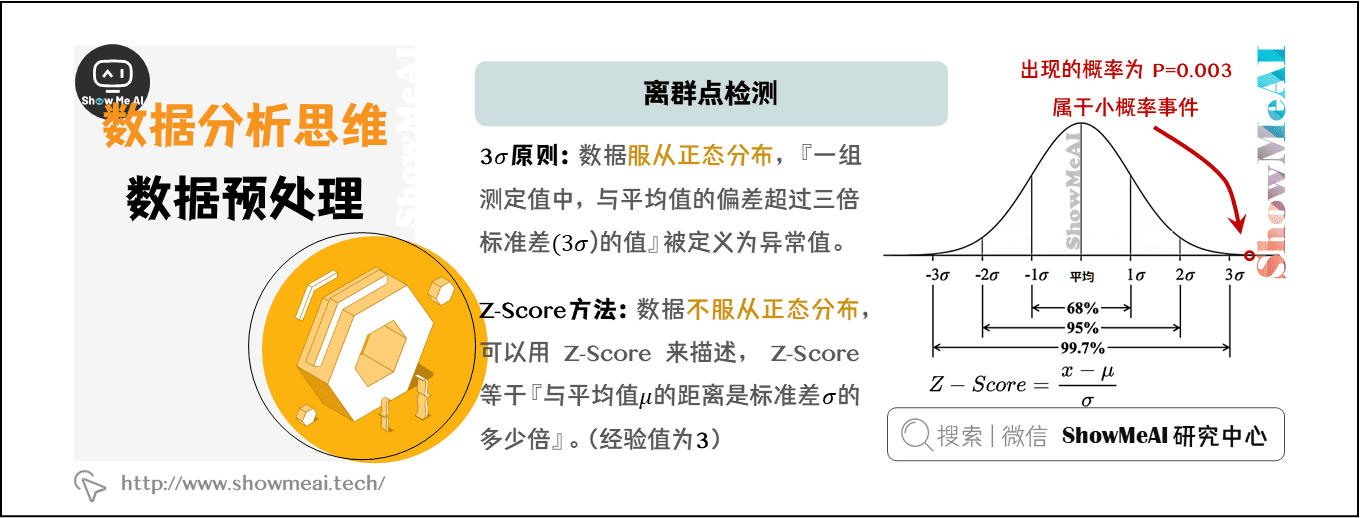

- **处理异常值:**异常值是与数据集中的其他值明显不同的数据点,可能由测量错误或数据输入错误引起。异常值可以影响建模结果,因此需要进行处理。常见的方法包括:删除异常值、用临近值替换、使用机器学习模型预测异常值。

- **数据类型转换:**不同的机器学习算法要求数据具有特定的数据类型。例如,线性回归要求数据为数值型,而决策树要求数据为类别型。因此,需要根据算法的要求对数据类型进行转换。

#### 2.1.2 数据归一化和标准化

数据归一化和标准化是将数据缩放到特定范围内的技术,可以提高模型的性能。

- **数据归一化:**将数据缩放到[0, 1]的范围内。

- **数据标准化:**将数据缩放到均值为0、标准差为1的范围内。

数据归一化和标准化的主要区别在于,归一化只考虑数据的值域,而标准化还考虑了数据的分布。在数据分布不均匀的情况下,标准化比归一化更有效。

### 2.2 特征工程

特征工程是将原始数据转换为机器学习模型可以理解和使用的特征的过程。特征工程对于提高模型的性能至关重要。

#### 2.2.1 特征选择

特征选择是选择与目标变量相关性较高的特征,以减少模型的复杂性和提高其性能。常见的特征选择方法包括:

- **过滤法:**根据特征与目标变量的相关性进行选择,如卡方检验、互信息等。

- **包裹法:**将特征组合成子集,并选择性能最好的子集。

- **嵌入法:**在模型训练过程中进行特征选择,如L1正则化、树模型等。

#### 2.2.2 特征提取

特征提取是将原始特征转换为更高层次、更抽象的特征的过程。常见的特征提取方法包括:

- **主成分分析(PCA):**将原始特征投影到新的正交空间中,并选择方差最大的主成分作为新特征。

- **奇异值分解(SVD):**类似于PCA,但可以处理非线性数据。

- **线性判别分析(LDA):**将原始特征投影到新的空间中,使得不同类别的样本具有最大的可分性。

**代码块:使用Scikit-learn进行数据归一化**

```python

from sklearn.preprocessing import MinMaxScaler

scaler = MinMaxScaler()

data_normalized = scaler.fit_transform(data)

```

**逻辑分析:**

该代码块使用Scikit-learn库中的MinMaxScaler对数据进行归一化。MinMaxScaler将数据缩放到[0, 1]的范围内。fit_transform()方法将scaler拟合到数据并将其转换到归一化后的数据。

**参数说明:**

- data:需要归一化的数据。

- data_normalized:归一化后的数据。

# 3.1 监督学习模型

### 3.1.1 线性回归

**概念:**

线性回归是一种用于预测连续值目标变量的监督学习模型。它假设目标变量与特征变量之间存在线性关系。

**模型方程:**

```python

y = b0 + b1x1 + b2x2 + ... + bnxn

```

其中:

* `y` 是目标变量

* `x1`, `x2`, ..., `xn` 是特征变量

* `b0` 是截距

* `b1`, `b2`, ..., `bn` 是特征变量的系数

**参数估计:**

线性回归模型的参数(截距和系数)通过最小化均方误差 (MSE) 来估计。MSE 是预测值与真实值之间的平方差的平均值。

```python

MSE = (1/n) * Σ(yi - ŷi)^2

```

其中:

* `n` 是样本数量

* `yi` 是真实值

* `ŷi` 是预测值

**逻辑回归**

**概念:**

逻辑回归是一种用于预测二分类目标变量的监督学习模型。它假设目标变量的概率分布服从逻辑函数。

**模型方程:**

```python

p = 1 / (1 + e^(-(b0 + b1x1 + b2x2 + ... + bnxn)))

```

其中:

* `p` 是目标变量为 1 的概率

* `x1`, `x2`, ..., `xn` 是特征变量

* `b0` 是截距

* `b1`, `b2`, ..., `bn` 是特征变量的系数

**参数估计:**

逻辑回归模型的参数通过最大化似然函数来估计。似然函数是模型在给定数据的情况下产生观测值的概率。

```python

L = Π(p_i^yi * (1 - p_i)^(1 - yi))

```

其中:

* `p_i` 是样本 `i` 的目标变量为 1 的概率

* `yi` 是样本 `i` 的真实目标变量值

### 3.1.3 决策树

**概念:**

决策树是一种用于预测分类或连续值目标变量的监督学习模型。它通过递归地将数据分割成更小的子集来构建一个树形结构。

**树结构:**

* **根节点:**包含所有数据

* **内部节点:**根据特征变量将数据分割成子集

* **叶节点:**代表目标变量的预测值

**决策规则:**

决策树通过选择最佳特征和分割点来创建决策规则。最佳特征和分割点是根据信息增益或信息增益率等指标选择的。

**模型构建:**

决策树模型通过递归地应用以下步骤构建:

1. 选择最佳特征和分割点。

2. 将数据分割成子集。

3. 对每个子集重复步骤 1 和 2,直到达到停止条件(例如,数据子集太小或所有特征都已使用)。

**表格:监督学习模型比较**

| 模型 | 目标变量类型 | 假设 | 优点 | 缺点 |

|---|---|---|---|---|

| 线性回归 | 连续 | 线性关系 | 简单易懂 | 对异常值敏感 |

| 逻辑回归 | 二分类 | 逻辑函数分布 | 适用于二分类问题 | 对数据分布敏感 |

| 决策树 | 分类/连续 | 无 | 可解释性强 | 容易过拟合 |

# 4. 机器学习模型评估与优化

### 4.1 模型评估指标

#### 4.1.1 回归模型评估指标

回归模型评估指标用于衡量模型预测值与真实值之间的差异。常用的指标包括:

- **均方误差(MSE)**:MSE 是预测值与真实值平方差的平均值。MSE 越小,模型拟合越好。

```python

from sklearn.metrics import mean_squared_error

mse = mean_squared_error(y_true, y_pred)

```

- **平均绝对误差(MAE)**:MAE 是预测值与真实值绝对差的平均值。MAE 衡量模型预测的平均误差。

```python

from sklearn.metrics import mean_absolute_error

mae = mean_absolute_error(y_true, y_pred)

```

- **决定系数(R2)**:R2 表示模型预测值与真实值之间的相关性。R2 越接近 1,模型拟合越好。

```python

from sklearn.metrics import r2_score

r2 = r2_score(y_true, y_pred)

```

#### 4.1.2 分类模型评估指标

分类模型评估指标用于衡量模型预测类别与真实类别的准确性。常用的指标包括:

- **准确率**:准确率表示模型正确预测的样本数量占总样本数量的比例。

```python

from sklearn.metrics import accuracy_score

accuracy = accuracy_score(y_true, y_pred)

```

- **精确率**:精确率表示模型预测为正例的样本中实际为正例的样本数量占预测为正例的样本数量的比例。

```python

from sklearn.metrics import precision_score

precision = precision_score(y_true, y_pred)

```

- **召回率**:召回率表示模型预测为正例的样本中实际为正例的样本数量占实际为正例的样本数量的比例。

```python

from sklearn.metrics import recall_score

recall = recall_score(y_true, y_pred)

```

- **F1 分数**:F1 分数是精确率和召回率的加权调和平均值。F1 分数越高,模型分类性能越好。

```python

from sklearn.metrics import f1_score

f1 = f1_score(y_true, y_pred)

```

### 4.2 模型优化方法

#### 4.2.1 超参数调优

超参数调优是指调整机器学习模型中影响模型性能的参数。常用的超参数调优方法包括:

- **网格搜索**:网格搜索是一种穷举法,它通过尝试参数的各种组合来找到最佳参数。

```python

from sklearn.model_selection import GridSearchCV

param_grid = {'C': [0.1, 1, 10], 'kernel': ['linear', 'rbf']}

grid_search = GridSearchCV(SVC(), param_grid, cv=5)

grid_search.fit(X, y)

```

- **随机搜索**:随机搜索是一种随机采样方法,它通过随机选择参数组合来找到最佳参数。

```python

from sklearn.model_selection import RandomizedSearchCV

param_distributions = {'C': scipy.stats.uniform(0.1, 10), 'kernel': ['linear', 'rbf']}

random_search = RandomizedSearchCV(SVC(), param_distributions, n_iter=100, cv=5)

random_search.fit(X, y)

```

#### 4.2.2 正则化

正则化是一种技术,它通过惩罚模型的复杂性来防止过拟合。常用的正则化方法包括:

- **L1 正则化(LASSO)**:L1 正则化通过惩罚模型中系数的绝对值之和来限制模型的复杂性。

```python

from sklearn.linear_model import Lasso

lasso = Lasso(alpha=0.1)

lasso.fit(X, y)

```

- **L2 正则化(岭回归)**:L2 正则化通过惩罚模型中系数的平方和来限制模型的复杂性。

```python

from sklearn.linear_model import Ridge

ridge = Ridge(alpha=0.1)

ridge.fit(X, y)

```

# 5. 机器学习实战项目**

### 5.1 房价预测

**5.1.1 数据获取**

首先,我们需要获取房价预测数据集。我们可以从 Kaggle 或其他数据仓库下载数据集。

**5.1.2 数据预处理**

数据预处理是一个至关重要的步骤,它可以提高模型的性能。我们需要执行以下操作:

- **数据清洗:** 删除缺失值、异常值和不一致的数据。

- **数据转换:** 将非数字特征转换为数字特征,例如使用独热编码。

- **数据归一化:** 将不同范围的特征缩放至相同范围,以防止某些特征对模型产生过大影响。

**5.1.3 特征工程**

特征工程是创建模型输入特征的过程。我们可以使用以下技术:

- **特征选择:** 选择与目标变量最相关的特征。

- **特征提取:** 创建新的特征,这些特征可以更好地表示数据。

**5.1.4 模型构建**

对于房价预测,我们可以使用线性回归模型。线性回归模型是一个监督学习算法,它试图找到一条直线来拟合数据点。

**5.1.5 模型评估**

模型评估是评估模型性能的过程。对于回归模型,我们可以使用均方根误差 (RMSE) 或平均绝对误差 (MAE) 等指标。

**5.1.6 模型优化**

我们可以使用超参数调优和正则化来优化模型。超参数调优涉及调整模型的内部参数,例如学习率和正则化参数。正则化是一种技术,它可以防止模型过拟合。

### 5.2 文本分类

**5.2.1 数据获取**

我们可以从互联网或数据仓库下载文本分类数据集。

**5.2.2 数据预处理**

文本预处理涉及以下步骤:

- **文本清洗:** 删除标点符号、数字和停用词。

- **文本分词:** 将文本分解为单个单词或词组。

- **词袋模型:** 创建一个包含所有单词的词典,并计算每个单词在文本中的出现次数。

**5.2.3 特征工程**

我们可以使用 TF-IDF (Term Frequency-Inverse Document Frequency) 等技术来创建特征。TF-IDF 是一种加权方案,它考虑了单词在文本中出现的频率以及在整个数据集中的频率。

**5.2.4 模型构建**

对于文本分类,我们可以使用逻辑回归或支持向量机 (SVM) 等监督学习算法。

**5.2.5 模型评估**

对于分类模型,我们可以使用准确率、召回率和 F1 分数等指标来评估模型性能。

**5.2.6 模型优化**

我们可以使用超参数调优和正则化来优化模型。

### 5.3 图像识别

**5.3.1 数据获取**

我们可以从互联网或数据仓库下载图像识别数据集。

**5.3.2 数据预处理**

图像预处理涉及以下步骤:

- **图像调整:** 调整图像大小、裁剪和旋转。

- **图像增强:** 使用滤波器、对比度调整和颜色校正来增强图像。

**5.3.3 特征工程**

我们可以使用卷积神经网络 (CNN) 来提取图像特征。CNN 是一种深度学习算法,它可以自动学习图像中的模式。

**5.3.4 模型构建**

对于图像识别,我们可以使用预训练的 CNN 模型,例如 VGGNet 或 ResNet。

**5.3.5 模型评估**

对于图像识别,我们可以使用准确率、召回率和 F1 分数等指标来评估模型性能。

**5.3.6 模型优化**

我们可以使用超参数调优和正则化来优化模型。

0

0