【R语言面板数据深度剖析】:plm包协变量动态分析实战

发布时间: 2024-11-10 17:30:32 阅读量: 52 订阅数: 26

# 1. R语言和面板数据简介

## R语言的介绍

R语言是一种用于统计计算和图形的编程语言,其强项在于数据分析与科学计算,广泛应用于经济、金融、生物信息学等多个领域。它拥有大量内置的统计函数,而且可以容易地进行数据处理和可视化,这使得R语言成为处理面板数据的首选工具之一。

## 面板数据的概述

面板数据(Panel Data),也称为纵向数据,是指在一定时间范围内对多个个体单位进行重复观测所获得的数据集合。面板数据能够展示个体随时间变化的动态行为,因其可以控制不随时间变化的个体特性,面板数据在因果关系研究中具有重要价值。

## R语言与面板数据分析的结合

R语言在处理面板数据方面显示出极大的灵活性和强大的功能。它允许用户进行复杂的数据预处理、统计建模、模型诊断和预测。特别值得一提的是R的plm包,专为面板数据设计,能够极大简化面板数据的分析流程,并支持多种统计分析模型。

# 2. plm包基础与面板数据预处理

## 2.1 R语言在面板数据分析中的应用

### 2.1.1 R语言的特点与优势

R语言是一种专门用于统计分析、图形表示和报告的编程语言。它在数据分析领域享有盛誉,原因在于其强大的统计功能、图形表现力以及第三方包的丰富性。R语言有几个显著的特点:

- 开源自由:R语言是开源的,用户可以自由地使用、修改和分发。

- 社区支持:有一个庞大、活跃的开发者社区,随时可以提供帮助。

- 可扩展性:通过安装额外的包,R语言几乎可以执行任何统计分析任务。

- 交互性:R提供了强大的交互式数据分析环境。

R语言在面板数据分析中的优势尤为明显,主要体现在以下几点:

- 多样化分析:R语言拥有专门用于面板数据分析的包,如`plm`,使得处理具有时间序列和横截面特征的数据变得非常方便。

- 高级图形:R语言的绘图系统非常灵活,能够生成高质量的图表,这对于数据的探索和展示十分有帮助。

- 灵活的数据处理:R语言拥有许多用于数据清洗、格式化和预处理的强大函数。

### 2.1.2 R语言的主要数据分析包简介

R语言的生态系统非常庞大,包含了数以千计的专门用于数据分析的包。以下是一些在面板数据分析中常用的包:

- `plm`:用于面板数据的估计和展示。

- `dplyr`:数据操作和转换。

- `tidyr`:用于数据的整洁化。

- `ggplot2`:用于创建精美的统计图形。

- `lme4`:用于估计线性和非线性混合效应模型。

这些包中,`plm`包是面板数据处理的核心包,它提供了大量的函数来估计不同类型的面板数据模型,并且能够轻松处理横截面和时间序列数据。接下来,我们将详细探讨`plm`包在面板数据预处理中的具体应用。

## 2.2 面板数据的特点与分类

### 2.2.1 面板数据的定义和类型

面板数据(Panel Data)是跨时间和截面的数据,它涉及到多个实体在不同时间点上的观测值。面板数据的特点主要体现在它既有横截面的维度,又有时间序列的维度。

面板数据可以分为以下几种类型:

- 短面板数据(Short Panel):时间维度较短,截面维度较大。

- 长面板数据(Long Panel):时间维度较长,截面维度较小。

- 平衡面板数据(Balanced Panel):每个时间点都有每个截面单位的观测值。

- 不平衡面板数据(Unbalanced Panel):数据集中存在缺失值,不同截面单位的观测次数不一。

### 2.2.2 面板数据的来源和收集方法

面板数据的来源可以非常多样,常见的获取方式包括:

- 政府或研究机构的数据库

- 企业内部数据库

- 社会调查、问卷调查

- 实验观察等

收集面板数据的方法有:

- 实时追踪:连续收集同一组个体在不同时间点的数据。

- 历史数据整合:将历史记录的数据进行整合,形成面板数据。

- 实验设计:通过控制变量,在不同时间点对特定截面单位进行观测。

面板数据的收集需要综合考虑数据的准确性和完整性。由于面板数据的特殊性,数据预处理显得尤为重要,这将是接下来要讨论的主题。

## 2.3 使用plm包进行面板数据预处理

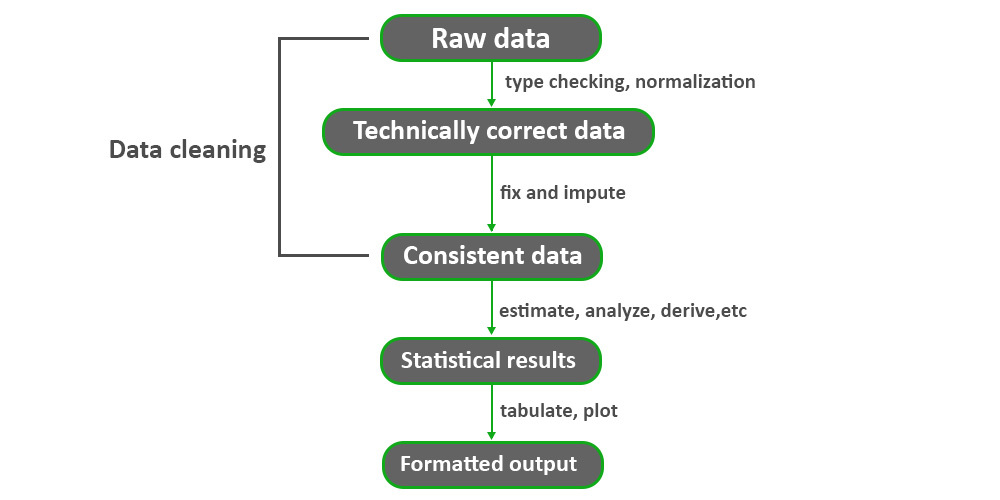

### 2.3.1 数据清洗与格式化

在面板数据分析中,数据清洗和格式化是极其重要的一步。在使用`plm`包之前,需要确保数据是整洁的,每个变量都有正确的格式。数据清洗通常包括以下步骤:

- 删除或填充缺失值

- 处理异常值和错误

- 转换数据类型

- 标准化和归一化数据

在R中,可以使用`dplyr`包的`mutate`、`select`、`filter`等函数来进行这些操作。例如,以下是一个简单的数据清洗示例:

```R

library(dplyr)

# 假设有一个名为panel_data的面板数据框

panel_data <- panel_data %>%

mutate(Var1 = as.numeric(Var1)) %>% # 转换变量类型

filter(!is.na(Var1)) %>% # 删除缺失值

mutate(Var2 = ifelse(Var2 < 0, NA, Var2)) # 处理异常值

```

### 2.3.2 缺失值处理与异常值检测

在面板数据中,缺失值和异常值的处理非常关键,因为它们可以严重影响分析结果的准确性。

#### 缺失值处理

缺失值的处理方法有很多,以下是几个常见的方法:

- 删除含有缺失值的行或列。

- 用均值、中位数或众数等统计量填充缺失值。

- 使用模型预测缺失值,例如多重插补(`mice`包)。

```R

# 使用均值填充

panel_data$Var1 <- ifelse(is.na(panel_data$Var1), mean(panel_data$Var1, na.rm = TRUE), panel_data$Var1)

```

#### 异常值检测

异常值的检测通常依赖于一些统计测试,如Z分数、箱形图、IQR(四分位距)等方法。下面是一个使用IQR检测异常值的例子:

```R

# 计算IQR

IQR_values <- quantile(panel_data$Var2, pro

```

0

0