微服务架构中的内存管理艺术:std::make_shared的角色与实践

发布时间: 2024-10-23 10:37:41 阅读量: 43 订阅数: 35

C++ 智能指针辅助利器:std::make-unique与std::make-shared深度剖析

# 1. 微服务架构与内存管理基础

## 简介

微服务架构近年来已成为软件开发领域的热门话题,它通过将应用分解为一系列小的、松耦合的服务组件,使得应用更易于扩展、维护和部署。在微服务架构中,高效的内存管理成为保证系统稳定性和性能的关键因素。

## 内存管理的重要性

在微服务环境中,每个服务可能由不同的团队开发,并运行在隔离的环境中。这意味着每个服务都需要管理自己的内存资源,防止内存泄漏和资源竞争问题,从而保障整个系统的健康运行。

## 内存管理策略

内存管理策略包括合理使用内存分配和释放操作,避免内存碎片,以及使用内存池和智能指针等工具来提升内存的使用效率和安全性。

在后续章节中,我们将详细探讨`std::make_shared`在微服务架构中的应用,它如何提升内存的使用效率,以及如何在实际项目中优化内存管理策略。通过深入理解内存管理的基础知识和最佳实践,我们可以构建更加健壮和高效的微服务应用。

# 2. std::make_shared的内部机制和优势

在现代C++编程中,内存管理是一个永恒的话题。C++11引入了智能指针,为管理动态分配的内存提供了一个更加安全、自动化的解决方案。std::make_shared是智能指针家族中的一员,它不仅简化了内存管理的过程,而且在性能上也带来了显著的提升。本章将深入探讨std::make_shared的定义、用法、工作原理以及其在性能上造成的影响。

## 2.1 std::make_shared的定义和用法

### 2.1.1 std::make_shared的作用和应用场景

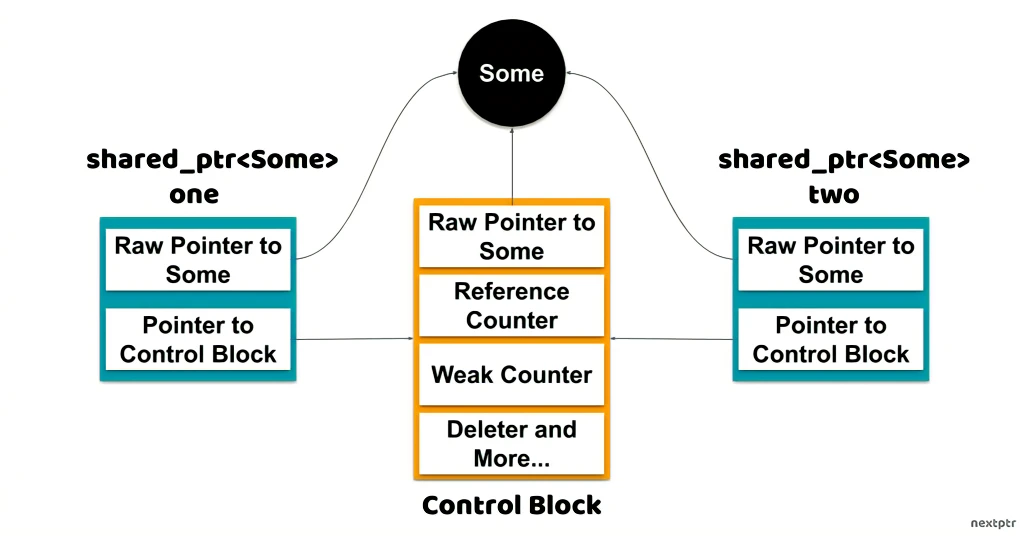

std::make_shared是一个模板函数,它创建并返回一个std::shared_ptr管理的动态分配的对象实例。与直接使用std::shared_ptr配合new操作符相比,std::make_shared有一些显著的优势。首先,std::make_shared会将对象和控制块分配在同一个内存块上,这样可以减少内存分配次数,并且能够避免某些类型的悬挂指针问题。

std::make_shared特别适合用于创建具有单一所有者,且生命周期由多个组件共享的资源。由于它减少了内存碎片并优化了内存使用,因此在创建单例模式或者实现缓存策略时,使用std::make_shared可以减少不必要的资源消耗。

### 2.1.2 与传统new操作符的对比

当使用new操作符创建对象时,会进行两次内存分配:一次用于对象本身,另一次用于与之关联的引用计数。这样的操作在资源使用上是低效的,并且增加了内存碎片化的风险。与此相对,std::make_shared将对象和引用计数合并到一个内存块中,从而优化内存分配和管理。

考虑以下代码示例:

```cpp

std::shared_ptr<int> sp1(new int(10)); // 使用new操作符

std::shared_ptr<int> sp2 = std::make_shared<int>(10); // 使用std::make_shared

```

第一个示例使用new操作符两次分配内存,而第二个示例则只分配一次,这表明std::make_shared在内存使用上的优势。

## 2.2 std::make_shared的工作原理

### 2.2.1 分配器的使用和内存池

std::make_shared内部实现可能会使用分配器来管理内存,这在C++中是一个非常强大的功能。分配器能够允许std::make_shared更加精细地控制内存分配行为,甚至可以与内存池技术结合来进一步优化性能。

内存池是一种预先分配一定数量的内存块的技术,这有助于减少小对象频繁分配和释放造成的性能开销。当使用std::make_shared时,可以考虑到这种预先分配内存的行为,它特别适合那些需要频繁创建和销毁大量小对象的场景。

### 2.2.2 引用计数与资源管理

std::make_shared除了优化内存分配之外,还改善了引用计数的管理。在std::shared_ptr中,引用计数是为了追踪有多少个智能指针对象共享同一个资源。std::make_shared将这个引用计数和对象存储在同一个内存块中,减少了访问共享资源的开销,并且提供了原子操作来保证线程安全。

这种设计简化了共享资源管理的复杂性,并且能够避免由于异常或者并发访问造成的资源管理错误。

## 2.3 std::make_shared的性能影响

### 2.3.1 内存分配和访问效率

std::make_shared将对象和控制块放在同一个内存块上,这不仅减少了内存的分配次数,而且也降低了访问控制块的延迟。因为控制块和对象是连续存储的,所以CPU缓存行可以更加高效地利用,从而提高访问速度。

### 2.3.2 减少内存碎片的策略

频繁的内存分配和释放是导致内存碎片的主要原因。std::make_shared通过减少分配次数来减轻这个问题。当多个std::shared_ptr对象共享同一个std::make_shared创建的对象时,由于对象只有一个实例,因此可以减少内存的浪费和碎片。

通过减少内存碎片,std::make_shared有助于提高应用程序的稳定性和性能,特别是在需要高效内存管理的微服务架构中。

在本章中,我们从定义和用法、工作原理、性能影响三个方面深入地了解了std::make_shared的内部机制和优势。接下来的章节将探讨std::make_shared在微服务架构中的具体应用和优化方法。

# 3. std::make_shared在微服务中的实践应用

## 3.1 微服务架构中的内存管理挑战

### 3.1.1 内存泄漏和资源竞争问题

在微服务架构中,内存泄漏和资源竞争是两个主要的内存管理挑战。每个微服务都是一个独立的进程,这增加了运行时的复杂性,尤其是在资源管理方面。

内存泄漏问题在微服务架构中尤为棘手,因为它可能导致服务实例逐渐耗尽资源,影响其性能和稳定性。在没有有效的监控和诊断机制的情况下,定位和修复内存泄漏问题变得非常困难。通常,这些问题是由于服务内部的逻辑错误导致的,如未正确释放资源或错误使用了内存。

资源竞争问题同样突出。在并发访问共享资源时,如果没有适当的同步机制,可能会出现数据不一致或竞态条件。这种竞争不仅发生在服务内部,还可能在服务之间发生,尤其是在使用共享内存或缓存时。

#### 代码块实践:

```cpp

#include <iostream>

#include <memory>

// 示例:简单的内存泄漏检查机制

// 注意:这并不是一个实际的内存泄漏检测工具,而是演示如何在代码中预防内存泄漏

class Resource {

public:

Resource() {

std::cout << "Resource created\n";

}

~Resource() {

std::cout << "Resource destroyed\n";

}

};

void processResource() {

auto resource = std::make_shared<Resource>(); // 使用std::make_shared确保资源正确释放

// ... 使用resource进行操作 ...

}

int main() {

processResource();

return 0;

}

```

### 3.1.2 内存管理最佳实践

为了应对内存泄漏和资源竞争问题,微服务架构需要采取一些内存管理的最佳实践。首先,服务应当采用智能指针来管理内存,以确保资源的自动释放。其次,应当通过单元测试和集成测试来检测内存泄漏。除此之外,合理的线程同步机制和资源锁也是解决资源竞争的有效策略。

以下是使用`std::make_shared`的示例代码,展示如何在服务间共享资源,同时确保资源的正确释放。

```cpp

#include <iostream>

#include <memory>

#include <thread>

std::shared_ptr<int> sharedResource;

void accessResource() {

std::this_thread::sleep_for(std::chrono::milliseconds(10)); // 模拟耗时操作

// 使用共享资源

*sharedResource += 1;

std::cout << "Resource updated: " << *sharedResource << std::endl;

}

int main() {

sharedResource = std::make_shared<int>(0); // 创建共享资源

std::thread t1(accessResource);

std::thread t2(accessResource);

t1.join();

t2.join();

std::cout << "Final resource value: " << *sharedResource << std::endl;

return 0;

}

```

### 3.2 使用std::make_shared优化内存使用

#### 3.2.1 实例:在服务间共享资源

当微服务需要在多个实例间共享资源时,`std::make_shared`提供了一个高效且安全的方法。它不仅可以减少内存分配的次数,还可以自动管理资源,减少内存泄漏的风险。

下面的示例展示了如何在服务间共享一个计数器资源,每个服务实例使用`std::make_shared`来创建和访问共享资源。

```cpp

#include <iostream>

#include <memory>

#include <thread>

#include <mutex>

std::shared_ptr<int> sharedCounter;

std::mutex counterMutex;

void incrementCounter(int numIterations) {

for (int i = 0; i < numIterations; ++i) {

std::lock_guard<std::mutex> guard(counterMutex);

(*sharedCounter)++;

std::this_thread::sleep_for(std::chrono::milliseconds(10)); // 模拟耗时操作

}

}

int main() {

sharedCounter = std::make_shared<int>(0); // 使用std::make_shared创建共享计数器

std::thread t1(incrementCounter, 1000);

std::thread t2(incrementCounter, 1000);

t1.join();

t2.join();

std::cout << "Final counter value: " << *sharedCounter << std::endl;

return 0;

}

```

#### 3.2.2 实例:构建轻量级微服务组件

轻量级微服务组件的构建需要高效地使用内存和资源。`std::make_shared`提供了一种减少内存碎片和提高内存利用率的方式,这对性能至关重要。

以下是一个示例,展示了如何使用`std::make_shared`构建一个轻量级的微服务组件:

0

0