基于卷积神经网络的交通场景分析研究

发布时间: 2024-05-02 08:26:04 阅读量: 82 订阅数: 35

基于深度卷积神经网络的道路场景理解.pdf

# 1. 交通场景分析概述**

交通场景分析是计算机视觉领域的一个重要应用,其目的是从交通场景图像中提取有意义的信息,例如车辆、行人、交通标志和道路状况。随着交通场景的复杂性和多样性不断增加,传统的图像处理方法已无法满足实际需求,卷积神经网络(CNN)因其强大的特征提取和分类能力而成为交通场景分析领域的主流方法。

CNN是一种深度学习模型,它通过卷积、池化和激活函数等操作从输入图像中提取特征。卷积层可以检测图像中的局部模式,池化层可以减少特征图的大小并增强鲁棒性,激活函数可以引入非线性,使模型能够学习复杂的关系。通过堆叠多个卷积层和池化层,CNN可以学习到图像中越来越抽象和高级的特征,从而实现交通场景的准确分析。

# 2. 卷积神经网络理论基础

### 2.1 卷积神经网络的结构和原理

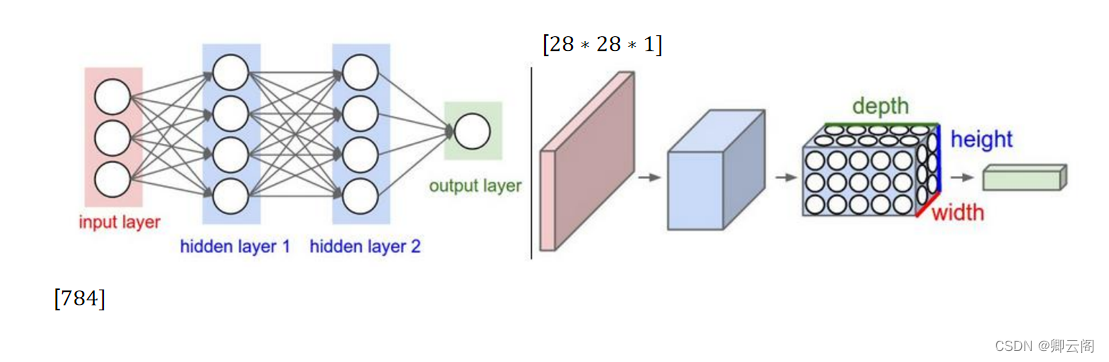

卷积神经网络(CNN)是一种深度学习模型,专门设计用于处理具有网格状结构的数据,如图像。CNN 的结构包括:

- **输入层:**接收输入数据,通常是图像。

- **卷积层:**应用卷积核(过滤器)在输入数据上滑动,提取特征。

- **池化层:**对卷积层输出进行下采样,减少特征图大小。

- **激活函数:**引入非线性,增强模型的表达能力。

- **全连接层:**将卷积层输出展平并连接到输出层。

- **输出层:**产生最终预测结果。

CNN 的原理如下:

- **卷积:**卷积核在输入数据上滑动,计算每个位置的特征值。

- **池化:**池化函数(如最大池化或平均池化)对卷积层输出进行下采样,减少特征图大小。

- **激活函数:**激活函数(如 ReLU 或 sigmoid)引入非线性,使模型能够学习复杂模式。

- **反向传播:**使用反向传播算法计算损失函数的梯度,更新模型权重。

### 2.2 卷积层、池化层和激活函数

#### 卷积层

卷积层是 CNN 的核心组件,负责提取特征。卷积核是一个小矩阵,在输入数据上滑动,计算每个位置的特征值。卷积核的权重和偏置是可学习的参数,通过训练进行优化。

**代码示例:**

```python

import torch

import torch.nn as nn

# 定义卷积层

conv = nn.Conv2d(in_channels=3, out_channels=32, kernel_size=3, stride=1, padding=1)

# 输入数据

input = torch.randn(1, 3, 224, 224)

# 卷积操作

output = conv(input)

```

**逻辑分析:**

* `in_channels`:输入数据通道数(图像为 3,RGB 通道)

* `out_channels`:输出通道数(卷积核个数)

* `kernel_size`:卷积核大小

* `stride`:卷积核滑动步长

* `padding`:卷积核周围填充大小

#### 池化层

池化层对卷积层输出进行下采样,减少特征图大小。池化函数包括最大池化和平均池化。最大池化选择池化窗口内最大值,而平均池化计算池化窗口内平均值。

**代码示例:**

```python

# 定义最大池化层

max_pool = nn.MaxPool2d(kernel_size=2, stride=2)

# 池化操作

output = max_pool(output)

```

**逻辑分析:**

* `kernel_size`:池化窗口大小

* `stride`:池化窗口滑动步长

#### 激活函数

激活函数引入非线性,增强模型的表达能力。常用的激活函数包括 ReLU、sigmoid 和 tanh。ReLU(修正线性单元)是 CNN 中最常用的激活函数,其公式为 f(x) = max(0, x)。

**代码示例:**

```python

# 定义 ReLU 激活函数

relu = nn.ReLU()

# 激活操作

output = relu(output)

```

**逻辑分析:**

* ReLU 激活函数将负值置为 0,保留正值。

0

0