【TensorFlow安装与部署】:从零到英雄,完整教程大公开

发布时间: 2024-12-14 03:15:31 阅读量: 13 订阅数: 7

使用TensorFlow构建神经网络:从零开始的实现.html

参考资源链接:[TensorFlow安装难题:解决'无匹配版本'错误](https://wenku.csdn.net/doc/6zk0vu9qko?spm=1055.2635.3001.10343)

# 1. TensorFlow简介和安装基础

## TensorFlow的历史和应用领域

TensorFlow是一个由Google开发的开源机器学习框架,自2015年发布以来,已迅速成为业界标准的深度学习库。它被广泛应用于图像识别、语音识别、自然语言处理等多个领域。TensorFlow不仅支持深度学习,还能够扩展至强化学习、传统机器学习算法等。

## 为何选择TensorFlow

选择TensorFlow的原因有很多,包括其强大的社区支持、跨平台特性(支持Linux、Mac、Windows)、易于扩展的能力以及丰富的API接口。TensorFlow拥有强大的工具生态,如TensorBoard用于模型可视化,TF-Slim用于简化模型构建等,使其成为开发者和研究人员青睐的工具。

## 安装TensorFlow的推荐环境

为了能够顺利安装并运行TensorFlow,推荐的环境包括Python 3.6及以上版本、64位的操作系统以及至少2GB的RAM。对于GPU加速版本,还需要支持CUDA的NVIDIA GPU和相应的cuDNN库。在接下来的章节中,我们将详细介绍TensorFlow的安装过程和验证方法。

# 2. TensorFlow安装过程详解

安装TensorFlow是迈向深度学习实践的第一步。本章节将详细介绍TensorFlow的安装过程,包括系统要求、安装方法以及安装后的验证和问题排查。确保您在顺利安装TensorFlow的同时,也能够理解安装过程中的细节和可能出现的问题。

## 2.1 TensorFlow的系统要求

在安装TensorFlow之前,先要确认您的计算机是否满足其系统要求。这些要求分为硬件和软件两部分。

### 2.1.1 硬件要求

TensorFlow对硬件的要求取决于您的具体需求,比如开发、训练还是生产部署。

- **CPU**:大多数的现代CPU均能满足安装要求,但TensorFlow在支持AVX指令集的CPU上会运行得更好。

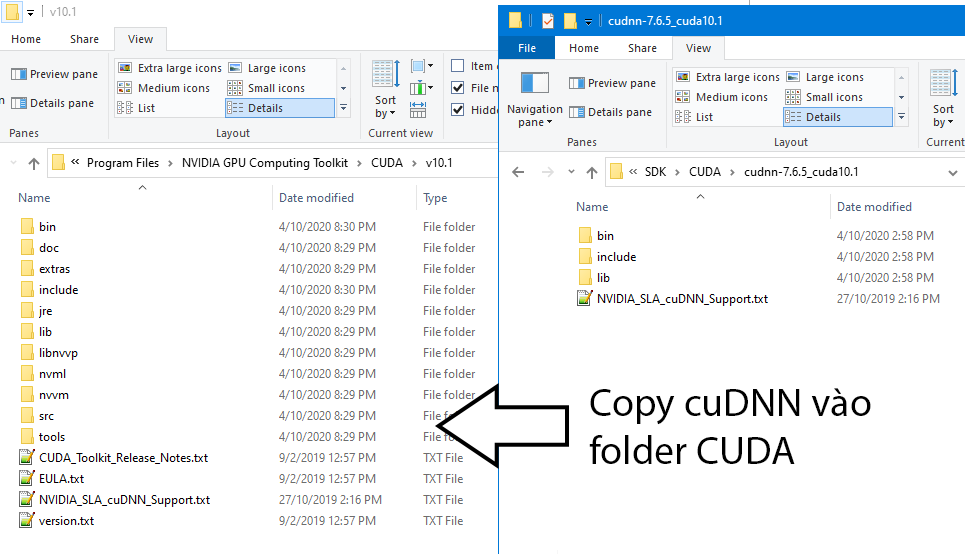

- **GPU**:如果计划进行深度学习模型训练,那么NVIDIA GPU将是最佳选择。支持CUDA 10.0或更高版本以及cuDNN 7.6或更高版本的GPU将非常适合使用TensorFlow。

- **内存**:至少需要2GB的RAM,但建议有更多内存以应对复杂模型的需要。

### 2.1.2 软件环境准备

TensorFlow可以通过Python运行,因此需要先准备合适的Python环境。

- **Python版本**:推荐使用Python 3.6及以上版本。请确保安装了Python,并添加到系统的PATH环境变量中。

- **依赖库**:除了Python,TensorFlow还会使用一些重要的依赖库,如numpy、six、setuptools等。可使用`pip install`命令安装。

- **系统兼容性**:TensorFlow支持Linux、macOS和Windows操作系统。需要注意的是,某些特定功能(如GPU支持)仅在Linux和Windows上可用。

### 代码块和逻辑分析

下面是一个用于检查Python版本的代码块,确保您安装的是支持的Python版本。

```python

import sys

print("Python version: {}".format(sys.version))

```

以上代码执行后,会打印当前Python的版本信息。请确保输出的Python版本号符合TensorFlow的要求。

## 2.2 TensorFlow的安装方法

TensorFlow提供了多种安装方式,包括使用pip、conda包管理器以及手动编译安装。用户可根据自身情况选择合适的安装方法。

### 2.2.1 使用pip安装

pip是Python的包管理工具,大部分用户都会选择使用pip进行安装。

- **CPU-only版本**:适用于不打算使用GPU加速的用户,安装命令如下:

```bash

pip install tensorflow

```

- **GPU版本**:适用于拥有NVIDIA GPU并安装了CUDA和cuDNN的用户,安装命令如下:

```bash

pip install tensorflow-gpu

```

### 2.2.2 使用conda安装

如果您使用conda作为包管理工具,也可以通过Anaconda的包索引安装TensorFlow。

- **CPU-only版本**:

```bash

conda install -c conda-forge tensorflow

```

- **GPU版本**:

```bash

conda install -c anaconda tensorflow-gpu

```

### 2.2.3 手动编译安装

对于希望从源码安装或需要特定TensorFlow版本的用户,可以选择手动编译安装。

手动编译安装涉及以下几个步骤:

1. 下载TensorFlow源代码。

2. 按照TensorFlow的官方文档安装依赖项。

3. 使用bazel工具编译源代码。

### 表格展示

下面展示的是不同安装方法的对比表格:

| 安装方法 | 支持的操作系统 | 是否需要CUDA/cuDNN | 命令示例 |

| --- | --- | --- | --- |

| 使用pip | Linux/macOS/Windows | CPU/GPU | `pip install tensorflow` |

| 使用conda | Linux/macOS/Windows | CPU/GPU | `conda install -c conda-forge tensorflow` |

| 手动编译 | Linux/macOS/Windows | CPU/GPU | `bazel build //tensorflow/tools/pip_package:build_pip_package` |

## 2.3 TensorFlow安装后的验证和问题排查

安装完成后,验证TensorFlow是否正确安装和运行至关重要。

### 2.3.1 环境验证

可以通过运行一个简单的TensorFlow程序来验证安装是否成功。

### 代码块和逻辑分析

```python

import tensorflow as tf

hello = tf.constant('Hello, TensorFlow!')

sess = tf.compat.v1.Session()

print(sess.run(hello))

```

这段代码创建了一个简单的TensorFlow会话,并打印出“Hello, TensorFlow!”。如果一切安装正确,您将看到打印输出。如果没有,需要根据错误信息进行问题排查。

### 2.3.2 常见问题解决

在安装TensorFlow的过程中,可能会遇到一些常见问题。这里列出一些并提供解决方案。

#### 问题一:pip版本太旧

```bash

ERROR: Could not find a version that satisfies the requirement tensorflow (from versions: none)

```

**解决方案**:更新pip到最新版本。

```bash

python -m pip install --upgrade pip

```

#### 问题二:CUDA和cuDNN版本不匹配

如果在安装TensorFlow-GPU版本时遇到CUDA和cuDNN版本不匹配的错误,请检查并更新相应的CUDA和cuDNN版本。

在使用TensorFlow进行深度学习任务之前,确保理解安装过程中的每一个细节。在本章节中,我们讲解了TensorFlow的安装条件、多种安装方式及安装后验证和问题排查方法。这些信息能够帮助您顺利搭建TensorFlow开发环境,并为后续学习和开发打下坚实的基础。

# 3. TensorFlow的基本使用

## 3.1 TensorFlow的基本概念

### 3.1.1 张量和操作

在TensorFlow中,所有的数据都通过张量(Tensor)的形式进行表示,张量可以被理解为一个多维数组。张量的秩(Rank)指的是其维度的数量。比如,一个标量是一个0秩张量,一个向量是一个1秩张量,一个矩阵是一个2秩张量,而一个立方体形状的数据则是一个3秩张量。

```python

import tensorflow as tf

# 创建一个常量张量

tensor = tf.constant([[1, 2], [3, 4]])

# 执行计算

with tf.Session() as sess:

result = sess.run(tensor)

print(result)

```

在上面的代码示例中,我们创建了一个2x2的常量张量。张量操作是TensorFlow编程的核心,可以进行加法、乘法等数学运算。

### 3.1.2 图和会话

TensorFlow使用图(Graph)来表示计算任务,在图中,节点(Node)表示数学运算,而边(Edge)表示在节点间相互传递的多维数组数据。会话(Session)则用来运行整个图。

```python

# 创建一个图

graph = tf.Graph()

with graph.as_default():

# 创建一个常量张量

tensor = tf.constant([[1, 2], [3, 4]])

# 创建一个会话

sess = tf.Session(graph=graph)

# 运行会话,并打印结果

print(sess.run(tensor))

# 关闭会话

sess.close()

```

在该例子中,我们首先创建了一个图,在图的上下文中定义了一个张量,并在会话中运行了图,得到了张量的结果。

## 3.2 TensorFlow的编程模型

### 3.2.1 基本的API使用

TensorFlow提供了丰富的API供开发者使用,基本的API使用包括定义变量(Variable)、构建图(Graph)、创建会话(Session)和执行运算。

```python

# 定义两个变量

W = tf.Variable([[1.0]], tf.float32)

b = tf.Variable([[0.0]], tf.float32)

# 构建图

x = tf.placeholder(tf.float32)

linear_model = W * x + b

# 创建一个会话

with tf.Session() as sess:

# 初始化变量

sess.run(tf.global_variables_initializer())

# 执行线性模型

y = sess.run(linear_model, feed_dict={x: [[2.0]]})

print(y)

```

这里我们创建了变量W和b,并定义了一个线性模型。通过placeholder来提供输入数据x,并在会话中运行模型得到结果y。

### 3.2.2 高级API和封装

为了简化复杂模型的构建,TensorFlow提供了高级API,如tf.layers, tf.keras等,它们提供了更加简洁和面向对象的方式来构建深度学习模型。

```python

from tensorflow.keras import layers, models

# 构建一个简单的序列模型

model = models.Sequential()

model.add(layers.Dense(64, activation='relu', input_shape=(100,)))

model.add(layers.Dense(10, activation='softmax'))

# 编译模型

model.compile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

# 模型摘要

model.summary()

```

在这个例子中,我们使用Keras API快速构建了一个包含两个全连接层的神经网络模型,并进行了编译和摘要信息的输出。

## 3.3 TensorFlow的调试和优化

### 3.3.1 调试技巧

TensorFlow提供了多种调试技巧,包括TensorBoard可视化工具、断言节点(tf.Assert)、以及打印张量值等。

```python

# 使用TensorBoard进行可视化

with tf.Session() as sess:

# 添加一个断言节点,检查张量值是否满足条件

tf.Assert(tf.equal(tf.rank(W), 2), [W])

# 通过tf.summary.FileWriter记录运行数据

writer = tf.summary.FileWriter('./logs', sess.graph)

writer.close()

```

在这个例子中,我们通过断言节点来检查变量W的秩是否为2,这有助于防止维度不匹配导致的错误。

### 3.3.2 性能优化方法

性能优化主要涉及到代码层面的优化和系统层面的优化,包括使用高效的计算图优化、并行计算、以及利用特定硬件加速(如GPU和TPU)。

```python

# 利用GPU进行计算加速

device_name = '/device:GPU:0'

with tf.device(device_name):

# 创建一个在GPU上运行的常量张量

tensor = tf.constant([[1, 2], [3, 4]])

# 通过tf.device指定设备,确保操作在指定的设备上执行

with tf.Session() as sess:

print(sess.run(tensor))

```

通过代码中的tf.device指定,确保张量的创建和计算都发生在GPU上,从而利用GPU的并行计算能力加速TensorFlow程序的运行。

以上章节内容展示了TensorFlow的基本使用方法,覆盖了从基本概念到实际操作的各个方面,并对调试和优化做了简要说明,为读者提供了一个初步但完整的TensorFlow使用体验。

# 4. TensorFlow的深度学习模型部署

## 4.1 模型的训练和保存

### 4.1.1 模型训练

在深度学习项目的生命周期中,模型训练是核心环节。这通常涉及多个步骤:数据预处理、模型构建、训练过程和参数调整。

在TensorFlow中,使用`tf.keras`模块可以方便地构建、训练和评估模型。首先定义一个模型,通常采用序贯(Sequential)模型或函数式API来构建模型。然后,通过调用模型的`compile`方法配置训练过程中的参数,例如优化器、损失函数和评价指标。最后,使用`fit`方法进行模型训练。

例如,下面是一个简单的卷积神经网络(CNN)用于训练图像分类任务的代码示例:

```python

import tensorflow as tf

# 定义一个简单的CNN模型

model = tf.keras.models.Sequential([

tf.keras.layers.Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),

tf.keras.layers.MaxPooling2D((2, 2)),

tf.keras.layers.Flatten(),

tf.keras.layers.Dense(128, activation='relu'),

tf.keras.layers.Dense(10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

# 训练模型

model.fit(x_train, y_train, epochs=5)

```

在这段代码中,我们创建了一个卷积神经网络模型,对输入的28x28像素的灰度图像进行分类。模型包含一个卷积层、一个最大池化层、一个全连接层和一个输出层。`fit`方法用于训练模型,其中`epochs`参数指定了训练的轮数。

### 4.1.2 模型保存和加载

训练完毕后,模型需要被保存以便将来使用或部署。TensorFlow提供了`save`方法用于模型保存,模型的结构、权重、训练配置和优化器状态都会被保存下来。保存的格式可以是TensorFlow自身的格式(`.h5`)或TensorFlow Checkpoint格式(`.ckpt`)。

模型保存的代码示例如下:

```python

# 保存模型到文件系统

model.save('my_model.h5')

# 也可以保存为TensorFlow Checkpoint格式

model.save_weights('my_model_weights.ckpt')

```

加载模型则可以使用`load_model`方法,它能够还原模型结构、权重和训练配置:

```python

from tensorflow.keras.models import load_model

# 加载之前保存的模型

reloaded_model = load_model('my_model.h5')

# 加载权重

model.load_weights('my_model_weights.ckpt')

```

通过这种方式,我们可以方便地在不同阶段进行模型的训练、保存和部署。

## 4.2 模型的部署

### 4.2.1 模型转换和优化

在实际部署中,我们往往需要考虑模型的效率和兼容性。TensorFlow提供了模型转换工具如`tf.lite`将模型转换为移动和嵌入式设备上运行的轻量级格式。此外,模型优化工具`tf-optimize`可以进一步减小模型尺寸,加速推断速度。

模型转换的代码示例如下:

```python

converter = tf.lite.TFLiteConverter.from_keras_model(model)

tflite_model = converter.convert()

# 保存转换后的模型

with open('model.tflite', 'wb') as f:

f.write(tflite_model)

```

在这个例子中,我们使用了`TFLiteConverter`将训练好的Keras模型转换为TensorFlow Lite格式,然后保存为`.tflite`文件。

### 4.2.2 部署到服务器

部署到服务器通常涉及将模型集成到一个应用程序或服务中。这可以使用TensorFlow Serving来完成,TensorFlow Serving是一个灵活、高性能的模型服务器,支持热加载、动态模型更新等功能。

部署模型到服务器的简单步骤如下:

1. 使用`SavedModelBuilder`将训练好的模型保存为`SavedModel`格式。

2. 启动TensorFlow Serving服务,并指定模型的存储路径。

3. 客户端通过gRPC或REST API与TensorFlow Serving进行通信,发送推断请求。

示例代码:

```python

from tensorflow.python.saved_model import tag_constants, signature_constants

from tensorflow.python.saved_model.builder import SavedModelBuilder

# 保存为SavedModel格式

model_version = '1'

export_path = '/tmp/saved_model/' + model_version

builder = SavedModelBuilder(export_path)

builder.add_meta_graph_and_variables(

sess, [tag_constants.SERVING], signature_def_map={

'predict_images': tf.saved_model.signature_constants.DEFAULT_SERVING_SIGNATURE_DEF_KEY,

})

builder.save()

# 启动TensorFlow Serving

! tensorflow_model_server --port=9000 --model_name=my_model --model_base_path=/tmp/saved_model/

```

在这个例子中,我们首先使用`SavedModelBuilder`将模型保存为`SavedModel`格式,然后通过TensorFlow Model Server启动模型服务。

## 4.3 模型的监控和维护

### 4.3.1 模型监控

模型部署到生产环境后,监控模型性能变得尤为重要。TensorFlow Extended (TFX) 提供了一套工具用于监控模型的性能指标、数据质量、漂移等。通过这些工具可以确保模型的准确性和可靠性。

一个简单的模型监控流程包括:

1. 使用`tf.data`模块监控数据输入。

2. 使用TensorFlow的summary功能监控训练和推断过程。

3. 设置阈值和报警机制,及时发现性能下降。

### 4.3.2 模型更新和维护

随着时间的推移,模型可能会因为数据漂移等原因性能下降。TensorFlow提供了在线学习和定期更新的策略来维护模型的准确性。

在线学习可以实时更新模型,而定期更新则涉及到重新训练模型并用新的模型替代旧的模型。TensorFlow提供了`tf.keras`模型的保存和加载机制,可以用来实现定期更新流程。

```python

from tensorflow.keras.callbacks import ModelCheckpoint, EarlyStopping

# 训练过程中保存最佳模型

checkpoint = ModelCheckpoint(filepath='best_model.h5', save_best_only=True, monitor='val_loss')

early_stopping = EarlyStopping(monitor='val_loss', patience=3)

model.fit(x_train, y_train, epochs=50, callbacks=[checkpoint, early_stopping])

```

在这个例子中,`ModelCheckpoint`和`EarlyStopping`回调被用于在训练过程中监控验证集的损失,并保存最佳模型以及在损失不再改善时提前停止训练。

TensorFlow的深度学习模型部署是一个涉及多个环节的复杂过程,从模型的训练和保存到实际部署,再到监控和维护,每一步都需要精心设计和管理。通过使用TensorFlow提供的工具和最佳实践,可以有效地提升模型的部署效率和运行稳定性。

# 5. TensorFlow的实战应用

TensorFlow的实战应用是检验我们学习成果的试金石。在本章,我们将深入探讨两个主要的应用领域:图像识别和自然语言处理。通过分析这两个领域的基本流程和实际应用案例,我们能够了解如何将TensorFlow的理论知识转化为解决实际问题的强大工具。

## 5.1 图像识别应用

### 5.1.1 图像识别的基本流程

在开始具体的代码实践之前,让我们来梳理一下图像识别任务中的关键步骤。图像识别的基本流程可以分为数据准备、模型构建、训练、评估和应用这几个主要环节。

- **数据准备**:首先,我们需要准备相应的数据集,并对其进行预处理。预处理通常包括调整图片大小、归一化像素值、数据增强等。这一阶段为模型的训练奠定了基础。

- **模型构建**:构建模型是通过选择合适的网络架构来实现的。在图像识别领域,常用的架构有卷积神经网络(CNN)。我们将根据具体任务的需求来选择合适的模型。

- **训练模型**:有了数据和模型之后,我们需要使用训练数据来训练模型。在这一阶段,模型会通过前向传播和反向传播不断调整自身参数以减少损失函数的值。

- **评估模型**:训练完成后,我们会使用验证集来评估模型的性能,确保模型具有良好的泛化能力。

- **应用模型**:最后,将训练好的模型应用到实际问题中,对新的数据进行预测。

### 5.1.2 实际应用案例

下面,我们通过一个简单的图像识别案例来加深理解。在这个例子中,我们将使用TensorFlow构建一个简单的卷积神经网络来识别MNIST手写数字。

首先,导入必要的库并准备数据:

```python

import tensorflow as tf

from tensorflow.keras.datasets import mnist

from tensorflow.keras.utils import to_categorical

# 加载数据集

(train_images, train_labels), (test_images, test_labels) = mnist.load_data()

# 预处理数据

train_images = train_images.reshape((60000, 28, 28, 1)).astype('float32') / 255

test_images = test_images.reshape((10000, 28, 28, 1)).astype('float32') / 255

train_labels = to_categorical(train_labels)

test_labels = to_categorical(test_labels)

```

接下来,构建模型:

```python

from tensorflow.keras import layers, models

# 构建模型

model = models.Sequential([

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.Flatten(),

layers.Dense(64, activation='relu'),

layers.Dense(10, activation='softmax')

])

```

编译并训练模型:

```python

model.compile(optimizer='rmsprop',

loss='categorical_crossentropy',

metrics=['accuracy'])

model.fit(train_images, train_labels, epochs=5, batch_size=64)

```

评估模型性能:

```python

test_loss, test_acc = model.evaluate(test_images, test_labels)

print(f"Test accuracy: {test_acc}")

```

最后,我们使用训练好的模型对单张图像进行预测:

```python

from tensorflow.keras.preprocessing import image

# 加载一张图像进行预测

test_image = image.load_img('path_to_new_image.jpg', target_size=(28, 28), color_mode='grayscale')

test_image = image.img_to_array(test_image)

test_image = test_image.reshape(1, 28, 28, 1)

test_image = test_image.astype('float32') / 255

prediction = model.predict(test_image)

print(f"Predicted class: {prediction.argmax()}")

```

在这个案例中,我们经历了图像识别的所有步骤,从数据的加载和预处理,到模型的构建、训练、评估,再到最后的应用。通过此案例,我们能够直观地了解如何将TensorFlow用于图像识别任务。

接下来,我们将探讨另一个重要的应用领域——自然语言处理。

## 5.2 自然语言处理应用

### 5.2.1 自然语言处理的基本流程

自然语言处理(NLP)是计算机科学、人工智能和语言学领域的一个交叉学科,它关注于计算机和人类语言之间的交互。NLP的基本流程可以概括为以下几个步骤:

- **数据准备**:在NLP任务中,数据往往以文本形式存在。我们需要对原始文本进行预处理,比如分词、去除停用词、词性标注等。

- **文本向量化**:将文本转换为机器可以理解的形式,常见的方法包括词袋模型、TF-IDF和词嵌入等。

- **模型构建**:根据任务需求,选择合适的模型,如循环神经网络(RNN)、长短期记忆网络(LSTM)、Transformer等。

- **模型训练与评估**:使用训练数据对模型进行训练,并使用验证集对模型性能进行评估。

- **模型应用**:将训练好的模型用于实际的NLP任务,如文本分类、情感分析、机器翻译等。

### 5.2.2 实际应用案例

让我们以一个简单的文本分类任务来具体展示NLP应用。这个例子中,我们将使用TensorFlow来训练一个模型,用于区分电影评论的情感倾向(正面或负面)。

首先,我们导入必要的库,并准备数据:

```python

import numpy as np

from tensorflow.keras.preprocessing.text import Tokenizer

from tensorflow.keras.preprocessing.sequence import pad_sequences

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Embedding, LSTM, Dense

# 假设我们已经有了一个数据集

texts = [...] # 电影评论文本列表

labels = [...] # 对应的情感标签,1为正面,0为负面

# 文本分词

tokenizer = Tokenizer(num_words=20000)

tokenizer.fit_on_texts(texts)

sequences = tokenizer.texts_to_sequences(texts)

# 文本序列填充

data = pad_sequences(sequences, maxlen=200)

# 划分训练集和测试集

from sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test = train_test_split(data, labels, test_size=0.2)

```

构建模型:

```python

model = Sequential()

model.add(Embedding(20000, 128, input_length=200))

model.add(LSTM(64, dropout=0.2, recurrent_dropout=0.2))

model.add(Dense(1, activation='sigmoid'))

model.compile(optimizer='adam',

loss='binary_crossentropy',

metrics=['accuracy'])

```

训练模型:

```python

model.fit(X_train, y_train, batch_size=32, epochs=10, validation_split=0.1)

```

评估模型:

```python

loss, accuracy = model.evaluate(X_test, y_test)

print(f"Test accuracy: {accuracy}")

```

通过此案例,我们了解了如何利用TensorFlow来解决文本分类问题。从文本的预处理到模型训练和评估,我们展示了整个NLP任务的流程。

在本章中,我们通过图像识别和自然语言处理这两个实际案例,了解到TensorFlow在解决复杂问题时的强大功能和灵活性。这些实战应用不仅仅是展示代码和执行结果,更是对知识的深入理解与应用能力的培养。

通过下一章节,我们将进一步了解TensorFlow的高级技巧和优化方法,帮助我们更高效地使用TensorFlow完成更多高级任务。

# 6. TensorFlow的高级技巧和优化

在本章节中,我们将深入探讨TensorFlow框架中的高级技巧以及性能优化的策略。我们将从分布式训练开始,到性能优化的方法,最后介绍TensorFlow社区和推荐学习资源。本章节将帮助您在实际工作中更高效地使用TensorFlow,以及如何利用社区资源来进一步提升技能。

## 6.1 TensorFlow的分布式训练

### 6.1.1 分布式训练的基本概念

分布式训练是通过将训练过程分散到多个设备上进行以加速模型训练的技术。在TensorFlow中,我们可以将模型的计算分布在多台机器上,每台机器可能有多个GPU或CPU。这样可以充分利用硬件资源,缩短训练时间,同时处理更大的数据集或更复杂的模型。

TensorFlow提供了一套完整的工具来支持分布式训练,主要包括`tf.distribute.Strategy` API,它支持同步训练和异步训练等多种模式。

### 6.1.2 分布式训练的实现

TensorFlow允许使用不同的策略来实现分布式训练,其中最常用的是`MirroredStrategy`,它适用于多GPU单机训练。我们可以通过以下代码实现一个简单的分布式策略:

```python

strategy = tf.distribute.MirroredStrategy()

with strategy.scope():

# 创建模型和其他TensorFlow操作

model = tf.keras.Sequential([tf.keras.layers.Dense(num_classes) for _ in range(num_layers)])

loss_object = tf.keras.losses.SparseCategoricalCrossentropy()

optimizer = tf.keras.optimizers.Adam()

```

此外,对于多机分布式训练,`tf.distribute.Strategy`还支持`ParameterServerStrategy`和`MultiWorkerMirroredStrategy`等多种策略。这些策略允许用户在不同的物理或虚拟机上部署模型训练任务。

## 6.2 TensorFlow的性能优化

### 6.2.1 性能优化的基本方法

性能优化是任何机器学习项目中不可或缺的一部分。在TensorFlow中,可以采取多种措施来优化模型的性能:

- **利用高效的层和操作**:选择合适的层和操作能够显著提高计算效率。

- **减少内存占用**:通过减少不必要的数据拷贝、使用`inplace`操作等方法可以减少内存占用。

- **并行计算**:合理安排计算的并行性可以充分利用CPU和GPU资源。

- **减少计算量**:通过权重共享、简化模型结构等方式减少每步计算量。

### 6.2.2 性能优化的实际案例

在实际应用中,性能优化可能会涉及到对模型的细致调整。以下是一个简单的案例,展示如何通过调整模型结构来优化性能:

```python

# 原始模型

model = tf.keras.Sequential([

tf.keras.layers.Flatten(input_shape=(28, 28)),

tf.keras.layers.Dense(128, activation='relu'),

tf.keras.layers.Dense(10, activation='softmax')

])

# 优化后的模型

model_optimized = tf.keras.Sequential([

tf.keras.layers.Flatten(input_shape=(28, 28)),

tf.keras.layers.Dense(64, activation='relu'),

tf.keras.layers.Dropout(0.2),

tf.keras.layers.Dense(10, activation='softmax')

])

```

在这个例子中,我们将第二层神经元的数量减少到64,并且加入了一个Dropout层来减少过拟合。这样的改动可以提高模型的训练速度,同时可能提升模型的泛化能力。

## 6.3 TensorFlow的社区和资源

### 6.3.1 TensorFlow社区介绍

TensorFlow拥有一个活跃的开发者和用户社区。在社区中,开发者们可以分享最新的研究成果、性能优化技巧以及解决遇到的问题。以下是社区中一些重要的资源:

- **TensorFlow论坛**:一个用于提问和解答问题的地方,对于初学者和经验丰富的开发者都很有用。

- **TensorFlow博客**:定期发布关于新特性和技术文章的官方博客。

- **GitHub**:TensorFlow的源代码以及社区贡献的代码都在这里维护。

### 6.3.2 学习资源推荐

为了帮助开发者深入学习TensorFlow,社区中也提供了很多高质量的学习资源,包括但不限于:

- **官方文档**:包含完整的API参考和教程,是学习TensorFlow不可或缺的资源。

- **在线课程和教程**:如Coursera和edX上的TensorFlow专项课程,适合系统学习。

- **技术博客和视频**:来自经验丰富的开发者,覆盖从基础到高级的TensorFlow使用技巧。

通过这些资源,您可以不断更新和加深对TensorFlow的理解,同时与全球范围内的TensorFlow用户互动,共同提高技能。

在下一章节中,我们将进入TensorFlow的实战应用领域,深入探讨如何使用TensorFlow进行图像识别和自然语言处理。这将为读者提供将理论知识应用于实际问题的宝贵经验。

0

0