:提升数据库并发能力:Doris数据库的并发控制机制

发布时间: 2024-07-17 03:12:47 阅读量: 109 订阅数: 66

MPP数据库 doris 使用

# 1. 数据库并发控制概述

数据库并发控制是数据库管理系统中一项重要的技术,用于管理和协调多个用户同时访问和修改数据库中的数据。它旨在确保数据的一致性、完整性和隔离性,防止并发访问带来的数据错误和混乱。

并发控制机制通过锁机制和事务机制来实现。锁机制通过对数据对象加锁,防止其他用户同时修改或删除数据。事务机制则通过原子性、一致性、隔离性和持久性(ACID)特性,确保数据库操作的正确性和完整性。

# 2. Doris数据库的并发控制机制

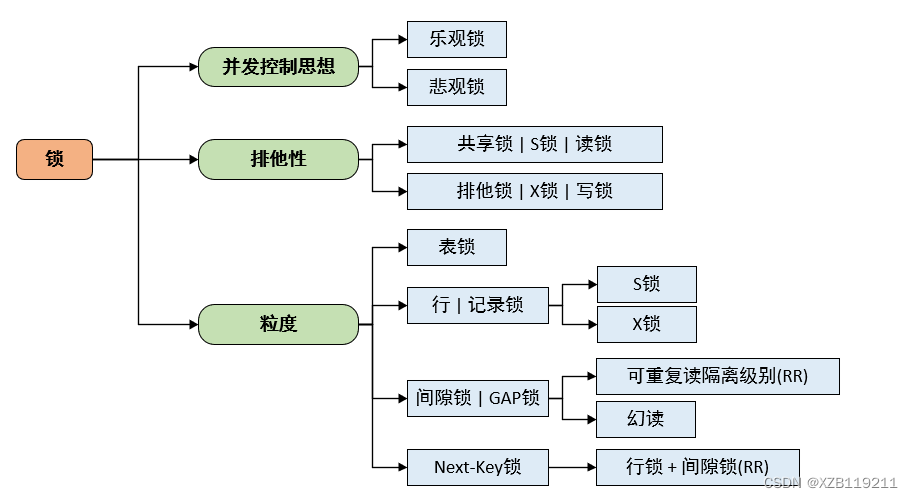

### 2.1 Doris数据库的锁机制

#### 2.1.1 乐观锁和悲观锁

乐观锁和悲观锁是两种不同的并发控制机制,用于解决并发访问数据时可能产生的数据一致性问题。

* **乐观锁:**乐观锁假设在并发访问时,数据不会被其他事务修改。它在事务提交时才对数据进行检查,如果发现数据被修改,则回滚事务。乐观锁的优点是并发性高,但可能会出现数据不一致的情况。

* **悲观锁:**悲观锁假设在并发访问时,数据可能会被其他事务修改。它在事务开始时就对数据进行加锁,防止其他事务修改数据。悲观锁的优点是数据一致性高,但可能会降低并发性。

#### 2.1.2 Doris数据库的锁类型和粒度

Doris数据库支持多种锁类型和粒度,以满足不同的并发控制需求。

**锁类型:**

* **共享锁(S锁):**允许其他事务同时读数据,但不能修改数据。

* **排他锁(X锁):**不允许其他事务同时读或修改数据。

**锁粒度:**

* **表锁:**对整个表加锁,粒度最大,并发性最低。

* **分区锁:**对表中的一个或多个分区加锁,粒度比表锁小,并发性更高。

* **行锁:**对表中的特定行加锁,粒度最小,并发性最高。

Doris数据库默认使用行锁,以最大限度地提高并发性。

### 2.2 Doris数据库的事务机制

#### 2.2.1 事务的特性和隔离级别

事务是数据库中的一组原子操作,要么全部成功,要么全部失败。事务具有以下特性:

* **原子性:**事务中的所有操作要么全部成功,要么全部失败。

* **一致性:**事务执行后,数据库必须处于一致状态。

* **隔离性:**并发执行的事务彼此独立,不会相互影响。

* **持久性:**一旦事务提交,其对数据库的修改将永久保存。

Doris数据库支持多种隔离级别,以满足不同的数据一致性需求:

* **读未提交(READ UNCOMMITTED):**事务可以读取其他事务未提交的数据,数据一致性最低。

* **读已提交(READ COMMITTED):**事务只能读取其他事务已提交的数据,数据一致性较高。

* **可重复读(REPEATABLE READ):**事务在执行过程中,其他事务不能修改事务读取的数据,数据一致性最高。

* **串行化(SERIALIZABLE):**事务执行的顺序与串行执行相同,数据一致性最高,但并发性最低。

#### 2.2.2 Doris数据库的事务实现

Doris数据库使用多版本并发控制(MVCC)机制来实现事务。MVCC通过保存数据的历史版本来解决并发访问数据时可能产生的数据一致性问题。

当一个事务读取数据时,它将读取数据的一个历史版本,该版本是事务开始时的数据快照。即使其他事务在事务读取数据后修改了数据,事务仍然可以读取到修改前的版本,从而保证了数据一致性。

### 2.3 Doris数据库的并发控制优化

#### 2.3.1 索引优化

索引是数据库中的一种数据结构,用于快速查找数据。通过创建适当的索引,可以显著提高并发查询的性能。

Doris数据库支持多种索引类型,包括:

* **B+树索引:**一种平衡树索引,用于快速查找数据。

* **位图索引:**一种用于快速查找具有特定值的列的索引。

* **布隆过滤器索引:**一种用于快速过滤不匹配数据的索引。

#### 2.3.2 分区优化

分区是将数据表划分为多个较小的部分的过程。通过分区,可以将并发访问的数据分布到不同的服务器上,从而提高并发性。

Doris数据库支持两种分区类型:

* **范围分区:**将数据表根据某个列的值范围划分为多个分区。

* **哈希分区:**将数据表根据某个列的值哈希值划分为多个分区。

# 3. Doris数据库并发控制机制实践

### 3.1 Doris数据库并发控制机制的配置和调优

#### 3.1.1 锁机制的配置和调优

**锁类型配置**

Doris数据库支持多种锁类型,包括:

- **行锁:**对单

0

0