处理大规模数据清洗时的性能优化探讨

发布时间: 2024-04-16 11:58:56 阅读量: 8 订阅数: 19

# 1. 背景介绍

数据清洗在数据处理过程中扮演着至关重要的角色。通过清洗数据,可以提高数据的质量,使得后续的分析和挖掘工作更加准确和可靠。实际应用中,数据常常会受到各种干扰因素的影响,如数据缺失、重复、不一致等,因此需要进行有效的清洗处理。与此同时,性能优化也是数据处理中不可或缺的一环,可以显著提升数据处理的效率和速度。通过合理的性能优化策略,不仅可以节省时间成本,还可以提升工作效率,使得数据处理更加高效和流畅。因此,深入探讨数据清洗和性能优化的重要性和作用,对于数据处理工作具有重要的指导意义。

# 2. 大规模数据清洗的挑战

### 2.1 数据量和数据多样性

在处理大规模数据清洗时,首先需要定义“大规模数据”是指数据量达到TB甚至PB级别的海量数据。这些数据来源广泛,包括结构化数据、半结构化数据和非结构化数据,而数据多样性给清洗带来挑战。

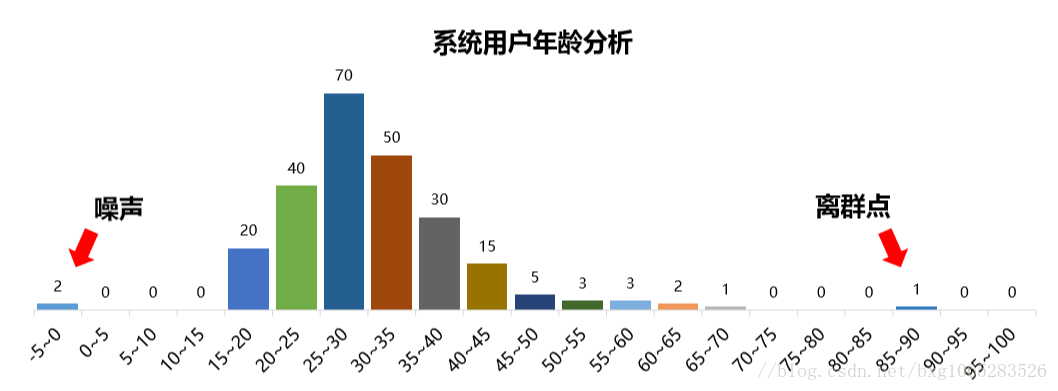

数据多样性对清洗的影响体现在数据类型的复杂性,比如文本数据、图像数据、时间序列数据等,每种数据类型都需要不同的处理方式,增加了清洗的难度。此外,数据的分布和质量也可能不均匀,导致清洗过程中需要处理各种异常情况。

### 2.2 数据清洗的算法复杂度

常见的数据清洗算法包括去重、缺失值填充、异常值处理、规范化等。这些算法的复杂度与数据规模密切相关,随着数据量的增加,清洗算法的执行时间也会增加。算法的时间复杂度和空间复杂度都会对性能产生影响。

以去重算法为例,如果使用遍历比较的方式,时间复杂度为O(n^2),当数据量很大时,执行时间会非常长。而对于缺失值填充这类涉及多列数据关联的算法,会涉及到更多的计算和内存开销。

#### 2.2.1 常见的数据清洗算法

- 去重算法:

```python

def deduplication(data):

unique_data = set()

for row in data:

unique_data.add(row)

return list(unique_data)

```

- 缺失值填充算法:

```python

def fill_missing_values(data):

for column in data.columns:

data[column].fillna(data[column].mean(), inplace=True)

```

#### 2.2.2 算法复杂度与数据规模的关系

算法复杂度通过分析执行时间与数据量之间的关系来衡量。常见算法如去重,随着数据量增加,执行时间呈平方级增长。

#### 2.2.3 数据清洗中的瓶颈问题

数据清洗中的瓶颈问题通常出现在处理大规模数据时,包括算法效率、计算资源、内存管理等方面。这些问题需要通过性能优化策略来解决,以提高数据清洗的效率和质量。

# 3. 性能优化策略探讨

在大规模数据处理中,性能优化策略对于提高数据清洗效率至关重要。本章将探讨数据预处理、并行计算、内存管理等策略,以及它们在性能优化中的作用。

#### 3.1 数据预处理与分布式计算

数据预处理是数据清洗过程中的关键环节,通过提前处理数据可以减少后续清洗的工作量。同时,采用分布式计算对大规模数据集进行处理可以提高处理速度,显著提高效率。

- 数据预处理的重要性

数据预处理包括数据清洗、去重、缺失值填充等操作,其目的是减少待处理数据中的噪音和冗余信息,为

0

0