时序数据分析中的注意力机制:挖掘序列数据隐藏规律的利器

发布时间: 2024-08-20 23:41:56 阅读量: 65 订阅数: 50

Attention(注意力机制代码)

# 1. 时序数据分析基础

时序数据是指按时间顺序排列的数据,具有以下特点:

- **时间依赖性:**数据点之间的顺序和时间间隔对于分析至关重要。

- **动态变化:**数据随着时间的推移而不断变化,呈现出趋势、周期性和异常值。

- **高维度:**时序数据通常包含多个时间序列,每个序列都可能具有不同的长度和采样率。

时序数据分析的目标是提取有意义的模式和见解,以进行预测、异常检测和可视化。常用的分析方法包括:

- **滑动窗口:**将数据划分为固定长度的窗口,并对每个窗口进行分析。

- **时间序列分解:**将时序数据分解为趋势、季节性和残差分量。

- **机器学习:**使用机器学习算法对时序数据进行建模和预测。

# 2. 注意力机制在时序数据分析中的应用

注意力机制是一种神经网络技术,它允许模型专注于输入序列中的特定部分。在时序数据分析中,注意力机制已被证明可以有效地捕捉序列数据中的长期依赖关系并增强时序预测的准确性。

### 2.1 注意力机制的原理和类型

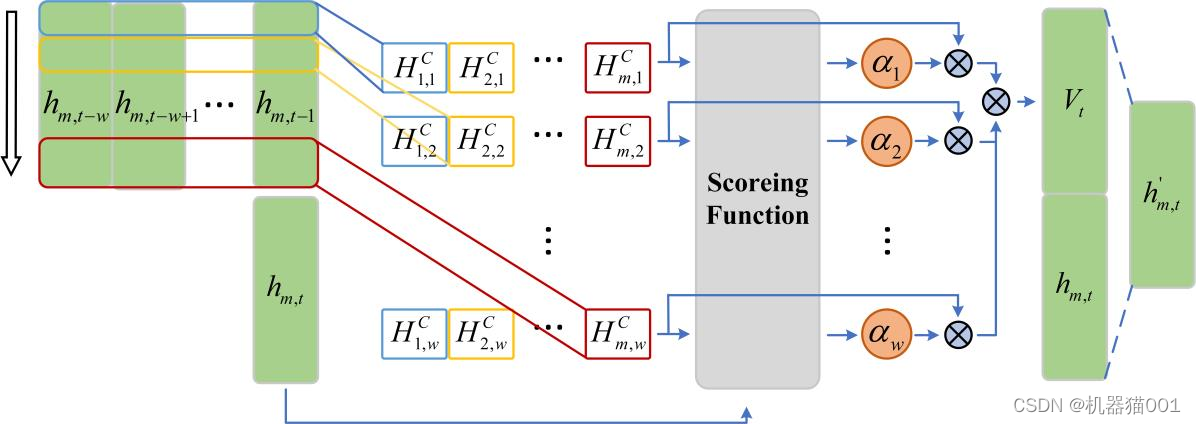

注意力机制的基本原理是为每个输入元素分配一个权重,这些权重表示该元素对输出的重要性。通过对输入元素的加权和,注意力机制可以生成一个上下文向量,该向量包含输入序列中最重要的信息的摘要。

有两种主要的注意力机制类型:

#### 2.1.1 自注意力机制

自注意力机制将输入序列本身作为查询和键值对。它计算每个输入元素与所有其他输入元素之间的相似度,然后使用这些相似度来分配权重。自注意力机制对于捕捉序列数据中的长期依赖关系特别有效。

#### 2.1.2 编码器-解码器注意力机制

编码器-解码器注意力机制用于将一个序列翻译成另一个序列。编码器将输入序列编码成一个固定长度的向量,而解码器使用注意力机制来选择编码器输出中的相关部分以生成输出序列。

### 2.2 注意力机制在时序数据分析中的优势

注意力机制在时序数据分析中具有以下优势:

#### 2.2.1 捕捉序列数据中的长期依赖关系

时序数据通常具有长期依赖关系,这意味着序列中的元素可能会影响远处的其他元素。注意力机制可以通过为序列中的每个元素分配一个权重来捕捉这些长期依赖关系,从而使模型能够学习序列中最重要的部分。

#### 2.2.2 增强时序预测的准确性

通过捕捉序列数据中的长期依赖关系,注意力机制可以增强时序预测的准确性。注意力机制使模型能够专注于序列中最重要的部分,从而做出更准确的预测。

# 3. 时序数据分析中的注意力机制实践

### 3.1 基于自注意力机制的时序预测模型

#### 3.1.1 模型结构和训练过程

自注意力机制的时序预测模型通常采用 Transformer 架构,该架构由编码器和解码器组成。编码器负责将输入时序数据转换为一个中间表示,而解码器则利用该表示进行预测。

**编码器**

编码器由多个自注意力层堆叠而成。每个自注意力层包含两个子层:

1. **自注意力子层:**计算输入序列中每个元素与其他所有元素之间的注意力权重。这些权重用于加权求和输入序列,生成一个新的表示。

2. **前馈子层:**将自注意力子层的输出通过一个前馈神经网络,产生一个新的表示。

**解码器**

解码

0

0