【从Stream到Collectors】:掌握Guava的集合转换之美

发布时间: 2024-09-26 11:44:06 阅读量: 76 订阅数: 27

java8-guava-comparation:Guava 和 Java 8 Stream API 的比较

# 1. Guava集合处理框架概述

## 1.1 Guava的起源与重要性

Guava是由Google开发的一款开源的Java库,它提供了丰富的集合处理工具,能够简化常见的Java编程任务,从而提高开发效率。在处理集合数据时,Guava提供了一系列便捷的方法和抽象,使开发者可以以更简洁的方式完成复杂的集合操作。

## 1.2 Guava集合框架的特点

Guava集合框架的核心特点是简化了集合操作,提供了包括但不限于集合的创建、转换和过滤等多种实用工具。它还包括了对并发集合的支持,提供了一套强大的不可变集合API,极大地降低了在多线程环境下对集合操作的复杂性。

## 1.3 Guava在现代Java开发中的应用

随着Java版本的迭代,Guava库补充了标准库中尚未实现的一些功能,比如Guava的Optional类用于更好的处理空值问题,以及Multimap、Table等集合类型提供了多数据源管理的便利。在实际的项目开发中,Guava的这些特性可以帮助开发者构建出更健壮、可维护性更强的应用程序。

# 2. Stream的基本理论与实践

## 2.1 Stream的核心概念和构建

### 2.1.1 Stream的定义和特性

Stream 是 Java 8 引入的一个新的抽象层,用于处理数据集合。它可以对集合进行声明式的操作,使用函数式编程风格,从而让代码更简洁、更易于阅读。Stream 不是集合,它没有存储数据的结构,而是对数据的处理和计算,可以看作是一个高级的迭代器。

Stream 的主要特性包括:

- **不可变性**:一旦创建了 Stream,就无法修改其内部状态。

- **延迟执行**:大多数 Stream 操作都是延迟执行的,这意味着它们会在实际需要结果时才执行。

- **函数式编程**:Stream 支持函数式编程范式,允许以声明式方式操作数据,而不需要编写复杂的循环和条件语句。

- **管道化**:多个操作可以链接起来形成一个流水线,每个操作都会返回一个新的 Stream,使得多个操作可以连接起来。

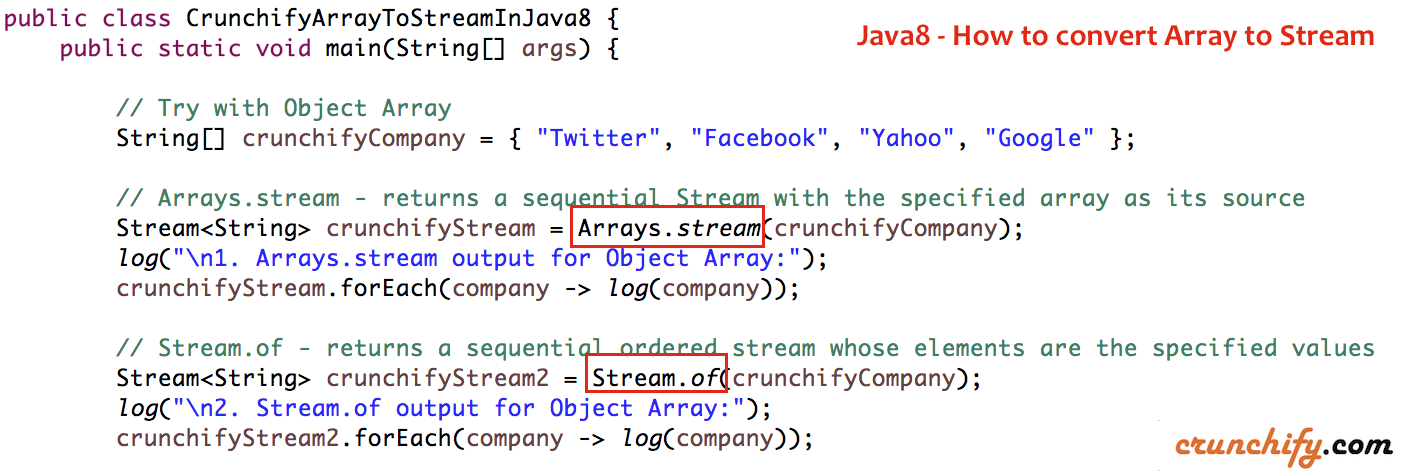

### 2.1.2 创建Stream的方法

创建 Stream 可以使用多种方式,最常见的是通过集合、数组或者特定的 Stream 类方法。下面是一些创建 Stream 的常用方法:

- **集合的 stream 方法**:通过调用集合类(如 List 或 Set)的 `stream()` 方法来创建流。

```java

List<String> list = Arrays.asList("a", "b", "c");

Stream<String> stream = list.stream();

```

- **数组的 Stream.of 方法**:使用 `Stream.of()` 方法从数组创建一个流。

```java

String[] array = {"a", "b", "c"};

Stream<String> stream = Stream.of(array);

```

- **静态的 Stream.generate 和 Stream.iterate 方法**:这两个方法可以创建一个无限流,`generate` 方法接受一个供应函数来不断产生新的元素,而 `iterate` 方法从一个初始值开始,应用一个函数来产生新的值。

```java

Stream<Double> randomStream = Stream.generate(Math::random);

Stream<Integer> evenStream = Stream.iterate(0, n -> n + 2);

```

- **IntStream、LongStream、DoubleStream 的范围和数值流**:这些特定类型的流用于表示原始数据类型流,并提供了额外的专门方法。

```java

IntStream range = IntStream.range(1, 10);

LongStream longStream = LongStream.rangeClosed(1, 10);

```

## 2.2 Stream的操作类型和使用

### 2.2.1 中间操作:filter、map、flatMap

中间操作是 Stream API 中用于转换和过滤数据流的方法,它们总是返回一个新的 Stream,可以链接起来形成一个流水线。常见的中间操作包括 `filter`、`map` 和 `flatMap`。

- **filter**:根据给定的谓词(一个返回布尔值的函数)筛选流中的元素。

```java

Stream<String> filtered = stream.filter(s -> s.startsWith("a"));

```

- **map**:将流中的每个元素映射到对应的值,它会应用一个函数并返回应用后的结果。

```java

Stream<Integer> mapped = stream.map(String::length);

```

- **flatMap**:将流中的每个元素转换成另一个流,然后将所有流连接到一个流中。

```java

Stream<List<String>> streamOfLists = Arrays.asList(someLists);

Stream<String> flatStream = streamOfLists.flatMap(List::stream);

```

### 2.2.2 终端操作:reduce、collect、forEach

终端操作是 Stream API 中用于处理流并产生结果的方法。这些方法执行实际的数据处理,例如聚合、收集到容器中或执行某个操作。常见的终端操作有 `reduce`、`collect` 和 `forEach`。

- **reduce**:对流中的元素进行累积操作,可以是求和、求最大值等。

```java

Optional<Integer> sum = stream.reduce((a, b) -> a + b);

```

- **collect**:将流中的元素收集到一个集合中,可以使用 Collector 提供的收集器(如 toList、toSet、groupingBy 等)。

```java

List<String> collected = stream.collect(Collectors.toList());

```

- **forEach**:对流中的每个元素执行给定的操作。

```java

stream.forEach(System.out::println);

```

### 2.2.3 短路操作:anyMatch、allMatch、noneMatch

短路操作是指,一旦结果可以确定,就不会继续处理流中剩余的元素。这样可以提高处理效率。常见的短路操作有 `anyMatch`、`allMatch` 和 `noneMatch`。

- **anyMatch**:检查至少有一个元素满足特定条件。

```java

boolean anyMatch = stream.anyMatch(s -> s.contains("a"));

```

- **allMatch**:检查所有元素都满足特定条件。

```java

boolean allMatch = stream.allMatch(String::isEmpty);

```

- **noneMatch**:检查没有任何元素满足特定条件。

```java

boolean noneMatch = stream.noneMatch(s -> s.contains("z"));

```

## 2.3 Stream的性能优化

### 2.3.1 惰性求值与即时求值

Stream 的操作有两种主要的求值方式:惰性求值和即时求值。了解这两种求值方式对于优化 Stream 性能至关重要。

- **惰性求值**:只有在实际需要结果时才进行计算。中间操作通常是惰性求值的,只有在终端操作调用时,中间操作才会执行。

- **即时求值**:一旦数据源可用,就开始执行操作并产生结果。`forEach` 和 `reduce` 等终端操作就是即时求值的。

```java

Stream<String> stream = list.stream();

stream.filter(s -> {

System.out.println(" Filtering " + s);

return s.startsWith("a");

}).map(s -> {

System.out.println(" Mapping " + s);

return s.toUpperCase();

}).forEach(s -> System.out.println(" ForEach " + s));

```

在上面的例子中,中间操作 filter 和 map 都是惰性求值的,只有当执行了 forEach 这个终端操作时,所有操作才会实际执行。

### 2.3.2 并行流的创建与注意事项

并行流可以利用多核处理器的性能,通过并行化操作来加速处理。在创建并行流时,可以使用 `parallelStream()` 方法,或者在常规流上调用 `.parallel()` 方法。

```java

Stream<String> parallelStream = list.parallelStream();

```

或者

```java

Stream<String> stream = list.stream();

Stream<String> parallelStream = stream.parallel();

```

然而,并行流并不总是最优选择。并行处理会带来上下文切换和线程管理的开销,特别是在处理小数据集或简单操作时,可能比串行流更慢。在使用并行流时需要注意以下几点:

- 尽量使用无副作用的函数:避免在流操作中使用共享状态,这可以防止并发问题。

- 尽量避免不必要的对象创建:每次对象创建都会带来垃圾回收的压力。

- 考虑数据的分割和合并开销:并行流需要将数据分割到不同的线程上,然后合并结果,这个过程是有成本的。

- 使用合适的线程数:Java 的默认线程数可能不适合所有场景,有时候自定义线程池可以提高性能。

```java

// 使用并行流进行数据处理,同时自定义线程池

ExecutorService executorService = Executors.newFixedThreadPool(4);

Stream<String> stream = list.parallelStream();

Stream<String> processedStream = stream.parallel().unordered().map(...);

List<String> result = processedStream.collect(Collectors.toList());

```

在上述示例中,通过 `unordered()` 方法提升并行处理的性能,然后通过自定义的线程池来控制并行流的执行。需要注意,对于具体的业务场景和硬件环境,最佳实践可能有所不同,因此在实施并行流时应进行充分的性能测试。

# 3. 深入Collectors的原理和应用

## 3.1 Collectors的分类和功能

### 3.1.1 分类概述:归约、分组、分区

Collectors是Java 8引入的一个强大的工具类,它提供了许多便捷的方法来进行数据收集,主要可以分为三大类:归约、分组、分区。

**归约(Reduction)** 操作可以将流中的元素组合起来,生成一个单一的结果。例如,我们可以使用归约来获取流中的最小值、最大值、总和或平均值。

**分组(Grouping)** 是按照某些标准将元素分到不同的组中。这种操作非常适合分类任务,例如按部门或按性别分组。

**分区(Partitioning)** 类似于分组,但是它只使用一个条件来判断元素属于两个分区中的哪一个,分区通常返回一个Map,其键为Boolean类型,表示条件是否满足,值为对应的分组。

### 3.1.2 常用Collectors的介绍

为了更深入地理解Collectors,我们可以看看几个常用的静态方法:

- `Collectors.toList()`:将流中的元素收集到一个List中。

- `Collectors.toSet()`:将流中的元素收集到一个Set中,帮助去除重复项。

- `Collectors.toMap()`:创建一个映射,以键为一个函数,以值为另一个函数的结果。

- `Collectors.counting()`:计算流中的元素数量。

- `Collectors.summingInt()`、`Collectors.summingLong()`、`Collectors.summingDouble()`:计算流中的元素对应整数、长整数或双精度浮点数的总和。

- `Collectors.averagingInt()`、`Collectors.averagingLong()`、`Collectors.averagingDouble()`:计算流中的元素对应类型数值的平均值。

这些收集器可以相互结合使用,以实现更复杂的数据收集任务。下面章节将深入探讨如何实现自定义Collectors,并分享一些高级收集技巧。

## 3.2 实现自定义Collectors

### 3.2.1 自定义收集器的设计步骤

自定义Collectors需要遵循一定的设计模式。通常,这涉及到实现`java.util.stream.Collector`接口。接口中的关键方法如下:

```java

public interface Collector<T, A, R> {

Supplier<A> supplier();

BiConsumer<A, T> accumulator();

BinaryOperator<A> combiner();

Function<A, R> finisher();

Set<Characteristics> characteristics();

// ...

}

```

- **Supplier<A> supplier()**:创建一个新的结果容器,比如用于收集数据的List或Map。

- **BiConsumer<A, T> accumulator()**:在结果容器中添加单个元素,例如将元素添加到List或Map中。

- **BinaryOperator<A> combiner()**:在并行处理时合并两个结果容器。

- **Function<A, R> finisher()**:转换结果容器为最终结果类型,例如将List转换为Set。

- **Set<Characteristics> characteristics()**:提供关于收集器特性的一些附加信息,如是否并行处理、是否无序等。

### 3.2.2 实践案例分析

假设我们需要实现一个收集器来计算一个字符串列表中每个单词的出现频率。下面是一个简单的实现示例:

```java

import java.util.*;

import java.util.function.BiConsumer;

import java.util.function.BinaryOperator;

import java.util.function.Function;

import java.util.function.Supplier;

import java.util.stream.Collector;

public class FrequencyCollector implements Collector<String, Map<String, Long>, Map<String, Long>> {

@Override

public Supplier<Map<String, Long>> supplier() {

return HashMap::new;

}

@Override

public BiConsumer<Map<String, Long>, String> accumulator() {

return (map, word) -> map.merge(word, 1L, Long::sum);

}

@Override

public BinaryOperator<Map<String, Long>> combiner() {

return (map1, map2) -> {

map1.putAll(map2);

return map1;

};

}

@Override

public Function<Map<String, Long>, Map<String, Long>> finisher() {

return Function.identity();

}

@Override

public Set<Characteristics> characteristics() {

return Collections.unmodifiableSet(EnumSet.of(Characteristics.IDENTITY_FINISH));

}

public static void main(String[] args) {

List<String> words = Arrays.asList("apple", "banana", "apple", "orange", "banana", "apple");

Map<String, Long> wordCounts = words.stream()

.collect(new FrequencyCollector());

System.out.println(wordCounts);

}

}

```

在上面的代码中,`FrequencyCollector`通过实现Collector接口的方法定义了如何将字符串流中的单词收集到Map中,并且计算它们的频率。

## 3.3 高级收集技巧

### 3.3.1 与Stream API的结合使用

当我们在处理复杂的数据结构时,往往需要将Collectors与Stream API的其他部分结合起来使用。例如,我们可以使用`map`和`collect`结合

0

0