【gdata库与机器学习】:将Google Data API数据用于机器学习模型训练

发布时间: 2024-10-14 15:48:24 阅读量: 23 订阅数: 33

GData-Backup:从Google服务备份数据的工具

# 1. gdata库和机器学习概述

## 1.1 机器学习简介

机器学习是一门多领域交叉学科,它通过算法使计算机能够从数据中学习并做出决策或预测。机器学习的核心在于构建模型,这些模型能够基于输入数据进行自我优化和改进。随着数据量的爆炸式增长,机器学习在各个行业中的应用变得越来越广泛,从图像识别到语音识别,再到推荐系统和自然语言处理。

## 1.2 gdata库概述

gdata库是一个Python库,它提供了一种简单的方式来访问和解析Google Data API返回的数据。这个库可以帮助开发者从各种Google服务中获取数据,例如Google Calendar、Google Contacts、Google Spreadsheets等。在机器学习领域,gdata库可以用来自动化数据获取过程,为数据预处理和特征工程提供便利。

## 1.3 gdata库和机器学习的结合

将gdata库与机器学习相结合,可以极大地简化数据获取和预处理的步骤。通过编程方式访问Google服务中的数据,可以实现高效的数据集成和处理,为构建和训练机器学习模型提供强大的数据支持。这种结合为解决复杂的实际问题提供了新的可能性。

# 2. Google Data API和gdata库的基础知识

## 2.1 Google Data API概述

### 2.1.1 API的工作原理

Google Data API是一种允许开发者通过HTTP请求访问Google应用程序数据的网络服务。这些API利用RESTful的设计原则,使得开发者可以在不同的平台上以多种编程语言与Google的服务进行交互。API的工作原理基于标准的HTTP请求和响应机制,开发者通过发送GET、POST等HTTP请求到API的端点(Endpoint),以此来读取、更新、创建或删除数据。

### 2.1.2 API的主要类型和特点

Google提供了多种类型的Data API,包括但不限于Google Calendar API、Google Contacts API、Google Docs API等。每种API都有其特定的用途和特点,但它们共享一些共同的特点:

- **统一的认证机制**:Google Data API通常使用OAuth 2.0进行用户认证,这是一种简单且广泛接受的安全机制。

- **标准化的数据格式**:大多数API使用Atom Publishing Protocol或GData XML格式来表示数据,这些格式易于理解和实现。

- **灵活的数据访问**:API支持对数据的CRUD(创建、读取、更新、删除)操作,使得开发者可以灵活地管理数据。

## 2.2 gdata库的安装和配置

### 2.2.1 gdata库的安装

gdata库是一个Python库,用于访问和解析Google Data API的数据。要安装gdata库,可以使用Python的包管理工具pip进行安装:

```bash

pip install gdata

```

### 2.2.2 gdata库的配置和使用

gdata库的配置通常涉及到认证和设置API端点。以下是一个简单的示例代码,展示了如何使用gdata库访问Google Calendar API:

```python

import gdata.calendar.service

# 初始化Calendar服务对象

service = gdata.calendar.service.CalendarService()

# 认证并授权,这里需要替换为你的OAuth 2.0凭据

service.ClientLogin('your_***', 'your_password', 'Calendar API')

# 获取日历列表

feed = service.GetCalendarListFeed()

for entry in feed.entry:

print(entry.title.text)

```

### 2.3 gdata库的基本操作

#### 2.3.1 数据获取

使用gdata库可以轻松地获取和解析Google Data API的数据。例如,要获取Google Calendar中的事件,可以使用以下代码:

```python

# 获取特定日历中的事件

feed = service.GetEventsFeed('primary')

for entry in feed.entry:

print(entry.title.text, entry Where)

```

#### 2.3.2 数据解析

gdata库提供了一套XML解析工具,可以将Google Data API的XML数据转换为Python对象。例如,解析上面获取的事件:

```python

import gdata.calendar.model

# 将XML转换为Event对象

events = [gdata.calendar.model.Event.FromFeedEntry(entry) for entry in feed.entry]

# 打印事件详情

for event in events:

print(event.title.text, event Where, event.start.date, event.end.date)

```

在本章节中,我们介绍了Google Data API的基本概念和工作原理,以及如何安装和配置gdata库。通过具体的代码示例,我们展示了如何使用gdata库进行数据获取和解析。这些基础知识为后续章节中gdata库在机器学习中的应用奠定了基础。

# 3. gdata库在机器学习中的应用

在本章节中,我们将深入探讨gdata库在机器学习领域的具体应用,包括数据预处理、特征工程和模型评估等方面。通过本章节的介绍,您将了解到如何利用gdata库进行高效的数据处理,以及它在构建机器学习模型时所能提供的支持。

## 3.1 gdata库与数据预处理

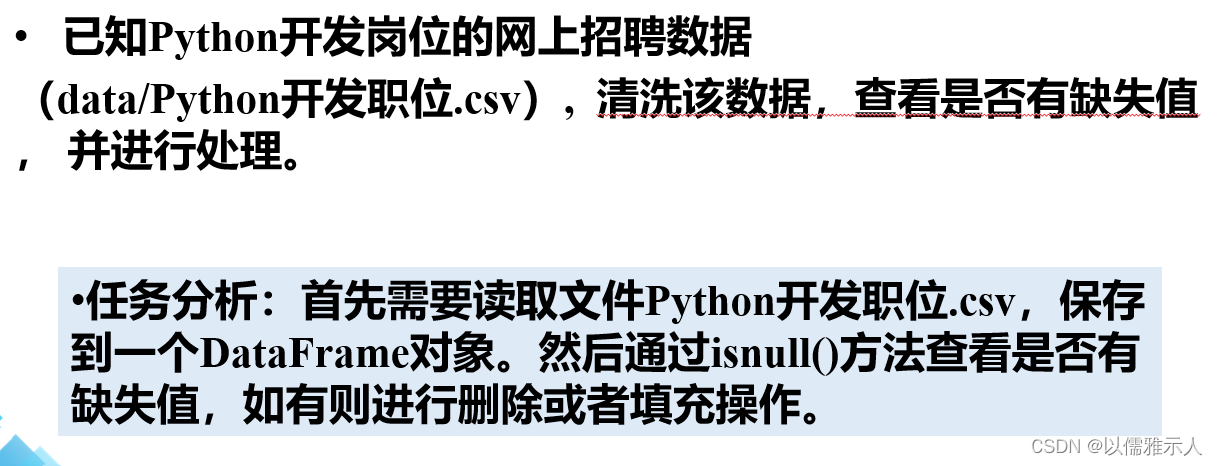

### 3.1.1 数据清洗

在机器学习项目中,数据清洗是一个至关重要的步骤。gdata库提供了多种工具和方法来帮助我们进行数据清洗,包括但不限于删除缺失值、填充缺失值、异常值检测和处理等。

```python

from gdata.service import atom

import pandas as pd

# 假设我们有一个AtomFeed对象,名为feed

feed = atom.AtomFeed(url='***', ...)

# 将AtomFeed转换为DataFrame

df = pd.DataFrame(feed.entry)

# 检查缺失值

print(df.isnull().sum())

# 删除包含缺失值的行

df_cleaned = df.dropna()

# 填充缺失值,例如用0填充

df_filled = df.fillna(0)

```

在上述代码中,我们首先将AtomFeed对象转换为Pandas的DataFrame,然后检查缺失值,并使用`dropna`和`fillna`方法进行数据清洗。

### 3.1.2 数据转换

数据转换是指将原始数据转换为适合机器学习模型使用的格式。这可能包括标准化、归一化、二值化等操作。gdata库本身不提供直接的数据转换功能,但我们可以结合Pandas和其他库进行这些操作。

```python

from sklearn.preprocessing import StandardScaler

# 假设df_cleaned是我们已经清洗过的数据

# 创建标准化对象

scaler = StandardScaler()

# 对特征进行标准化

df_scaled = scaler.fit_transform(df_cleaned.drop('label', axis=1))

```

在这段代码中,我们使用了`sklearn.preprocessing.StandardScaler`来对数据进行标准化处理。

### 3.2 gdata库与特征工程

#### 3.2.1 特征选择

特征选择是从数据集中选择最相关特征的过程。这可以提高模型的性能并减少训练时间。

```python

from sklearn.feature_selection import SelectKBest

from sklearn.feature_selection import chi2

# 假设df_scaled是我们已经标准化的数据

# 选择K个最佳特征

X_new = SelectKBest(chi2, k=5).fit_transform(df_scaled, df_cleaned['label'])

```

在这段代码中,我们使用了`SelectKBest`方法结合`chi2`(卡方检验)来选择最相关的K个特征。

#### 3.2.2 特征构造

特征构造是指通过组合、转换现有特征来创建新特征,这有助于提高模型的预测能力。

```python

# 假设df_scaled是我们已经标准化的数据

# 创建新特征,例如特征的平方

df_scaled['feature_squared'] = df_scaled['feature']**2

# 添加新特征到特征集中

X_new = df_scaled.drop('label', axis=1)

```

在这个例子中,我们通过计算现有特征的平方来构造新特征,并将其添加到特征集中。

### 3.3 gdata库与模型评估

#### 3.3.1 模型选择

在机器学习中,模型选择是指从多个候选模型中选择最合适的一个。gdata库本身不提供模型选择功能,但我们可以结合机器学习库如scikit-learn来进行模型选择。

#### 3.3.2 模型评估指标

模型评估指标用于衡量模型的性能。gdata库不直接提供评估指标,但我们可以通过构建评估函数来实现。

```python

from sklearn.metrics import accuracy_score

# 假设y_true是真实的标签,y_pred是模型预测的标签

accuracy = accuracy_score(y_true, y_pred)

print(f'Accuracy: {accuracy}')

```

在这段代码中,我们使用了`accuracy_score`函数来计算模型的准确率。

## 总结

本章节介绍了gdata库在机器学习中的应用,包括数据预处理、特征工程和模型评估等方面。通过具体的代码示例,我们展示了如何使用gdata库和其他工具进行数据清洗、转换、特征选择和构造,以及模型评估。这些步骤是构建高效机器学习模型的重要组成部分。在下一章中,我们将进一步探讨gdata库在分类问题、回归问题和聚类问题中的具体应用。

# 4. gdata库与机器学习模型训练

0

0