【SAX解析器应用】:流式处理HTML内容的高效策略

发布时间: 2024-09-28 20:53:13 阅读量: 62 订阅数: 59

quick-xml:Rust高性能xml读写器

# 1. SAX解析器基本概念及原理

SAX(Simple API for XML)解析器是一种基于事件的XML解析方式,与DOM解析器形成鲜明对比。它采用流式处理,仅在读取XML文档时进行操作,无需将整个文档加载到内存中。这种方式特别适合于大型文件处理,因为它具有较小的内存占用和较快的解析速度。SAX解析器是事件驱动模型的典型应用,当解析器读取XML文档的某一部分时,触发相应事件的处理器,程序可以立即响应这些事件。为了深入理解SAX的工作原理,我们首先需要了解它的核心组件及其工作流程。

# 2. SAX解析器在HTML内容处理中的应用

SAX(Simple API for XML)解析器是一种基于事件驱动的XML解析方式,它在处理大型XML文件时特别有效率,因为它不需要将整个文件加载到内存中。HTML内容的处理往往是这种情形,使得SAX解析器在网页数据抓取和实时分析中具有独特的优势。本章将深入探讨SAX解析器在HTML内容处理中的应用,包括其工作机制、HTML内容的解析策略以及与DOM解析器的比较。

## 2.1 SAX解析器的工作机制

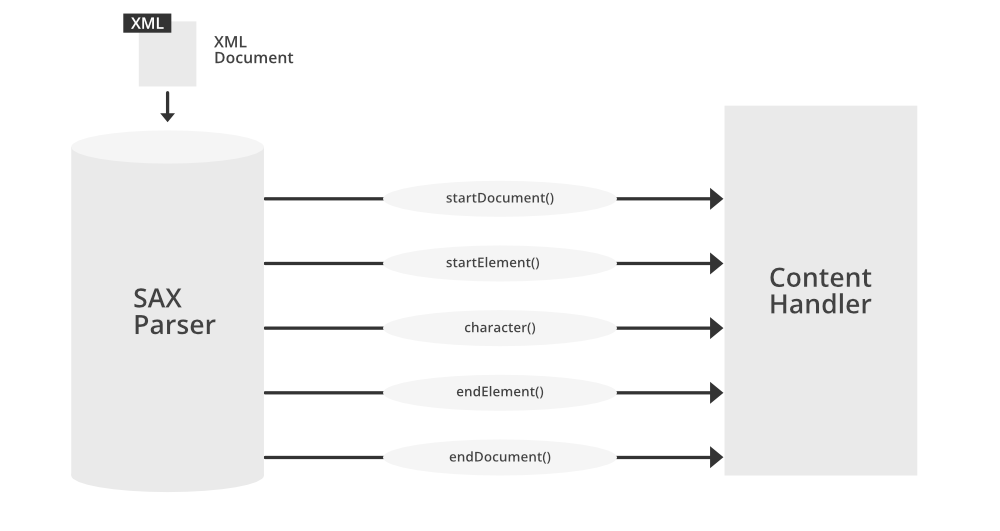

SAX解析器的核心工作原理是事件驱动模型。它通过在解析XML文档时触发一系列的事件来工作,这些事件是由XML文档中的不同结构(如标签的开始和结束)引发的。开发人员可以通过实现相应的事件处理函数来响应这些事件。

### 2.1.1 事件驱动模型解析流程

当SAX解析器开始处理一个XML文档时,它会按照文档中的元素顺序,触发一系列预定义的事件。每个事件都与XML文档中的某种结构相关联:

1. **开始文档**:解析器开始解析一个XML文档。

2. **开始元素**:解析器遇到一个XML元素的开始标签。

3. **字符**:解析器读取到文本数据。

4. **结束元素**:解析器遇到一个XML元素的结束标签。

5. **结束文档**:解析器完成文档的解析。

每个事件都可以通过一个事件处理器来处理,事件处理器可以被编程来执行特定的任务。例如,你可以编写一个函数来收集开始元素和结束元素事件之间的文本。

### 2.1.2 解析器状态与事件回调

SAX解析器通常维护一个内部状态机,这个状态机会在解析过程中根据遇到的XML结构改变。事件回调函数的实现与这些状态紧密相关。例如,在解析HTML文档时,一旦解析器进入“解析标签”的状态,就会触发相应的回调函数。

```java

parser.setContentHandler(new DefaultHandler() {

@Override

public void startElement(String uri, String localName, String qName, Attributes attributes) throws SAXException {

// 处理标签开始事件

}

@Override

public void characters(char[] ch, int start, int length) throws SAXException {

// 处理文本内容

}

@Override

public void endElement(String uri, String localName, String qName) throws SAXException {

// 处理标签结束事件

}

});

```

## 2.2 HTML内容的SAX解析策略

在HTML内容处理中,SAX解析器需要适应HTML文档的复杂性。HTML元素具有嵌套和属性等特点,这些都需要在解析策略中特别考虑。

### 2.2.1 标签的识别与处理

HTML中的标签可能是自闭合的,也可能是成对出现的,SAX解析器需要能够正确识别并处理这两种情况。每个标签的开始和结束事件都应该被适当地触发。

### 2.2.2 属性的提取与应用

HTML标签的属性对于确定标签的功能和内容至关重要。SAX解析器需要在标签的开始事件中提取这些属性,并根据需要进行处理。

### 2.2.3 文本内容的流式处理技巧

HTML文档中可能含有大量的文本内容,SAX解析器的一个重要优势是能够流式处理这些文本,从而无需将整个文档加载到内存中。这种处理方式需要精确地在字符事件中收集文本片段。

## 2.3 SAX解析器与DOM解析器的比较

SAX和DOM解析器是处理XML文档的两种不同方法,每种方法都有其优缺点。比较它们可以帮助开发者选择更适合特定情况的解析器。

### 2.3.1 内存使用对比分析

SAX是一种基于流的解析方式,它一次只处理XML文档的一部分。因此,它通常在内存使用方面更为高效,特别适合于大型文档的处理。

| 解析器类型 | 内存使用 | 解析速度 | 数据处理方式 |

|------------|----------|----------|--------------|

| SAX | 低 | 快 | 流式 |

| DOM | 高 | 慢 | 非流式 |

### 2.3.2 解析速度和效率评估

DOM解析器将整个文档构建为内存中的树形结构,这在处理大量数据时可能会导致性能问题。相比之下,SAX可以在不构建整个树的情况下完成解析,因此通常解析速度更快。

尽管如此,SAX解析器也有其局限性,比如不能随机访问文档内容,这对某些应用场景是一个限制。但总的来说,在需要处理大型文件或实时数据流时,SAX解析器通常是更优的选择。

以上就是第二章中关于SAX解析器在HTML内容处理中的应用介绍。在下一章节,我们将深入探讨SAX解析器在实践中的具体案例,包括流式XML数据处理和实时HTML内容分析,以及在Web爬虫中的高级应用。

# 3. SAX解析器实践案例分析

## 3.1 流式XML数据处理

SAX解析器非常适合处理大型的流式XML数据,它通过事件驱动的方式逐个处理数据片段,避免了一次性读取整个文档至内存,这使得SAX在处理大型XML文件时尤其高效。在本小节中,我们将详细探讨如何利用SAX解析器来处理流式XML数据。

### 3.1.1 数据流的构建与处理

构建一个处理流式XML数据的SAX解析器涉及到几个关键步骤。首先,需要初始化一个`XMLReader`对象,并设置相应的`ContentHandler`。`ContentHandler`是一个接口,它定义了多个方法,这些方法会在解析XML文档时的不同阶段被调用。

```java

import org.xml.sax.helpers.XMLReaderFactory;

import org.xml.sax.XMLReader;

import org.xml.sax.ContentHandler;

public class SaxStreamProcessor {

public static void main(String[] args) throws Exception {

XMLReader reader = XMLReaderFactory.createXMLReader();

ContentHandler handler = new MyContentHandler(); // MyContentHandler 需要自己实现

reader.setContentHandler(handler);

// 假设我们有一个XML流的输入源

InputStream xmlStream = new FileInputStream("bigfile.xml");

try {

InputSource xmlInputSource = new InputSource(xmlStream);

reader.parse(xmlInputSource);

} finally {

xmlStream.close();

}

}

}

```

在上面的代码示例中,`MyContentHandler`是我们自定义的处理器,它需要实现`ContentH

0

0