数据清洗与预处理秘籍:打造机器学习的高效训练集

发布时间: 2024-11-23 04:42:29 阅读量: 10 订阅数: 13

# 1. 数据清洗与预处理概述

在当今数据驱动的业务环境中,数据清洗与预处理是数据分析和机器学习前的必要步骤。这个阶段至关重要,因为它直接影响了数据质量,进而影响分析结果的准确性。数据预处理通常涉及几个关键环节,包括数据清洗、数据转换、特征工程等。在这篇文章中,我们将讨论数据清洗与预处理的重要性,掌握其基本概念,并探索一些核心的预处理方法。通过本文的学习,读者将能够理解并实施高效的数据预处理流程,从而为后续的数据分析工作打下坚实的基础。

# 2. 数据预处理的理论基础

数据预处理是数据科学和机器学习中不可或缺的一步,涉及到从原始数据中提取有用信息,并将其转换为适合分析和建模的格式。此过程涵盖了数据清洗、转换、特征工程等步骤,对于最终模型的性能有着直接的影响。在本章中,我们将探讨数据预处理的理论基础,包括其重要性、策略、方法,以及如何有效地实施这些步骤。

## 2.1 数据预处理的重要性

### 2.1.1 数据质量对机器学习的影响

在机器学习领域,数据质量对最终模型的准确性和可靠性有着决定性的影响。高质量的数据集应该是准确的、一致的、完整的,并且代表了所需分析的问题。如果数据集中包含噪声、异常值、缺失值或者不一致性,那么模型可能无法准确捕捉到数据的真实分布,导致过拟合或欠拟合的问题。

数据质量的不佳,可能会导致以下问题:

- **准确性下降**:模型无法正确学习数据背后的模式。

- **效率降低**:不一致的数据需要更多的预处理时间,影响模型的训练效率。

- **解释性问题**:低质量的数据会使得模型难以解释,因为数据中蕴含的信号被噪声所掩盖。

### 2.1.2 数据预处理在数据科学工作流中的位置

数据预处理是整个数据科学工作流程中的关键步骤,通常位于数据收集与探索性数据分析之后,特征工程与模型建立之前。数据预处理的任务包括清理数据,填充缺失值,异常值处理,数据转换,以及数据标准化等。

工作流的顺序可以概括为以下几个步骤:

- **数据收集**:从不同的数据源获取数据。

- **数据探索与清洗**:对数据进行初步探索,识别并处理缺失值、异常值等。

- **特征工程**:通过预处理步骤构建更有意义的特征。

- **模型训练与评估**:在预处理后的数据上训练模型,并评估其性能。

工作流的这种顺序保证了模型建立在了一个较为干净、结构化、经过优化的数据集上,这对于模型的性能至关重要。

## 2.2 数据清洗的策略与方法

### 2.2.1 缺失值的处理技巧

在实际的数据集之中,缺失值是一种常见问题。数据缺失可能是由于各种原因造成的,包括数据录入错误、数据传输问题或者数据隐私保护等。处理缺失值有几种常见的策略,包括删除含有缺失值的记录、填充缺失值或者通过模型预测缺失值。

- **删除法**:如果数据集足够大,而缺失值占比较小,可以选择删除含有缺失值的记录。

- **填充法**:对于数值型数据,可以使用均值、中位数或者众数来填充缺失值。对于分类数据,可以使用众数或者一个特定的标记值。

- **预测填充**:使用回归、分类模型来预测缺失值,并用预测结果填充。

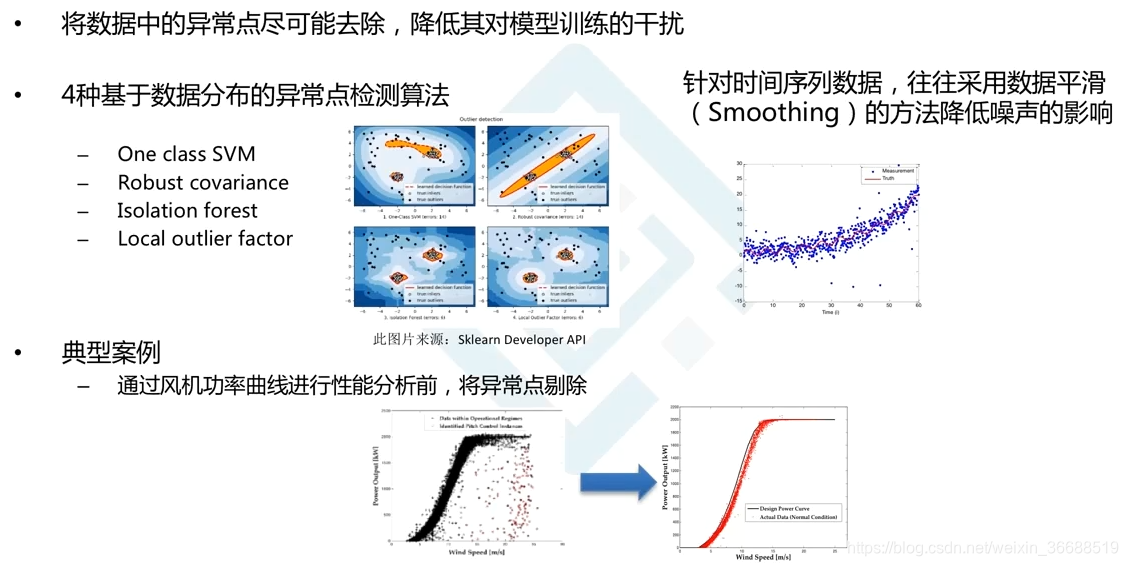

### 2.2.2 异常值的识别与处理

异常值指的是那些与数据集中的其他观测值显著不同的点。它们可能是由于错误的测量或者记录导致,也可能代表了一些有价值的信息。因此,正确识别和处理异常值是数据预处理中的重要环节。

一些识别异常值的常用方法包括:

- **箱形图(Boxplot)**:通过箱形图可以直观地识别出离群点。

- **Z-score**:计算数据点与平均值的偏离程度,如果Z-score大于某个阈值(通常是3),则该点可能是异常值。

- **基于分布的检测**:通过假设数据的分布来检测异常值,比如使用正态分布参数来识别偏离正态分布的数据点。

处理异常值的方法有:

- **删除**:如果确认异常值是由于错误导致的,可以直接删除。

- **变换**:通过对数变换、平方根变换等方法来减少异常值的影响。

- **替换**:用均值、中位数或其他估计值来替换异常值。

### 2.2.3 数据重复性的检验与去除

数据集中的重复记录会导致分析结果的偏差,降低模型的准确度。在数据预处理时,必须检查并去除重复数据。通常,这可以通过比较数据集中的记录,找出那些完全相同的记录,并将它们删除。

重复数据的检测和去除可以通过以下步骤进行:

- **全列比较**:逐行比较数据集中的每一列,找出完全匹配的行。

- **分组聚合**:使用分组聚合的方式,例如,对于重复的记录,取其中的一个代表进行保留,其余的删除。

- **哈希函数**:对于大型数据集,可以使用哈希函数快速识别出重复的记录。

## 2.3 数据标准化与归一化

### 2.3.1 标准化与归一化的概念和目的

数据标准化(Standardization)和归一化(Normalization)是将特征的尺度缩放到统一范围的过程。虽然这两个术语有时被交替使用,但它们在技术上有细微的差别。

- **标准化**:使得数据具有均值为0和标准差为1的特性,通常称为“Z-score标准化”。

- **归一化**:将数据缩放到[0,1]范围,使得最大值为1,最小值为0。

进行这些操作的目的在于:

- **加速学习过程**:标准化或归一化的特征可以加快模型训练的过程,因为它们避免了在求解优化问题时出现的数值问题。

- **提高模型性能**:不同尺度的特征可能使得优化算法难以处理,经过标准化或归一化后,模型可以更加公平地评估这些特征的重要性。

- **避免数值问题**:对于某些模型算法(如基于距离的算法),在不同尺度上的特征可能导致数值不稳定。

### 2.3.2 实现数据标准化与归一化的常用算法

数据标准化和归一化通常可以使用简单的数学方法实现。对于标准化,常见的方法是使用公式:

\[ Z = \frac{(X - \mu)}{\sigma} \]

其中,\( X \) 是原始数据点,\( \mu \) 是数据的均值,\( \sigma \) 是数据的标准差。

对于归一化,常用的方法是:

\[ X_{\text{norm}} = \frac{(X - X_{\text{min}})}{(X_{\text{max}} - X_{\text{min}})} \]

其中,\( X \) 是原始数据点,\( X_{\text{min}} \) 和 \( X_{\text{max}} \) 分别是数据集的最小值和最大值。

这些方法可以轻易通过编程语言中的库函数实现,例如在Python中,Pandas和Scikit-learn库提供了内置函数来轻松实现标准化和归一化。

### 2.3.3 标准化与归一化的选择与应用实例

标准化和归一化的选择依赖于模型的性质以及数据本身的特性。对于基于距离的算法,如K近邻(KNN)和主成分分析(PCA),标准化通常是首选。而对于梯度下降算法,归一化可能是更好的选择。

以一个简单的线性回归问题为例,假设我们有一组数据,其中包括房屋价格(因变量)以及房屋的面积和卧室数量(自变量)。在构建模型之前,我们先进行标准化:

```python

from sklearn.preprocessing import StandardScaler

# 假设df是一个Pandas DataFrame,包含我们的数据集

X = df[['area', 'bedrooms']]

y = df['price']

# 对数据进行标准化

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

```

通过标准化,我们将数据集中的特征缩放到了相同的尺度,使得模型可以更好地解释特征之间的关系。在这个例子中,我们使用了Scikit-learn库,这是一个广泛使用的Python机器学习库,提供了很多易于使用的数据预处理函数。

# 3. 数据转换与特征工程

数据转换与特征工程是数据预处理的关键环节,它关系到后续模型的准确度和效率。特征工程的目标是通过转换原始数据来增强模型的预测能力。本章将详细介绍特征选择与降维、特征提取与构造以及时间序列数据的预处理方法。

## 3.1 特征选择与降维

### 3.1.1 特征选择的动机与方法

特征选择是为了减少特征的数量,去除冗余和无关的特征,提高模型的训练效率和预测性能。特征选择的方法主要分为三大类:过滤方法、包装方法和嵌入方法。

过滤方法依赖于特征的统计度量值进行评估,如相关系数、卡方检验、互信息等。此方法计算简单,但不考虑特征与模型间的依赖关系。例如,使用相关系数选择特征的Python代码如下:

```python

import pandas as pd

from scipy.stats import pearsonr

# 假设df是已经加载的DataFrame,包含目标变量target和一系列特征

def correlation_with_target(dataframe, target):

correlations = {}

for column in dataframe.columns:

if column == target:

continue

correlation, _ = pearsonr(dataframe[column], dataframe[target])

correlations[column] = correlation

return correlations

# 计算特征与目标变量的相关性

correlations = correlation_with_target(df, 'target')

# 过滤掉相关性低的特征

threshold = 0.1

selected_features = [feature for feature, corr in correlations.items()

```

0

0