遗传算法超参数优化:自动化工具的进阶使用指南

发布时间: 2024-09-03 21:28:47 阅读量: 117 订阅数: 49

基于遗传算法的PID参数优化.doc

# 1. 遗传算法与超参数优化基础

遗传算法是一种启发式搜索算法,它模拟了自然选择的过程,并在生物进化论的启发下产生。作为超参数优化的一种技术,它在众多机器学习模型中扮演着重要角色,允许我们通过自动化的过程改进模型性能。

## 遗传算法的基本概念

在进一步探索遗传算法如何用于超参数优化之前,我们有必要了解其基本概念。遗传算法处理问题的方式类似于自然界中生物的遗传和进化,通过选择、交叉(也称为杂交或重组)和变异等操作,算法迭代地改进一组候选解决方案。

- **选择(Selection)**:根据适应度函数对当前种群中的个体进行评估,并选出较优的个体用于繁殖后代。

- **交叉(Crossover)**:通过结合两个(或更多)父代个体的部分信息来产生新的子代。

- **变异(Mutation)**:以一定概率随机改变个体的部分基因,以维持种群的多样性,防止算法过早收敛至局部最优。

遗传算法的终止条件通常设定为达到预设的迭代次数,或种群适应度收敛到一定程度。适应度函数是根据具体问题设计的,它决定了个体适应环境的能力,进而影响其被选择的机会。

在后续章节中,我们将深入探讨遗传算法的操作细节、性能评估以及如何将其应用于超参数优化。

# 2. 遗传算法的理论基础

## 2.1 遗传算法的基本原理

### 2.1.1 选择、交叉、变异的概念

遗传算法(Genetic Algorithm, GA)是一种模拟自然选择和遗传学机制的搜索优化算法,它从自然界的进化过程中汲取灵感,采用种群的概念来进行问题的求解。算法中的三个核心概念:选择(Selection)、交叉(Crossover)和变异(Mutation),共同构成了遗传算法的基础框架。

选择是模拟自然选择的过程,它决定了哪些个体能够遗传到下一代。在一个种群中,适应度高的个体被选中的概率更高,这种机制保证了优秀的特征能够被保留和传承。常见的选择机制有轮盘赌选择(Roulette Wheel Selection)、锦标赛选择(Tournament Selection)等。

交叉是遗传算法中产生新个体的主要方式,它模拟了生物的杂交过程。通过选择两个或多个父代个体并按照某种方式交换它们的部分基因,可以产生包含父代特征的后代。这种机制增加了种群的多样性,有助于算法跳出局部最优并寻找到全局最优解。

变异是遗传算法中引入新的遗传特征的手段,它通过随机改变个体的某些基因来实现。变异操作为种群带来新的遗传信息,增强了算法的探索能力,防止了过早收敛到局部最优解。

这三个操作相互配合,使遗传算法能够在搜索空间内进行有效的全局搜索,并逐步逼近最优解。

### 2.1.2 算法的适应度函数和终止条件

适应度函数是遗传算法中评估个体优劣的标准,它相当于自然界中生物的生存能力。在遗传算法中,每个个体都有一个与之对应的适应度值,这个值决定了该个体在环境中的生存与繁衍概率。适应度函数的选择取决于具体问题,需要根据问题的性质来设计,它应当能够准确反映出个体的好坏。

终止条件是遗传算法停止运行的标准。它决定了算法何时结束搜索,进而输出当前找到的最佳解。常见的终止条件有:达到预设的最大迭代次数、连续若干代种群的适应度变化小于某个阈值、找到满足特定条件的解等。终止条件的选择对算法的运行效率和找到的解的质量都有直接的影响。

## 2.2 遗传算法的操作细节

### 2.2.1 编码策略

遗传算法的编码策略决定了个体基因的表示方式。一个合适的编码方式可以提高算法的搜索效率,使得遗传操作能够更加直观和高效地进行。常用的编码方式包括二进制编码、实数编码和符号编码等。

二进制编码是将问题解的参数转换为二进制字符串,它在早期的遗传算法中应用广泛。实数编码使用实数值来表示参数,适用于连续优化问题。符号编码则是用符号序列来表示参数,适用于需要特定规则组合的问题。

在实际应用中,编码策略的选择要考虑到问题的复杂度、搜索空间的大小以及算法的运行效率等因素。

### 2.2.2 种群初始化和选择机制

种群初始化是遗传算法的第一步,它决定了算法搜索的起始点。一个优秀的初始化策略能够帮助算法更快地找到好的解。初始化时,种群中的个体应尽量分散,以便覆盖更广泛的搜索空间。

选择机制决定了哪些个体可以遗传到下一代,直接影响算法的收敛速度和找到全局最优解的能力。轮盘赌选择依据个体适应度与种群适应度总和的比例来确定被选中的概率,而锦标赛选择则是通过随机选取若干个体,从中选出最佳者作为父本。不同的选择机制各有优劣,需要根据实际问题和算法表现来选择。

### 2.2.3 交叉和变异的操作实现

交叉操作是遗传算法中创造新个体的主要手段。它通过选择一个或多个交叉点,然后交换父代个体在这个点上的基因片段来实现。常见的交叉方式有单点交叉、多点交叉、均匀交叉等。交叉操作的设计需要考虑到问题的特点,以确保子代继承父代的优良特性。

变异操作是通过随机改变个体的部分基因来引入新的遗传信息。变异率需要谨慎设置,太高可能会导致搜索过程变得随机,太低则可能无法提供足够的新特征。在实数编码中,变异可能表现为给某个基因值加上一个小的随机数。

## 2.3 遗传算法的性能评估

### 2.3.1 收敛性分析

收敛性分析是评估遗传算法性能的重要指标之一,它关注算法是否能够稳定并准确地找到问题的最优解。收敛性分析通常涉及到算法的稳定性和收敛速度。稳定性是指算法在多次运行后是否能够一致地找到相同的解。收敛速度则是指算法找到满意解所需的迭代次数。

为了分析遗传算法的收敛性,可以通过绘制适应度值随迭代次数变化的曲线来观察算法的运行情况。如果曲线逐渐平缓,并趋向于某个固定的值,则表明算法具有良好的收敛性。

### 2.3.2 算法比较与评价标准

在实践中,遗传算法通常与其他优化算法进行比较,以便评价其性能。比较的评价标准包括解的质量、计算效率、稳定性和鲁棒性等方面。解的质量可以通过解的适应度值来衡量。计算效率通常以算法运行时间或迭代次数来评估。稳定性和鲁棒性则反映了算法在面对不同问题时的性能波动情况。

在多目标优化问题中,评价标准可能会更加复杂,需要考虑多个目标之间的权衡和折中。对于超参数优化,通常更关注模型在验证集上的性能。

在进行算法比较时,需要注意公平性和一致性原则,即比较的算法应该在相同的条件下运行,并且问题的复杂度和规模应该是相匹配的。

通过对比分析不同算法在相同问题上的表现,可以为选择最合适的优化算法提供依据。在一些情况下,结合多种算法的优点形成混合算法或元启发式算法,可能会得到更好的优化效果。

# 3. 超参数优化实践指南

## 3.1 超参数优化的问题定义

### 3.1.1 什么是超参数

在机器学习模型训练过程中,模型的参数(weights and biases)是在训练数据上通过学习得到的。而超参数则是在模型训练之前设置的参数,它们控制学习过程本身,并影响最终模型的性能。超参数是不可以直接从训练数据中学习到的,需要通过实验来调整和优化。

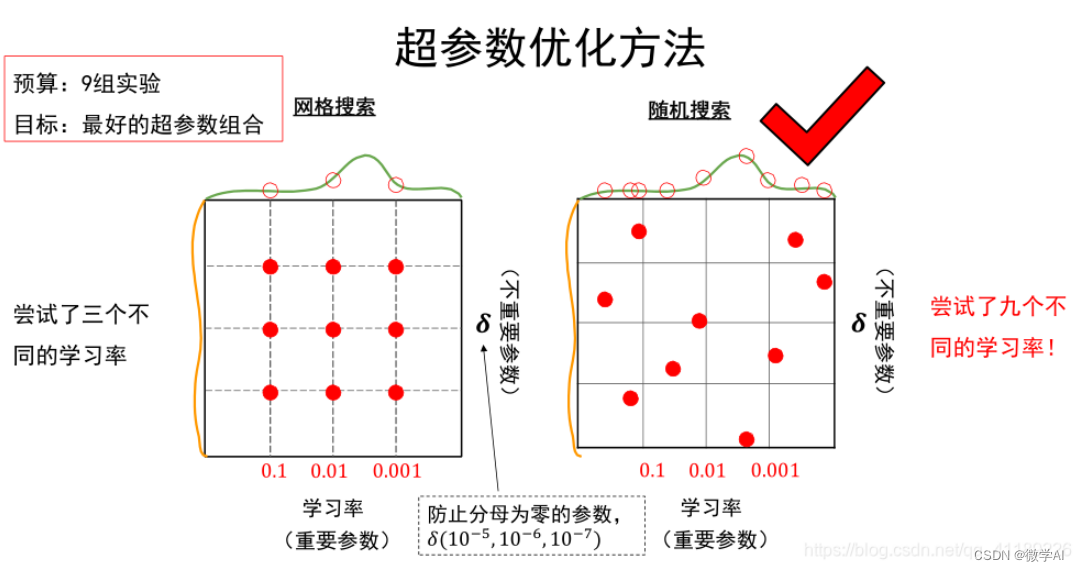

超参数的典型例子包括学习率、批处理大小(batch size)、隐藏层神经元的数量、决策树的深度、网络架构的选择等。不同的超参数和它们的不同值可以组成一个超参数空间,而寻找这个空间中的最优组合就是超参数优化的问题所在。

### 3.1.2 超参数优化的目标和挑战

超参数优化的目标是找到一组超参数的配置,使得模型在验证集上的性能达到最优。这样的优化过程通常涉及对性能指标的评估,比如准确率、精确度、召回率、F1分数等。实现这一目标通常面临以下几个挑战:

- **高维空间搜索**:超参数的数量和它们可能的取值范围导致了搜索空间的巨大。在高维空间中寻找最优配置是非常困难的。

- **计算资源限制**:优化过程可能需要大量的计算资源,因为评估一个超参数配置通常需要完整地训练模型一

0

0