【未来自注意力机制发展趋势及前沿技术预测】: 展望自注意力机制的未来发展趋势及前沿技术

发布时间: 2024-04-20 13:26:59 阅读量: 15 订阅数: 23

# 1. 自注意力机制简介

自注意力机制(Self-Attention)是一种用于建模序列数据之间依赖关系的机制,最早应用在自然语言处理和计算机视觉领域。通过自注意力机制,模型可以对不同位置的输入信号分配不同的注意力权重,从而实现对输入序列中不同元素的关注程度。自注意力机制的关键在于计算注意力权重,并基于这些权重对输入进行加权聚合,以获取表示信息的特征向量。

在神经网络中,自注意力机制通过学习得到注意力矩阵,能够更好地捕捉输入序列之间的长程依赖关系,提升模型在处理序列数据时的性能和效果。

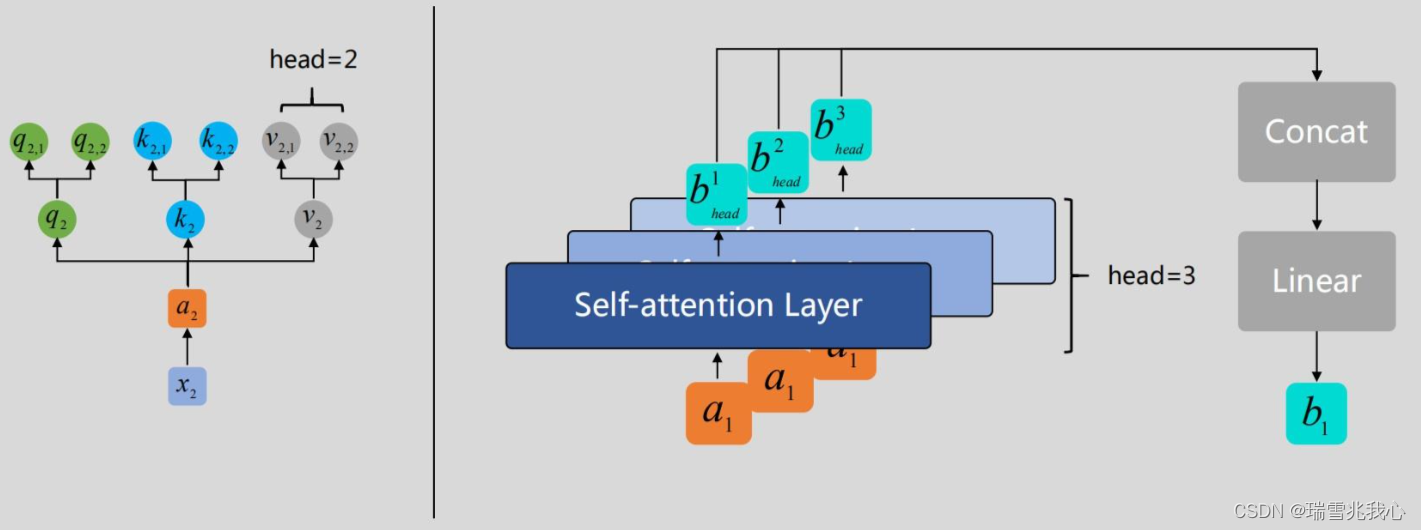

# 2. 自注意力机制的基本原理

自注意力机制作为一种重要的注意力机制,在深度学习领域扮演着至关重要的角色。本章将介绍自注意力机制的基本原理,包括概述、注意力权重计算、注意力矩阵生成以及自注意力与传统注意力的区别。

### 2.1 自注意力机制概述

自注意力机制是一种可以帮助模型在处理序列数据时更好地理解不同位置之间关系的方法。它通过对输入的各个位置进行加权求和,从而达到关注“自己”和“他人”的效果。

#### 2.1.1 注意力权重计算

在自注意力机制中,注意力权重的计算是关键的一步。通过输入的查询、键、值向量之间的相互关系计算出注意力分数,再将其归一化得到注意力权重。

```python

# 注意力权重计算

def attention(query, key, value):

attention_scores = tf.matmul(query, tf.transpose(key))

attention_weights = tf.nn.softmax(attention_scores, axis=-1)

return tf.matmul(attention_weights, value)

```

#### 2.1.2 注意力矩阵生成

注意力矩阵是由各个位置对其他位置的注意力权重组成的矩阵。这个矩阵反映了模型在处理序列数据时对不同位置的关注程度,有助于理解信息交互及关联。

#### 2.1.3 自注意力与传统注意力的区别

相比于传统的注意力机制,自注意力机制具有更好的建模能力和灵活性。传统的注意力机制通常是通过固定的查询来计算注意力权重,而自注意力通过查询、键、值的交互动态地生成注意力权重,可以更好地适应不同的输入序列。

### 2.2 自注意力在神经网络中的应用

自注意力机制在神经网络中有着广泛的应用,尤其是在Transformer模型中表现出色。同时,它也被应用于自然语言处理和计算机视觉领域。

#### 2.2.1 Transformer模型中的自注意力机制

Transformer模型是自注意力机制的经典代表,通过多层的自注意力和前馈神经网络层构成。自注意力在Transformer中被用于捕捉输入序列中的长程依赖关系,是其在翻译、语言建模等任务中取得成功的关键。

#### 2.2.2 自注意力在自然语言处理中的应用

在自然语言处理中,自注意力被广泛应用于文本分类、句子生成等任务。在处理文本数据时,自注意力可以帮助模型更好地理解句子内部的语义关系,提升模型性能。

#### 2.2.3 自注意力在计算机视觉中的应用

除了在自然语言处理中的应用,自注意力也在计算机视觉领域展现出强大的能力。通过引入自注意力机制,模型可以在处理图像数据时实现像素级别的关注,从而提升图像分类、目标检测等任务的表现。

在神经网络领域中,自注意力机制的应用正变得越来越广泛,为各种任务带来了新的思路和解决方案。

# 3. 自注意力机制的发展趋势

### 3.1 神经网络中的演化

神经网络作为人工智能领域的重要支柱,随着自注意力机制的引入,也在不断演化和发展。下面我们将深入探讨神经网络中的演化过程及相关内容。

#### 3.1.1 深度自注意力网络的发展

在神经网络领域中,深度神经网络一直是一个重要的研究方向。自注意力机制的出现为深度神经网络的发展提供了新的思路和方法。深度自注意力网络通过引入多层注意力机制,能够更好地捕捉输入序列中的内部依赖关系,提高模型的表征能力和泛化能力。值得一提的是,随着深度自注意力网络的不断改进和优化,其在计算机视觉和自然语言处理等领域取得了显著的成果。

```python

# 深度自注意力网络示例代码

class SelfAttention(nn.Module):

def __init__(self, embed_size, heads):

super(SelfAttention, self).__init__()

self.embed_size = embed_size

self.heads = heads

self.head_dim = embed_size // heads

assert (

self.head_dim * heads == embed_size

), "Embedding size needs to be divisible by heads"

self.values = nn.Linear(self.head_dim, self.head_dim, bias=False)

self.keys = nn.Linear(self.head_dim, self.head_dim, bias=False)

sel

```

0

0