机器学习进阶:R语言中randomForest包的高级应用技巧

发布时间: 2024-11-02 01:25:37 阅读量: 4 订阅数: 4

# 1. randomForest包概述

randomForest是一个广泛使用的机器学习库,在R和Python的机器学习库中,它被广泛应用于分类和回归任务。它基于构建多个决策树,并结合它们的预测结果以提高整体模型的准确性和鲁棒性。randomForest之所以受到青睐,部分原因在于它的效率、稳定性以及处理数据特征之间复杂关系的能力。此外,它也提供了对特征重要性的度量,这有助于我们理解模型预测背后的动因,进而优化模型。在本文的第一章中,我们将首先概述randomForest包的基本功能和结构,为后续深入学习其算法原理、参数调优、应用案例打下基础。

# 2. randomForest算法原理与实践

## 2.1 算法的基本概念与理论

### 2.1.1 随机森林算法简介

随机森林是一种集成学习算法,它通过构建多个决策树来进行预测。每个决策树都会在训练过程中随机选择特征进行分割,最终的预测结果是基于所有树的预测结果的综合。这种算法因其出色的表现和易于并行化的特点,在数据挖掘和机器学习领域得到了广泛应用。

### 2.1.2 算法的工作机制

随机森林的工作机制可以简单地描述为以下几个步骤:

1. **数据抽样**:从原始数据集中随机抽取有放回的样本来创建多个训练集。

2. **树的生成**:对每个训练集,随机选择特征,并构建决策树。在树的每个节点上,进行特征分割,找到最佳的分裂点。

3. **预测投票**:当对新的数据进行预测时,每棵树都会给出预测结果。随机森林算法将根据多数投票或者平均概率来确定最终的预测结果。

随机森林的鲁棒性较强,通常不需要对数据进行严格的预处理。然而,为了获得更好的预测效果,适当的预处理和参数调优仍然非常重要。

## 2.2 构建第一个randomForest模型

### 2.2.1 模型构建的步骤

构建第一个randomForest模型可以分为以下几个步骤:

1. **数据准备**:加载数据集,并进行必要的数据清洗和预处理,比如处理缺失值、异常值等。

2. **模型初始化**:加载randomForest包,并初始化模型参数。

3. **模型训练**:使用训练数据集来训练randomForest模型。

4. **模型评估**:使用测试数据集来评估模型性能。

以下是一个简单的R代码示例,演示如何构建一个randomForest模型:

```R

# 载入randomForest包

library(randomForest)

# 假设我们有一个数据框df,其中包含特征和一个名为target的目标变量

# df <- read.csv("data.csv") # 加载数据集

# 分离特征和目标变量

features <- df[, -which(names(df) == "target")]

target <- df$target

# 训练randomForest模型

model <- randomForest(x = features, y = target, ntree = 500)

# 查看模型结构

print(model)

```

### 2.2.2 模型参数的初步调优

在随机森林模型训练之前,我们可以通过调整参数来进行初步的模型调优。重要的参数包括:

- `ntree`: 决策树的数量。更多的树通常意味着更好的性能,但会增加计算时间。

- `mtry`: 在构建每棵树时随机选择的特征数量。通常为特征总数的平方根。

- `nodesize`: 叶节点中最小的样本数。更小的值会导致更深的树和可能的过拟合。

调整这些参数可以通过交叉验证来实现,以寻找最佳的模型性能。

## 2.3 模型评估与验证

### 2.3.1 交叉验证与模型选择

交叉验证是一种模型评估技术,可以用来评估模型在未知数据上的表现。最常用的交叉验证方法是k折交叉验证,它将数据分为k个部分,轮流将其中一部分作为验证集,其余作为训练集。

在randomForest中实现交叉验证可以通过设置`cv.fold`参数来完成。以下是一个使用交叉验证来选择模型的R代码示例:

```R

# 使用交叉验证

cv.model <- randomForest(x = features, y = target, ntree = 500, cv.fold = 5)

# 输出交叉验证的结果

cv.model

```

### 2.3.2 模型的性能指标评估

评估随机森林模型的性能可以使用多种指标,包括准确率、召回率、F1分数、ROC曲线和AUC值等。对于回归问题,常用的指标是均方误差(MSE)和决定系数(R²)。

以下是一个评估模型性能的R代码示例,展示了如何计算和打印分类模型的性能指标:

```R

# 预测

predictions <- predict(model, newdata = features)

# 计算混淆矩阵和性能指标

confusion_matrix <- table(Predicted = predictions, Actual = target)

accuracy <- sum(diag(confusion_matrix)) / sum(confusion_matrix)

# 打印性能指标

print(paste("Accuracy:", accuracy))

```

接下来,我们将探讨randomForest参数调优和特征重要性分析的相关内容。

# 3. randomForest参数调优和特征重要性分析

在本章中,我们将深入探讨如何对randomForest模型进行参数调优,以及如何进行特征重要性分析,以便于我们构建出更加健壮、高效的预测模型。

## 3.1 参数调优策略

### 3.1.1 超参数的种类和作用

在构建机器学习模型时,超参数是控制学习过程和模型性能的外部配置参数。对于randomForest模型而言,一些关键的超参数包括:

- `n_estimators`:表示森林中树木的数量。增加树的数量通常会提高模型的精度,但同时也会增加训练所需的时间。

- `max_features`:在构建树的节点时要考虑的最大特征数。合理设置这个值可以减少过拟合的风险,并提升模型的泛化能力。

- `max_depth`:树的最大深度。深度越大,模型的复杂度越高,可能会导致过拟合;过小则可能欠拟合。

- `min_samples_split`:节点分割所需的最小样本数。这个值越大,对过拟合的控制就越强,但可能会导致欠拟合。

- `min_samples_leaf`:叶节点的最小样本数。它通常与`min_samples_split`一起控制树的增长和复杂性。

- `bootstrap`:用于构建每棵树的样本抽样方法。

了解这些参数的作用对于调优过程至关重要。

### 3.1.2 调优方法与实践案例

参数调优是一个迭代和实验过程,常用的调优策略包括网格搜索(Grid Search)和随机搜索(Random Search)。它们通过遍历参数空间的可能值,找到最佳的参数组合。

**网格搜索**:

```python

from sklearn.model_selection import GridSearchCV

param_grid = {

'n_estimators': [100, 300],

'max_depth': [10, 20, 30],

'min_samples_split': [2, 5],

}

rf = RandomForestClassifier()

grid_search = GridSearchCV(estimator=rf, param_grid=param_grid, cv=3, n_jobs=-1, verbose=2)

grid_search.fit(X_train, y_train)

```

执行逻辑说明:

1. 定义一个参数网格`param_grid`,其中包含了想要测试的参数及其对应的候选值。

2. 使用`GridSearchCV`初始化网格搜索对象,设置交叉验证折数为3,使用所有的CPU核心加速计算。

3. 使用训练数据拟合网格搜索对象,最优参数组合会被选出。

**随机搜索**:

```python

from sklearn.model_selection import RandomizedSearchCV

param_dist = {

'n_estimators': range(100, 500),

'max_features': ['auto', 'sqrt', 'log2'],

'max_depth': [None, 10, 20, 30],

}

rf = RandomForestClassifier()

random_search = RandomizedSearchCV(estimator=rf, param_distributions=param_dist, n_iter=10, cv=3, verbose=2)

random_search.fit(X_train, y_train)

```

执行逻辑说明:

1. 同样先定义参数分布`param_dist`,但这里使用范围或者列表形式给出参数的可能取值。

2. `RandomizedSearchCV`对象被用来进行随机搜索,通过设置`n_iter`来决定对参数空间进行多少次迭代。

3. 对象被拟合后,会从参数分布中随机选取指定数量的参数组合进行模型训练,得到最优的参数组合。

## 3.2 特征选择与重要性分析

### 3.2.1 特征选择的方法

特征选择的目的是找到最有助于预测目标变量的特征子集。常见的方法有:

- 过滤法(Filter methods):根据特征与目标变量之间的统计关系进行选择,如使用相关系数。

- 包裹法(Wrapper methods):基于模型的性能来进行特征选择,如递归特征消除(RFE)。

- 嵌入法(Embedded methods):在算法训练过程中进行特征选择,如随机森林模型自带的特征重要性评估。

### 3.2.2 特征重要性的度量和解释

randomForest提供了一种基于模型内部结构的特征重要性评估方法。特征重要性是通过平均不纯度减少(Mean Decrease in Impurity, MDI)计算得出的。

```python

import matplotlib.pyplot as plt

importances = rf.feature_importances_

indices = np.argsort(importances)[::-1]

plt.title('Feature Importances')

plt.bar(range(X_train.shape[1]), importances[indices], color='r', align='center')

plt.xticks(range(X_train.shape[1]), [feature_names[i] for i in indices], rotation=90)

plt.xlim([-1, X_train.shape[1]])

plt.show()

```

执行逻辑说明:

1. 从训练好的随机森林模型中提取特征重要性。

2. 对特征重要性进行排序,并使用条形图可视化展示每个特征的重要程度。

通过观察特征重要性的图表,我们可以识别出那些对模型预测有较大影响的特征,并据此进行进一步的数据分析和模型调优。

在下一章节中,我们将详细探讨randomForest在不同数据类型中的应用,以及如何在分类问题和回归问题中构建和优化随机森林模型。

# 4. randomForest在不同数据类型中的应用

### 4.1 分类问题应用

分类问题是机器学习中常见的一类问题,随机森林由于其高效和准确性,在分类问题上被广泛应用。本节将详细探讨如何在分类问题中构建随机森林模型,以及如何提升分类性能。

#### 4.1.1 分类问题的随机森林模型构建

构建分类问题的随机森林模型,首先需要理解分类问题的基本概念。分类问题通常指的是将实例数据划分到合适的类别中,如垃圾邮件识别、疾病诊断等。随机森林通过构造多个决策树来解决分类问题,最后通过投票的方式确定最终的分类结果。

以下是构建分类问题的随机森林模型的一般步骤:

1. 数据准备:首先收集数据并进行清洗,确保数据质量。

2. 数据预处理:将分类变量转换为数值型,并进行标准化或归一化处理。

3. 构建模型:使用randomForest包在R中构建模型。

4. 模型训练:使用训练数据集来训练模型。

5. 预测和评估:使用测试数据集进行预测,并评估模型的准确性。

示例代码如下:

```R

library(randomForest)

# 加载数据集

data(iris)

# 分割数据集为训练集和测试集

set.seed(123)

trainIndex <- createDataPartition(iris$Species, p = 0.7, list = FALSE)

trainData <- iris[trainIndex, ]

testData <- iris[-trainIndex, ]

# 构建随机森林模型

rfModel <- randomForest(Species ~ ., data = trainData, ntree = 500)

# 进行预测

predictions <- predict(rfModel, testData)

# 评估模型

confusionMatrix(predictions, testData$Species)

```

#### 4.1.2 分类性能的提升技巧

提升随机森林模型的分类性能,可以通过以下几个方面来进行:

1. 特征选择:选择相关性强的特征来训练模型,去除冗余特征。

2. 参数调整:调整如树的数量、树的深度等参数,以避免过拟合或欠拟合。

3. 特征工程:使用特征工程技术如PCA,或者特征转换。

4. 交叉验证:使用交叉验证来选择最优模型参数。

5. 集成学习:结合多个模型的预测结果以提升整体性能。

### 4.2 回归问题应用

回归问题是预测连续值的问题,例如股票价格预测、销售预测等。随机森林同样可以应用于回归问题,并且因其对异常值的鲁棒性而在回归任务中表现良好。

#### 4.2.1 回归问题的随机森林模型构建

构建回归问题的随机森林模型,需要对随机森林算法进行适当的调整以适应连续的输出。以下是构建回归问题的随机森林模型的一般步骤:

1. 数据准备:和分类问题类似,收集和清洗数据。

2. 数据预处理:标准化或归一化数据,处理缺失值。

3. 构建模型:使用randomForest包在R中构建模型。

4. 模型训练:使用训练数据集来训练模型。

5. 预测和评估:使用测试数据集进行预测,并评估模型的准确性和误差。

示例代码如下:

```R

library(randomForest)

# 加载数据集

data(Boston, package = "MASS")

# 分割数据集为训练集和测试集

set.seed(123)

trainIndex <- createDataPartition(Boston$medv, p = 0.7, list = FALSE)

trainData <- Boston[trainIndex, ]

testData <- Boston[-trainIndex, ]

# 构建随机森林回归模型

rfModel <- randomForest(medv ~ ., data = trainData, ntree = 500)

# 进行预测

predictions <- predict(rfModel, testData)

# 评估模型

postResample(predictions, testData$medv)

```

#### 4.2.2 回归预测的优化方法

针对回归问题,可以采用以下方法来优化随机森林模型的预测性能:

1. 调整树的数量和树深度:通过验证来确定最佳的数量和深度,以减少过拟合的风险。

2. 引入交互特征:通过特征交互来提高模型预测的精确度。

3. 处理异常值:在训练之前对数据中的异常值进行适当的处理,如使用中位数替代或移除。

4. 误差分析:评估模型残差来诊断模型性能,关注系统误差或偏差。

在本节中,我们详细探讨了随机森林模型在分类和回归问题中的应用,并提供了相关的R代码示例以及模型优化的策略。通过对数据的恰当处理和模型参数的调整,我们可以显著提升模型在不同数据类型中的性能。

# 5. randomForest的高级技术与集成方法

在深入了解了随机森林(randomForest)的基础知识和参数调优技巧之后,我们接下来探讨一些更高级的技术和集成方法。这些内容将使我们能够处理更复杂的任务,以及如何将randomForest与其他机器学习技术结合使用,以提升模型的预测能力和适应性。

## 5.1 高级特征工程技术

### 5.1.1 特征交叉与聚合

特征交叉和聚合是提高模型性能的有效手段,尤其是在处理具有多个相互关联特征的数据集时。特征交叉是指创建新特征,这些特征是原始特征对的组合。聚合则是指将多个特征的值合并成一个单一特征值,通常是为了捕捉某些统计属性,如均值、中位数或最大值等。

```r

# 示例代码展示如何在R中创建特征交叉

data("mtcars")

# 使用mtcars数据集,创建马力(hp)和每加仑行驶英里数(mpg)的交叉特征

mtcars$hp_mpg <- with(mtcars, hp * mpg)

# 展示交叉后的数据框部分

head(mtcars)

```

在上述示例中,我们通过简单的乘法操作创建了两个变量的交叉特征。在实际应用中,我们可能需要进行更复杂的操作以捕获数据中的交互效果。

### 5.1.2 特征转换技巧

特征转换是将原始特征转换成更适合模型训练的形式。这对于提升模型性能至关重要,尤其是当模型对数据分布敏感时。常用的方法包括标准化(z-score标准化)、最小-最大标准化、对数转换等。

```r

# 示例代码展示如何在R中进行特征标准化

data("mtcars")

# 使用mtcars数据集,对数据进行标准化处理

mtcars_std <- scale(mtcars)

# 展示标准化后的数据框部分

head(mtcars_std)

```

标准化处理后,数据的均值为0,标准差为1,这样可以避免特征的量纲对模型训练产生影响。

## 5.2 集成学习与模型融合

### 5.2.1 集成学习的基本原理

集成学习是机器学习中一种强大的策略,它通过组合多个模型来获得比单个模型更好的预测性能。在集成学习中,常见的方法包括Bagging、Boosting和Stacking。randomForest属于Bagging方法的一种,通过构建多个决策树并进行投票来预测最终结果。

### 5.2.2 随机森林与其他模型的融合策略

尽管randomForest本身就是一个集成模型,但我们可以将其与其他类型的模型融合,形成更强大的混合模型。例如,我们可以使用Stacking策略,将randomForest作为一个基模型,与其他基模型结合,通过一个元模型来整合所有基模型的预测结果。

```r

# 示例代码展示如何使用mlr包在R中进行Stacking模型融合

library(mlr)

# 创建一个基础学习器任务,这里以随机森林为例

task <- makeClassifTask(data = iris, target = "Species")

# 创建随机森林模型,作为Stacking中的一员

lrn1 <- makeLearner("classif.randomForest", predict.type = "prob")

# 创建另一个模型,比如线性判别分析(LDA),作为Stacking中的另一个基模型

lrn2 <- makeLearner("classif.lda")

# 将两个模型的预测结果组合,使用一个元模型进行整合

# 这里使用逻辑回归作为元模型

lrn3 <- makeLearner("classif.logreg")

# 创建Stacking学习器

s learner <- makeStackedLearner(lrn1, lrns = list(lrn2), super.learner = lrn3)

# 模型训练与评估

mod <- train(learner = s.learner, task = task)

pred <- predict(mod, task = task)

# 展示模型评估结果

performance(pred)

```

在上述代码中,我们展示了如何使用`mlr`包来实现Stacking。通过组合不同类型的模型,Stacking能够从各个模型中提取信息,并通过元模型进行更有效的集成。

## 5.2.3 集成模型在实际项目中的应用

在实际项目中,集成模型能够处理数据中的复杂模式,提高模型的泛化能力。通过融合不同模型的优点,集成模型在预测精度和稳定性方面通常优于单一模型。此外,集成学习可以很好地解决模型选择问题,因为最终模型由多个不同模型共同决策,从而降低了单个模型可能存在的偏差。

在使用集成模型时,需要注意模型之间的差异性,如果多个模型给出相似的预测结果,则集成后的提升可能并不显著。因此,合理选择模型,并确保它们在预测性能上的互补性,是提升集成模型效能的关键。

## 5.2.4 集成学习与数据科学竞赛

在数据科学竞赛中,如Kaggle竞赛,集成学习经常被用来提升模型的竞赛排名。竞赛参与者通常会尝试不同的集成策略,包括Bagging和Boosting的组合,以及不同模型的Stacking。为了进一步提高模型性能,参与者还会利用先进的特征工程技术和超参数优化方法。

在实际应用中,集成学习表现出了巨大的潜力,无论是在提高模型的准确性还是在处理不平衡数据集方面。然而,集成学习也有其局限性,如模型训练时间较长,模型复杂度较高,这些都需要在实际应用中进行权衡。

总结而言,集成学习不仅仅是随机森林技术的一部分,而是一种更加广泛的应用方法。通过理解集成学习的原理和策略,我们能够构建出更强大、更稳健的机器学习系统。

# 6. randomForest在实际项目中的应用案例

## 6.1 实际案例分析:数据预处理到模型部署

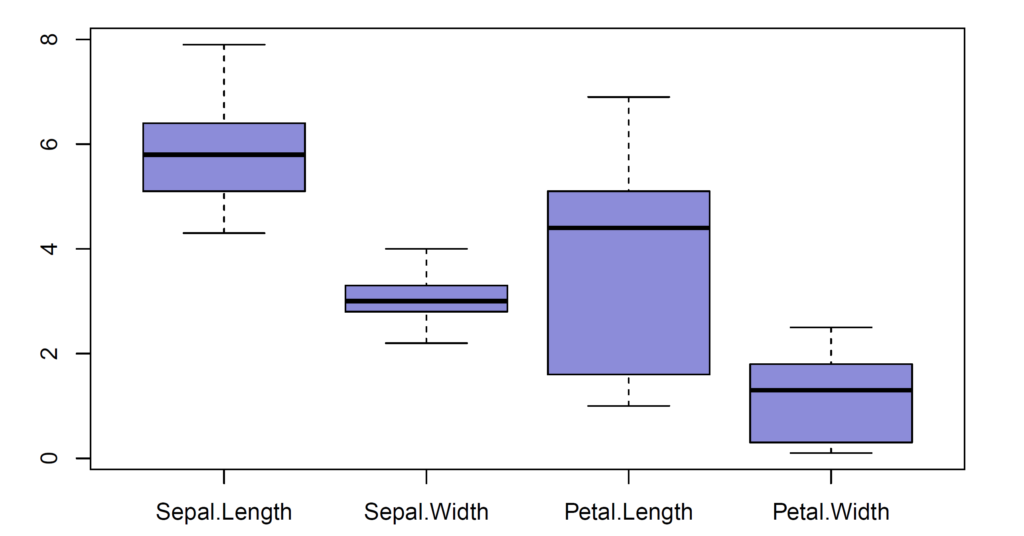

### 6.1.1 数据探索与预处理

在着手构建randomForest模型之前,数据的探索和预处理是至关重要的一步。首先,我们需要理解数据集中的每一列意味着什么,哪些是特征,哪些是标签。通过描述性统计和可视化手段可以了解数据的分布、异常值和潜在的模式。

```python

import pandas as pd

import seaborn as sns

import matplotlib.pyplot as plt

# 加载数据集

data = pd.read_csv('data.csv')

# 描述性统计分析

print(data.describe())

# 数据可视化探索

sns.pairplot(data)

plt.show()

# 检查缺失值

missing_values = data.isnull().sum()

print(missing_values)

# 处理缺失值

data.fillna(data.mean(), inplace=True)

# 特征工程:例如,对分类变量进行编码

data = pd.get_dummies(data, drop_first=True)

```

以上代码首先描述了数据集的基本情况,随后通过pairplot进行了变量之间的关系可视化,缺失值的统计则帮助我们决定是否需要填充或删除缺失数据。最后,`get_dummies`函数用于将分类变量转换为数值型特征。

### 6.1.2 模型训练与调优

完成了数据的预处理之后,我们就可以开始训练randomForest模型并进行调优了。模型训练过程中,我们首先需要划分训练集和测试集,然后使用训练集来训练模型,并使用测试集来评估模型性能。

```python

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import classification_report, accuracy_score

# 数据集分割

X_train, X_test, y_train, y_test = train_test_split(

data.drop('target', axis=1),

data['target'],

test_size=0.3,

random_state=42

)

# 初始化随机森林模型

rf = RandomForestClassifier(n_estimators=100, random_state=42)

# 训练模型

rf.fit(X_train, y_train)

# 预测测试集

predictions = rf.predict(X_test)

# 评估模型

print(classification_report(y_test, predictions))

print("Accuracy:", accuracy_score(y_test, predictions))

```

在上述代码块中,我们使用了`train_test_split`来划分数据集,`RandomForestClassifier`来初始化模型,并且拟合了训练数据。最后,我们通过`classification_report`和`accuracy_score`来评估模型的性能。

## 6.2 案例扩展:应用randomForest解决业务难题

### 6.2.1 业务问题描述与数据集准备

在实际业务中,randomForest可以应用于各种问题,比如客户流失分析、信用评分、股票价格预测等。业务问题的描述会指导我们选取合适的特征和构建相应的模型。例如,在客户流失分析中,目标变量可能是客户是否停止使用某项服务。

```python

# 业务问题描述:识别可能导致客户流失的特征

# 数据集准备:加载并初步探索

# 假设有一个名为 'churn_data.csv' 的文件

churn_data = pd.read_csv('churn_data.csv')

# 数据探索

print(churn_data.head())

```

### 6.2.2 randomForest模型的业务应用场景分析

在确定了业务问题之后,randomForest模型可以被用来预测客户的流失概率。以下是如何使用randomForest模型解决此问题的一个简要案例。

```python

from sklearn.model_selection import GridSearchCV

# 使用GridSearchCV来寻找最佳的模型参数

param_grid = {

'n_estimators': [100, 200, 300],

'max_depth': [5, 10, 15],

'min_samples_split': [2, 5, 10]

}

grid_search = GridSearchCV(estimator=rf, param_grid=param_grid, cv=5, n_jobs=-1, verbose=2)

grid_search.fit(X_train, y_train)

# 最佳参数和最佳分数

best_params = grid_search.best_params_

best_score = grid_search.best_score_

print("Best Parameters:", best_params)

print("Best Score:", best_score)

# 使用最佳参数重新训练模型

best_rf = RandomForestClassifier(**best_params)

best_rf.fit(X_train, y_train)

best_predictions = best_rf.predict(X_test)

# 再次评估模型

print(classification_report(y_test, best_predictions))

```

在此案例中,我们使用`GridSearchCV`进行参数调优,以找出最佳的模型参数,从而提高模型的性能。通过评估调优后的模型,我们可以对业务问题的预测有更高的信心。

0

0