KNN算法在移动设备上的应用:优化算法性能与用户体验,打造流畅移动应用

发布时间: 2024-08-20 05:40:56 阅读量: 16 订阅数: 42

# 1. KNN算法简介**

KNN(k-最近邻)算法是一种非参数机器学习算法,用于分类和回归任务。它的基本原理是,对于一个给定的新样本,算法会找到训练集中与它最相似的k个样本(即邻居),然后根据这些邻居的类别或值来预测新样本的类别或值。

KNN算法的优点包括易于理解和实现,不需要复杂的模型训练,并且对异常值不敏感。然而,它的缺点是计算成本高,特别是对于大数据集,并且需要存储整个训练集以进行预测。

# 2. KNN算法在移动设备上的优化

### 2.1 算法性能优化

**2.1.1 数据预处理和特征选择**

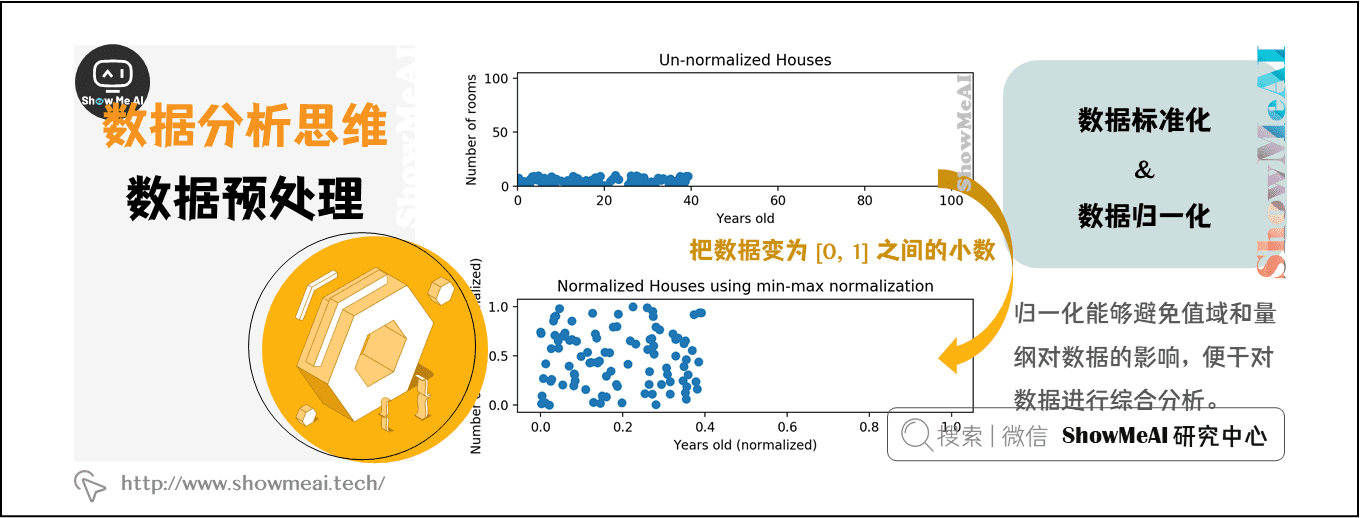

数据预处理和特征选择是优化KNN算法性能的关键步骤。数据预处理包括数据清洗、归一化和标准化,以消除噪声和异常值,并使数据分布在相同范围内。特征选择则涉及识别和选择与目标变量最相关的特征,以减少计算量和提高算法精度。

**代码块:**

```python

import pandas as pd

from sklearn.preprocessing import StandardScaler

# 数据预处理

df = pd.read_csv('data.csv')

df = df.dropna()

df = df.apply(lambda x: (x - np.min(x)) / (np.max(x) - np.min(x)))

# 特征选择

from sklearn.feature_selection import SelectKBest

from sklearn.feature_selection import chi2

selector = SelectKBest(chi2, k=10)

selected_features = selector.fit_transform(df.drop('target', axis=1), df['target'])

```

**逻辑分析:**

* `read_csv` 函数从 CSV 文件中读取数据。

* `dropna` 函数删除包含缺失值的行。

* `apply` 函数对数据框中的每一列应用归一化函数。

* `SelectKBest` 函数使用卡方检验选择前 10 个最相关的特征。

* `fit_transform` 函数将特征选择器拟合到数据并返回选定的特征。

**2.1.2 距离度量优化**

距离度量是KNN算法中衡量数据点相似性的关键因素。常见的距离度量包括欧几里德距离、曼哈顿距离和余弦相似度。根据数据的分布和特征,选择合适的距离度量可以提高算法的精度。

**代码块:**

```python

from sklearn.neighbors import KNeighborsClassifier

# 欧几里德距离

knn_euclidean = KNeighborsClassifier(n_neighbors=5, metric='euclidean')

# 曼哈顿距离

knn_manhattan = KNeighborsClassifier(n_neighbors=5, metric='manhattan')

# 余弦相似度

knn_cosine = KNeighborsClassifier(n_neighbors=5, metric='cosine')

```

**逻辑分析:**

* `KNeighborsClassifier` 类是用于 KNN 分类任务的 scikit-learn 实现。

* `n_neighbors` 参数指定要考虑的近邻数。

* `metric` 参数指定要使用的距离度量。

**2.1.3 近邻搜索算法优化**

近邻搜索

0

0