机器学习加速器:Kronecker积的算法秘诀大揭秘

发布时间: 2024-12-04 11:29:17 阅读量: 9 订阅数: 18

参考资源链接:[矩阵运算:Kronecker积的概念、性质与应用](https://wenku.csdn.net/doc/gja3cts6ed?spm=1055.2635.3001.10343)

# 1. Kronecker积的数学原理

Kronecker积是一种在数学的线性代数领域中使用的矩阵运算,它对于数据科学和机器学习领域有重要的作用。在本章中,我们将首先介绍Kronecker积的基本定义,然后探索它的数学原理和属性。

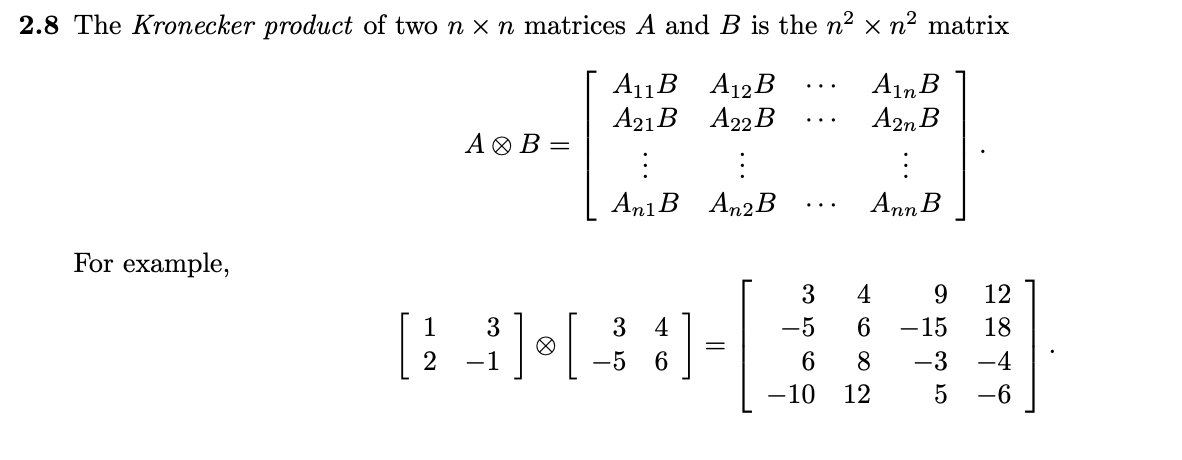

## 1.1 Kronecker积定义

Kronecker积,也称为直积或张量积,表示为 \( A \otimes B \),其中 \( A \) 和 \( B \) 是任意的矩阵。对于矩阵 \( A \) 的大小为 \( m \times n \) 和矩阵 \( B \) 的大小为 \( p \times q \),它们的Kronecker积 \( A \otimes B \) 将是一个新的矩阵,其大小为 \( mp \times nq \)。每个元素 \( A_{ij} \) 被矩阵 \( B \) 所替换,并按照特定的方式排列。

## 1.2 Kronecker积的性质和运算规则

Kronecker积的性质和运算规则是理解其在更复杂系统中应用的基础。例如,它满足分配律和结合律,但不满足交换律。具体的性质包括:

- **结合律**:\( (A \otimes B) \otimes C = A \otimes (B \otimes C) \)

- **分配律**:\( A \otimes (B + C) = A \otimes B + A \otimes C \)

- **非交换性**:\( A \otimes B \neq B \otimes A \),除非特殊条件成立。

了解这些性质可以帮助我们更好地处理矩阵运算中的复杂问题,为在机器学习模型中有效利用Kronecker积打下理论基础。

# 2. Kronecker积在机器学习中的理论应用

## 2.1 Kronecker积与线性代数

### 2.1.1 线性代数中的张量积概念

在探讨Kronecker积之前,必须先了解张量积这一概念,它是线性代数中的核心内容之一。张量积是一个用来描述两个向量空间中元素之间关系的运算,可以看作是向量空间的乘法。在数学上,对于两个向量空间U和V,它们的张量积U⊗V是所有可能的向量对(u,v)的集合,其中u属于U,v属于V。这个张量积空间的维度是原始空间维度的乘积,也即dim(U⊗V) = dim(U) * dim(V)。

张量积的概念在物理学、代数几何等领域都有广泛的应用,而在机器学习中,尤其是在涉及多维数据处理的场合,张量积能够提供更为丰富的结构描述。

### 2.1.2 Kronecker积的性质和运算规则

Kronecker积是张量积的一种特殊情况,用于矩阵运算。给定两个矩阵A和B,它们的Kronecker积,记作A⊗B,是一个将矩阵A的每个元素都用矩阵B的复制替换所得到的块矩阵。Kronecker积的运算规则包括如下几点:

- 如果A是m×n矩阵,B是p×q矩阵,那么A⊗B是一个mp×nq的矩阵。

- Kronecker积保持矩阵的加法和数乘运算,即A⊗(B+C) = A⊗B + A⊗C以及(A+B)⊗C = A⊗C + B⊗C。

- 具有结合律,即(A⊗B)⊗C = A⊗(B⊗C)。

- 矩阵的转置运算与Kronecker积相结合时,满足(A⊗B)的转置等于A的转置⊗B的转置。

- 与矩阵乘法的关系比较复杂,它们并不相互交换,即A⊗(BC) ≠ (A⊗B)(A⊗C)。

这些性质在机器学习算法中有着重要的应用,尤其是在处理具有层次结构的数据时,可以帮助我们更好地理解和操作矩阵运算。

## 2.2 Kronecker积与机器学习算法

### 2.2.1 在神经网络中的角色

在神经网络中,尤其是深度网络的设计与优化过程中,Kronecker积可以作为一种高效的矩阵操作工具。其作用体现在以下几个方面:

- 参数共享:在某些特定结构的神经网络中,利用Kronecker积可以在参数矩阵之间建立一种特殊的共享关系,提高模型的参数效率。

- 矩阵运算简化:当涉及到多个矩阵的乘法运算时,通过Kronecker积可以将复杂的运算简化为单个运算。

- 运行效率提升:在处理大规模数据时,通过利用Kronecker积的性质,可以减少计算量和内存使用,从而加速模型训练。

### 2.2.2 对算法效率和性能的影响

Kronecker积对机器学习算法效率和性能的影响主要表现在以下几个方面:

- 减少模型复杂度:通过使用Kronecker积,可以在保持模型性能的同时减少模型的参数数量,从而降低计算复杂度。

- 加快运算速度:在涉及到矩阵运算的算法中,适当的利用Kronecker积运算可以显著提升矩阵运算的效率。

- 提高模型泛化能力:有时候在特定的机器学习任务中,如分类问题,Kronecker积能够在不增加过多参数的情况下丰富模型的表示能力,从而增强模型的泛化能力。

Kronecker积的这些性质,使得在某些特定情况下,它成为提高机器学习算法效率和性能的有力工具。然而,如何具体应用这些性质来优化算法,还需结合具体的任务和数据集进行深入的研究。

# 3. Kronecker积的实践案例分析

## 3.1 深度学习框架中的Kronecker积应用

### 3.1.1 TensorFlow和PyTorch中的实现

TensorFlow和PyTorch作为深度学习的两大框架,为Kronecker积提供了高效的操作支持。在TensorFlow中,Kronecker积可以通过`tf.matmul`函数实现,该函数允许用户执行高效的矩阵乘法,这对于大规模数据集特别有用。以下是一个使用TensorFlow实现Kronecker积的代码示例:

```python

import tensorflow as tf

# 定义两个矩阵

A = tf.constant([[1, 2], [3, 4]])

B = tf.constant([[0, 5], [6, 7]])

# 计算Kronecker积

kronecker积 = tf.matmul(A, B)

print(kronecker积.numpy())

```

在这个例子中,`tf.matmul(A, B)`的结果是矩阵A和B的Kronecker积。TensorFlow优化了底层计算过程,使得这种运算可以高效进行。

PyTorch实现Kronecker积相对直观,使用`torch.mm`函数来计算两个矩阵的乘积,然后利用广播机制来计算Kronecker积。示例如下:

```python

import torch

# 定义两个矩阵

A = torch.tensor([[1,

```

0

0