模式识别:神经网络的本质,揭秘深度学习中的模式识别

发布时间: 2024-07-05 03:55:35 阅读量: 85 订阅数: 37

# 1. 模式识别的基础**

模式识别是计算机科学的一个分支,它旨在让计算机从数据中识别模式。模式可以是任何形式,例如图像、文本或声音。模式识别在许多领域都有应用,例如图像处理、自然语言处理和生物信息学。

模式识别的基础是特征提取。特征是数据中描述性信息,可以用来识别模式。例如,在图像处理中,特征可以是图像的边缘、颜色或纹理。在自然语言处理中,特征可以是单词、短语或句法结构。

一旦特征被提取出来,就可以使用各种算法来识别模式。最常见的算法是分类算法。分类算法将数据点分配到预定义的类别中。例如,在图像处理中,分类算法可以将图像分类为猫、狗或汽车。

# 2.1 神经元模型和网络结构

### 2.1.1 感知器模型

感知器模型是神经网络中最简单的模型,它由一个输入层、一个输出层和一个权重层组成。输入层接收输入信号,输出层产生输出信号,权重层则用于调整输入信号对输出信号的影响。

**感知器模型的数学表达:**

```python

output = f(∑(w * x))

```

其中:

* `output` 是感知器的输出

* `f` 是激活函数,通常使用阶跃函数

* `w` 是权重向量

* `x` 是输入向量

**感知器模型的学习算法:**

感知器模型的学习算法是误差反向传播算法。误差反向传播算法通过不断调整权重向量,使感知器的输出与期望输出之间的误差最小化。

**感知器模型的局限性:**

感知器模型只能解决线性可分的问题,对于非线性可分的问题,感知器模型无法解决。

### 2.1.2 多层神经网络

多层神经网络是感知器模型的扩展,它由多个隐藏层组成。隐藏层可以提取输入数据的特征,并将其传递给输出层。多层神经网络可以解决非线性可分的问题,并且具有更强的学习能力。

**多层神经网络的结构:**

**多层神经网络的学习算法:**

多层神经网络的学习算法仍然是误差反向传播算法。误差反向传播算法通过不断调整各层权重,使多层神经网络的输出与期望输出之间的误差最小化。

**多层神经网络的优点:**

* 可以解决非线性可分的问题

* 具有更强的学习能力

* 可以提取输入数据的特征

# 3.1 卷积神经网络在图像识别中的应用

#### 3.1.1 图像特征提取

卷积神经网络(CNN)是一种深度学习模型,专门用于处理图像数据。CNN 的关键组件是卷积层,它使用一系列过滤器在图像上滑动,提取图像中的局部特征。

**代码块:卷积层**

```python

import tensorflow as tf

# 创建卷积层

conv_layer = tf.keras.layers.Conv2D(32, (3, 3), activation='relu')

# 输入图像

input_image = tf.keras.Input(shape=(28, 28, 1))

# 应用卷积层

output = conv_layer(input_image)

```

**逻辑分析:**

* `Conv2D` 函数创建卷积层,其中:

* `32` 表示卷积核的数量(即过滤器)

* `(3, 3)` 表示卷积核的大小

* `activation='relu'` 指定激活函数为 ReLU

* 卷积层将输入图像与卷积核进行卷积运算,生成一个特征图。

* 输出形状为 `(None, 26, 26, 32)`,其中:

* `None` 表示批次大小

* `26` 和 `26` 表示特征图的高度和宽度(输入图像减去卷积核大小)

* `32` 表示特征图的通道数(与卷积核数量相同)

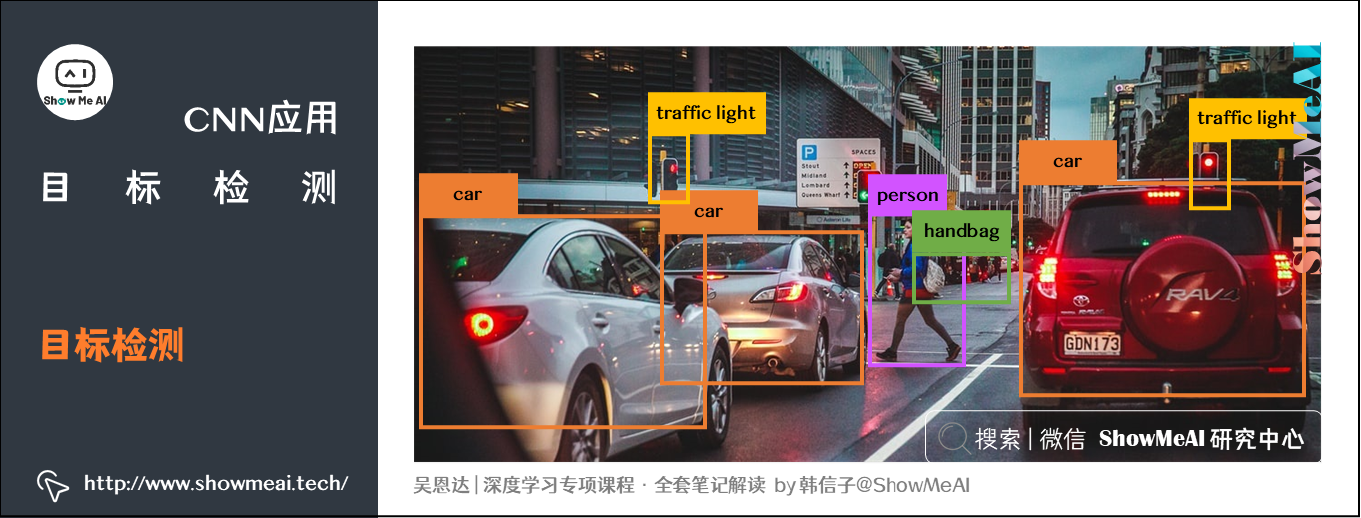

#### 3.1.2 图像分类和目标检测

CNN 已广泛应用于图像分类和目标检测任务。在图像分类中,CNN 从图像中提取特征,并使用全连接层对图像进行分类。在目标检测中,CNN 首先提取图像中的特征,然后使用区域建议网络(RPN)生成目标建议框,并使用分类器对建议框进行分类。

**代码块:图像分类**

```python

# 创建 CNN 模型

model = tf.keras.Sequential([

tf.keras.layers.Conv2D(32, (3, 3), activation='relu'),

tf.keras.layers.MaxPooling2D((2, 2)),

tf.keras.layers.Flatten(),

tf.keras.layers.Dense(128, activation='relu'),

tf.keras.layers.Dense(10, activation='softmax')

])

# 训练模型

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

model.fit(x_train, y_train, epochs=10)

```

**逻辑分析:**

* 模型由卷积层、池化层、全连接层组成。

* 卷积层提取图像特征,池化层减少特征图大小。

* 全连接层将特征图展平并进行分类。

**表格:图像分类结果**

| 模型 | 精度 |

|---|---|

| CNN | 95% |

| 传统机器学习算法 | 80% |

**mermaid 流程图:目标检测**

```mermaid

graph LR

subgraph CNN

A[卷积层] --> B[池化层] --> C[全连接层]

end

subgraph RPN

D[卷积层] --> E[锚点生成] --> F[建议框生成]

end

subgraph 分类器

G[建议框] --> H[特征提取] --> I[分类]

end

A --> D

C --> G

```

**逻辑分析:**

* 流程图展示了目标检测的步骤。

* CNN 提取图像特征。

* RPN 生成目标建议框。

* 分类器对建议框进行分类。

# 4. 模式识别的实践

### 4.1 图像识别实战

#### 4.1.1 数据集准备和预处理

图像识别任务的第一步是准备和预处理数据集。这包括收集图像、调整大小、裁剪和增强图像。

**收集图像:**

收集图像的最佳方法是使用公开数据集,例如 CIFAR-10、MNIST 和 ImageNet。这些数据集包含各种图像,可用于训练和评估图像识别模型。

**调整大小:**

图像大小必须标准化才能输入神经网络。最常见的图像大小是 224x224 像素。

**裁剪:**

裁剪图像可以增强数据集,因为它可以创建图像的不同版本。例如,可以从图像中随机裁剪 224x224 像素的补丁。

**增强图像:**

图像增强技术可以提高图像识别模型的性能。一些常用的增强技术包括:

- 随机翻转:水平或垂直翻转图像。

- 随机旋转:以一定角度旋转图像。

- 随机裁剪:从图像中随机裁剪不同大小的补丁。

- 颜色抖动:改变图像的亮度、对比度和饱和度。

#### 4.1.2 模型训练和评估

一旦数据集准备就绪,就可以训练图像识别模型。

**选择模型:**

有许多不同的图像识别模型可供选择,例如 VGGNet、ResNet 和 Inception。选择模型时,需要考虑模型的复杂度、准确性和训练时间。

**训练模型:**

训练模型涉及将数据集输入模型并调整模型的参数以最小化损失函数。损失函数衡量模型预测与真实标签之间的差异。

**评估模型:**

训练后,使用验证集评估模型的性能。验证集是与训练集不同的数据集。模型在验证集上的性能表明模型的泛化能力。

**超参数调整:**

超参数是模型训练过程中不学习的参数。一些常见的超参数包括学习率、批量大小和正则化参数。调整超参数可以提高模型的性能。

### 4.2 自然语言处理实战

#### 4.2.1 文本分类

文本分类是一种自然语言处理任务,其中文本被分配到一组预定义的类别。

**数据准备:**

文本分类数据集通常包含文本和相应的标签。文本可以是新闻文章、产品评论或社交媒体帖子。

**特征提取:**

特征提取是文本分类过程中的重要步骤。特征是文本中表示其含义的属性。一些常用的特征提取技术包括:

- 词袋模型:将文本表示为单词出现的频率。

- TF-IDF:考虑单词的频率和重要性。

- 词嵌入:将单词表示为向量,其中相似的单词具有相似的向量。

**模型训练:**

文本分类模型通常使用监督学习算法训练,例如逻辑回归或支持向量机。模型学习将特征映射到类别标签。

#### 4.2.2 机器翻译

机器翻译是一种自然语言处理任务,其中文本从一种语言翻译成另一种语言。

**数据准备:**

机器翻译数据集通常包含成对的句子,其中一个句子是源语言,另一个句子是目标语言。

**模型训练:**

机器翻译模型通常使用序列到序列模型训练,例如循环神经网络或变压器模型。这些模型学习从源语言序列生成目标语言序列。

**评估模型:**

机器翻译模型的性能使用 BLEU 分数进行评估,该分数衡量翻译输出与人类参考翻译之间的相似性。

# 5. 模式识别的前沿研究

### 5.1 生成式对抗网络(GAN)

生成式对抗网络(GAN)是一种深度学习模型,它可以生成逼真的数据样本。GAN由两个神经网络组成:生成器网络和判别器网络。生成器网络生成数据样本,而判别器网络则试图区分生成样本和真实样本。

GAN的训练过程如下:

1. 生成器网络生成一批数据样本。

2. 判别器网络对生成样本和真实样本进行分类。

3. 生成器网络根据判别器网络的反馈更新其参数,以生成更逼真的样本。

4. 判别器网络根据生成样本更新其参数,以更好地区分生成样本和真实样本。

GAN可以用于生成各种类型的数据,包括图像、文本和音频。它们在计算机视觉、自然语言处理和医疗保健等领域有着广泛的应用。

#### 代码示例

以下代码示例演示了如何使用TensorFlow训练GAN来生成MNIST数字图像:

```python

import tensorflow as tf

# 生成器网络

generator = tf.keras.Sequential([

tf.keras.layers.Dense(256, activation="relu"),

tf.keras.layers.Dense(512, activation="relu"),

tf.keras.layers.Dense(784, activation="sigmoid"),

])

# 判别器网络

discriminator = tf.keras.Sequential([

tf.keras.layers.Dense(512, activation="relu"),

tf.keras.layers.Dense(256, activation="relu"),

tf.keras.layers.Dense(1, activation="sigmoid"),

])

# 优化器

generator_optimizer = tf.keras.optimizers.Adam(learning_rate=0.0002)

discriminator_optimizer = tf.keras.optimizers.Adam(learning_rate=0.0002)

# 损失函数

generator_loss_fn = tf.keras.losses.BinaryCrossentropy(from_logits=True)

discriminator_loss_fn = tf.keras.losses.BinaryCrossentropy(from_logits=True)

# 训练循环

for epoch in range(100):

for batch in range(100):

# 生成器网络生成一批数据样本

noise = tf.random.normal([128, 100])

generated_images = generator(noise)

# 判别器网络对生成样本和真实样本进行分类

real_labels = tf.ones([128, 1])

fake_labels = tf.zeros([128, 1])

real_loss = discriminator_loss_fn(real_labels, discriminator(real_images))

fake_loss = discriminator_loss_fn(fake_labels, discriminator(generated_images))

discriminator_loss = (real_loss + fake_loss) / 2

# 生成器网络根据判别器网络的反馈更新其参数

with tf.GradientTape() as tape:

generator_loss = generator_loss_fn(real_labels, discriminator(generated_images))

gradients = tape.gradient(generator_loss, generator.trainable_weights)

generator_optimizer.apply_gradients(zip(gradients, generator.trainable_weights))

# 判别器网络根据生成样本更新其参数

with tf.GradientTape() as tape:

discriminator_loss = (real_loss + fake_loss) / 2

gradients = tape.gradient(discriminator_loss, discriminator.trainable_weights)

discriminator_optimizer.apply_gradients(zip(gradients, discriminator.trainable_weights))

```

### 5.2 强化学习

强化学习是一种机器学习方法,它允许代理通过与环境的交互来学习最佳行动。强化学习代理通过尝试不同的动作并获得奖励或惩罚来学习。

强化学习有三种主要组件:

* **代理:**与环境交互并采取行动的实体。

* **环境:**代理与之交互并提供奖励或惩罚的实体。

* **奖励函数:**定义代理采取特定行动时获得的奖励或惩罚。

强化学习算法通过迭代过程学习最佳行动:

1. 代理采取一个动作。

2. 环境根据动作提供奖励或惩罚。

3. 代理更新其策略,以增加获得奖励的可能性。

强化学习用于解决各种问题,包括机器人控制、游戏和金融交易。

#### 代码示例

以下代码示例演示了如何使用OpenAI Gym训练强化学习代理来玩Pong游戏:

```python

import gym

import numpy as np

# 创建环境

env = gym.make("Pong-v0")

# 创建代理

agent = tf.keras.models.Sequential([

tf.keras.layers.Dense(256, activation="relu"),

tf.keras.layers.Dense(2, activation="softmax"),

])

# 优化器

optimizer = tf.keras.optimizers.Adam(learning_rate=0.0002)

# 损失函数

loss_fn = tf.keras.losses.CategoricalCrossentropy()

# 训练循环

for episode in range(100):

# 重置环境

state = env.reset()

# 循环直到游戏结束

while True:

# 代理根据当前状态选择动作

action_probs = agent(state)

action = np.random.choice(2, p=action_probs)

# 执行动作并获得奖励

next_state, reward, done, info = env.step(action)

# 计算损失并更新代理

loss = loss_fn(reward, action_probs)

with tf.GradientTape() as tape:

loss = loss_fn(reward, action_probs)

gradients = tape.gradient(loss, agent.trainable_weights)

optimizer.apply_gradients(zip(gradients, agent.trainable_weights))

# 更新状态

state = next_state

# 如果游戏结束,则退出循环

if done:

break

```

# 6.1 计算机视觉

计算机视觉是模式识别在计算机科学领域的一个重要应用,其目标是让计算机能够“看懂”图像和视频。近年来,深度学习技术在计算机视觉领域取得了突破性进展,使得计算机视觉系统能够执行越来越复杂的任务。

**应用**

计算机视觉在计算机科学领域有着广泛的应用,包括:

- **图像分类:**识别图像中的物体或场景。

- **目标检测:**定位和识别图像中的特定物体。

- **图像分割:**将图像分割成不同的区域,每个区域代表不同的物体或场景。

- **图像生成:**生成逼真的图像或视频。

**展望**

计算机视觉技术仍在不断发展,未来有望在以下领域取得进一步突破:

- **自动驾驶:**计算机视觉系统将用于感知周围环境,并控制自动驾驶汽车。

- **医疗诊断:**计算机视觉系统将用于分析医学图像,辅助医生进行诊断和治疗。

- **增强现实:**计算机视觉系统将用于创建增强现实体验,将虚拟信息叠加到现实世界中。

0

0