MATLAB sort函数在并行计算中的优势:提升排序效率的新思路

发布时间: 2024-06-11 04:00:37 阅读量: 72 订阅数: 32

使用并行计算大幅提升递归算法效率

# 1. MATLAB sort函数简介

MATLAB `sort` 函数是一种强大的工具,用于对数据进行排序。它提供了一种简单而高效的方法来对向量、矩阵和多维数组中的元素进行排序。`sort` 函数具有广泛的选项和参数,允许用户根据特定标准自定义排序操作。

`sort` 函数的基本语法如下:

```

B = sort(A, dim, mode)

```

其中:

* `A` 是要排序的输入数组。

* `dim`(可选)指定要沿其进行排序的维度。默认值为 1,表示按行排序。

* `mode`(可选)指定排序模式。默认值为 `ascend`,表示升序排序。

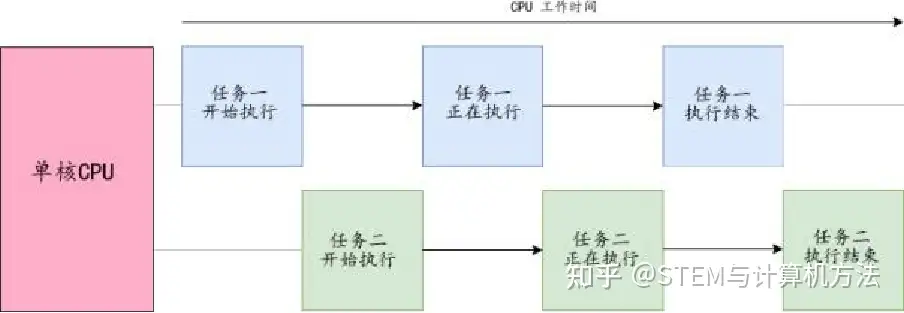

# 2.1 并行计算的原理和特点

### 并行计算的原理

并行计算是一种利用多个处理单元同时执行任务的计算方法。它通过将一个大的计算任务分解成多个较小的子任务,然后将这些子任务分配给不同的处理单元同时执行,从而提高计算效率。

### 并行计算的特点

并行计算具有以下特点:

- **并发性:**多个处理单元同时执行不同的任务。

- **可扩展性:**随着处理单元数量的增加,计算效率线性提升。

- **负载均衡:**将任务均匀分配给不同的处理单元,避免资源浪费。

- **容错性:**如果一个处理单元发生故障,其他处理单元可以继续执行任务,保证计算的可靠性。

### 并行计算的分类

并行计算根据处理单元的类型和通信方式,可以分为以下几类:

- **共享内存并行:**处理单元共享同一块内存,通过锁机制协调对共享数据的访问。

- **分布式内存并行:**处理单元拥有独立的内存,通过消息传递机制进行通信。

- **异构并行:**处理单元类型不同,例如 CPU 和 GPU,通过不同的编程模型协调协作。

### 并行计算的优势

并行计算相对于串行计算具有以下优势:

- **提高计算效率:**通过同时执行多个任务,大幅缩短计算时间。

- **解决复杂问题:**并行计算可以处理大规模、高维的数据,解决传统串行计算无法解决的复杂问题。

- **降低成本:**并行计算可以利用廉价的处理单元构建高性能计算系统,降低计算成本。

- **提高可扩展性:**并行计算系统可以随着处理单元数量的增加线性扩展,满足不断增长的计算需求。

# 3.1 sort函数的基本语法和参数

MATLAB `sort` 函数用于对数组或矩阵中的元素进行排序。其基本语法如下:

```matlab

sortedArray = sort(array, dimension, direction)

```

其中:

* `array`:要排序的数组或矩阵。

* `dimension`(可选):指定要沿其排序的维度。默认值为 1,表示沿行排序。

* `direction`(可选):指定排序方向。默认值为 'ascend'(升序),也可以指定为 'descend'(降序)。

`sort` 函数还支持以下可选参数:

* `missing`:指定如何处理缺失值。默认值为 'insignificant',表示缺失值将被视为比所有其他值都小。

* `method`:指定排序算法。默认值为 'quicksort',其他选项包括 'mergesort' 和 'heapsort'。

* `parallel`:指定是否并行化排序。默认值为 `false`,表示使用串行算法。

### 3.2 sort函数的并行化实现原理

0

0