传感器与执行器的桥梁:硬件在环仿真,连接虚拟与现实

发布时间: 2024-07-02 03:14:36 阅读量: 56 订阅数: 33

用于水下机器人仿真的GazeboROS软件包

# 1. 硬件在环仿真概述

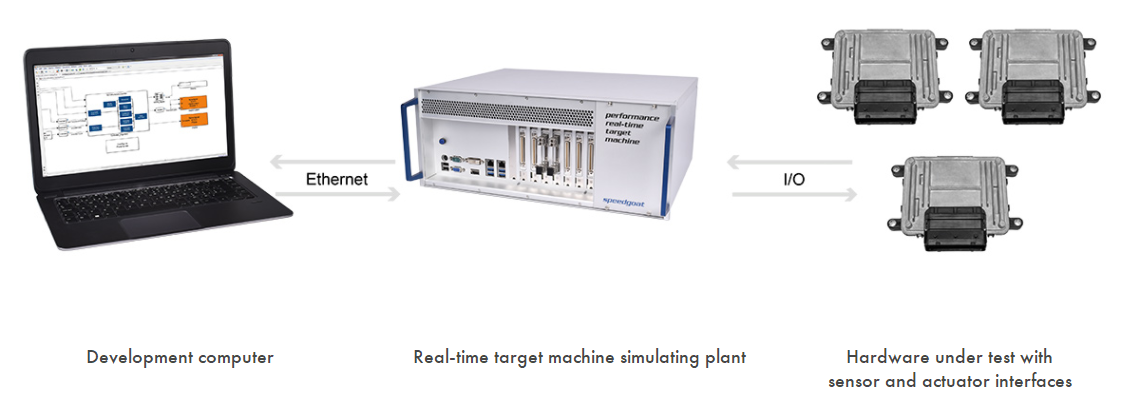

硬件在环仿真(HIL)是一种先进的测试技术,它将物理硬件与虚拟仿真环境相结合,以评估和验证嵌入式系统在真实世界条件下的性能。HIL 仿真通过创建虚拟环境,模拟实际操作条件,从而允许工程师在不依赖物理原型的情况下测试和验证系统。通过这种方式,HIL 仿真可以显著缩短开发时间,降低成本,并提高嵌入式系统设计的质量和可靠性。

# 2. 硬件在环仿真技术原理

### 2.1 虚拟仿真环境搭建

**虚拟仿真环境搭建**是硬件在环仿真技术的基础。它需要构建一个与真实硬件系统高度相似的虚拟环境,以提供硬件交互和数据处理的平台。

**虚拟仿真环境的搭建步骤:**

1. **选择仿真软件:**选择功能强大、仿真精度高的仿真软件,如MATLAB/Simulink、National Instruments LabVIEW、Ansys Fluent等。

2. **建立仿真模型:**根据真实硬件系统的结构和功能,建立相应的仿真模型。仿真模型应尽可能准确地反映硬件系统的行为和特性。

3. **配置仿真参数:**设置仿真时间步长、仿真精度、仿真终止条件等参数,以确保仿真结果的准确性和效率。

### 2.2 硬件与虚拟环境交互

**硬件与虚拟环境交互**是硬件在环仿真技术的核心。它需要建立硬件与虚拟仿真环境之间的通信机制,实现数据交换和控制。

**硬件与虚拟环境交互的方式:**

1. **I/O接口:**通过I/O接口(如USB、CAN、Ethernet等)连接硬件和仿真环境,实现数据传输和控制命令的发送。

2. **FPGA/DSP:**使用FPGA或DSP(现场可编程门阵列/数字信号处理器)作为硬件接口,实现高速数据处理和实时控制。

3. **HIL接口卡:**使用专门的HIL接口卡,提供硬件与仿真环境之间的高速、低延迟通信。

### 2.3 实时数据采集与处理

**实时数据采集与处理**是硬件在环仿真技术的关键环节。它需要从硬件系统中采集实时数据,并进行处理和分析,以评估仿真结果。

**实时数据采集与处理的步骤:**

1. **数据采集:**通过传感器、数据采集卡等设备,从硬件系统中采集实时数据。

2. **数据预处理:**对采集到的数据进行预处理,包括滤波、归一化、特征提取等。

3. **数据分析:**使用统计学、机器学习等方法,对预处理后的数据进行分析,提取有价值的信息。

4. **结果展示:**将分析结果以图形、表格等形式展示,方便用户查看和理解。

**代码块:**

```python

import numpy as np

import matplotlib.pyplot as plt

# 数据采集

data = np.loadtxt('data.csv', delimiter=',')

# 数据预处理

data = data[::100] # 降采样

data = (data - np.mean(data)) / np.std(data) # 归一化

# 数据分析

plt.plot(data)

plt.show()

```

**代码逻辑分析:**

* `np.loadtxt()`函数从CSV文件中加载数据。

* `data[::100]`对数据进行降采样,以提高处理效率。

* `(data - np.mean(data)) / np.std(data)`对数据进行归一化,以消除数据尺度差异的影响。

* `plt.plot(data)`绘制数据的折线图。

* `plt.show()`显示折线图。

**参数说明:**

* `data.csv`:数据文件路径。

* `delimiter`:数据分隔符。

* `data[::100]`:降采样因子。

* `np.mean(data)`:数据均值。

* `np.std(data)`:数据标准差。

# 3. 硬件在环仿真应用场景

### 3

0

0