Java数据库连接超时问题排查:常见原因与解决方案,快速解决连接故障

发布时间: 2024-07-24 05:23:36 阅读量: 121 订阅数: 36

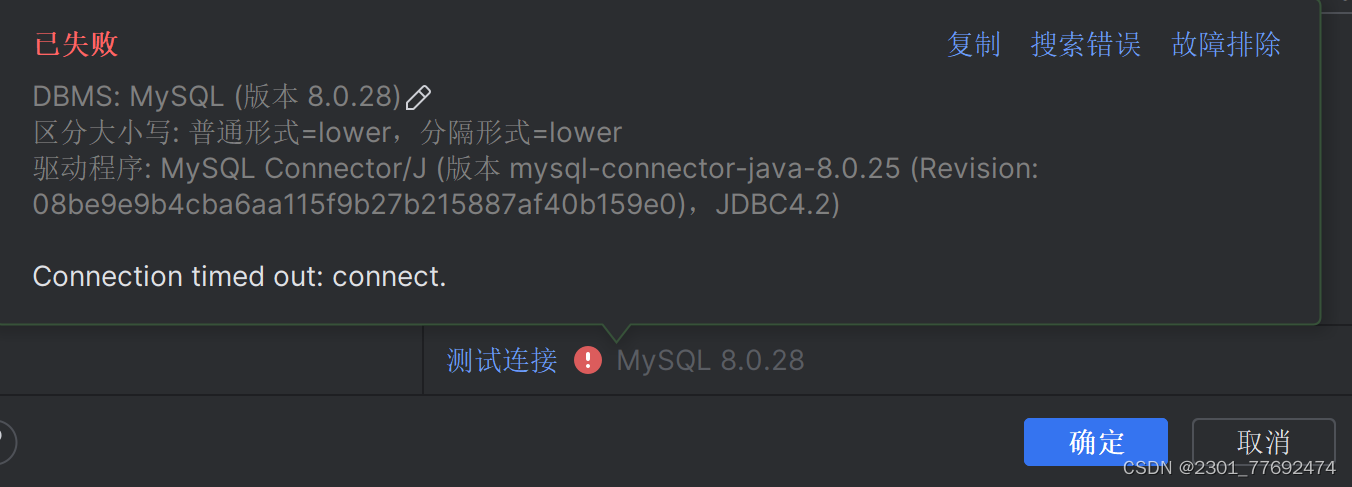

# 1. Java数据库连接超时概述**

Java数据库连接超时是指在指定时间内无法建立或维护与数据库服务器的连接。它是一个常见问题,可能导致应用程序无法访问或更新数据。超时时间通常由数据库服务器或应用程序配置,当连接在指定时间内未建立或保持活动状态时,将引发超时异常。

理解Java数据库连接超时至关重要,因为它可以帮助开发人员识别和解决导致连接失败的根本原因。通过分析连接超时原因,开发人员可以采取适当的措施来优化网络、数据库服务器和应用程序配置,从而提高连接可靠性和性能。

# 2. Java数据库连接超时原因分析

### 2.1 网络问题

#### 2.1.1 网络连接不稳定

**原因:**网络连接不稳定会导致数据包丢失或延迟,从而导致数据库连接超时。

**解决方法:**

- 检查网络电缆和路由器连接是否牢固。

- 使用网络诊断工具(例如ping和traceroute)测试网络连接的稳定性。

- 考虑使用冗余网络连接或负载均衡器来提高网络可靠性。

#### 2.1.2 防火墙或代理服务器阻碍连接

**原因:**防火墙或代理服务器可能会阻止数据库连接,导致超时。

**解决方法:**

- 确保防火墙或代理服务器已正确配置,允许与数据库服务器的连接。

- 检查防火墙或代理服务器的日志,查找有关阻止连接的条目。

- 考虑暂时禁用防火墙或代理服务器以进行测试,以排除其影响。

### 2.2 数据库服务器问题

#### 2.2.1 数据库服务器负载过高

**原因:**当数据库服务器负载过高时,它可能无法及时处理连接请求,导致超时。

**解决方法:**

- 监控数据库服务器的负载,并根据需要进行扩展或优化。

- 优化数据库查询和索引,以减少服务器负载。

- 考虑使用数据库连接池来管理连接,并限制同时连接的数量。

#### 2.2.2 数据库服务器配置不当

**原因:**数据库服务器配置不当,例如连接超时值设置过低,可能会导致超时。

**解决方法:**

- 检查数据库服务器的配置,并确保连接超时值已适当设置。

- 调整连接超时值,以提供更多时间建立连接。

- 考虑使用连接池,它可以自动管理连接超时。

### 2.3 应用程序问题

#### 2.3.1 连接池配置不当

**原因:**连接池配置不当,例如最大连接数设置过低,可能会导致超时。

**解决方法:**

- 检查连接池的配置,并确保最大连接数已适当设置。

- 调整最大连接数,以允许更多并发连接。

- 考虑使用连接池监视工具,以监控连接池的使用情况并进行调整。

#### 2.3.2 SQL语句优化不佳

**原因:**优化不佳的SQL语句可能会导致数据库服务器处理时间过长,从而导致超时。

**解决方法:**

- 分析SQL语句,并优化查询以提高性能。

- 使用索引和优化器提示,以减少数据库服务器的处理时间。

- 考虑使用数据库性能分析工具,以识别和解决性能问题。

# 3.1 网络优化

**3.1.1 优化网络连接稳定性**

* **检查网络硬件:**确保网络电缆、路由器和交换机正常工作,没有松动或损坏。

* **优化网络拓扑

0

0