【紧急优化】:MapReduce Shuffle和排序的实战解决方案(快速解决大数据瓶颈)

发布时间: 2024-10-30 14:51:49 阅读量: 26 订阅数: 34

# 1. MapReduce Shuffle机制的理论基础

## 1.1 Shuffle机制的角色与重要性

MapReduce Shuffle机制是大数据处理框架的核心环节之一,它涉及到从Map任务输出到Reduce任务输入的数据传输过程。Shuffle过程不仅负责数据的排序、分组和转移,还直接影响整个作业的执行效率和性能。理解Shuffle的理论基础对于优化大数据处理至关重要。

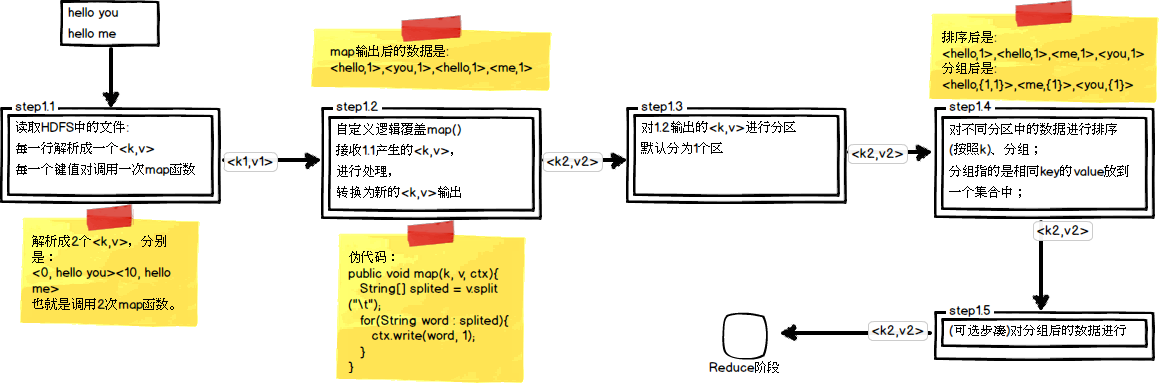

## 1.2 Shuffle过程的主要步骤

Shuffle过程大致可以分为以下几个步骤:Map端的数据处理,包括写入磁盘和进行局部排序;Shuffle阶段,即Map端输出的数据经过网络传输到Reduce端;Reduce端接收数据,进行合并和最终排序。每个步骤都有其独特的作用和优化潜力。

## 1.3 Shuffle优化的理论依据

优化Shuffle过程需要深入理解其内部机制,包括缓冲策略、数据分区、压缩算法等。通过分析I/O操作的瓶颈、网络通信的开销、以及内存与CPU资源的利用,可以实施有效的性能优化策略。在后续章节中,我们将详细探讨这些理论依据,并提供具体的优化方法。

# 2. MapReduce排序过程的深入解析

## 2.1 排序前的准备:数据分片和分区

### 2.1.1 数据分片的原理及作用

在MapReduce中,数据分片是一个重要的前期准备工作,它涉及将输入数据切割成更小的部分,以便能够并行处理。这一过程对排序和Shuffle阶段都有影响,因为分片的数量和大小直接关系到后续任务的负载均衡和性能。

数据分片的核心作用在于:

1. **负载均衡**:通过分片可以确保每个Map任务处理的数据量大致相同,避免了某些任务过载而其他任务空闲的情况。

2. **并行处理**:分片使得Map任务可以独立进行,各个任务间互不干扰,这极大地提高了数据处理的效率。

3. **局部性优化**:合理分片可以使得数据尽可能地靠近它将要被处理的位置,减少网络传输和I/O操作。

分片是基于输入文件的逻辑块来完成的,通常由Hadoop框架中名为`InputFormat`的组件来管理。开发者可以自定义`InputFormat`来控制如何将输入数据切分成分片。

### 2.1.2 分区策略的多样性与选择

数据分区是MapReduce中一个关键的步骤,它负责在Shuffle之前将Map端的输出数据分配到相应的Reduce任务中。这一步骤确保每个Reduce任务只接收到它应该处理的数据。

分区策略的选择取决于应用需求:

1. **默认分区器**:大多数情况下,使用默认的分区器是合适的。它基于哈希算法将键值分配到Reduce任务,保持了数据的随机分布。

2. **自定义分区器**:当默认分区无法满足特定需求时,可以自定义分区策略。例如,如果需要将数据按照特定属性进行分组,就可能需要实现一个自定义分区器。

选择正确的分区策略可以减少数据倾斜的问题,并且优化网络带宽的使用。例如,在进行关键字统计时,如果数据分布严重不均,可能导致某些Reduce任务处理的数据量远大于其他任务,造成效率瓶颈。

## 2.2 Map端Shuffle的关键步骤

### 2.2.1 Map输出的局部排序和写盘

在Map阶段完成后,Map任务会将输出结果缓存到内存中的环形缓冲区。当环形缓冲区达到一定阈值时,数据会被写入到磁盘,这个过程被称为Spill(溢写)。

在写盘之前,会进行一次局部排序,具体步骤如下:

1. **排序**:数据根据key进行局部排序,确保相同key的数据连续存储。

2. **分区**:根据分区策略将数据分配到不同的分区中。

3. **写盘**:将排序后的数据写入到磁盘上的临时文件。

这个过程需要注意的是,内存缓冲区和磁盘的写入速度是不匹配的,为了避免写入速度成为瓶颈,需要合理设置内存和磁盘的使用策略。

### 2.2.2 网络传输过程中的缓冲与压缩

在Map任务完成后,Reduce任务开始执行。在此阶段,Reduce任务会从所有Map任务拉取数据。由于网络带宽有限,因此需要通过缓冲和压缩技术来优化数据的传输。

关键步骤如下:

1. **缓冲**:为了减少网络传输次数,Hadoop采用增量拉取的方式,即Reduce任务不会一次性拉取所有数据,而是按照一定策略逐步拉取。

2. **压缩**:在传输之前,对数据进行压缩,可以显著减少传输时间。压缩算法的选择对性能有较大影响。

```java

// 示例代码:启用Map输出压缩

conf.setBoolean("***press", true);

conf.setClass("***press.codec",

BZip2Codec.class, CompressionCodec.class);

```

在上述代码中,通过设置`***press`为`true`启用Map输出压缩,并指定压缩编解码器为`BZip2Codec`,这可以优化网络传输过程,尤其是在处理大量数据时。

## 2.3 Reduce端Shuffle的执行流程

### 2.3.1 远程拉取Map输出数据

在Shuffle阶段,Reduce任务需要从每个Map任务拉取对应分区的数据。这个过程分为几个步骤:

1. **确定数据源**:Reduce任务根据分区信息确定需要从哪些Map任务拉取数据。

2. **拉取数据**:Reduce任务向Map任务发起远程请求,拉取数据。

3. **合并流**:拉取的数据在到达Reduce端之前,会通过网络流进行合并,形成一个连续的数据流。

网络I/O的效率在这一阶段是瓶颈之一,因此合理管理网络带宽和减少数据传输量是优化的关键。

### 2.3.2 合并和排序拉取的数据

拉取到Reduce端的数据首先需要经过合并和排序,以便于后续处理。

合并和排序的步骤:

1. **内存排序**:如果数据量较小,可以先加载到内存进行排序。

2. **外排序**:对于大量数据,通常需要使用外部排序算法,将数据写入到磁盘,再进行合并和排序。

```java

// 示例代码:配置排序和合并参数

conf.setInt("mapreduce.job.map.sort.spill.percent", 60);

conf.setInt("mapreduce.job.reduce.merge.inmem.threshold", 10000);

```

在上述配置中,`mapreduce.job.map.sort.spill.percent` 设置为60%,意味着当环形缓冲区达到60%时会开始溢写。`mapreduce.job.reduce.merge.inmem.threshold` 设置为10000,表示当拉取的文件达到10000个时,会开始执行内存合并。这些参数的选择需要根据实际数据量和资源情况来调整,以达到最佳性能。

## 2.3.3 Reduce端的最终排序

经过合并和排序的数据会被送入Reduce阶段进行最终处理。在这个阶段,数据已经根据key排序好,并且同一key的数据会连续地出现在一起。

最终排序的关键步骤包括:

1. **合并排序**:在内存中对所有Map输出的数据进行合并排序。

2. **分组**:将排序好的数据进行分组,即将具有相同key的value值归并到一起。

```java

// 示例代码:自定义Comparator进行排序

public class MyGroupingComparator extends WritableComparator {

public MyGroupingComparator() {

super(MyKey.class, true);

}

@Override

public int compare(WritableComparable a, WritableComparable b) {

MyKey key1 = (MyKey) a;

MyKey key2 = (MyKey) b;

return key1.getGroupField().compareTo(key2.getGroupField());

}

}

```

在上面的示例中,`MyKey`是一个自定义的Writable类,`getGroupField()`方法用于获取用于分组的字段。通过继承`WritableComparator`并重写`compare`方法,我们可以定义自己的分组逻辑,使得具有相同组字段的数据视为一组,从而进行正确的分组。

通过上述步骤,Reduce端Shuffle阶段的数据准备完毕,接下来就可以执行用户定义的Reduce函数,对每个分组的数据执行相应的计算操作。

# 3. Shuffle性能瓶颈分析与优化策略

## 3.1 识别性能瓶颈:CPU、内存和I/O

### 3.1.1 资源使用情况的监控与分析

在MapReduce作业执行过程中,性能瓶颈通常发生在CPU、内存或I/O资源的使用上。要准确识别瓶颈,就需要监控作业的资源使用情况。通常,我们可以使用YARN的ResourceManager Web UI来查看各个任务的资源使用情况,包括CPU利用率、内存使用量和磁盘I/O速度等指标。

```mermaid

graph TD

A[开始监控] --> B[收集系统性能数据]

B --> C[分析CPU、内存和I/O的使用情况]

C --> D{是否存在性能瓶颈?}

D -- 是 --> E[定位瓶颈所在]

D -- 否 --> F[继续监控并分析]

E --> G[采取优化措施]

F --> H[定期检查和预防]

```

监控和分析时,可以利用JVM工具如jstat

0

0