【高效实践】:MapReduce Shuffle优化案例的深入分析(大数据排序效率专家指南)

发布时间: 2024-10-30 15:18:06 阅读量: 19 订阅数: 27

# 1. MapReduce Shuffle机制概述

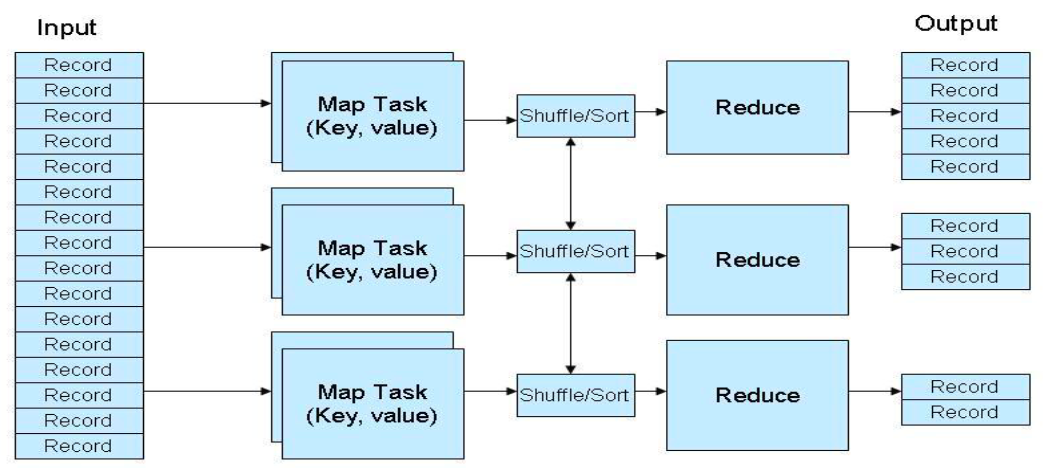

MapReduce Shuffle机制是Hadoop框架中一个复杂但至关重要的过程,它涉及到从Map任务输出到Reduce任务输入的数据传输。本章首先简要介绍Shuffle机制的基本概念及其在整个MapReduce作业中的作用,随后概述Shuffle过程的数据流动,以及它是如何影响大数据作业的效率和性能。

MapReduce模型的核心在于将大数据集分解为可管理的小块,并并行处理这些数据块。在这个过程中,Shuffle负责将Map阶段的中间数据按照某种排序规则传输到Reduce阶段,确保数据的正确分类和排序,为最终的聚合操作提供基础。

为了理解Shuffle,我们可以将其比作一个“数据快递员”,它确保Map任务产生的数据能够被安全、有序地传送到Reduce任务。Shuffle过程的效率直接决定了MapReduce作业的执行时间和资源消耗,因此,深入理解并掌握Shuffle机制的优化对于大数据处理至关重要。下面章节将详细探讨Shuffle的具体过程及其优化方法。

# 2. 优化Shuffle的关键理论

### 2.1 Shuffle过程解析

MapReduce的Shuffle过程是在Map阶段和Reduce阶段之间发生的一系列数据交换操作。它包括了数据的读取、排序、合并、分区和传输等步骤。Shuffle过程的性能直接关系到整个MapReduce作业的执行效率。

#### 2.1.1 Map阶段的Shuffle操作

Map阶段Shuffle操作的核心是生成中间数据,并将其输出到本地磁盘。关键步骤包括:

- **数据分区(Partitioning)**:首先,Map任务的输出需要按照Partition进行分割,以确保每个Reduce任务能收到属于自己的数据。这个过程涉及到了key-value对的哈希计算。

- **排序(Sorting)**:对分区后的数据进行排序。排序操作保证了每个Reducer接收到的数据是有顺序的,这对后续的合并操作至关重要。

- **溢写(Spill)**:将排序后的数据写入本地磁盘。由于内存有限,需要定期将内存中的数据溢写到磁盘上,这个过程也称为Shuffle的溢写(Spill)。

```java

// 伪代码示例

List<IntermediateKey> keys = getKeysFromMemory();

List<IntermediateValue> values = getValuesFromMemory();

List<Pair<IntermediateKey, IntermediateValue>> pairs = zip(keys, values);

List<Pair<IntermediateKey, IntermediateValue>> sortedPairs = sortPairs(pairs);

// Spill to disk...

```

#### 2.1.2 Reduce阶段的Shuffle操作

Reduce阶段Shuffle操作的主要任务是将Map阶段的数据进行复制和合并。关键步骤包括:

- **数据拉取(Fetch)**:Reduce任务开始时,主动从各个Map节点拉取对应Partition的数据。这些数据需要根据Reduce任务的标识进行筛选。

- **合并(Merge)**:从不同的Map节点拉取的数据可能有重叠部分,需要进行合并操作。合并的目的在于为后续的排序和处理做准备。

- **最终排序(Final Sort)**:合并后的数据再次进行排序,为Reduce操作的执行做准备。

```java

// 伪代码示例

List<Pair<IntermediateKey, IntermediateValue>> dataFromMapTasks = fetchDataFromMapTasks(partitionKey);

List<Pair<IntermediateKey, IntermediateValue>> mergedData = merge(dataFromMapTasks);

List<Pair<IntermediateKey, IntermediateValue>> sortedData = sortPairs(mergedData);

// Perform reduce tasks...

```

### 2.2 影响Shuffle性能的因素

#### 2.2.1 网络带宽与数据传输

网络带宽是影响Shuffle性能的重要因素。数据传输速度的快慢直接关联到Map和Reduce任务之间的通信效率。高带宽可以保证大量数据快速传输,但网络延迟和拥塞也会影响性能。

#### 2.2.2 磁盘I/O与数据持久化

磁盘的读写速度对于Shuffle过程中的数据持久化操作至关重要。磁盘I/O瓶颈会降低数据处理速度,提高整体作业的执行时间。

#### 2.2.3 JVM性能与垃圾回收

JVM性能及垃圾回收机制也会对Shuffle过程产生影响。不当的内存管理和频繁的垃圾回收可能会导致系统响应时间变长。

### 2.3 理论模型与性能评估

#### 2.3.1 大数据处理的理论模型

要深入理解Shuffle优化,就需要掌握大数据处理的理论模型。这些模型有助于我们量化分析Shuffle操作的性能瓶颈。

#### 2.3.2 性能评估方法与工具

性能评估是优化过程的重要环节。使用正确的评估方法和工具可以帮助我们准确测量Shuffle操作的效率和瓶颈所在。常用的工具有Apache Hadoop自带的计时器、YARN的资源管理器以及专门的性能分析工具,如JProfiler和VisualVM等。

以上就是对Shuffle过程解析和影响Shuffle性能因素的理论基础。在下一章节,我们将讨论Shuffle优化实践技巧。

# 3. Shuffle优化实践技巧

优化MapReduce的Shuffle过程是提高大数据处理性能的重要环节。在本章节中,我们将深入探讨网络传输、磁盘I/O和JVM调优等方面的实践技巧,通过具体的技术应用和参数调整,达到提升Shuffle性能的目的。

## 3.1 网络传输优化

### 3.1.1 压缩技术的应用

在大数据处理场景中,网络传输的数据量往往巨大。通过压缩技术,可以在保证数据完整性的同时减少网络负载,从而提高数据传输效率。常见的压缩技术有LZ4、Snappy等。

- **LZ4**: LZ4是一种开源的压缩算法,它强调压缩和解压的速度,特别适合于网络传输优化。LZ4的压缩速度非常快,解压速度更是接近原始数据的读取速度。

- **Snappy**: Snappy由Google开发,旨在提供相对较好的压缩率,同时保持快速的压缩与解压速度。它被广泛应用于Hadoop生态系统中。

在MapReduce任务中,合理配置压缩技术可以显著减少数据在Map阶段输出到网络前的序列化大小,以及Reduce阶段从网络接收数据时的解压时间。

### 3.1.2 数据序列化优化

数据序列化是在Map和Reduce任务间传输数据的必要过程。选择合适的序列化框架能够有效减少数据传输量,加快网络传输速度。常用的序列化框架有Avro、Protocol Buffers、Thrift等。

- **Avro**: Avro提供了一种紧凑的二进制序列化格式,同时支持复杂数据结构。它在Hadoop中用于远程过程调用(RPC)通信。

- **Protocol Buffers**: Google开发的Protocol Buffers是一种轻量级、高效的数据序列化框架。它定义了一种紧凑

0

0