【MapReduce Shuffle】:性能优化的理论与实践(大数据处理速度提升指南)

发布时间: 2024-10-30 14:59:09 阅读量: 32 订阅数: 34

# 1. MapReduce Shuffle概述

MapReduce Shuffle是Hadoop生态系统中最为关键的数据处理过程之一,它负责在Map和Reduce任务间传递数据。理解Shuffle的工作机制,对于提高大数据处理效率至关重要。

## 1.1 Shuffle的基本概念

Shuffle可被视为一种数据的"洗牌"过程,在Map阶段产生的中间数据被"洗牌"并传递到Reduce阶段。这一过程涉及到数据的分区、排序、合并以及传输,是MapReduce程序性能的瓶颈所在。

## 1.2 Shuffle的重要性

Shuffle的性能直接影响到整个MapReduce作业的执行效率。如果Shuffle处理不当,不仅会导致作业执行缓慢,还可能引发数据倾斜问题,加剧资源的竞争。因此,对Shuffle的深入研究与优化可以大幅提升大数据处理系统的整体表现。

# 2. Shuffle过程的理论基础

### 2.1 MapReduce框架原理

#### 2.1.1 MapReduce的工作流程

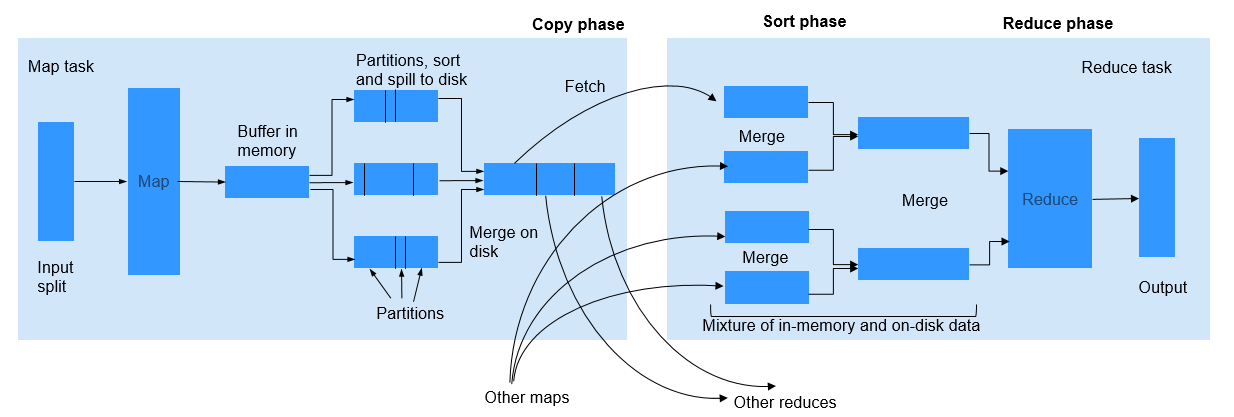

MapReduce是一种编程模型,用于处理和生成大数据集,广泛应用于大规模数据处理场景。其工作流程主要包括以下几个阶段:输入数据分割、Map处理、Shuffle和Reduce处理、以及输出结果。

- 输入数据分割:输入的数据集首先被分割成固定大小的块,这些块由不同的Map任务并行处理。

- Map处理:Map任务读取输入数据块,并对这些数据块中的数据应用用户定义的Map函数。Map函数的输出是中间键值对集合,即(k1, v1)。

- Shuffle:Shuffle阶段是MapReduce中连接Map和Reduce阶段的关键过程。它包括排序和分组,以及将Map的输出结果根据键值对分发给相应的Reduce任务。

- Reduce处理:Reduce任务接收到Shuffle阶段排序后的键值对,对具有相同键的所有值应用Reduce函数,输出最终的结果集合。

- 输出结果:最终结果通常保存在HDFS或者其他存储系统中,供后续的处理或者分析使用。

Shuffle过程在MapReduce中起到了至关重要的作用,因为它直接关系到数据传输的效率和最终的计算性能。为了达到最优的性能,优化Shuffle过程是关键。

#### 2.1.2 Shuffle的定义与作用

Shuffle定义为MapReduce计算模型中,将Map端的数据按照特定的键值进行排序、分区,并传输到Reduce端的过程。Shuffle是数据在网络中移动的阶段,其作用可以概括为:

- 数据排序:保证相同键的数据会被发送到同一个Reduce任务,以便于进行后续的聚合操作。

- 数据分区:确保数据均匀分布到各个Reduce任务,避免数据倾斜导致的任务处理性能不均衡。

- 网络传输:优化Shuffle可以减少数据在网络中的传输量,缩短数据传输时间,提升整体处理效率。

Shuffle的高效运作对整个MapReduce作业的执行时间有着决定性的影响。通过深入理解Shuffle机制,我们可以在实践中更好地进行性能优化。

### 2.2 Shuffle的核心组件分析

#### 2.2.1 Shuffle阶段的关键组件

Shuffle过程中涉及多个关键组件,包括Map端输出、Spill机制、Partitioner、Sort Comparator以及Reduce端读取等。

- Map端输出:Map任务产生的中间输出首先被写入本地磁盘。这个过程中涉及到缓冲机制和溢写操作。

- Spill机制:当Map任务的内存缓存达到阈值时,溢写操作会被触发。将内存中的数据按照键值进行部分排序并写入磁盘的过程称为Spill。

- Partitioner:Partitioner组件负责将Map端的输出数据根据键值进行分区,以确保数据能正确地路由到对应的Reduce任务。

- Sort Comparator:排序操作确保了相同键的数据能够聚集在一起,为后续的分区和传输做准备。

- Reduce端读取:Reduce任务从网络读取经过Shuffle处理的数据,并准备进行聚合操作。

以上关键组件的协调工作,是保证MapReduce高效运行的基础。

#### 2.2.2 Shuffle与排序的交互机制

Shuffle过程中的排序是一个非常重要的步骤,它确保了数据在传输到Reduce端前已经被正确地排序和分区。排序机制通常发生在Spill阶段,然后是在最终写入磁盘之前。

排序的交互机制主要涉及以下几个步骤:

- 内存排序:在内存中的数据达到溢写阈值之前,先在内存中进行快速排序。

- Spill排序:溢写到磁盘的数据同样需要进行排序,这通常使用外部排序算法,如归并排序。

- 终排序:在Shuffle过程中,所有的Map任务输出都是局部有序的,当这些数据被拉取到Reduce端时,会进行最终的全局排序。

理解Shuffle与排序的交互机制,对于诊断Shuffle过程中的性能瓶颈和优化Shuffle性能至关重要。

# 3. Shuffle性能优化理论

## 3.1 瓶颈问题识别与分析

### 3.1.1 网络带宽与I/O限制

在网络通信中,带宽指的是数据传输的最大速率。在MapReduce的Shuffle阶段,大量的中间数据需要在Map和Reduce任务之间传输。当网络带宽不足以支撑这些数据的快速传输时,网络延迟将成为影响Shuffle性能的瓶颈。

在优化Shuffle性能时,需要评估网络带宽对性能的限制。首先,可以通过网络压力测试获取网络的基准性能指标。其次,分析MapReduce作业的日志,查看Shuffle阶段的网络传输数据量是否接近网络带宽的上限。如果确定是网络带宽限制了性能,那么可能需要升级网络硬件或优化网络使用方式,如增加带宽或减少不必要的网络流量。

此外,I/O瓶颈通常出现在磁盘读写操作中。由于Shuffle阶段需要频繁地从磁盘读取中间数据,再写入磁盘中,因此I/O性能对Shuffle速度有很大影响。提高I/O性能可以采取的措施包括使用更快的磁盘(如SSD)、增加磁盘数量、优化磁盘的读写模式等。

### 3.1.2 内存管理与GC影响

在MapReduce作业中,内存是影响Shuffle性能的另一个重要因素。Map和Reduce任务都需要消耗内存来处理数据。内存管理不当会导致频繁的垃圾回收(GC)操作,严重影响性能。

优化内存的策略包括合理配置内存大小、使用内存池技术以及优化数据处理逻辑。合理配置内存大小是指根据任务的特点和需求,为Map和Reduce任务分配合适的内存。内存池技术可以减少内存分配和回收的开销。对于数据处理逻辑,可以通过减少内存中的数据拷贝次数、压缩中间数据来减少内存使用。

Java虚拟机(JVM)的垃圾回收机制也对性能有很大影响。不同的GC策略会对应用的响应时间和吞吐量产生影响。针对MapReduce作业,可以选择合适的GC策略和参数,以减少GC对Shuffle阶段的影响。

## 3.2 优化策略的理论基础

### 3.2.1 数据倾斜问题的理论探讨

数据倾斜是Shuffle过程中常见的性能问题,指的是数据在Map和Reduce任务之间分布不均。某些任务处理的数据量远大于其他任务,导致负载不均衡。数据倾斜通常发生在具有重复键值的记录上,尤其是当这些键值过于集中时。

针对数据倾斜问题,理论上可以采用多种策略。一种常见的方法是增加Map任务的数量,从而可以对具有倾斜键值的数据进行更细粒度的划分。另一种方法是通过重写Map函数来防止键值的重复,或者在Map输出中添加随机前缀以分散相同键值的数据。

### 3.2.2 参数调优的理论依据

在MapReduce框架中,存在大量可供调整的配置参数,这些参数对作业的执行效率有重要影响。理论分析表明,合理的参数配置可以最大化资源利用率,从而提升Shuffle性能。

参数调优的理论依据包括对任务执行的各个环节的深入理解。例如,`mapreduce.task.io.sort.factor`参数控制了Map输出排序时使用的内存缓冲区大小。通过调整此参数,可以控制排序过程的内存使用和磁盘I/O,避免因为内存不足导致频繁的磁盘写操作。类似地,`mapreduce.reduce.shuffle.parallelcopies`参数决定了Reduce任务从Map任务拉取数据时的并行度。提高并行度可以加快数据传输的速度,但同时也会增加系统的负载。

## 3.3 实际案例的理论分析

### 3.3.1 经典案例研究

一个经典案例是某大型互联网公司处理日志数据的MapReduce作业。在这个案例中,公司发现其Shuffle阶段耗时异常,严重影响了整体作业的执行效率。通过分析,他们发现数据倾斜问题极为严重,特定的键值对应的数据量远远超过其他键值。

在理论的指导下,他们采取了优化措施。首先,增加了Map任务的数量,使得数据更加分散。然后,通过在键值上增加随机前缀,打破了原本的倾斜模式。最终,Shuffle阶段的性能得到了显著提升。

### 3.3.2 解决方案的理论对比

除了数据倾斜问题,该公司的优化策略还包括了内存管理和GC优化。通过对比不同的内存优化理论,他们选择了适合其作业特点的内存池技术和GC参数配置。

在GC策略上,他们对比了不同的垃圾回收算法和参数设置。最终选择了G1 GC,并通过调整相关参数减少了GC带来的停顿时间。通过这一系列的理论分析和对比,公司的Shuffle性能得到了整体优化。

## 3.2 优化策略的理论基础

### 3.2.1 数据倾斜问题的理论探讨

数据倾斜是指在MapReduce作业的Shuffle过

0

0