【监控与故障】:MapReduce Shuffle过程的全面分析(立即排除大数据处理问题)

发布时间: 2024-10-30 15:02:44 阅读量: 26 订阅数: 34

mapreduce基础实战-大数据处理技术MapReduce的基础应用与实战案例-词频统计详解

# 1. MapReduce Shuffle过程概述

MapReduce作为一种分布式计算框架,被广泛应用于大数据处理场景中。Shuffle过程是MapReduce中最具挑战性的阶段之一,它负责在Map和Reduce任务之间传输数据,并且涉及数据的排序、合并以及可能的分组。本章节首先对Shuffle过程进行一个高层次的概述,揭示其在整体数据处理流程中的位置和作用,为后续章节深入探讨其理论基础、优化策略和故障排查提供背景知识。我们将简要介绍Shuffle过程在MapReduce工作流程中的关键角色,包括它如何影响整个作业的性能和稳定性。此外,本章节也将概述Shuffle过程中常见的问题及其影响,为读者提供一个全面而简洁的入门知识。

# 2. Shuffle过程的理论基础

## 2.1 MapReduce模型简介

### 2.1.1 MapReduce的工作原理

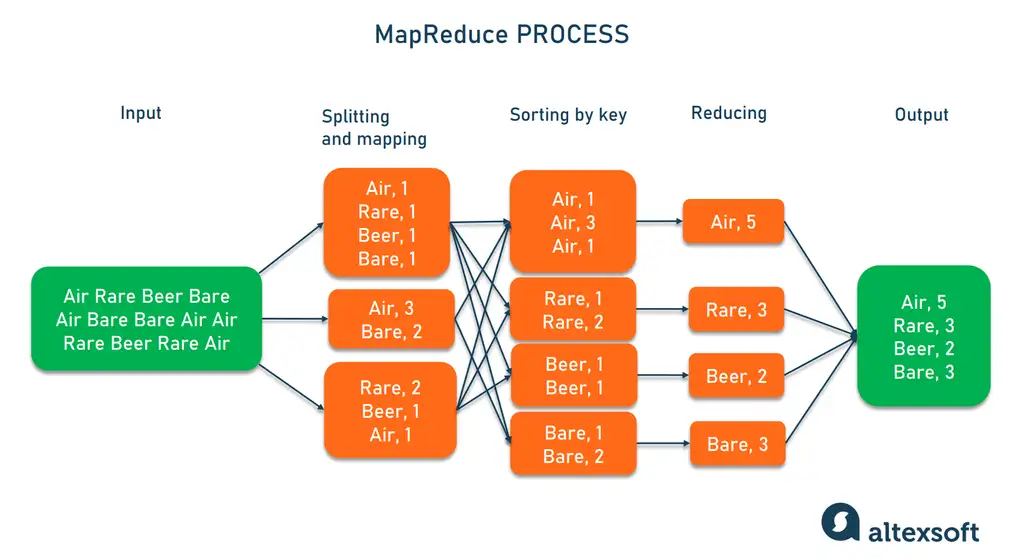

MapReduce是一种编程模型,用于处理和生成大数据集,其工作原理主要由两个阶段组成:Map阶段和Reduce阶段。

- **Map阶段**:在这个阶段,Map函数接受输入数据,并对其进行处理,生成一系列中间的键值对(key-value pairs)。这些键值对会被传递到Reduce阶段。

- **Reduce阶段**:在这个阶段,Reduce函数接收来自Map阶段的中间数据,并进行合并处理。它按照键(key)聚合所有的值(values),并输出最终的结果。

MapReduce的这种设计理念使得它非常适合于并行处理大量数据的场景。

```python

# MapReduce的一个简化伪代码示例

def map(document):

for each word in document:

emit_intermediate(word, 1)

def reduce(word, values):

result = 0

for count in values:

result += count

emit(word, result)

```

### 2.1.2 MapReduce的关键组件

MapReduce模型主要由以下几个关键组件构成:

- **Job Tracker**:负责整个作业的调度和监控,包括分配Map和Reduce任务给Task Trackers,监控它们的状态,重新执行失败的任务等。

- **Task Tracker**:在集群中的每个节点上运行,负责执行具体的Map和Reduce任务,并向Job Tracker汇报任务状态。

- **Job**:用户提交的MapReduce作业,通常包含一个Map函数,一个Reduce函数和输入输出数据集。

- **Task**:Job的细分,一个Job可以分解为多个Map任务和Reduce任务。

- **Input Split**:输入数据被切分成的逻辑上相互独立的片段,Map任务处理的就是这些片段。

- **Shuffle**:这个过程在Map任务和Reduce任务之间,负责将Map输出的结果根据key重新分组,然后传输给Reduce任务。

## 2.2 Shuffle过程的步骤分解

### 2.2.1 Map端Shuffle

Map端Shuffle主要负责处理Map任务的输出,确保这些输出能够按照Reduce任务的要求进行排序和分组。

- **排序**:Map任务输出的键值对首先会进行排序。排序的目的是把相同键的记录聚合在一起,便于后续的合并操作。

- **分区**:排序完成后,数据会根据设定的分区函数(Partitioner)进行分区,以保证具有相同键的所有记录被发送到同一个Reduce任务。

- **写入本地磁盘**:排序并分区后的数据会被写入到Map任务节点的本地磁盘上。这是为了防止Map任务结束后数据丢失。

### 2.2.2 Reduce端Shuffle

Reduce端Shuffle主要是从Map节点获取数据,并准备好供Reduce函数处理的过程。

- **复制(Fetch)**:Reduce任务启动后,首先会从Map任务节点复制已排序的输出数据。这个过程是并行进行的,因为每个Reduce任务可以同时从多个Map节点拉取数据。

- **合并(Merge)**:复制到Reduce节点的数据是有序的,但是可能来自不同的Map节点。Reduce任务需要对这些数据进行合并操作,形成一个大的有序的数据集。

- **Shuffle过程**:最终Shuffle过程完成了数据的排序、分区和合并,为Reduce函数提供了连续有序的数据输入。

## 2.3 Shuffle过程中的关键问题

### 2.3.1 瓶颈问题及分析

Shuffle过程中的瓶颈问题主要表现为数据倾斜和网络传输压力。

- **数据倾斜**:指的是在Map或Reduce阶段,数据在各个任务之间分配不均,导致某些任务处理的数据量远大于其他任务。这会导致整个作业的执行效率下降。

- **网络传输压力**:在Shuffle过程中,Map节点需要将大量数据传输到Reduce节点。如果数据量过大,或者网络带宽不足,就会产生网络瓶颈,影响整体的作业性能。

### 2.3.2 数据倾斜的影响与对策

数据倾斜的解决对策通常包括以下几种方法:

- **重新设计Key的生成逻辑**:使得数据更加均匀地分配到不同的Key上。

- **使用Combiner**:在Map端执行部分Reduce操作,减少数据量的传输。

- **增加Map任务数量**:通过增加Map任务数量来分散数据,从而减轻单个任务的压力。

- **自定义Partitioner**:通过定制分区器确保数据更加均匀地分布到各个Reduce任务。

这些方法可以根据具体的应用场景和数据特性进行选择和应用。

# 3. Shuffle过程的性能优化

## 3.1 编码和压缩的优化策略

### 3.1.1 数据序列化格式的选择

在MapReduce的Shuffle过程中,数据序列化格式的选择对性能有显著影响。序列化是数据在内存中转换为能被网络传输或写入磁盘的格式的过程。选择合适的序列化格式可以大幅度减少网络传输和磁盘I/O的时间,从而提高整体Shuffle性能。

Apache Hadoop默认使用的是TextOutputFormat和TextInputFormat,这些格式使用Java的序列化机制,它虽然简单但并不是最优的序列化方式,因为其数据通常比较大且解析较慢。在性能要求较高的场景下,推荐使用高效的序列化框架,如Avro、Thrift或Protocol Buffers。

Avro是Hadoop生态系统中常用的序列化框架,它支持二进制格式,但仍然具有良好的跨语言特性。Thrift和Protocol Buffers则主要是由Facebook和Google开发,分别用于支持Thrift协议和ProtoBuf协议的数据交换,它们的数据体积小,解析速度快,适合用于Shuffle过程中的网络传输和磁盘读写。

### 3.1.2 压缩算法的影响分析

压缩是Shuffle优化策略中极为重要的一步,它能有效减少磁盘空间的占用以及网络I/O的负载。合理选择压缩算法和压缩级别可以显著提升性能。在MapReduce中,常用的压缩算法包括但不限于:Snappy, LZO, Deflate和Gzip。

Snappy由Google开发,它在提供较好的压缩比的同时,优化了压缩和解压的速度。因此,Snappy在实时或近实时处理场景中非常受欢迎。LZO压缩算法在解压速度方面有出色的表现,适合于读取密集型的应用场景。然而,LZO通常需要预处理(索引),这会增加额外的存储开销。Deflate和Gzip提供了较高的压缩比,但压缩和解压的速度相对较低,因此适用于存储密集型的场景。

评估压缩算法时,需要考虑以下几个因素:

- 数据访问模式:需要频繁读取的场景应选择解压速度快的算法,而对存储空间要求更高的场景则应选择压缩比高的算法。

- 硬件资源:CPU性能越强,可以选择压缩率更高,但解压速度相对低的算法。

- 网络带宽:在网络传输中,通过压缩节省带宽可以减少传输时间和成本。

在选择压缩算法时,建议根据实际应用场景和资源限制进行综合评估,以实现最优的性能和成本平衡。

### 3.1.3 代码示例

以下是一个简单的Hadoop MapReduce程序,演示了如何自定义输出格式以使用Snappy压缩算法:

```java

public class ShuffleOptimizationExample {

public static class TokenizerMapper extends Mapper<Object, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

public static class IntSumReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable va

```

0

0