【调优之道】:MapReduce Shuffle机制在大数据环境下的深度解析

发布时间: 2024-10-30 15:09:30 阅读量: 4 订阅数: 10

# 1. MapReduce Shuffle机制概述

MapReduce Shuffle机制是Hadoop分布式计算框架中的核心组件,负责在Map和Reduce任务之间高效地传输数据。Shuffle过程涉及到数据的排序、分组、聚合等操作,是影响MapReduce性能的关键因素之一。理解Shuffle的工作原理对于优化大数据处理作业至关重要。本章将简要介绍Shuffle的基本概念,并概述其在大数据处理中的重要性,为后续章节深入探讨Shuffle的理论基础、实践操作及优化策略打下基础。

# 2. Shuffle机制的理论基础

## 2.1 MapReduce核心概念回顾

### 2.1.1 MapReduce的工作原理

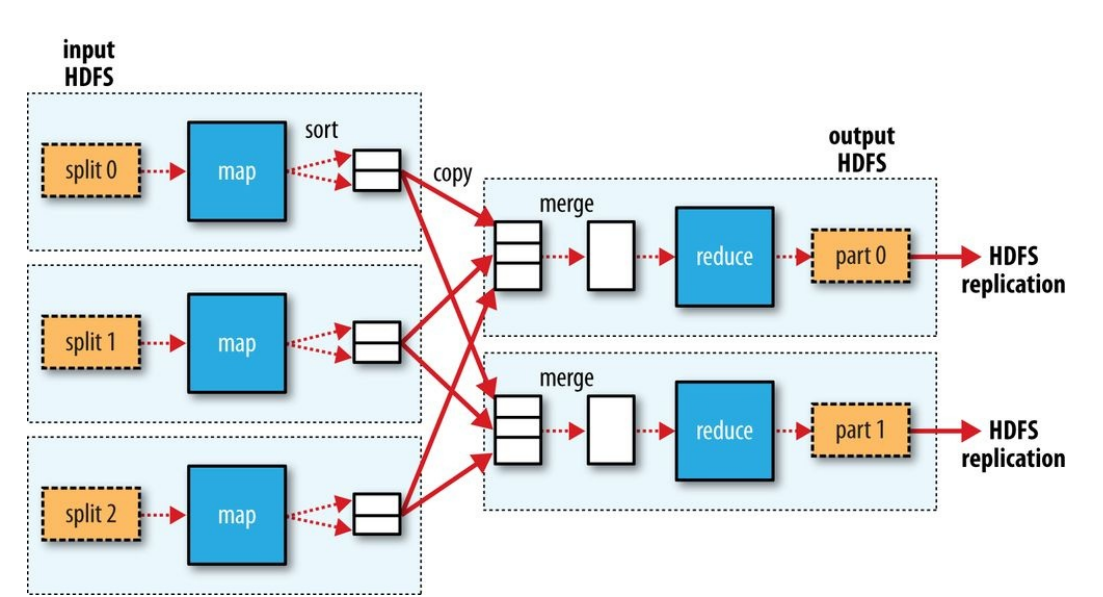

MapReduce是一种编程模型,用于大规模数据集的并行运算。它主要包含两个阶段:Map阶段和Reduce阶段。在Map阶段,输入数据被分片,然后每个分片被独立处理,生成中间键值对(Key-Value);在Reduce阶段,这些键值对被分组,并且每个组中的值被合并处理。

```java

// 以下为伪代码示例,用于说明MapReduce的工作原理

// Map函数处理逻辑

map(String key, String value):

// key: document name

// value: document contents

for each word w in value:

EmitIntermediate(w, "1");

// Reduce函数处理逻辑

reduce(String key, Iterator values):

// key: a word

// values: a list of counts

int result = 0;

for each v in values:

result += ParseInt(v);

Emit(AsString(result));

```

### 2.1.2 Map和Reduce的执行流程

Map操作通常并行执行,每个Map任务处理输入数据的一个片段。Map函数输出的结果是排序后的键值对集合,这个集合会被Shuffle过程处理,之后发送给Reduce任务。

```java

// Map任务的执行流程伪代码

for each inputSplit in input:

call Map(inputSplit.key, inputSplit.value)

write output to intermediate files

// Shuffle过程逻辑伪代码

for each intermediate file in intermediateFiles:

for each key-value pair in ***

***

***任务的执行流程伪代码

for each key-value pair in shuffledData:

call Reduce(key, value)

write output to final result files

```

## 2.2 Shuffle机制的角色与功能

### 2.2.1 Shuffle在MapReduce中的作用

Shuffle是连接Map阶段和Reduce阶段的关键环节,其主要作用是将Map任务的输出结果重新分配给Reduce任务。Shuffle过程中会进行网络传输、排序、合并等操作,确保相同键的值可以聚集在一起,供Reduce任务处理。

### 2.2.2 Shuffle过程的关键步骤

Shuffle过程涉及多个步骤,包括数据的分区、排序、合并和溢写磁盘等。分区保证每个键值对被发送到正确的Reduce任务;排序和合并确保Reduce任务接收到的数据是有序的。

```java

// Shuffle过程的伪代码

for each mapOutput in mapOutputs:

partition mapOutput based on key

sort mapOutput by key

merge mapOutput with existing data for same key

if (size of merged data exceeds threshold):

write to disk

else:

keep in memory for sending to Reduce task

```

## 2.3 Shuffle的优化理论

### 2.3.1 理解数据倾斜问题

数据倾斜是Shuffle过程中常见的性能瓶颈。它发生在某一或几个Reduce任务接收到远超其他任务的数据量时。这会导致这些任务的执行时间远高于其他任务,从而影响整体的处理速度。

### 2.3.2 Shuffle性能优化的基本原则

为了优化Shuffle性能,可以采取多种策略,如改进分区逻辑以均等地分配数据、增加Map和Reduce任务的数量来平衡负载、使用压缩减少数据传输量等。

```java

// 数据倾斜优化策略伪代码示例

// 改进分区逻辑

def customPartition(key, numReduceTasks):

// 自定义分区逻辑,确保数据均衡分布

// ...

// 增加任务数量平衡负载

def adjustTaskConfiguration(inputSize, numReduceTasks):

// 根据输入数据的大小自动调整Map和Reduce任务数量

// ...

```

接下来,我们将进入第三章,详细探讨Shuffle机制的实践操作,包括Map阶段优化、Shuffle过程中的排序与合并以及Reduce阶段的调优。

# 3. Shuffle机制的实践操作

## 3.1 Shuffle前的Map阶段优化

### 3.1.1 自定义Map输出的Key设计

在MapReduce中,Map阶段的输出会作为Shuffle过程的输入。为了提高Shuffle的效率,优化Map输出的Key设计至关重要。自定义Map输出的Key不仅可以减少数据倾斜的问题,还可以提升网络传输的效率和Reduce阶段的排序性能。

Key的设计应考虑数据的分布均匀性。理想情况下,每个Map任务输出的Key值应当尽量均匀分散,以避免某些Reducer任务因为接收数据过多而成为瓶颈。在实际操作中,可以通过随机扰动Key值前缀来打破潜在的数据倾斜模式,例如,将用户的身份证号加上一个随机数作为Key的一部分。

另一个重要的考虑因素是Key的排序。Map输出的Key值在传输到Reduce之前会进行排序。如果业务逻辑允许,可以考虑在Key的设计中加入排序优化,如对Key进行编码以提升排序效率。

### 3.1.2 Map端缓存与Combiner的使用

Map端缓存是优化Shuffle性能的另一种有效手段。它在Map任务完成数据处理后立即将输出结果存储在内存中,而不是写入磁盘。这对于处理大量小文件特别有用。然而,需要注意的是,过多地依赖内存会增加内存溢出的风险。

在某些情况下,可以在Map端使用Combiner来合并中间结果。Combiner函数是在Map端执行的,它在数据发送给Reducer之前进行局部聚合操作。使用Com

0

0