【HDFS安全升级】:datanode安全特性的增强与应用

发布时间: 2024-10-30 09:27:29 阅读量: 5 订阅数: 13

# 1. HDFS的安全性概述

在当今信息化快速发展的时代,数据的安全性已成为企业和组织所关注的核心议题之一。Hadoop分布式文件系统(HDFS)作为大数据存储的关键组件,其安全性备受重视。本章将概览HDFS的安全性问题,为读者揭示在分布式存储领域中,如何确保数据的机密性、完整性和可用性。

首先,我们探讨HDFS面临的安全威胁,包括数据泄露、未授权访问和恶意攻击等问题。其次,我们会简述HDFS通过采取一系列安全措施来应对这些威胁,这些措施不仅涉及系统架构层面,还包括了网络通信、访问控制与权限管理等细节。随着对安全性要求的不断提升,HDFS的安全性概述提供了一个框架性的理解,为后续章节中对Hadoop安全模型的详细介绍以及DataNode的安全增强特性等深入分析打下基础。

# 2. Hadoop安全模型的理论基础

### 2.1 安全模型的组成

在大数据生态系统中,Hadoop是核心组件之一,其安全模型确保了数据处理的机密性和完整性。Hadoop的安全模型主要由两个核心部分组成:认证机制和授权机制。

#### 2.1.1 认证机制

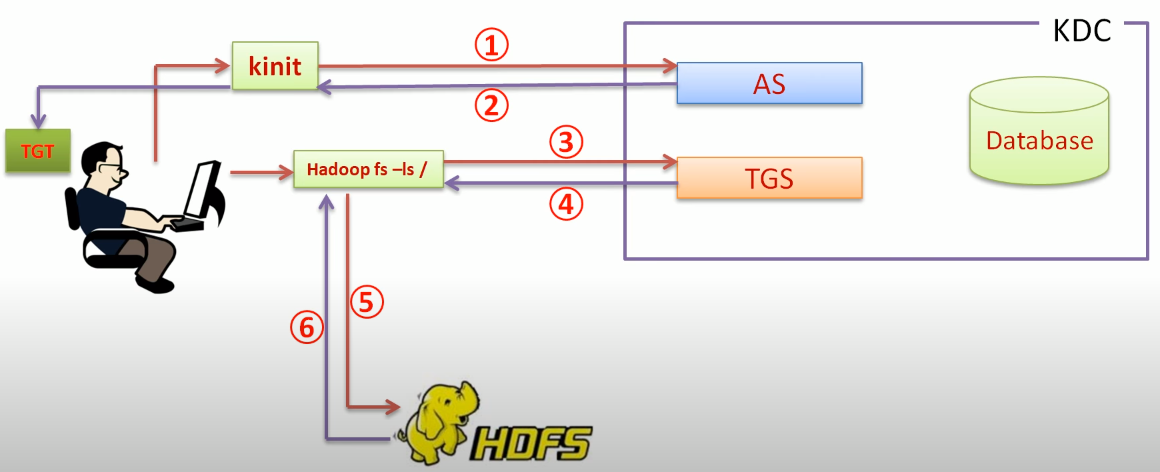

认证机制保证了只有授权用户和系统才能访问Hadoop集群。在Hadoop中,最常用的认证方式是基于Kerberos的认证。Kerberos是一个网络认证协议,它允许两台计算机在网络上通信时相互验证身份。Hadoop集群使用Kerberos来确保集群内部以及集群和客户端之间的通信安全。用户和服务首先从密钥分发中心(KDC)获取票据授予票据(TGT),随后用TGT请求服务票据,服务票据用于访问特定服务。

```mermaid

sequenceDiagram

participant U as 用户

participant KDC as 密钥分发中心(KDC)

participant S as 服务

U->>+KDC: 请求认证票据(TGT)

KDC-->>-U: 返回TGT

U->>+KDC: 使用TGT请求服务票据

KDC-->>-U: 返回服务票据

U->>+S: 使用服务票据请求服务

S-->>-U: 确认票据并提供服务

```

#### 2.1.2 授权机制

授权机制定义了用户或服务对资源的访问权限。Hadoop使用基于角色的访问控制(RBAC),它允许管理员为用户分配不同的角色,角色决定了用户可以访问的资源和可以执行的操作。Hadoop权限模型的核心组件包括用户、组、权限和策略。管理员可以定义策略,将用户或组与特定权限关联,然后将这些策略应用到资源上,如文件、目录或表。

### 2.2 安全模型的工作原理

Hadoop安全模型的工作原理涉及几个关键组件和流程。

#### 2.2.1 Kerberos认证过程

Kerberos认证过程是Hadoop安全模型的基础。以下是该过程的简要描述:

1. 用户使用密码从KDC请求一个TGT。

2. KDC验证用户身份后,发送TGT给用户。

3. 用户持有TGT请求访问服务所需的服务票据。

4. KDC验证TGT,发放服务票据。

5. 用户使用服务票据请求服务。

6. 服务验证票据,确定用户是否有权限访问,之后提供服务。

这个过程保证了整个Hadoop集群中的通信是安全的,防止了未授权访问和中间人攻击。

#### 2.2.2 访问控制列表(ACLs)的应用

Hadoop使用访问控制列表(ACLs)来定义对文件和目录的访问权限。ACLs允许对单个用户或组进行精细的权限设置,如只读、读写或完全控制。管理员可以创建新的策略并将其应用到特定的HDFS路径或资源上,通过设置ACLs来控制对这些资源的访问。例如,一个文件可以设置为只有特定用户或用户组可以读取或修改。

```yaml

# 示例:YAML格式的HDFS文件访问控制列表

hdfs_file_path: /user/admin/data

permissions:

- user: user1

permission: rw-

- group: admin_group

permission: r--

```

ACLs的设置和管理是维护Hadoop集群安全的关键,必须谨慎进行以避免安全漏洞。

### 2.3 安全策略的配置与管理

配置和管理Hadoop集群的安全策略是保护集群免受未授权访问的关键步骤。

#### 2.3.1 安全策略文件的设置

Hadoop集群的配置文件是集群安全策略的主要载体。这些配置文件包含了有关Kerberos、认证、授权和其他安全设置的信息。例如,`core-site.xml` 和 `hdfs-site.xml` 文件中包含了HDFS的安全相关配置,而 `yarn-site.xml` 和 `mapred-site.xml` 文件包含了YARN和MapReduce的安全设置。管理员负责更新这些配置文件,并确保集群中的所有节点都同步更新。

#### 2.3.2 策略的动态更新与应用

安全策略的动态更新和应用是确保集群实时安全的重要手段。管理员可以使用Hadoop的配置管理工具动态更改和应用策略,例如使用`hdfs dfsadmin -setSpaceQuota`来动态设置空间配额,使用`hdfs dfsadmin -setPermission`来动态修改权限。Hadoop的安全模型支持在线策略更新,这使得管理员可以在不影响集群正常运行的情况下进行安全维护。

在下一章,我们将继续深入探讨DataNode的安全增强特性,并逐步走进Hadoop安全特性的实际应用。

# 3. DataNode的安全增强特性

## 3.1 数据加密传输

### 3.1.1 传输层安全(SSL/TLS)

在现代分布式系统中,数据传输的加密是保障数据安全的重要环节。传输层安全(SSL/TLS)提供了一种在两个通信实体之间建立加密连接的方法,确保了数据在传输过程中即使被截获,也无法被第三方解读。在Hadoop的DataNode中,SSL/TLS的使用能够确保客户端与DataNode之间的通信不会被窃听,这对于保护敏感数据尤其重要。

### 3.1.2 数据在传输中的加密方法

数据在传输中的加密方法主要依靠SSL/TLS协议提供的密钥交换和加密算法。首先,通过证书验证通信双方的身份,建立一个加密通道。然后数据在这个通道内传输前被加密,在接收端被解密还原。这种加密方法不仅可以防御中间人攻击,还可以防止数据泄露。

## 3.2 数据存储安全

### 3.2.1 块加密技术

在HDFS中,数据以块的形式存储在DataNode上。块加密技术可以在文件系统层面上提供数据的加密保护。通过块加密,即使攻击者能够访问到存储介质,也无法读取加密后的数据块内容。这种技术常配合密钥管理系统一同使用,以确保数据的安全性。

### 3.2.2 数据块的密钥管理

数据块的密钥管理是实现块加密的关键。密钥管理系统负责生成、存储、分发和销毁

0

0