深入理解HDFS:datanode故障恢复机制探究

发布时间: 2024-10-30 08:24:13 阅读量: 54 订阅数: 43

深入理解HDFS:Hadoop分布式文件系统

# 1. HDFS架构和datanode概述

Hadoop分布式文件系统(HDFS)是Hadoop项目的核心组件之一,它被设计为能够跨商业硬件集群存储大量数据。HDFS采用了主从(Master/Slave)结构来实现分布式存储,主要包含两个关键组件:NameNode和DataNode。NameNode作为主节点,负责管理文件系统的命名空间和客户端对文件的访问;而DataNode作为从节点,主要负责实际的数据存储。

## 1.1 HDFS架构简介

HDFS架构设计目标是支持高容错性的场景,并能提供高吞吐量的数据访问,非常适合大规模数据集的应用程序。它基于流式数据访问模式,假设数据一旦写入就不会被修改,这一点在数据仓库、日志处理和推荐系统等应用场景中极为常见。

## 1.2 DataNode的角色和职责

DataNode是HDFS的执行者,负责存储和检索块数据,以及处理来自客户端的读写请求。每个DataNode会在本地文件系统中存储数据块,并周期性地向NameNode报告其存储的数据块列表。DataNode还参与数据块的创建、删除和复制过程,以保证数据的冗余和可靠性。

# 2. datanode的工作原理及故障类型

## 2.1 datanode的基本工作原理

### 2.1.1 datanode的角色和职责

datanode作为Hadoop分布式文件系统(HDFS)的主要组件之一,其主要负责存储实际的数据块,并提供数据的读取和写入服务。每个datanode都管理着一部分存储空间,用于数据的持久化存储。其角色和职责可以细分为以下几个方面:

- 数据块存储:将文件分割成一系列的块,并将这些块分布在不同的datanode上。

- 副本管理:HDFS默认为每个数据块创建三个副本,datanode负责维护这些副本,并确保副本数量满足要求。

- 数据读写:响应来自客户端的读写请求,将数据块传输给客户端或从客户端接收数据。

- 健康监测:定期向名称节点发送心跳信号和数据块报告,证明其正常运行状态。

### 2.1.2 数据存储和读写流程

数据存储和读写流程是datanode的核心功能。整个流程可分解为几个关键步骤,如下所示:

1. **写数据流程:**

- 客户端向名称节点请求写入新文件。

- 名称节点返回可用的datanode列表。

- 客户端将数据分割成块,并将它们顺序地写入到列表中的datanode。

- 数据被复制到三个datanode,完成后通知名称节点。

2. **读数据流程:**

- 客户端向名称节点请求读取文件。

- 名称节点提供包含文件数据块的datanode列表。

- 客户端直接从这些datanode中读取数据块。

- 通常情况下,客户端将选择距离自己最近的datanode来读取数据块,以提高读取效率。

## 2.2 datanode可能遇到的故障类型

### 2.2.1 硬件故障

硬件故障是datanode面临的常见问题之一,主要包括:

- 磁盘故障:存储数据的磁盘可能会损坏,导致数据丢失。

- 主机宕机:datanode所在的物理或虚拟主机可能会因系统错误或硬件问题而宕机。

- 网络中断:连接datanode的网络设备或链路可能会故障,导致无法访问。

为应对硬件故障,HDFS通过数据块的多副本机制来确保数据可靠性。当某一个或多个副本因硬件问题不可用时,系统可以从其他datanode上恢复丢失的数据块。

### 2.2.2 软件故障

软件故障通常指的是运行datanode进程的操作系统或Hadoop软件层面的问题,比如:

- Bug导致服务崩溃:Hadoop程序中的bug可能导致datanode意外退出。

- 配置错误:不正确的配置可能会导致datanode运行不正常。

这些软件故障通常通过系统日志和Hadoop内部监控工具来发现和解决。针对这些故障,可以采取以下措施:

- 定期检查日志,对错误和警告信息进行分析处理。

- 定期更新Hadoop集群软件到稳定版本,修复已知bug。

### 2.2.3 网络问题导致的故障

网络问题可能会导致datanode与集群中其他节点通信时出现故障,如:

- 网络延迟:由于网络延迟,datanode可能无法按时响应心跳信号。

- 网络分割:网络分割可能导致集群中的不同部分无法相互通信,影响datanode的数据同步。

为减少网络问题的影响,集群设计时需要考虑高可用性和冗余网络设计。同时,在软件层面,需要实现有效的网络监控和快速恢复机制。

在下一章节,我们将深入探讨datanode的故障检测机制,并揭示其内部工作原理。

# 3. datanode故障检测机制

在处理大规模分布式存储系统时,故障检测机制是保障数据持久性和系统稳定性的核心组件之一。对于Hadoop分布式文件系统(HDFS)中的DataNode节点而言,故障检测机制是必不可少的,它能够在底层硬件或软件出现问题时,迅速采取措施以防止数据丢失和系统中断。这一章节将深入探讨DataNode的故障检测机制,包括心跳机制、块报告机制,以及自动故障切换和恢复机制。

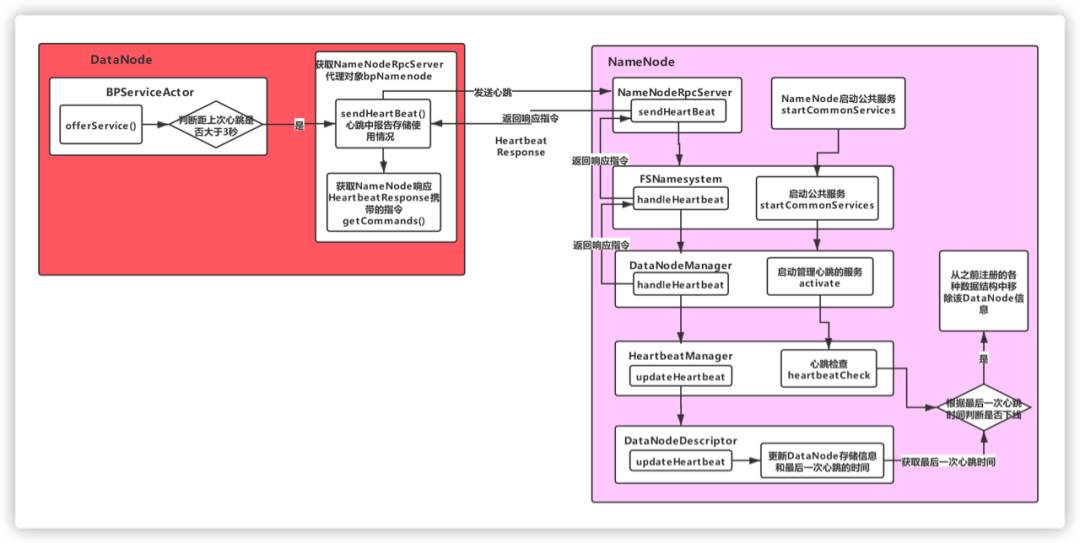

## 3.1 心跳机制

心跳机制是一种在分布式系统中广泛使用的状态检测方法,它通过周期性发送心跳信号来检查组件之间是否存活并且正常工作。在HDFS中,心跳机制用于检测DataNode是否运行正常。

### 3.1.1 心跳信号的作用

心跳信号的作用主要是为了监控DataNode节点的状态。NameNode会通过接收DataNode发送的心跳信号来确认DataNode是否存活,并且能够及时检测出节点故障。如果在一定时间内没有收到DataNode的心跳信号,NameNode会将其标记为死亡,进而触发副本的复制和重新分配,以保持数据的副本数量满足系统要求。

### 3.1.2 心跳监测的实施和频率

心跳信号的发送频率会影响到故障检测的灵敏度和系统的性能开销。在HDFS中,心跳频率通常设置为3秒钟一次,这样可以在保证及时检测到故障的同时,尽量减少对系统资源的消耗。心跳信号的发送和接收过程是通过RPC(Remote Procedure Call)进行的。

```java

// 代码示例:心跳监测伪代码

while (nodeIsRunning) {

sendHeartbeatToNameNode();

if (noResponseFromNameNodeWithinTimeout) {

incrementFailedHeartbeatCount();

} e

```

0

0