【数据节点网络优化】:提升datanode间数据传输效率

发布时间: 2024-10-30 08:56:55 阅读量: 20 订阅数: 28

# 1. 数据节点网络优化概述

## 1.1 优化的必要性

在当今数据密集型的IT环境中,数据节点网络优化变得至关重要。随着业务数据量的增长和网络服务需求的提升,优化数据节点网络对于保持高性能、降低延迟和提高用户满意度都是不可或缺的。

## 1.2 优化的目标

优化的目标是确保数据节点在网络中的高效运作,包括但不限于优化数据传输速度、确保数据的可靠传输和提高网络吞吐量。此外,通过优化还能减少成本,提升系统的可扩展性和弹性。

## 1.3 优化的范围

数据节点网络优化覆盖了网络架构、通信协议、传输效率以及故障排除等多个方面。这些优化措施共同作用,以提高整体网络的性能和响应能力。

# 2. 数据节点网络通信基础

数据节点作为网络通信中的重要组成部分,其通信基础的理解对于整个数据处理效率有着至关重要的作用。本章节将深入解析数据节点网络架构,并探讨网络传输协议如何影响数据节点以及相应的优化策略。

### 2.1 数据节点网络架构解析

网络架构是数据节点在通信过程中遵循的底层结构,它的合理设计直接关系到数据传输的效率和可靠性。本节将从网络拓扑结构的基本理解开始,深入到数据节点在网络中的角色和功能。

#### 2.1.1 网络拓扑结构的基本理解

网络拓扑结构描述了网络设备的物理和逻辑布局。常见的网络拓扑结构有总线型、星型、环形、网状等。每种拓扑结构都有其独特的特点、优势和限制。

以星型拓扑为例,其特点是中心节点(通常是交换机或路由器)控制整个网络的通信。星型拓扑易于管理、诊断问题,并且容易扩展。但其缺点是依赖于中心节点,如果中心节点出现故障,整个网络将受到严重影响。

```mermaid

graph LR

A[Hub] --- B[Client 1]

A --- C[Client 2]

A --- D[Client 3]

A --- E[Client 4]

```

在Mermaid流程图中展示了星型拓扑结构的示意图,中心节点与每个客户端相连。

#### 2.1.2 数据节点在网络中的角色和功能

数据节点在网络架构中承担着数据处理、转发及存储的重要角色。节点功能的多样性要求它必须能够快速响应网络请求,高效转发数据包,并且在必要时进行数据存储。

例如,在云计算环境中,数据节点可能同时充当存储节点和计算节点。这要求节点不仅要有足够的I/O能力来处理存储请求,还要有足够的CPU和内存资源来处理计算任务。高可靠性、高吞吐量和低延迟成为这类节点的关键性能指标。

### 2.2 网络传输协议与数据节点

网络传输协议定义了在网络中传输数据的标准方式,不同的协议有不同的特性和用途。TCP/IP协议族是互联网上使用最广泛的一组协议,它们对数据节点的通信效率具有深刻的影响。

#### 2.2.1 TCP/IP协议族及其对数据节点的影响

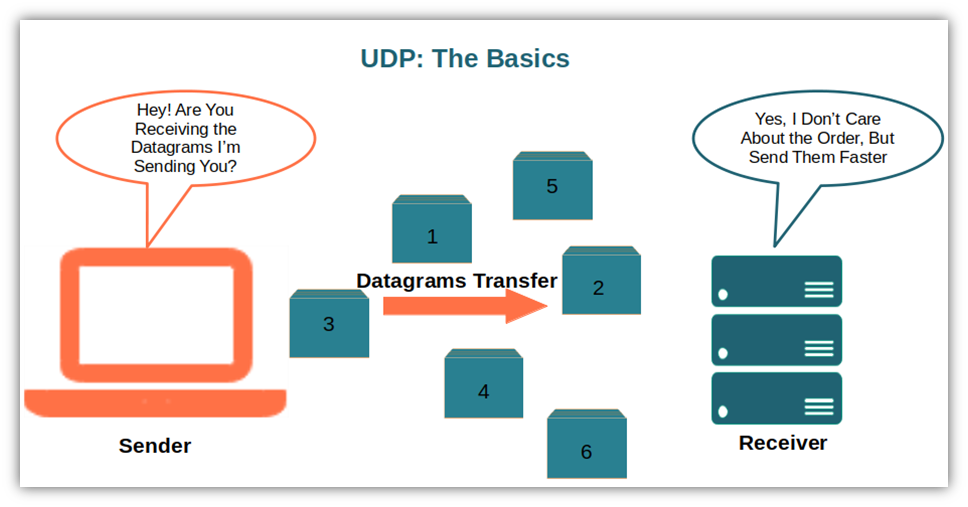

TCP/IP协议族包括多个层次,从最底层的链路层到应用层,包括了IP、TCP、UDP、HTTP等多个协议。数据节点在网络通信中需要正确处理这些协议以确保数据的可靠传输。

以TCP协议为例,它提供了面向连接的、可靠的数据传输服务。为了保障传输的可靠性,TCP协议使用了重传机制、流量控制和拥塞控制等技术。这些机制在确保数据传输的可靠性和效率的同时,也增加了数据节点的处理开销。

```plaintext

数据节点在处理TCP连接时,需要为每个连接维护相关状态信息和管理资源。

```

```c

// 示例:TCP连接建立的简要代码段

int sockfd = socket(AF_INET, SOCK_STREAM, 0);

struct sockaddr_in serv_addr;

memset(&serv_addr, 0, sizeof(serv_addr));

serv_addr.sin_family = AF_INET;

serv_addr.sin_port = htons(MY_PORT);

inet_pton(AF_INET, "***.***.*.*", &serv_addr.sin_addr);

connect(sockfd, (struct sockaddr *) &serv_addr, sizeof(serv_addr));

```

上面的代码示例展示了在Linux环境下如何创建一个TCP套接字并连接到服务器。其中,`socket`、`connect`等函数调用涉及到底层的TCP/IP协议栈处理。

#### 2.2.2 传输协议的优化策略与数据节点效率

优化TCP/IP传输协议可以通过调整TCP/IP栈的参数来实现,如修改窗口大小、调整重传机制等。合理的参数配置可以显著提高数据节点的通信效率。

例如,可以适当增加TCP窗口大小来提高带宽利用率,减少小包发送频率以降低CPU开销,或者调整重传超时时间以适应网络条件的变化。

```shell

# 在Linux系统中,使用sysctl命令调整TCP窗口大小

sysctl -w net.ipv4.tcp_window_scaling=1

sysctl -w net.ipv4.tcp_rmem='***'

sysctl -w net.ipv4.tcp_wmem='***'

```

通过调整上述参数,可以优化TCP窗口大小,使得系统可以处理更大体积的数据传输,从而提升整体网络的吞吐量。

本章深入探讨了数据节点网络通信的基础知识,包括网络架构和传输协议的详细解析,以及优化策略的探讨。通过本章内容的消化理解,读者应能够建立一个扎实的理论基础,进而深入学习下一章节的数据节点间通信机制分析。

# 3. ```

# 第三章:数据节点间通信机制分析

## 3.1 数据传输过程中的延迟问题

### 3.1.1 网络延迟的来源及其影响

在数据传输过程中,延迟(Latency)是指数据从源头传输到目的地所需的时间。延迟主要由以下几个部分组成:

- **传播延迟(Propagation Delay)**:信号在介质中传播所需要的时间。

- **传输延迟(Transmission Delay)**:数据包从节点发出到完全进入链路的时间。

- **处理延迟(Processing Delay)**:数据包到达交换节点时,交换节点进行处理的时间。

- **排队延迟(Queuing Delay)**:数据包在等待输出链路可用时的时间。

延迟对数据节点间通信的影响是显而易见的。高延迟会直接影响到系统的响应时间和数据传输效率。例如,远程数据访问、在线游戏、实时视频会议等对延迟要求极高的应用,任何一点延迟都可能导致

```

0

0