大数据稳定性保障:MapReduce监控与故障诊断指南

发布时间: 2024-10-25 18:25:27 阅读量: 2 订阅数: 5

# 1. 大数据稳定性保障概述

随着大数据技术的快速发展,其在各行各业的应用越来越广泛,数据处理的稳定性成为了决定业务成败的关键因素。大数据稳定性保障不仅需要保障数据的准确性和完整性,更需要确保数据处理流程的连续性和可靠性。它包括对数据采集、存储、处理和分析的全面监控与管理,从而及时发现并解决潜在的风险和问题。在这一章节中,我们将概述大数据稳定性保障的重要性、目标和挑战,并探讨如何为实现大数据平台的稳定运行而构建有效的监控和故障诊断体系。这将为后续章节深入理解MapReduce监控策略和故障诊断提供坚实的基础。

# 2. MapReduce基础与架构解析

MapReduce作为一种编程模型,是大数据处理中的核心技术之一,它极大地简化了复杂数据处理任务的实施,允许开发者编写可扩展的分布式算法。接下来,本章节将深入探讨MapReduce的基础知识、架构和工作原理。

## 2.1 MapReduce的基本概念

### 2.1.1 MapReduce编程模型

MapReduce由Google在2004年提出,它抽象了并行计算的复杂性,提供了一个简单但功能强大的编程模型。在MapReduce模型中,开发者需要编写两个主要函数:Map函数和Reduce函数。

- **Map函数**:负责处理输入数据,它接收一组键值对(key/value pairs),并输出一组中间键值对。Map函数的目的是将数据分解成可以独立处理的多个块,并进行初步过滤和处理。

- **Reduce函数**:对Map函数的输出进行处理,它接收一个键和相关联的一组值,然后将这组值合并为少量的输出。Reduce操作通常涉及到某种形式的数据聚合,比如求和、计数或排序等。

MapReduce的编程模型极大地简化了并行计算过程,开发者无需关注底层的网络通信、错误处理、数据分布、负载均衡等细节,专注于业务逻辑的实现即可。

### 2.1.2 作业执行流程简述

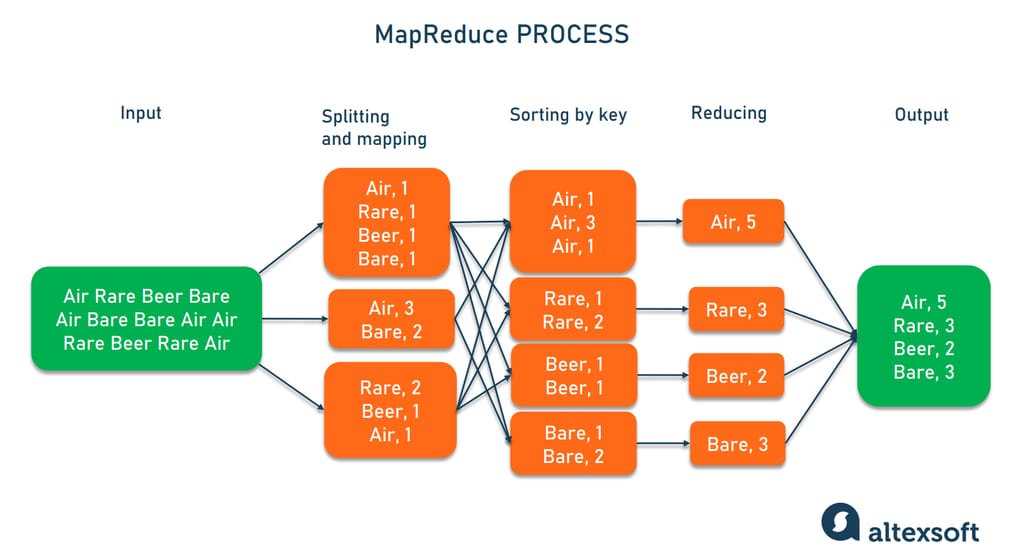

一个MapReduce作业执行流程大致可以分为以下步骤:

1. **输入数据分割**:将输入数据分割成若干个分片(splits),每个分片由Map任务处理。

2. **Map阶段**:系统将输入分片分配给Map任务,Map函数处理输入数据,输出中间键值对。

3. **Shuffle阶段**:框架将所有Map任务的输出按照键进行排序和分组,为Reduce阶段做好准备。

4. **Reduce阶段**:Reduce任务处理Shuffle阶段准备好的键值对,输出最终结果。

5. **输出**:输出数据通常存放在分布式文件系统中,供后续使用。

整个过程的框架管理和调度由MapReduce系统完成,开发者只需要关注Map和Reduce函数的实现。

## 2.2 MapReduce系统架构

### 2.2.1 Hadoop集群的角色与组件

Hadoop是MapReduce的一种实现,它是一个由Apache基金会开发的开源框架。Hadoop集群主要由以下角色和组件构成:

- **NameNode**:管理HDFS(Hadoop Distributed File System)的元数据,维护文件系统树及整个HDFS的目录树,不存储实际的数据。

- **DataNode**:在HDFS中存储实际的数据,并执行数据块(blocks)的创建、删除和复制等操作。

- **JobTracker**:负责调度和监控作业的执行,分配任务给TaskTracker。

- **TaskTracker**:在集群的每个节点上运行,接受TaskTracker分配的任务并执行。

Hadoop集群的运行需要监控和维护多个组件的协调工作,以保证数据处理的高效性和稳定性。

### 2.2.2 MapReduce任务调度机制

任务调度机制是MapReduce框架的核心之一,它主要分为两个阶段:任务分配和任务执行。

- **任务分配**:MapReduce作业提交后,JobTracker接收到作业请求,进行任务调度。JobTracker将作业分解成一系列任务,并将任务分配给空闲的TaskTracker。

- **任务执行**:TaskTracker接收到任务后,在其所在节点上执行任务。如果任务执行失败,TaskTracker会重新请求任务,并由JobTracker重新调度执行。

任务调度机制需要综合考虑节点的负载、硬件条件、网络状况等多方面因素,保证作业高效、稳定地完成。

## 2.3 MapReduce工作原理

### 2.3.1 Map阶段与Reduce阶段的数据处理

Map阶段和Reduce阶段是MapReduce编程模型的核心,它们处理数据的方式有着本质的区别:

- **Map阶段**:Map任务并行处理输入数据,输出中间键值对。这个阶段的关键在于并行化处理大量数据,以提升数据处理效率。

- **Reduce阶段**:Reduce任务接收Map输出的中间键值对,并将具有相同键的值进行合并处理。这个阶段主要是对数据进行汇总、排序、合并等操作。

MapReduce框架通过自动分割数据和调度任务,使得开发者能够专注于处理逻辑的开发,而不必担心底层的并行计算细节。

### 2.3.2 Shuffle过程与排序机制

Shuffle过程是MapReduce中极为关键的一步,它连接了Map阶段和Reduce阶段,涉及数据从Map到Reduce的传输过程。Shuffle过程包括以下几个步骤:

1. **数据分组**:按照输出键将数据分组,确保具有相同键的数据被发送到同一个Reducer。

2. **数据排序**:对每个键的数据进行排序,这样Reducer可以按顺序处理它们。

3. **数据传输**:分组排序后的数据通过网络传输到Reduce任务所在节点。

Shuffle过程确保了数据按照一定的顺序从Map端传输到Reduce端,使得数据能够被有效地聚合和处理。

在这个过程中,排序机制是核心,它不仅保证了数据的正确汇总,而且对于后续的Reduce任务至关重要。排序机制按照键的顺序对中间数据进行排序,这为Reduce函数的执行奠定了基础。

通过分析MapReduce的基础概念、系统架构以及工作原理,我们对MapReduce有了一个全面的理解。在接下来的章节中,我们将进一步深入探讨如何通过监控策略来优化MapReduce作业的性能,以及如何进行故障诊断与处理。

# 3. MapReduce监控策略

## 3.1 监控指标与工具选择

### 3.1.1 关键性能指标(KPIs)的定义

在进行MapReduce的监控中,关键性能指标(KPIs)是非常重要的,它们帮助我们量化系统的性能,并提供实时或定期的性能反馈。关键性能指标应包括如下几个方面:

- **作业完成时间**:MapReduce作业从提交到完成所需的时间,这个指标能直接反映系统的处理能力。

- **资源利用率**:CPU、内存、磁盘和网络带宽的使用情况,它们反映了集群在作业运行过程中的资源消耗。

- **吞吐量**:单位时间内的作业处理数量,衡量MapReduce的性能是否满足业务需求。

- **延迟**:作业从提交到开始执行之间的时间间隔,通常与调度器的效率密切相关。

- **错误率**:在MapReduce作业执行过程中出现失败的比例。

### 3.1.2 开源与商业监控工具对比

在实际应用中,我们可以选择开源工具或者商业工具来实现MapReduce的监控。以下是对开源和商业监控工具的一些对比:

**开源工具**:

- **优点**:通常免费且开源社区活跃,可以定制化和集成其他开源组件。

- **缺点**:可能需要较高的专业知识来搭建和维护,功能可能不如商业软件全面。

**商业工具**:

- **优点**:一般提供全功能的用户界面和专业级的客户支持,功能全面,使用方便。

- **缺点**:成本较高,并且可能需要依赖供应商的技术支持。

#

0

0