Hadoop与MapReduce:揭秘它们的内在联系及其重要性

发布时间: 2024-10-25 17:52:40 阅读量: 36 订阅数: 30

hadoop-mapreduce:hadoop MapReduce

# 1. Hadoop与MapReduce简介

在信息技术迅猛发展的今天,大数据已成为企业乃至整个行业关注的焦点。Hadoop作为一个开源的、可扩展的分布式存储和计算平台,为处理海量数据提供了可能。而MapReduce作为Hadoop的核心组件之一,是处理大规模数据集的一种编程模型。本章将从Hadoop和MapReduce的基本概念出发,讨论它们在现代数据处理中的重要性及应用。

## 1.1 Hadoop的起源和意义

Hadoop是由Apache软件基金会开发的一套框架,其设计初衷是为了支持应用程序在通用硬件上的分布式存储和分布式处理。通过使用简单易懂的编程接口,Hadoop使得开发者能够快速处理PB级别的数据,并且能够高效地扩展到数千个计算节点。

## 1.2 MapReduce模型简介

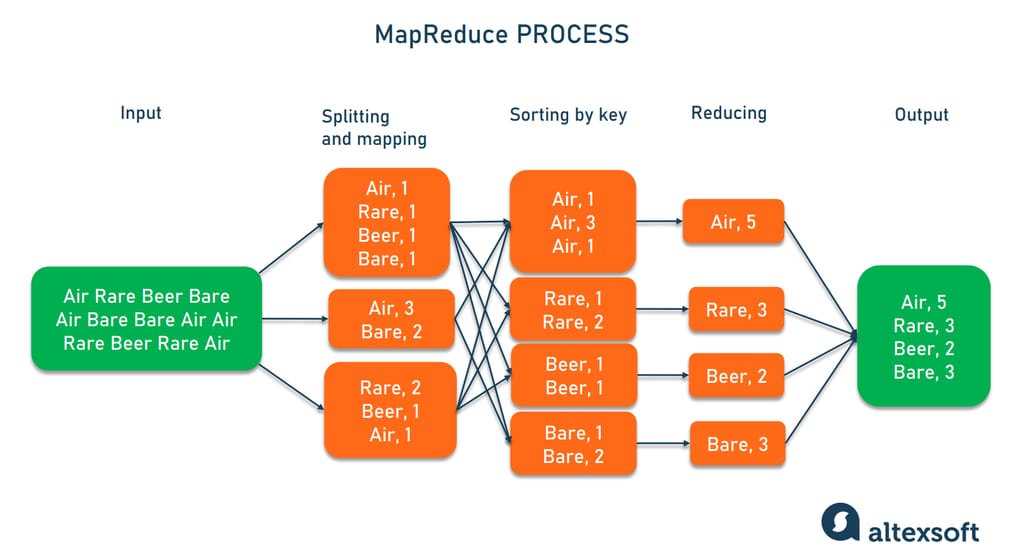

MapReduce是一种编程模型,被设计用于简化并行处理过程。它将任务拆分为两个步骤:Map(映射)和Reduce(归约)。在Map阶段,输入数据被处理成中间键值对;在Reduce阶段,这些中间结果被归约,形成最终输出。

## 1.3 Hadoop与MapReduce的结合

Hadoop和MapReduce的关系密不可分。MapReduce模型被应用于Hadoop框架中,用来处理存储在Hadoop分布式文件系统(HDFS)中的数据。Hadoop利用MapReduce算法,将任务分配到多个节点上并行处理,从而大幅度提高数据处理的速度和效率。

通过上述内容,我们对Hadoop与MapReduce有了一个基本的了解。接下来的章节将深入探讨Hadoop生态系统的核心组件,并逐步揭开MapReduce执行过程的神秘面纱。

# 2. Hadoop生态系统的核心组件

在第一章中,我们对Hadoop与MapReduce进行了基础性的介绍。现在,我们将深入探讨Hadoop生态系统的核心组件,这些组件共同构建了分布式存储与处理的框架,为处理大规模数据提供了强大的支持。本章分为三个主要部分,分别是HDFS、YARN和MapReduce。

## 2.1 HDFS:分布式文件存储系统

### 2.1.1 HDFS的基本架构

Hadoop分布式文件系统(HDFS)是Hadoop生态系统中的关键组件之一,专为存储大规模数据集而设计。HDFS具有高容错性和高吞吐量,特别适合运行在普通的硬件之上。它采用主从架构,由一个NameNode(主节点)和多个DataNode(数据节点)组成。

- NameNode负责管理文件系统命名空间和客户端对文件的访问。

- DataNode在集群的各个节点上实际存储数据,并执行创建、删除和复制数据块的任务。

HDFS的设计使得单点故障的风险降低,因为数据被自动复制到多个DataNode上。此外,HDFS还支持数据的弹性扩展,允许用户在不停机的情况下增加更多的DataNode来提升存储能力。

### 2.1.2 数据冗余与容错机制

HDFS通过数据冗余确保了高可用性和容错性。在默认配置下,一个数据块会被复制三份,分别存储在不同的DataNode上。这种冗余机制使得系统在面对节点故障时,能够迅速从其他节点上重新构建丢失的数据。

- 当一个DataNode失败时,HDFS会自动检测并开始复制丢失的数据块到其他健康的DataNode上。

- 客户端读写操作不会因为节点故障而被中断,因为HDFS的客户端库可以自动重定向到数据的其他副本进行操作。

HDFS的容错机制是通过心跳信号和周期性的心跳报告来维护的。NameNode通过心跳信号监控DataNode是否在线,一旦发现异常就将该DataNode上的数据复制到其他节点。心跳报告则用于向NameNode报告每个数据块的健康状态,确保数据的一致性。

## 2.2 YARN:资源管理和作业调度

### 2.2.1 YARN的架构与组件

YARN(Yet Another Resource Negotiator)是Hadoop的资源管理器,负责管理集群的计算资源,并为应用提供资源分配。YARN架构的引入是Hadoop从1.x向2.x演进的关键步骤,解决了原始MapReduce框架资源管理和作业调度上的局限性。

YARN的核心组件包括资源管理器(ResourceManager)、节点管理器(NodeManager)和应用程序历史服务器(ApplicationHistoryServer):

- 资源管理器是集群的主节点,负责整个系统的资源分配和任务调度。

- 节点管理器运行在每个集群节点上,负责监控节点的资源使用情况,并与资源管理器协商资源分配。

- 应用程序历史服务器记录了已完成的应用程序的详细信息,使得用户可以查询应用程序的历史状态。

YARN的出现,极大地提高了Hadoop集群的资源利用率,它使得除了MapReduce之外的其他计算框架也能运行在同一个Hadoop集群中,例如Apache Tez和Apache Spark。

### 2.2.2 资源调度与任务分配

YARN通过调度器(Scheduler)和应用程序的资源需求模型来实现资源调度和任务分配。调度器负责根据集群的资源状态和资源请求来调度任务。目前,YARN提供了三种调度器:FIFO调度器、容量调度器(Capacity Scheduler)和公平调度器(Fair Scheduler)。

- FIFO调度器按照先到先得(First-In-First-Out)的原则,顺序地为应用程序分配资源。

- 容量调度器能够为多个组织提供服务,并保证每个组织至少获得一定的计算资源,同时支持资源共享。

- 公平调度器尝试为所有运行中的应用程序提供公平的资源分配,适合于多用户共享集群资源的场景。

应用程序向YARN提交任务时,会指明所需资源的类型和数量。调度器根据这些需求,以及集群中各节点的资源使用情况,来决定将资源分配给哪个应用程序。这一过程确保了集群资源的有效利用,同时兼顾了任务执行的公平性。

## 2.3 MapReduce:数据处理范式

### 2.3.1 MapReduce编程模型

MapReduce是一种编程模型,用于处理大规模数据集的并行运算。它由Google提出,并被广泛应用于Hadoop生态系统中。MapReduce模型将复杂的、大规模的数据处理工作分解为两个关键阶段:Map阶段和Reduce阶段。

- Map阶段处理输入数据,将数据集转换成一系列中间的键值对(key-value pairs)。

- Reduce阶段则对中间键值对进行合并处理,得出最终结果。

MapReduce模型之所以强大,在于它通过抽象化隐藏了底层的并行处理、容错、数据分布和负载均衡等细节,使得开发者可以专注于数据处理的逻辑,而无需关心底层的分布式细节。

### 2.3.2 Map和Reduce任务的工作机制

在Hadoop中,MapReduce作业被分为两个阶段执行:Map阶段和Reduce阶段。每个阶段都由一组任务构成,每个任务负责处理数据的一部分。

- Map任务以数据块为单位读取输入数据,进行用户定义的Map函数处理,输出中间键值对。

- Reduce任务则根据键值对的键(key)对中间数据进行排序,然后对每个键的所有值(values)应用用户定义的Reduce函数,最终生成输出数据。

在MapReduce模型中,Shuffle阶段是一个重要的数据传输过程,它发生在Map和Reduce阶段之间。Shuffle负责把所有Map任务产生的中间输出根据键(k

0

0