企业级应用案例:MapReduce在企业中的应用与经验分享

发布时间: 2024-10-25 18:08:51 阅读量: 25 订阅数: 32

学生信息管理系统-----------无数据库版本

# 1. MapReduce的基本概念和原理

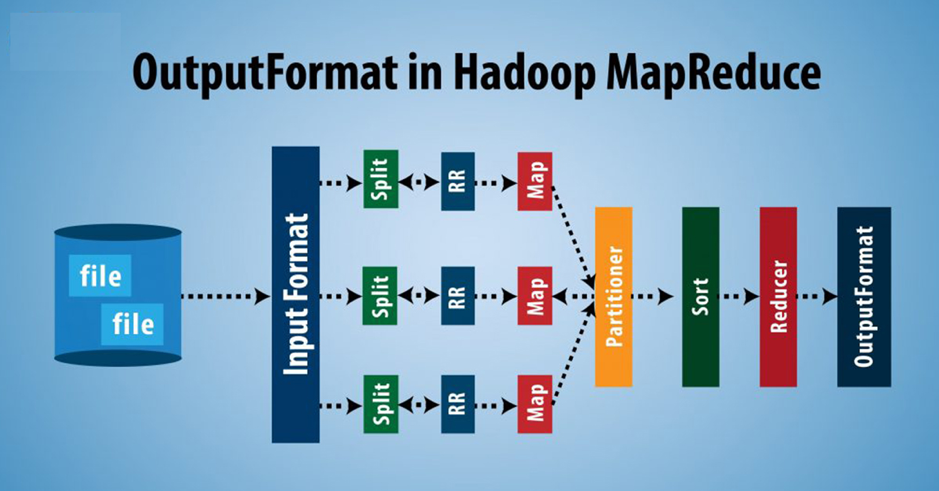

在这一章节中,我们将介绍分布式计算领域内赫赫有名的MapReduce框架。MapReduce不仅仅是一个简单的编程模型,它还是一种能有效处理大规模数据集的并行算法。我们将深入探讨MapReduce模型的精髓,以及它是如何运作的。读者将了解到MapReduce模型的设计哲学、其核心组件——Mapper和Reducer的作用,以及它们如何协同工作,将复杂的数据处理任务分解成可管理的块并最终整合结果。此外,我们还将探讨MapReduce与现代大数据处理平台,例如Hadoop的关系,为理解接下来章节中MapReduce在实战中的应用和优化打下坚实的基础。

## MapReduce的工作原理

MapReduce的工作原理是将复杂的数据处理任务分解成两个阶段:Map阶段和Reduce阶段。

### Map阶段

在Map阶段,输入的数据被分为独立的块,每个块由一个Map任务并行处理。Map任务将块中的数据映射为一系列中间键值对。

```python

# Map函数示例

def map(document):

for each word in document:

emit_intermediate(word, 1)

```

### Reduce阶段

Reduce阶段,Map阶段输出的中间键值对根据键进行分组,然后由Reduce函数处理这些分组。

```python

# Reduce函数示例

def reduce(word, values):

result = 0

for count in values:

result += count

emit(word, result)

```

通过这一章,您将掌握MapReduce的基本概念、工作流程以及其对大数据处理的重要性。这将为深入理解MapReduce框架和在各种场景中的高效运用奠定基础。

# 2. MapReduce的实战技巧

在上一章中,我们了解了MapReduce的基本概念和工作原理。接下来,我们将深入探讨MapReduce的实战技巧,包括其编程模型、性能优化、以及错误处理等方面的内容。掌握这些技巧,可以让MapReduce在大数据处理中发挥更强大的作用。

## 2.1 MapReduce的编程模型

### 2.1.1 MapReduce的工作原理

MapReduce的工作流程可以概括为以下三个主要步骤:映射(Map)、排序(Shuffle)和规约(Reduce)。这一流程实现了从输入数据到输出结果的转换。

```mermaid

graph LR

A[输入数据] --> B[Map]

B --> C[排序]

C --> D[Reduce]

D --> E[输出结果]

```

- **映射(Map)**: Map阶段读取输入数据,并将数据映射为键值对(key-value pairs)。每个Map任务独立处理数据的子集,并将结果输出为中间键值对。

- **排序(Shuffle)**: Shuffle阶段对所有的Map输出进行排序。它保证了相同键值(key)的所有数据被发送到同一个Reduce任务。

- **规约(Reduce)**: Reduce阶段接收排序后的键值对,将相同键(key)的所有值(values)合并在一起进行处理,最终输出结果。

### 2.1.2 MapReduce的关键组件

MapReduce的编程模型包含以下几个关键组件:

- **JobTracker**: 负责管理整个MapReduce作业的生命周期。

- **TaskTracker**: 负责在各个工作节点上运行任务并报告其状态。

- **Mapper**: 执行映射操作的代码。

- **Reducer**: 执行规约操作的代码。

- **Driver Program**: 驱动整个MapReduce程序运行的主类,负责配置作业的各种参数。

## 2.2 MapReduce的性能优化

### 2.2.1 MapReduce的性能瓶颈

MapReduce的性能瓶颈主要来自于以下几个方面:

- **I/O**: 输入输出操作的开销很大,尤其是在读写磁盘数据时。

- **网络传输**: Shuffle过程中数据在网络中的传输可能成为瓶颈。

- **资源调度**: 资源分配不均匀或调度不高效会导致资源浪费。

- **任务调度**: 任务的启动和停止可能会引入额外的开销。

### 2.2.2 MapReduce的性能优化策略

为了提高MapReduce的性能,可以采取以下策略:

- **优化数据格式**: 使用高效的序列化机制,比如使用Protocol Buffers,减少数据大小和序列化/反序列化的开销。

- **减少Shuffle开销**: 通过压缩中间数据来减少网络传输量。

- **合理配置资源**: 根据作业需求合理配置Map和Reduce任务的资源。

- **调整任务并发度**: 适当增加Map和Reduce任务的并发度,可以提高作业的并行度。

## 2.3 MapReduce的错误处理

### 2.3.1 MapReduce的常见错误

MapReduce程序在运行过程中可能会遇到多种错误:

- **数据问题**: 输入数据格式错误、数据不完整或数据损坏。

- **代码问题**: 逻辑错误或资源泄露。

- **配置问题**: 作业配置不正确,如内存设置不当。

- **硬件故障**: 工作节点硬件故障导致任务失败。

### 2.3.2 MapReduce的错误处理方法

处理MapReduce错误的方法包括:

- **日志分析**: 利用日志记录来分析错误发生的原因。

- **重试机制**: 设置合理的重试次数和重试间隔,避免因临时错误导致作业失败。

- **容错机制**: 使用Hadoop提供的内置容错机制,比如数据复制。

- **资源监控**: 实时监控资源使用情况,及时发现并解决资源分配问题。

以上就是MapReduce的实战技巧的详细介绍。在掌握这些技巧后,我们可以更有效地设计和优化MapReduce作业,更好地应对在大数据处理中可能遇到的各种挑战。在下一章中,我们将详细探讨MapReduce在企业中的应用案例,了解它在实际

0

0