高效处理数据:MapReduce案例研究与最佳实践

发布时间: 2024-10-25 17:44:37 阅读量: 2 订阅数: 5

# 1. MapReduce的基本概念与原理

## 1.1 MapReduce定义与起源

MapReduce是一种编程模型,用于大规模数据集(Big Data)的并行运算。其名称源自该模型中的两个核心操作:Map(映射)和Reduce(归约)。MapReduce概念最早由Google的研究人员提出,并被广泛应用于分布式计算领域。

## 1.2 MapReduce工作原理

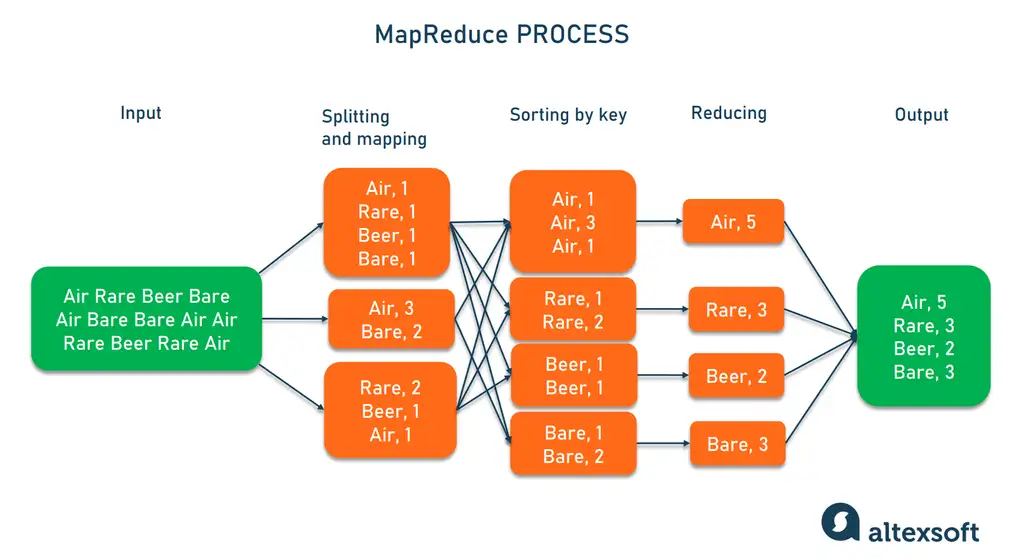

MapReduce作业分为两个阶段:Map阶段和Reduce阶段。在Map阶段,输入数据被分割成多个小块,并在多个节点上并行处理,输出中间键值对。在Reduce阶段,所有中间数据按键进行合并,相同的键值对会合并在一起,然后传递给Reduce函数进行处理,最终产生最终结果。

## 1.3 MapReduce的优势与应用场景

MapReduce最大的优势在于它的可扩展性和容错性,能够有效处理PB级别的数据。它适用于需要大量并行处理的场景,比如文本分析、日志挖掘、数据排序等。然而,它在需要实时处理或者数据规模不是很大的情况下,可能不是最优选择。

```java

// 一个简单的MapReduce示例代码

map(String key, String value):

// key: document name

// value: document contents

for each word w in value:

EmitIntermediate(w, "1");

reduce(String key, Iterator values):

// key: a word

// values: a list of counts

int result = 0;

for each v in values:

result += ParseInt(v);

Emit(key, result);

```

MapReduce通过将任务分解成可并行处理的部分,以及在多个节点上分布式计算,极大地提高了大规模数据处理的效率。在理解了MapReduce的基本概念和工作原理后,接下来的章节将深入分析其在不同领域的应用案例。

# 2. MapReduce案例深入剖析

MapReduce不仅仅是一个编程模型,更是一种强大的数据处理工具,能够解决大数据领域的各种复杂问题。本章节将深入探讨MapReduce在不同领域的具体应用案例,使读者能够全面理解其实际作用与效益。

### 2.1 MapReduce在文本处理中的应用

文本处理是MapReduce应用最广泛的领域之一,下面将详细分析两个典型的文本处理案例:日志文件分析和大规模文本数据排序。

#### 2.1.1 日志文件分析案例

日志文件是互联网公司积累的宝贵资源,它们记录了用户的行为模式、系统运行情况等信息。通过对日志文件的分析,企业能够洞察用户需求,优化服务体验。

##### 案例分析

一个典型的日志文件分析过程如下:

1. **输入阶段**:读取日志文件,将其按行划分成一个个小的数据块。

2. **Map阶段**:编写Map函数提取日志中的关键信息,例如IP地址、访问时间、请求路径等。

3. **Shuffle阶段**:根据Map输出结果的key值进行排序,并分发到不同的Reduce任务。

4. **Reduce阶段**:汇总相同key的日志信息,进行统计分析,如统计访问频次、访问时长等。

5. **输出阶段**:将结果输出到存储系统中,如HDFS。

```java

// Map函数的伪代码示例

public void map(LongWritable key, Text value) {

// 每一行日志解析

String logLine = value.toString();

String ip = parseIP(logLine);

// 输出key-value对

emit(ip, new IntWritable(1));

}

```

```java

// Reduce函数的伪代码示例

public void reduce(Text key, Iterable<IntWritable> values) {

int count = 0;

for(IntWritable val : values) {

count += val.get();

}

// 输出每个IP的访问次数

emit(key, new IntWritable(count));

}

```

##### 执行逻辑说明

Map阶段的关键在于对日志的解析,将一条完整的日志分割成若干个我们需要的数据字段。Reduce阶段则是对相同key(如相同的IP地址)的value(访问次数)进行累加。上述代码片段仅作为逻辑示意,实际应用中需要根据具体的日志格式进行相应的解析与数据类型定义。

#### 2.1.2 大规模文本数据排序案例

排序是文本处理中的一个常见需求,对于大规模的数据集来说,普通的排序算法难以胜任。MapReduce的排序操作则可以通过分布式处理来高效完成。

##### 案例分析

大规模文本数据排序可以采用MapReduce来完成,具体流程如下:

1. **输入阶段**:输入待排序的文本数据。

2. **Map阶段**:读取数据后直接输出原始数据作为key,value设为固定值,例如`null`。

3. **Shuffle阶段**:由于key相同,数据会被自动排序并发送到同一个Reducer。

4. **Reduce阶段**:Reducer接收到的value是连续的,直接将它们写入文件即可。

5. **输出阶段**:最终输出的文件即为排序后的结果。

```java

// Map函数的伪代码示例

public void map(LongWritable key, Text value) {

// 直接将输入数据作为key输出,value设为null

emit(value, NullWritable.get());

}

```

##### 执行逻辑说明

在这个案例中,由于Map阶段的输出key直接就是待排序的数据,所以Shuffle阶段后所有相同key的数据都会被送到同一个Reducer中。因为数据是按照key的字典顺序排列的,所以Reduce阶段只需按顺序输出即可完成排序。这种方法避免了复杂的排序算法,利用了MapReduce的内建排序机制。

### 2.2 MapReduce在数据挖掘中的应用

数据挖掘是通过分析大量的数据来揭示其中隐藏的模式、未知的关联以及发展趋势等。MapReduce的并行处理能力使其在数据挖掘领域中具有显著优势。

#### 2.2.1 用户行为分析案例

用户行为分析通过分析用户在网站或应用中的行为模式,可以提供宝贵的市场和产品改进信息。

##### 案例分析

用户行为分析的MapReduce处理流程如下:

1. **输入阶段**:读取用户行为日志数据。

2. **Map阶段**:提取关键行为信息,如浏览页面、购买商品等。

3. **Shuffle阶段**:将相同用户ID的行为数据分组。

4. **Reduce阶段**:对每个用户的行为进行统计分析,如计算平均浏览时间、平均购买次数等。

5. **输出阶段**:将分析结果输出到HDFS。

```java

// Map函数的伪代码示例

public void map(LongWritable key, Text value) {

// 提取用户ID和行为信息

String userId = extractUserId(value);

String behavior = extractBehavior(value);

emit(userId, new Text(behavior));

}

```

```java

// Reduce函数的伪代码示例

public void reduce(Text key, Iterable<Text> values) {

// 对每个用户的行为信息进行统计分析

Map<String, Integer> behaviorStats = new HashMap<>();

for(Text val : values) {

// 更新行为统计

}

// 输出统计结果

emit(key, new Text(mapToString(behaviorStats)));

}

```

##### 执行逻辑说明

在这个案例中,Map阶段提取了用户行为数据,并以用户ID作为key输出,以便在Shuffle阶段将同一用户的行为分组到同一个Reducer。Reduce阶段负责对用户的各项行为进行汇总统计。由于MapReduce可以处理TB甚至PB级别的数据,因此非常适合于大规模用户行为的分析。

#### 2.2.2 关联规则挖掘案例

关联规则挖掘的目标是在大量数据中发现项集之间的有趣关联,如购物篮分析,识别哪些商品通常一起被购买。

##### 案例分析

关联规则挖掘通常会采用Apriori算法,MapReduce的实现步骤如下:

1. **输入阶段**:读取交易数据。

2. **Map阶段**:每个交易被视为一个项集,输出项集中的所有项。

3. **Shuffle阶段**:将相同项的项集合并到一起。

4. **Reduce阶段**:计算频繁项集,剪枝非频繁项集。

5. **输出阶段**:输出所有频繁项集及关联规则。

```java

// Map函数的伪代码示例

public void map(LongWritable key, Text value) {

// 将每条交易数据分割成项集

Set<String> itemset = splitTransaction(value.toString());

for(String item : itemset) {

emit(item, NullWrita

```

0

0