【矩阵初学者指南】:15个关键概念和应用,助你轻松掌握

发布时间: 2024-08-24 06:57:07 阅读量: 49 订阅数: 37

webgl-978-1-8496-9172-7:WebGL 初学者指南

# 1. 矩阵基础概念

矩阵是一种二维数组,用于表示和操作数据。它由行和列组成,每个元素表示一个特定位置的值。矩阵在数学、科学和工程等领域有着广泛的应用。

### 1.1 矩阵的表示

矩阵通常用大写字母表示,例如 A。矩阵中的元素用下标表示,例如 A[i, j] 表示第 i 行第 j 列的元素。例如,矩阵 A 可以表示为:

```

A = | a11 a12 a13 |

| a21 a22 a23 |

| a31 a32 a33 |

```

其中,a11 是第 1 行第 1 列的元素,a23 是第 2 行第 3 列的元素。

# 2. 矩阵运算技巧

矩阵运算技巧是矩阵理论中至关重要的基础知识,它为矩阵的实际应用奠定了基础。本章节将介绍矩阵加减法、数乘、乘法和行列式的基本概念和性质,为后续的矩阵应用提供必要的理论支撑。

### 2.1 矩阵加减法和数乘

**2.1.1 矩阵加减法的性质**

矩阵加减法是针对同型矩阵(即行数和列数相同的矩阵)进行的。两个同型矩阵的加法结果是一个新的矩阵,其元素是对应位置元素的和;两个同型矩阵的减法结果也是一个新的矩阵,其元素是对应位置元素的差。

矩阵加减法满足以下性质:

- 交换律:A + B = B + A

- 结合律:A + (B + C) = (A + B) + C

- 零元素:对于任何矩阵 A,0 + A = A

- 相反数:对于任何矩阵 A,-A + A = 0

**2.1.2 矩阵数乘的意义**

矩阵数乘是指一个矩阵与一个标量的乘法。标量可以是实数或复数。矩阵数乘的结果是一个新的矩阵,其元素是原矩阵元素与标量的乘积。

矩阵数乘的意义在于:

- 放缩:矩阵数乘可以对矩阵进行放缩。标量为正时,矩阵被放大;标量为负时,矩阵被缩小。

- 线性组合:矩阵数乘可以对矩阵进行线性组合。多个矩阵与不同标量的乘积相加,得到一个新的矩阵。

### 2.2 矩阵乘法

**2.2.1 矩阵乘法的定义和性质**

矩阵乘法是两个矩阵之间的运算。矩阵 A 的行数必须与矩阵 B 的列数相等,才能进行矩阵乘法。矩阵乘法的结果是一个新的矩阵,其元素是矩阵 A 的行元素与矩阵 B 的列元素的内积。

矩阵乘法满足以下性质:

- 结合律:A(BC) = (AB)C

- 分配律:A(B + C) = AB + AC

- 单位矩阵:对于任何矩阵 A,IA = AI = A

- 转置:对于矩阵 A 和 B,(AB)<sup>T</sup> = B<sup>T</sup>A<sup>T</sup>

**2.2.2 矩阵乘法的应用**

矩阵乘法在实际应用中有着广泛的应用,例如:

- 线性变换:矩阵乘法可以表示线性变换。矩阵 A 乘以向量 x,得到一个新的向量 y,表示向量 x 在线性变换 A 下的变换结果。

- 求解线性方程组:矩阵乘法可以用于求解线性方程组。将方程组写成矩阵形式,通过矩阵乘法可以将方程组化为求解矩阵 A 的逆矩阵的问题。

### 2.3 矩阵的行列式

**2.3.1 行列式的定义和性质**

行列式是一个与方阵(即行数和列数相等的矩阵)相关联的标量。行列式的值可以用来判断方阵是否可逆,求解线性方程组,以及计算矩阵的面积或体积。

行列式满足以下性质:

- 行列式展开定理:行列式可以按任意一行或一列展开。

- 伴随矩阵:方阵 A 的伴随矩阵 A<sup>*</sup> 的行列式等于 A 的行列式。

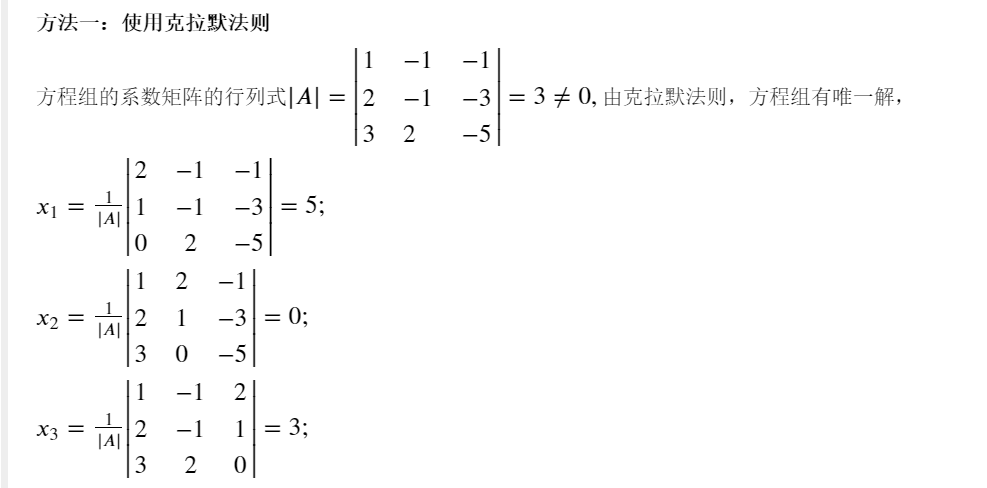

- 克拉默法则:对于 n 阶方阵 A 和 n 个未知数的线性方程组 Ax = b,如果 A 的行列式不为零,则方程组有唯一解。

**2.3.2 行列式的求解方法**

求解行列式的方法有多种,常用的方法包括:

- 直接展开:对于低阶方阵,可以直接按行列式展开定理展开求解。

- 递归求解:对于高阶方阵,可以使用递归的方法,将行列式化为低阶行列式的和或差。

- 高斯消元:将方阵化为上三角矩阵或下三角矩阵,行列式的值等于对角线元素的乘积。

# 3.1 矩阵在物理学中的应用

#### 3.1.1 矩阵在力学中的应用

矩阵在力学中有着广泛的应用,特别是在描述刚体运动和弹性力学方面。

**刚体运动**

刚体运动可以表示为一个旋转矩阵和一个平移向量。旋转矩阵描述了刚体相对于其初始位置的旋转,而平移向量描述了刚体的位移。通过使用矩阵,我们可以方便地表示和操作刚体运动。

例如,考虑一个刚体绕其质心旋转 θ 角。旋转矩阵 R 可以表示为:

```

R = [cos(θ) -sin(θ) 0]

[sin(θ) cos(θ) 0]

[0 0 1]

```

**弹性力学**

矩阵在弹性力学中也扮演着重要的角色。弹性力学研究材料在受到外力作用时的变形和应力。

例如,考虑一个弹性杆,其横截面积为 A,长度为 L,杨氏模量为 E。杆受到一个轴向力 F。杆的应变 ε 可以表示为:

```

ε = F / (AE)

```

应力 σ 可以表示为:

```

σ = Eε = F / A

```

#### 3.1.2 矩阵在电磁学中的应用

矩阵在电磁学中也有着广泛的应用,特别是在描述电场和磁场方面。

**电场**

电场可以表示为一个矩阵,其中元素表示电场在不同方向上的分量。例如,考虑一个均匀电场,其电场强度为 E。电场矩阵 E 可以表示为:

```

E = [E_x]

[E_y]

[E_z]

```

**磁场**

磁场也可以表示为一个矩阵,其中元素表示磁场在不同方向上的分量。例如,考虑一个均匀磁场,其磁场强度为 B。磁场矩阵 B 可以表示为:

```

B = [B_x]

[B_y]

[B_z]

```

# 4.1 矩阵的特征值和特征向量

### 4.1.1 特征值和特征向量的定义

**特征值**:对于一个方阵 **A**,如果存在一个非零向量 **x**,使得 **Ax = λx**,其中 **λ** 是一个标量,那么 **λ** 称为方阵 **A** 的特征值,**x** 称为方阵 **A** 对应于特征值 **λ** 的特征向量。

**特征向量**:对于一个方阵 **A**,如果存在一个非零向量 **x**,使得 **Ax = λx**,其中 **λ** 是一个标量,那么 **x** 称为方阵 **A** 对应于特征值 **λ** 的特征向量。

### 4.1.2 特征值和特征向量的求解方法

**特征值的求解**:

求解特征值 **λ** 需要解方程组 **(A - λI)x = 0**,其中 **I** 是单位矩阵。这个方程组有非零解的条件是方阵 **(A - λI)** 的行列式为零,即:

```

det(A - λI) = 0

```

求解这个特征方程可以得到方阵 **A** 的特征值。

**特征向量的求解**:

对于每个特征值 **λ**,求解方程组 **(A - λI)x = 0** 即可得到对应的特征向量 **x**。

**代码示例:**

```python

import numpy as np

# 定义方阵 A

A = np.array([[2, 1], [-1, 2]])

# 求解特征值

eig_vals, eig_vecs = np.linalg.eig(A)

print("特征值:", eig_vals)

# 求解特征向量

for i in range(len(eig_vals)):

print("特征值 {} 对应的特征向量:".format(eig_vals[i]))

print(eig_vecs[:, i])

```

**逻辑分析:**

* `np.linalg.eig()` 函数用于求解方阵的特征值和特征向量。

* `eig_vals` 存储特征值,`eig_vecs` 存储特征向量。

* `eig_vecs[:, i]` 表示第 `i` 个特征向量。

**参数说明:**

* `A`:要求解特征值和特征向量的方阵。

# 5.1 矩阵在主成分分析中的应用

### 5.1.1 主成分分析的原理和步骤

主成分分析(PCA)是一种常用的降维技术,它通过将原始数据投影到一个新的正交坐标系上,将高维数据转换为低维数据,同时保留原始数据中尽可能多的信息。

PCA的原理如下:

1. **标准化数据:**将原始数据中的每个特征按均值和标准差进行标准化,以消除量纲的影响。

2. **计算协方差矩阵:**计算标准化后的数据之间的协方差矩阵,协方差矩阵表示了数据中各个特征之间的相关性。

3. **求解协方差矩阵的特征值和特征向量:**协方差矩阵是一个对称矩阵,其特征值是实数,特征向量是正交的。特征值表示了每个特征对数据方差的贡献,特征向量表示了每个特征在新的坐标系中的方向。

4. **选择主成分:**根据特征值的大小,选择前几个特征值对应的特征向量作为主成分。主成分的个数决定了降维后的数据的维数。

5. **投影数据:**将原始数据投影到主成分组成的新的坐标系上,得到降维后的数据。

### 5.1.2 矩阵在主成分分析中的作用

矩阵在PCA中扮演着至关重要的角色:

- **协方差矩阵:**协方差矩阵是一个对称矩阵,其元素表示了数据中各个特征之间的协方差。协方差矩阵的特征值和特征向量可以用来确定主成分。

- **特征值分解:**特征值分解是求解协方差矩阵特征值和特征向量的过程。特征值分解可以使用矩阵运算来实现。

- **投影矩阵:**投影矩阵是由主成分组成的矩阵。投影矩阵用于将原始数据投影到主成分组成的新的坐标系上。

```python

import numpy as np

from sklearn.decomposition import PCA

# 原始数据

data = np.array([[1, 2, 3], [4, 5, 6], [7, 8, 9]])

# 标准化数据

data_std = (data - np.mean(data, axis=0)) / np.std(data, axis=0)

# 计算协方差矩阵

cov_matrix = np.cov(data_std, rowvar=False)

# 求解协方差矩阵的特征值和特征向量

eigenvalues, eigenvectors = np.linalg.eig(cov_matrix)

# 选择主成分

num_components = 2

eigenvectors_selected = eigenvectors[:, :num_components]

# 投影数据

data_pca = np.dot(data_std, eigenvectors_selected)

```

**代码逻辑分析:**

1. 使用`numpy.cov()`函数计算协方差矩阵。

2. 使用`numpy.linalg.eig()`函数求解协方差矩阵的特征值和特征向量。

3. 选择前`num_components`个特征值对应的特征向量作为主成分。

4. 使用`numpy.dot()`函数将原始数据投影到主成分组成的新的坐标系上。

# 6. 矩阵在人工智能中的应用

### 6.1 矩阵在神经网络中的应用

#### 6.1.1 神经网络的结构和工作原理

神经网络是一种受生物神经系统启发的机器学习模型,由称为神经元的相互连接层组成。每个神经元接收一组输入,执行非线性转换,然后输出一个值。神经网络通过训练调整其连接权重,以学习从输入数据中提取特征并预测输出。

#### 6.1.2 矩阵在神经网络中的作用

矩阵在神经网络中扮演着至关重要的角色:

- **权重矩阵:**每个神经元与前一层神经元连接的权重表示为一个矩阵。权重矩阵确定了神经元如何组合输入信号。

- **输入矩阵:**输入数据表示为一个矩阵,其中每行代表一个样本,每列代表一个特征。

- **输出矩阵:**神经网络的输出是一个矩阵,其中每行代表一个样本,每列代表一个预测类别或连续值。

### 6.2 矩阵在自然语言处理中的应用

#### 6.2.1 自然语言处理的任务和挑战

自然语言处理(NLP)涉及计算机理解和生成人类语言。NLP任务包括文本分类、情感分析和机器翻译。这些任务通常涉及处理大量文本数据,其中矩阵发挥着关键作用。

#### 6.2.2 矩阵在自然语言处理中的作用

矩阵在NLP中广泛用于:

- **词嵌入矩阵:**词嵌入矩阵将单词映射到一个低维向量空间,其中语义相似的单词具有相似的向量表示。

- **共现矩阵:**共现矩阵捕获单词在文本中同时出现的频率,用于识别单词之间的关系和提取主题。

- **转换矩阵:**转换矩阵用于在不同的语言或文本表示之间转换,例如词性标注或语言翻译。

0

0