【Java 8 Map特技】:掌握这些新特性,Map数量优化不再难

发布时间: 2024-10-31 21:09:42 阅读量: 13 订阅数: 18

# 1. Java 8中的Map接口简介

Java 8中Map接口作为编程中不可或缺的一部分,提供了存储键值对的泛型集合。相比之前的版本,Java 8对Map接口进行了优化与改进,以支持更多的功能和操作。本章我们将了解Map接口的基础,包括它的主要实现类以及在Java 8中的基本用法。随着后续章节的深入,我们将探讨Java 8为Map接口带来的新特性,以及如何在日常开发中高效地应用这些特性。

```java

// 示例代码:创建并使用Map的基本操作

Map<String, Integer> map = new HashMap<>();

map.put("Java", 8);

map.put("Map", 1);

map.get("Java"); // 返回8

map.containsKey("Map"); // 返回true

```

在此示例中,我们创建了一个`HashMap`实例,并演示了如何添加键值对、获取值以及检查键是否存在。这仅是Java 8中Map接口的冰山一角,更多高级特性和最佳实践将在接下来的章节中详细介绍。

# 2. Java 8 Map接口的新特性探究

### 2.1 Lambda表达式的运用

#### 2.1.1 Lambda表达式基本概念

在Java 8中,Lambda表达式提供了一种简洁的方式来表示可传递的匿名函数。Lambda表达式通常用于那些只使用一次的函数式接口。在Map接口的操作中,Lambda表达式可以使得代码更加简洁和易于理解。

Lambda表达式的基本语法如下:

```

(parameters) -> expression

(parameters) -> { statements; }

```

这里,参数列表对应函数式接口的输入参数,箭头将参数列表与表达式体分开,表达式体定义了函数式接口的实现,可由单个表达式或语句块组成。

#### 2.1.2 Lambda与函数式接口的结合

在Map操作中,Lambda表达式通常与函数式接口一起使用,如`Consumer`、`Function`、`Predicate`等。例如,使用`forEach`方法结合Lambda表达式来遍历Map:

```java

map.forEach((key, value) -> System.out.println("Key: " + key + ", Value: " + value));

```

在这个例子中,`(key, value) -> System.out.println("Key: " + key + ", Value: " + value)`是一个Lambda表达式,它被传递给`forEach`方法,该方法接受一个`BiConsumer`函数式接口参数。

### 2.2 Stream API的集成

#### 2.2.1 Stream API概述

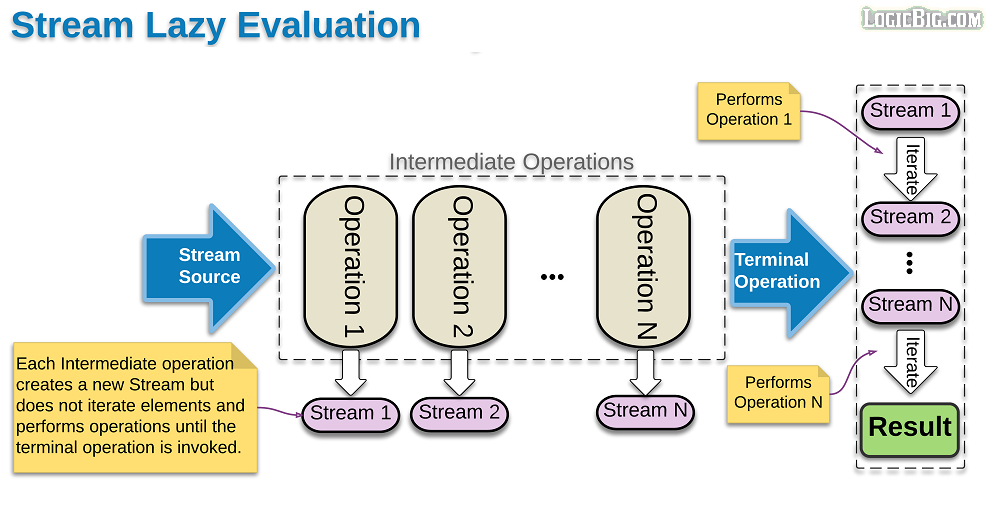

Java 8引入了Stream API,它允许对集合对象进行函数式操作。Stream API是Java集合框架的补充,可以用来处理数组或集合中的数据。对于Map而言,Stream API可以使得对键、值或键值对的操作变得更加灵活。

Stream API操作分为两种:中间操作(如`filter`, `map`)和终端操作(如`forEach`, `collect`)。中间操作返回一个Stream实例,可以进行链式调用;终端操作则会触发实际的计算,并返回结果。

#### 2.2.2 使用Stream处理Map数据流

处理Map时,我们常常需要将数据提取为一个流进行操作。例如,我们可以使用`map`方法来转换键值对:

```java

List<String> keys = map.keySet().stream()

.map(key -> key.toUpperCase())

.collect(Collectors.toList());

```

这段代码将Map中的所有键转换为大写,并收集到一个新的列表中。`map`方法接受一个`Function`接口的Lambda表达式,用于转换每个键。

### 2.3 新的Map接口实现

#### 2.3.1 HashMap的性能改进

Java 8对HashMap进行了优化,改进了哈希表的实现,减少了哈希碰撞的概率,并且在处理哈希冲突时使用了平衡树结构,从而提高了性能。这主要通过在链表长度超过阈值时将链表转换为红黑树来实现。

这种改进在处理大量数据时尤其有效,可以显著提高查找、插入和删除操作的效率。

#### 2.3.2 ConcurrentHashMap的并发增强

ConcurrentHashMap在Java 8中也得到了增强。新增的`compute`, `merge`, `forEach`等方法使得并发操作更加方便和高效。这些方法利用了`CAS`(Compare-And-Swap)操作,减少了锁的使用,从而提高了并发性能。

```java

ConcurrentHashMap<String, String> map = new ConcurrentHashMap<>();

***pute("key", (k, v) -> (v == null) ? "value" : v.toUpperCase());

```

在这个例子中,`compute`方法接受一个键和一个BiFunction函数式接口,根据当前值计算新值。

#### 2.3.3 TreeMap的排序特性

TreeMap在Java 8中保留了其基于红黑树的排序特性。Java 8增加了`compute`, `merge`, `forEach`等方法,这些方法提供了函数式编程的能力,使得TreeMap的操作更加简洁。

```java

TreeMap<String, Integer> map = new TreeMap<>();

map.merge("key", 1, Integer::sum);

```

这段代码使用`merge`方法来增加一个键的值,如果键不存在,则添加键值对。

以上小节中的内容展示了Java 8中Map接口在使用Lambda表达式和Stream API方面的创新,以及在性能改进和并发增强方面的新特性。在后续的小节中,我们将继续深入探索Map的高级操作实践。

# 3. Map的高级操作实践

## 3.1 使用Collectors类简化收集器的使用

### 3.1.1 收集器的基本使用

Collectors类是Java 8中引入的一个强大的工具类,它为Stream API中的收集操作提供了众多预定义的实现。这些收集器使得以声明式的方式,将流(Stream)中的元素收集到各种数据结构中变得异常简单。收集器可以分为三大类:归约、分组、分区。

在基本的使用场景中,我们可以用`Collectors.toList()`来将流中的元素收集到列表中,使用`Collectors.toSet()`来收集到集合中去除重复元素,而`Collectors.toMap()`则可以收集到Map中,以键值对的形式存储数据。

```java

List<String> names = Arrays.asList("Alice", "Bob", "Charlie", "David", "Eve");

List<String> nameList = names.stream().collect(Collectors.toList());

Set<String> nameSet = names.stream().collect(Collectors.toSet());

Map<String, Integer> nameLengthMap = names.stream()

.collect(Collectors.toMap(name -> name, String::length));

```

在上述代码中,我们分别将名字列表收集到了`List`、`Set`和`Map`中。这些操作非常直观且方便,是处理集合数据时不可或缺的工具。

### 3.1.2 分组、分区与收集数据

分组和分区是Collectors类中更为高级的特性。分组允许我们根据某个属性将数据分组到Map中,而分区则是将数据分为两组,一组满足条件,一组不满足。

举一个简单的例子,我们有一个产品列表,其中每个产品对象包含产品名称和价格。我们可能想要根据价格的高低对产品进行分组,或者根据产品是否属于某个分类进行分区。

```java

List<Product> products = // 假设这是一个产品列表

Map<String, List<Product>> productByCategory = products.stream()

.collect(Collectors.groupingBy(Product::getCategory));

Map<Boolean, List<Product>> productByPrice = products.stream()

.collect(Collectors.partitioningBy(p -> p.getPrice() > 100));

```

在第一段代码中,产品根据它们的分类被分组,而在第二段代码中,产品根据价格是否高于100被分成两组。

## 3.2 Map的合并和转换

### 3.2.1 合并Map的策略和方法

在处理多个Map的时候,合并它们是一个常见的需求。合并Map的关键在于定义好合并的策略,例如,当两个Map中存在相同的键时,我们是选择保留前者的值还是后者的值?还是根据某些规则进行合并?

Java 8提供的`Map.merge`方法可以用于合并Map,它提供了对合并逻辑的控制。假设我们有两个Map,分别代表两个不同的数据源,我们想要合并这两个Map,当出现相同的键时,以第二个Map的值为准:

```java

Map<String, Integer> map1 = Map.of("a", 1, "b", 2);

Map<String, Integer> map2 = Map.of("b", 3, "c", 4);

map1.forEach((k, v) -> map2.merge(k, v, Integer::max

```

0

0