深度学习在NLP中的应用:自然语言处理的突破与实践

发布时间: 2024-09-05 10:06:15 阅读量: 90 订阅数: 51

# 1. 深度学习与自然语言处理的融合

自然语言处理(NLP)是计算机科学和人工智能领域的一个分支,旨在使计算机能够理解、解释和生成人类语言。近年来,深度学习在自然语言处理领域取得了重大进展,这得益于其能够从原始数据中学习到复杂的表示。本章将探讨深度学习与自然语言处理如何融合,以及这种融合如何推动了NLP的发展。

## 1.1 融合的必要性

NLP任务通常涉及语言理解的各个方面,包括语法分析、句法结构理解、语义识别和情感分析等。这些任务要求算法能够处理多层次的语言特征,而传统机器学习方法往往需要手工设计特征,这既耗时又受限于设计者自身的知识水平。深度学习的出现克服了这些限制,通过自动学习数据的层次化特征表示,使机器能够更自然地理解和处理语言。

## 1.2 应用案例

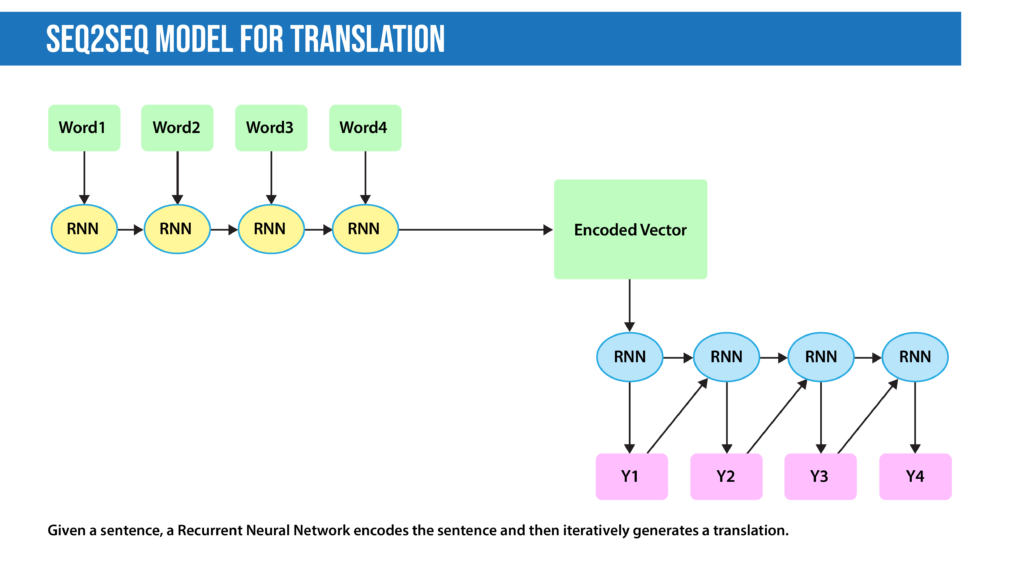

在深度学习和NLP的融合应用中,我们可以看到显著的例子,例如机器翻译、情感分析、语音识别等。深度学习模型通过自动编码和解码语言的复杂模式,极大地提高了这些任务的准确性和效率。例如,神经机器翻译系统利用深度学习模型来学习不同语言间的映射关系,成功实现了从一种语言到另一种语言的翻译。

## 1.3 未来展望

尽管深度学习已经在NLP领域取得了显著成就,但仍面临诸多挑战,如模型的可解释性、处理长距离依赖问题以及跨领域适应性等。未来的研究将朝着解决这些问题的方向发展,进一步推进NLP技术的进步。随着计算能力的增强和数据资源的丰富,深度学习与自然语言处理的融合将不断开辟新的应用场景,对人类的生产、生活产生深远的影响。

通过本章,我们对深度学习与NLP的融合有了初步了解,并对这一领域的潜力和挑战有了基本的认识。接下来的章节将详细探讨NLP的深度学习基础理论和具体的技术应用。

# 2. NLP的深度学习基础理论

## 2.1 深度学习模型简介

### 2.1.1 神经网络的基本概念

神经网络是深度学习中最核心的模型之一。它试图通过模仿人脑神经元的结构和工作方式来处理信息。在一个简化的人工神经网络中,一个基本的单元被称为神经元,它可以接收输入,进行加权求和,再通过一个激活函数,输出一个值。神经元之间相互连接,通过网络层传递信号。

深度学习特别指使用深层网络结构,这些结构通常包含多个隐藏层。每一层都学习输入数据的不同表示。网络的深度让它能够捕捉和抽象出更复杂的模式。神经网络的学习通常基于大量的数据和反向传播算法,后者负责计算误差并相应地调整网络权重。

### 2.1.2 前馈神经网络和反向传播算法

前馈神经网络是深度学习中使用最广泛的一类神经网络。在这类网络中,数据流动是单向的,没有反馈或循环连接。每层的神经元只与下一层的神经元连接。前馈神经网络特别适合于处理静态数据,例如图像识别或分类任务。

反向传播算法是训练神经网络的一种有效方法。它的核心思想是利用链式法则计算损失函数相对于网络权重的梯度,然后根据这个梯度进行权重的更新,以最小化损失函数。其过程可以分为两个阶段:前向传播,计算输出和误差;反向传播,更新权重。这种权重更新的机制,使得网络能够在数据上学习到更加准确的模式。

```python

import numpy as np

# 定义简单的前馈网络参数和计算过程

def sigmoid(x):

return 1 / (1 + np.exp(-x))

def sigmoid_derivative(x):

return x * (1 - x)

# 输入数据

X = np.array([0.5, 0.2])

# 隐藏层参数

W1 = np.array([[0.15, 0.2], [0.25, -0.1]])

# 输出层参数

W2 = np.array([[-0.4], [0.3]])

# 前向传播计算

hidden_layer_input = np.dot(X, W1)

hidden_layer_output = sigmoid(hidden_layer_input)

output_layer_input = np.dot(hidden_layer_output, W2)

output_layer_output = sigmoid(output_layer_input)

print("输出层输出:", output_layer_output)

# 反向传播计算(简化示例)

# 假设真实输出为0,误差为预测输出与真实输出之差

error = output_layer_output - np.array([0])

# 计算输出层梯度

output_layer_gradient = error * sigmoid_derivative(output_layer_output)

# 假设学习率为0.1

learning_rate = 0.1

# 更新输出层权重

W2 -= learning_rate * np.dot(hidden_layer_output.T, output_layer_gradient)

# 更新隐藏层权重(隐藏层输出梯度)

hidden_layer_gradient = np.dot(output_layer_gradient, W2.T) * sigmoid_derivative(hidden_layer_output)

# 更新隐藏层权重

W1 -= learning_rate * np.dot(X.T, hidden_layer_gradient)

```

在上面的代码中,我们定义了一个简单的两层神经网络,包括一个输入层、一个隐藏层和一个输出层。通过前向传播,我们计算了预测输出。然后通过反向传播,我们计算了输出层的梯度,并使用它来更新网络权重。这个过程是网络学习的关键,通过反复迭代,网络能够提高其预测的准确性。

## 2.2 NLP中的关键概念和问题

### 2.2.1 自然语言处理的定义和重要性

自然语言处理(NLP)是计算机科学与语言学的交叉领域,它专注于使计算机能够理解、解释和操纵人类语言。NLP在智能助理、机器翻译、情感分析和内容推荐等多个领域都有广泛的应用。理解自然语言的能力是实现人工智能的关键步骤之一,因为它能够让机器与人类进行更自然的交互。

NLP的重要性不仅在于它可以提升用户体验,还在于它能够帮助从大量文本数据中提取有用信息,这对于数据密集型行业尤其重要。在医疗、法律、金融服务等行业,NLP技术可以帮助自动化信息处理和决策支持。

### 2.2.2 NLP中的常见问题和任务

NLP研究解决的问题包括但不限于文本分类、机器翻译、命名实体识别、情感分析、文本摘要等。这些问题和任务通常可以分为两大类:基于规则的方法和基于统计/机器学习的方法。

基于规则的方法依赖于对自然语言的语法和语义的深入理解。例如,早期的NLP系统会使用特定的语言规则来确定句子的句法结构。这种方法虽然在特定领域表现良好,但是它很难应对语言的多样性和复杂性。

基于统计的方法则利用大量的语言数据和机器学习算法来发现语言规律。这种方法更加灵活,能够适应语言的变化。深度学习技术的引入,特别是神经网络,极大提升了NLP任务的性能,使机器在某些任务上达到甚至超越人类水平。

### 2.2.3 词嵌入和分布式表示

词嵌入(Word Embeddings)是将单词映射到实数向量的技术,这些向量能够捕捉词之间的语义和语法关系。词嵌入通常用于将自然语言转换为机器学习模型能够处理的数值形式。词嵌入极大地提升了NLP任务的性能,因为它能够捕捉词的多义性以及上下文中的词义变化。

分布式表示(Distributed Representation)是词嵌入的一种形式,它使用低维连续向量表示单词,并假设单词的意义可以通过其分布来体现。这种表示方法通过向量之间的距离和角度来衡量词与词之间的相似性。Word2Vec 和 GloVe 是分布式表示的两个著名模型,它们通过无监督学习的方式从大量的文本中学习到单词的向量表示。

## 2.3 深度学习技术在NLP中的应用

### 2.3.1 循环神经网络(RNN)及其变种

循环神经网络(RNN)是一种特别适合处理序列数据的神经网络结构。与前馈神经网络不同,RNN 的输出不仅依赖于当前的输入,还依赖于之前的隐藏状态。这种结构使得 RNN 能够在一定程度上记忆历史信息,因此在处理自然语言等序列数据时具有明显优势。

然而,标准的 RNN 在处理长序列数据时,存在梯度消失或梯度爆炸的问题。为了解决这个问题,研究者提出了几种变种,如长短期记忆网络(LSTM)和门控循环单元(GRU)。

0

0