:ResNet在自然语言处理中的跨界应用:迁移学习新突破

发布时间: 2024-08-20 15:23:07 阅读量: 53 订阅数: 23

基于深度学习的ResNet与自然语言处理的GPT设计源码

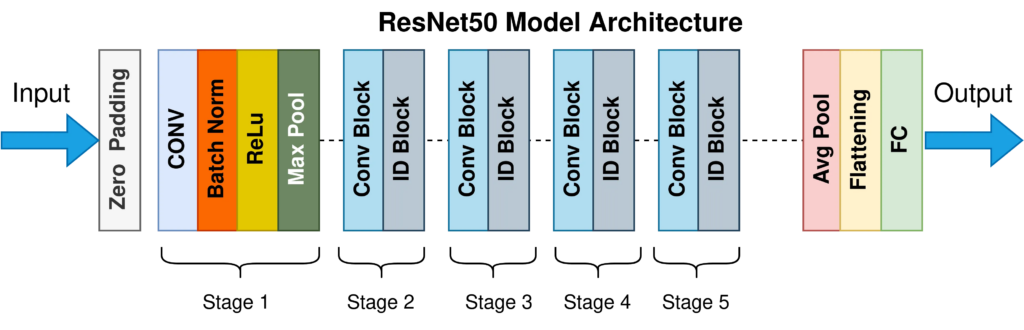

# 1. ResNet模型的理论基础

ResNet(残差网络)是一种深度卷积神经网络,由何恺明等人于2015年提出。它通过引入残差连接,解决了深度网络训练中的梯度消失问题,极大地提升了网络的性能。

ResNet模型的基本结构由残差块组成。每个残差块包含两个卷积层,其中第一个卷积层用于提取特征,第二个卷积层用于生成残差。残差是输入特征和第一个卷积层输出特征之间的差值。通过将残差与第二个卷积层的输出相加,可以得到最终的输出特征。

残差连接的引入使得网络可以学习到输入特征和输出特征之间的差异,从而避免了梯度消失问题。这使得ResNet模型可以训练到数百甚至上千层,大大提高了模型的特征提取能力。

# 2. ResNet模型在NLP中的迁移学习

### 2.1 预训练模型的获取和微调

#### 2.1.1 预训练模型的来源和选择

预训练模型是迁移学习的基础,其质量直接影响迁移学习的效果。获取预训练模型的主要途径有:

- **官方发布:**主流深度学习框架(如TensorFlow、PyTorch)通常提供经过预训练的ResNet模型,这些模型在ImageNet等大型图像数据集上训练。

- **第三方平台:**Hugging Face等平台提供了丰富的预训练模型库,涵盖NLP、计算机视觉等多个领域。

- **自训练:**对于特定任务,可以从头开始训练ResNet模型,并将其作为预训练模型。

在选择预训练模型时,需要考虑以下因素:

- **任务相关性:**预训练模型与目标任务的相似度越高,迁移效果越好。

- **模型大小:**模型大小影响训练和推理速度,需要根据任务需求和计算资源进行选择。

- **性能指标:**预训练模型在相关任务上的性能指标,如准确率、召回率等,可以作为选择依据。

#### 2.1.2 微调策略和超参数优化

微调是指在预训练模型的基础上,针对特定任务进行进一步训练。微调策略包括:

- **冻结参数:**冻结预训练模型的部分或全部参数,仅更新与目标任务相关的参数。

- **全微调:**更新预训练模型的所有参数,但学习率通常较低。

- **部分微调:**只更新预训练模型中特定层的参数,如输出层或中间层。

超参数优化是微调过程中不可或缺的一步,包括:

- **学习率:**控制模型更新幅度,过大易导致不稳定,过小则收敛速度慢。

- **批量大小:**影响模型训练速度和稳定性,需要根据数据量和计算资源进行调整。

- **训练轮次:**微调轮次过多可能导致过拟合,过少则效果不佳。

### 2.2 迁移学习的应用场景

ResNet模型在NLP中的迁移学习已广泛应用于以下场景:

#### 2.2.1 文本分类和情感分析

文本分类是指将文本片段归类到预定义的类别中,情感分析是指识别文本的情感极性(正面、负面或中性)。ResNet模型通过迁移图像分类任务中学到的特征提取能力,可以有效提升文本分类和情感分析任务的性能。

#### 2.2.2 机器翻译和摘要生成

机器翻译是指将一种语言的文本翻译成另一种语言,摘要生成是指从较长的文本中提取出更简洁、信息丰富的摘要。ResNet模型在这些任务中发挥着重要作用,通过迁移图像处理任务中学到的序列处理能力,可以有效处理文本序列。

#### 2.2.3 负迁移的产生和应对措施

负迁移是指迁移学习后,模型在目标任务上的性能下降。负迁移可能由以下原因引起:

- **特征不匹配:**预训练模型和目标任务的特征分布不同,导致模型无法有效提取相关特征。

- **过拟合:**预训练模型在源任务上过拟合,导致其在目标任务上泛化能力差。

- **参数冲突:**预训练模型和目标任务的参数空间冲突,导致模型难以收敛。

应对负迁移的措施包括:

- **选择相关性高的预训练模型:**减少特征不匹配的可能性。

- **使用适当的微调策略:**防止过拟合,如冻结预训练模型的部分参数。

- **引入正则化技术:**抑制参数冲突,如L1/L2正则化。

### 2.3 迁移学习的局限性和挑战

ResNet模型在NLP中的迁移学习也存在一些局限性和挑战:

- **数据分布差异:**NLP任务中的数据分布往往与图像分类任务不同,这可能导致迁移学习效果不佳。

- **模型复杂度:**ResNet模型结构复杂,训练和推理成本较高,对于资源受限的场景可能不适用。

- **可解释性差:**ResNet模型是一种黑盒模型,其内部机制难以理解,这限制了其在某些应用中的使用。

# 3. ResNet模型在NLP中的实践应用

### 3.1 文本分类任务

#### 3.1.1 数据预处理和特征工程

在文本分类任务中,数据预处理和特征工程是至关重要的步骤。数据预处理包括文本清洗、分词、词干化和去停用词等操作。特征工程则涉及到将文本数据转换为适合ResNet模型训练的特征向量。

常用的文本特征工程方法包括:

- **词袋模型(Bag-of-Words,BoW):**将文本表示为一个单词出现频率的向量。

- **TF-IDF:**考虑单词在文本中出现的频率和在语料库中出现的频率,对BoW模型进行加权。

- **词嵌入:**将单词映射到一个低维稠密向量空间,捕获

0

0